用于自動駕駛賽車的多模態傳感器融合和目標跟蹤

本文經自動駕駛之心公眾號授權轉載,轉載請聯系出處。

原標題:Multi-Modal Sensor Fusion and Object Tracking for Autonomous Racing

論文鏈接:https://arxiv.org/pdf/2310.08114.pdf

代碼鏈接:https://github.com/TUMFTM/FusionTracking

作者單位:慕尼黑工業大學

期刊:IEEE TRANSACTIONS ON INTELLIGENT VEHICLES

論文思路:

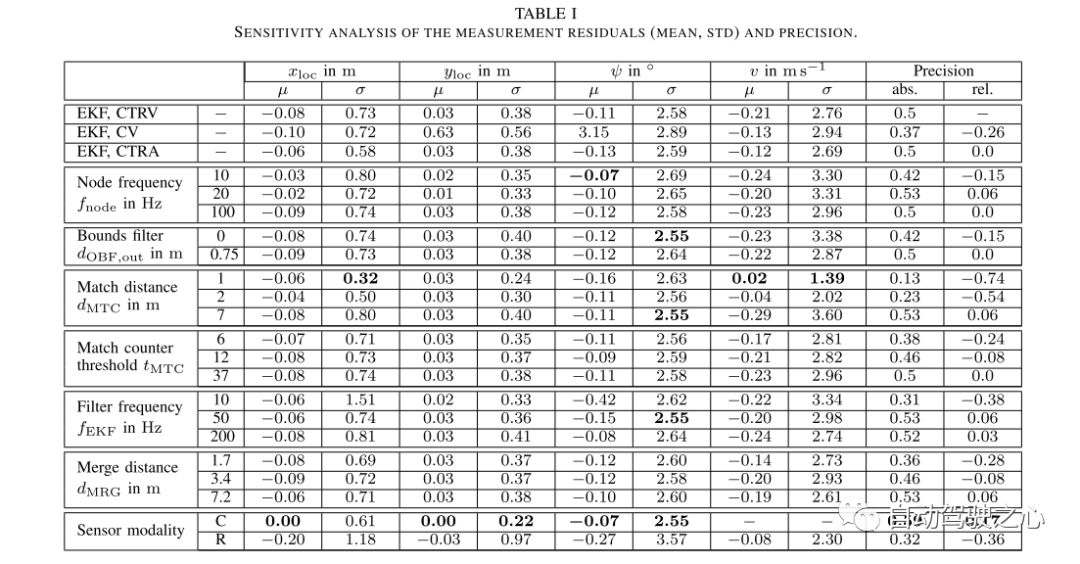

對周圍目標的可靠檢測和跟蹤是自動駕駛車輛綜合運動預測和規劃必不可少的。由于單個傳感器的局限性,需要多傳感器模態融合來提高整體檢測能力。此外,魯棒運動跟蹤對于降低傳感器噪聲的影響,提高狀態估計精度至關重要。自動駕駛汽車軟件的可靠性在復雜、競爭激烈的高速場景下變得更加重要。本文提出了一種適用于高速應用的模塊化多模態傳感器融合與跟蹤方法。該方法基于擴展卡爾曼濾波器(Extended Kalman Filter) (EKF),能夠融合異構檢測輸入來一致地跟蹤周圍物體。一種新穎的延遲補償方法能夠減少感知軟件延遲的影響,并輸出一個更新的目標列表。這是第一個在Indy Autonomous Challenge 2021和CES (AC@CES) 2022的高速現實場景中驗證的融合和跟蹤方法,證明了它在嵌入式系統上的魯棒性和計算效率。它不需要任何標記數據,實現0.1 m以下的位置跟蹤殘差(residuals)。

主要貢獻:

一種用于多模態異構檢測的模塊化后期融合方法

一種通過運動學前后積分(kinematic backward-forward integration)進行延遲補償的感知軟件。

跟蹤算法在完整的自動駕駛軟件中的實際應用中得到驗證,用于速度高達 270 的自動駕駛賽車 [4]、[5]。

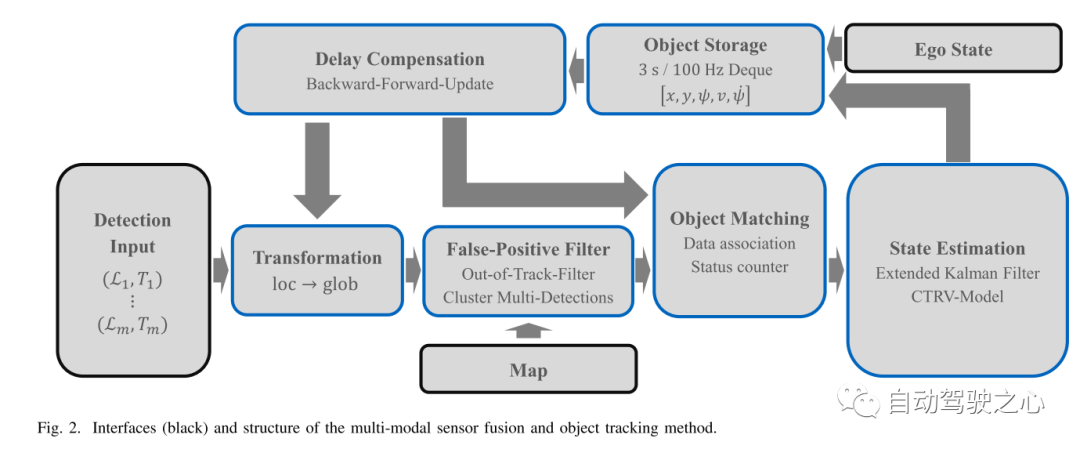

網絡設計:

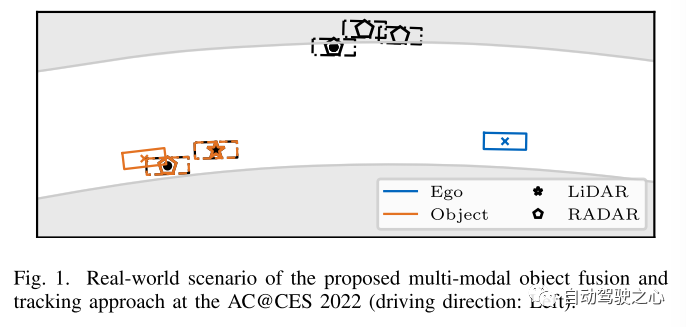

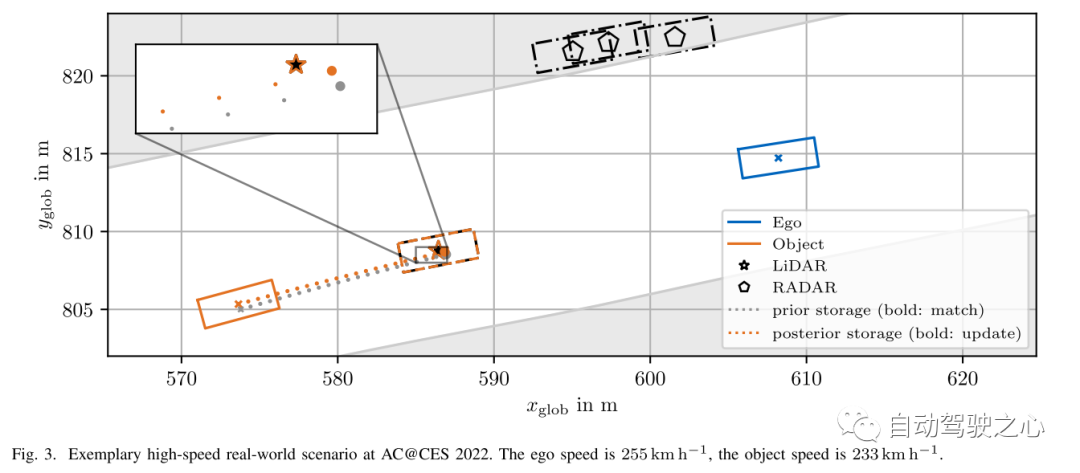

基于這些問題,將本文的問題表述如下:本文希望提供一種魯棒的融合和跟蹤方法,該方法能夠可靠地處理多種異構傳感器模態,并一致且準確地跟蹤周圍物體的運動。該方法應在現實世界中適用于高速自動駕駛的軟件堆棧,這需要低延遲并考慮感知軟件延遲。此外,無需標注數據即可適用。本文解決這個問題的后期融合和目標跟蹤方法的構建如下。多模態后期融合可以處理來自多個異構檢測 pipeline 的輸入。原始輸入會被過濾以查找偏離軌道的目標以及每個目標的多次檢測。然后,基于距離的匹配將過濾后的目標列表與當前跟蹤的目標按時間順序關聯起來。如果匹配成功,則將擴展卡爾曼濾波器 (EKF) 應用于運動模型以進行狀態估計。該方法的一個重要特征是延遲補償:由于檢測輸入的延遲,在觀測存儲中應用向后搜索來獲取傳感器時間戳處的跟蹤目標。然后,歷史狀態的優化狀態估計與運動學模型前向集成,以將所有存儲 entries 更新到當前時間戳。通過這種方式,運動預測和自我運動規劃接收周圍目標的更新、優化的軌跡。圖 1 顯示了 2022 年 CES (AC@CES) 自動駕駛挑戰賽上記錄的所提出方法的典型場景,包括脫軌濾波器(黑色)、延遲感知(橙色虛線)和補償優化狀態估計(橙色立方體)。

圖 1. AC@CES 2022 上提出的多模態目標融合和跟蹤方法的真實場景(行駛方向:左)。

圖2.多模態傳感器融合和目標跟蹤方法的接口(黑色)和結構。

圖 3. AC@CES 2022 上的示例高速現實場景。ego 速度為 255 ,物體速度為 233 。

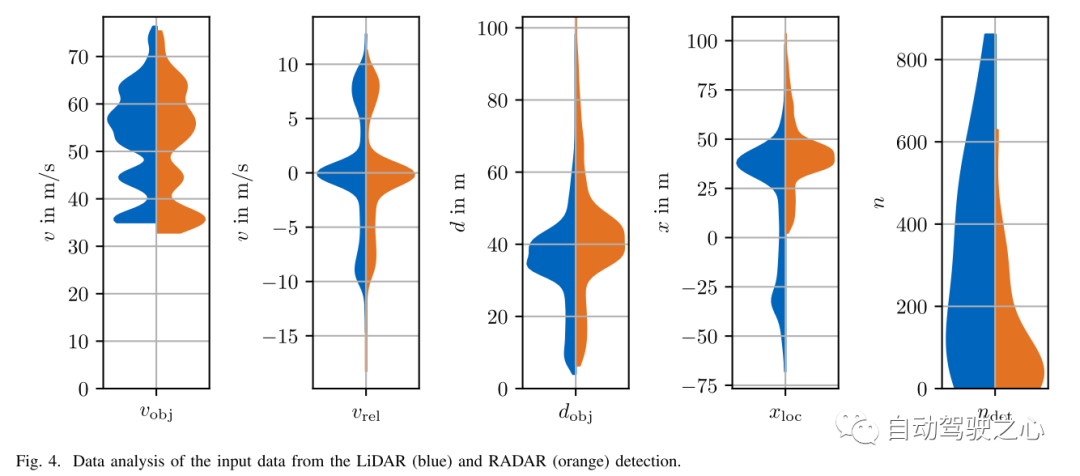

圖 4. LiDAR(藍色)和 RADAR(橙色)檢測輸入數據的數據分析。

實驗結果:

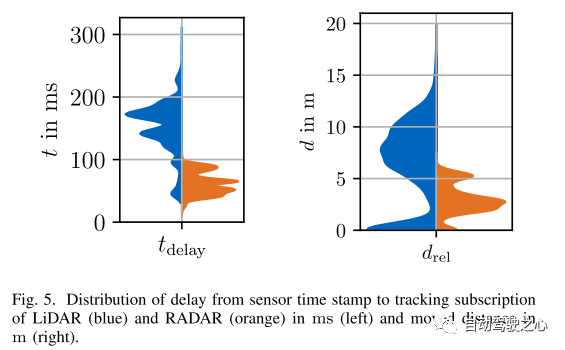

圖 5. 從傳感器時間戳到 LiDAR(藍色)和 RADAR(橙色)跟蹤 subscription 的延遲分布(以毫秒為單位)(左)和移動距離(以米為單位)(右)。

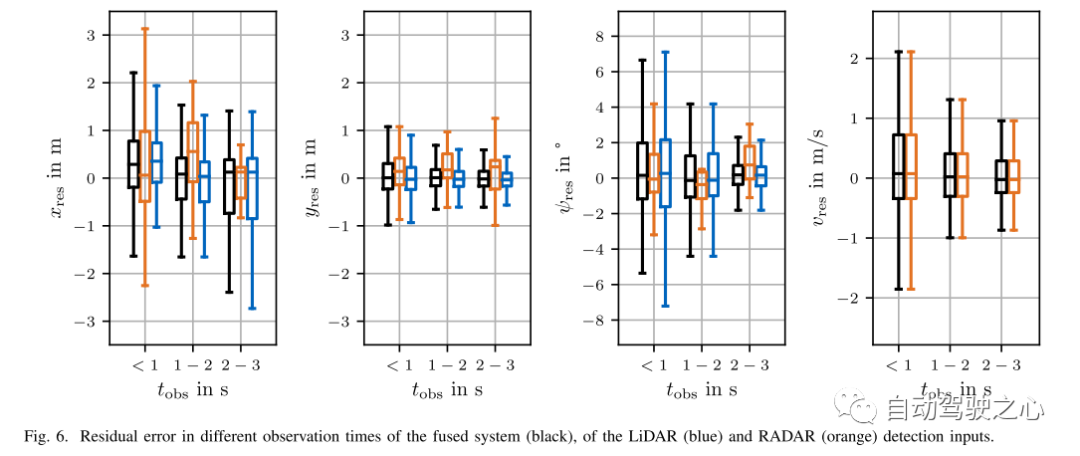

圖 6. 融合系統(黑色)、LiDAR(藍色)和 RADAR(橙色)檢測輸入在不同觀測時間的殘差(Residual error)。

引用:

Karle, P., Fent, F., Huch, S., Sauerbeck, F., & Lienkamp, M. (2023). Multi-Modal Sensor Fusion and Object Tracking for Autonomous Racing. ArXiv. https://doi.org/10.1109/TIV.2023.3271624

原文鏈接:https://mp.weixin.qq.com/s/v4Mmghz-g5iKSQ4S4oSM_A