AI「腦補」畫面太強了!李飛飛團隊新作ZeroNVS,單個視圖360度全場景生成

近來,利用3D感知擴散模型訓練模型,然后對單個物體進行SDS蒸餾的研究數不勝數。

但是,能夠真正做到「場景級」的畫面生成,從未實現。

現如今,斯坦福李飛飛和谷歌團隊打破了這個記錄!

比如,輸入一張從某個角度拍攝的客廳圖片,整個客廳的樣貌就出來了。

再來一張角度很偏的屋子拐角圖,也能生成一個意想不到的空間。

還有各種物體室內、戶外的全場景圖。

看到這兒,不得不不讓人驚呼AI「腦補」簡直強的一批!

那么,這究竟是如何實現的呢?

3D感知擴散模型——ZeroNVS

最新論文中,斯坦福和谷歌研究人員引入了一種3D感知擴散模型——ZeroNVS。

論文地址:https://arxiv.org/pdf/2310.17994.pdf

單圖像、360度新視圖合成 (NVS) 的模型,在生成圖像時應該逼真且多樣化。

合成圖像對于我們來說,應該看起來自然且3D一致,并且它們還應該捕獲不可觀察區域的許多可能的解釋。

以往,這個具有挑戰性的問題,通常是在單個物體,甚至沒有背景下研究的,也就是說,對真實性和多樣性的要求都被簡化了。

最近的研究依賴于高質量大規模數據集,比如Objaverse-XL,使得條件散射模型能夠從新視角產生逼真圖像,然后通過SDS蒸餾采樣,以提高3D一致性。

同時,由于圖像多樣性主要體現在背景中,而不是物體中,因此對背景的無知顯著降低了合成多樣化圖像的效果。

事實上,大多數以物體對象為中心的方法,不再將多樣性視為衡量標準。

然而,在復雜真實場景生成新視角合成是一個更難的問題,目前還沒有包含完整場景真值信息的大規模數據集。

研究人員在研究中對背景進行了建模,以產生多樣的結果。

在ZeroNVS中,作者開發了新技術來預測單個真實圖像的場景,并且建立在之前在3D感知擴散模型訓練(Zero-1-to-3)和SDS蒸餾(DreamFusion)方面的工作基礎上。

具體方法

研究人員著手從單個真實圖像合成場景級新穎視圖的問題。

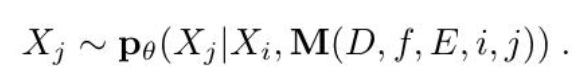

與之前的工作類似,我們首先訓練擴散模型 來執行新穎的視圖合成,然后利用它來執行3D SDS蒸餾。

來執行新穎的視圖合成,然后利用它來執行3D SDS蒸餾。

與之前的工作不同地方在于,作者關注的是場景而不是物體。

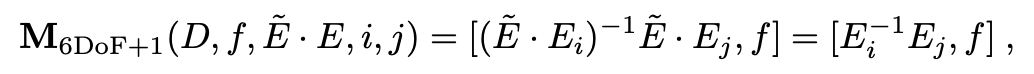

場景提出了一些獨特的挑戰。首先,先前的研究使用攝像機和比例的表示,這些表示對于場景來說要么含糊不清,要么表達力不足。

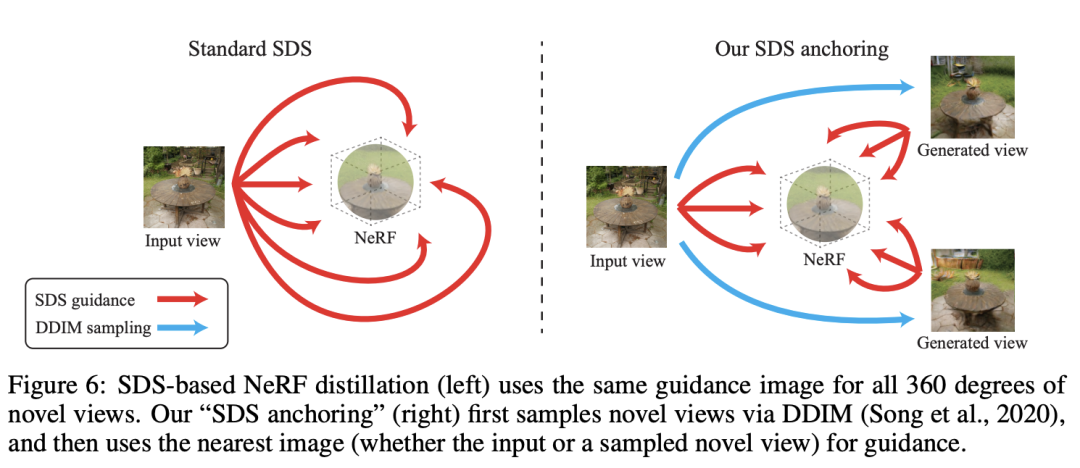

其次,先前研究的推理過程是基于 SDS 的,它具有已知的模式崩潰問題,并且通過大大減少預測視圖中的背景多樣性在場景中體現出來。

與之前的工作相比,研究人員嘗試了通過「改進場景的表示」和「推理程序」來應對這些挑戰。

在這個公式中,M的輸出,和單個圖像的輸入 是模型可用于視圖合成的唯一信息。

是模型可用于視圖合成的唯一信息。

表示視圖綜合的對象

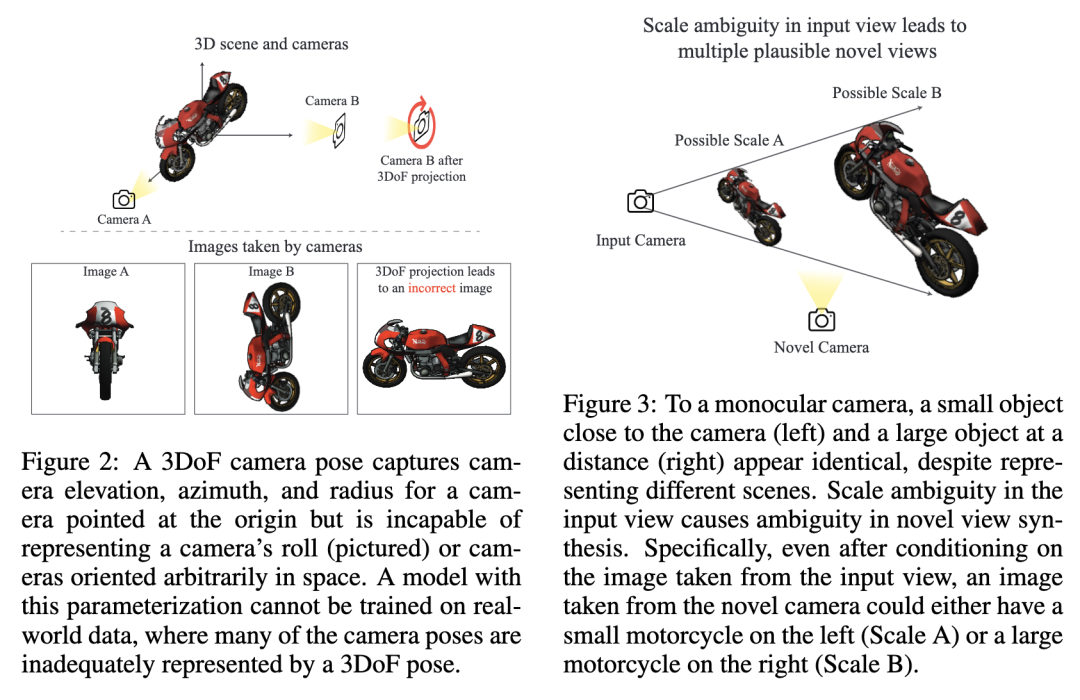

如下圖,3DoF相機姿勢捕獲指向原點的相機的相機仰角、方位角和半徑,但無法表示相機的滾動(如圖)或空間中任意方向的相機。

具有這種參數化的模型無法在現實世界數據上進行訓練,其中許多相機姿勢不能用3DoF姿勢充分表示。

表示視圖合成的通用場景

對于場景,研究人員應該使用具有6個自由度的相機表示,可以捕獲所有可能的位置和方向。

捕獲六個自由度的相機參數化的一種直接選擇是相對位姿參數化。研究人員建議還將視野作為額外的自由度,并將這種組合表示稱為「6DoF+1」。

M 6DoF+1的一個吸引人的特性是它對于場景的剛性變換具有不變性,因此可以得到:

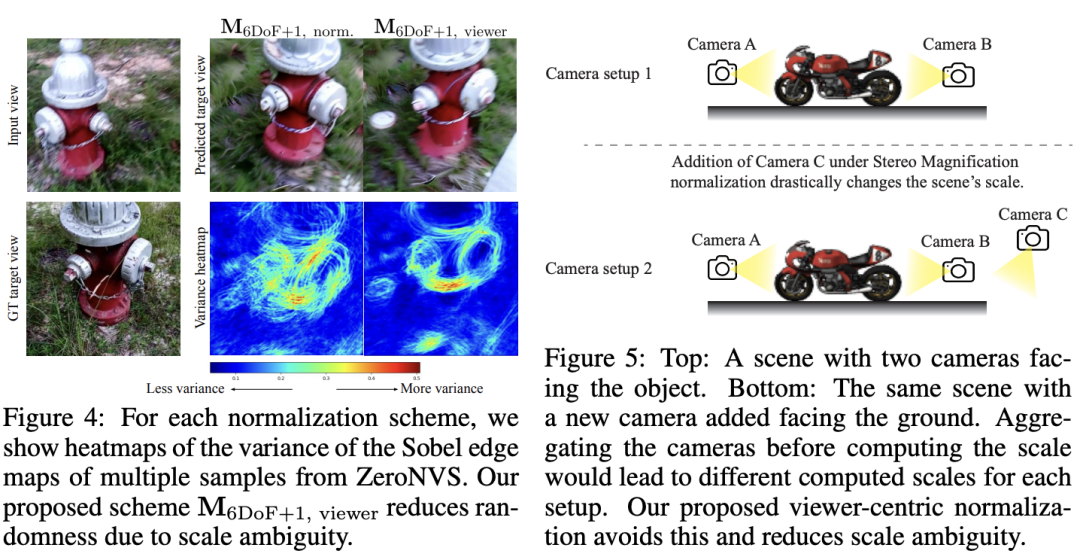

對于每個歸一化方案,ZeroNVS中多個樣本的Sobel邊緣圖方差的熱圖。研究者提出的方案M 6DoF+1,觀察者減少了由于尺度模糊而導致的隨機性。

通過SDS anchoring提高多樣性

基于SDS的NeRF蒸餾(左)對所有360度新視圖使用相同的引導圖像。

作者的「SDS anchoring」(右)首先通過DDIM對新視圖進行采樣,然后使用最近的圖像(無論是輸入還是采樣的新視圖)作為指導。

實驗結果

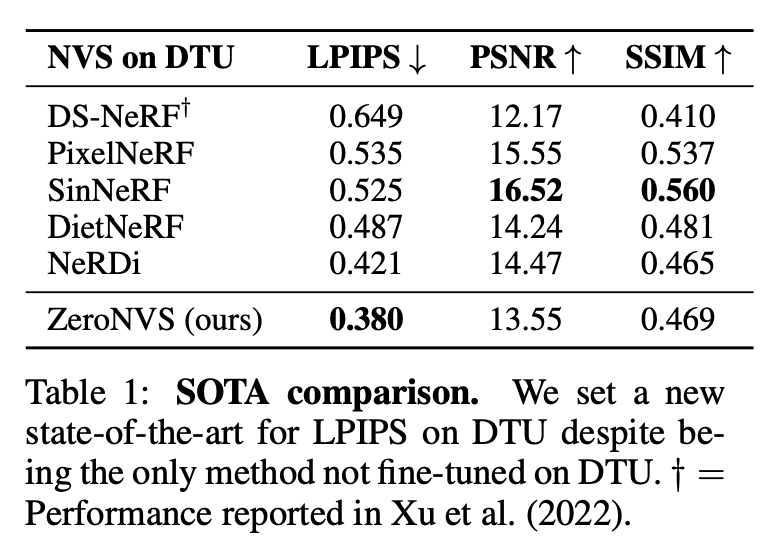

再具體評估中,研究人員使用了一組標準的新視圖合成指標來評估所有方法:PSNR、SSIM和LPIPS。

由于PSNR和SSIM有已知缺點,研究人員更看重LPIPS,并確認PSNR和SSIM與問題設置中的性能沒有很好的相關性,如圖7所示。

結果如表1所示。

首先與基線方法 DS-NeRF、PixelNeRF、SinNeRF、DietNeRF進行比較。

盡管所有這些方法都是在DTU上進行訓練的,但研究人員從未在DTU上進行過訓練,但實現了最先進的LPIPS零樣本。

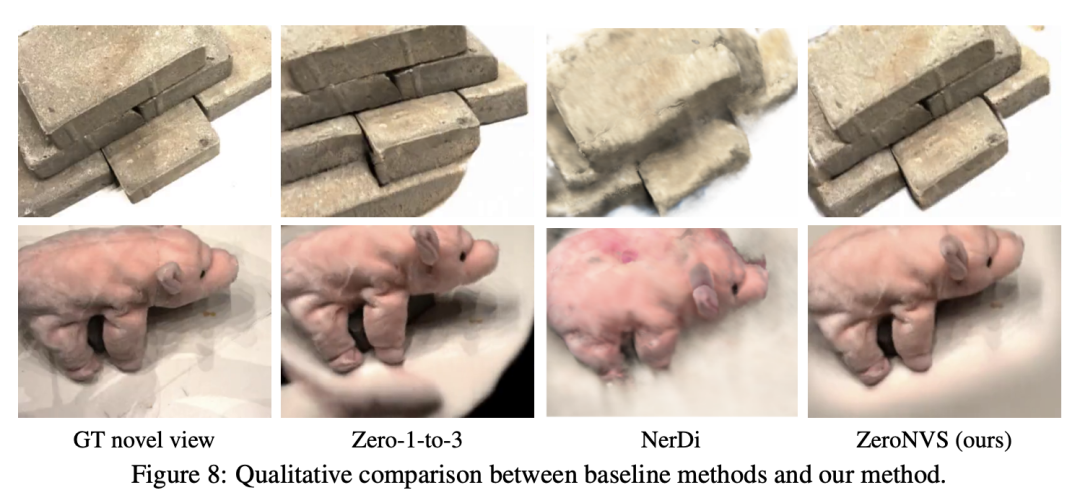

圖8中顯示了一些定性比較。

DTU場景僅限于相對簡單的前向場景。

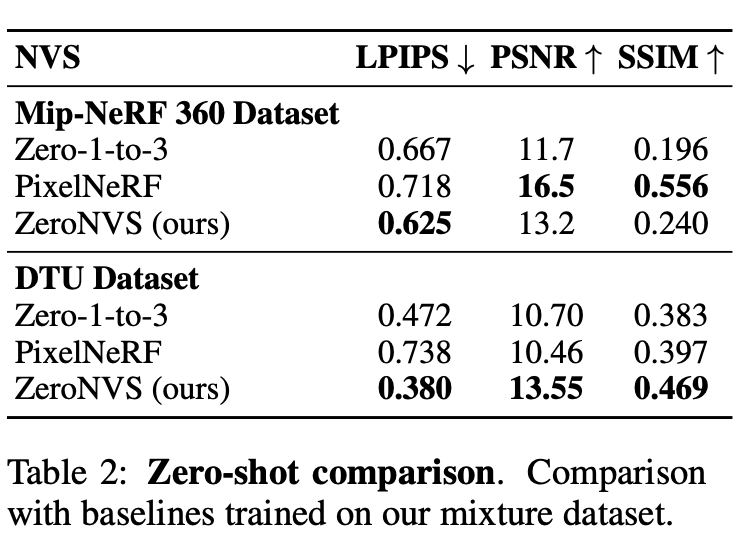

因此,研究人員還引入了一個更具挑戰性的基準數據集,即Mip-NeRF 360數據集,來對單張圖像的360度視圖合成任務進行基準測試。

研究人員使用這個基準作為零樣本基準,并在混合數據集上訓練3個基線模型來比較零樣本性能。

限制這些零樣本模型,其方法在該數據集的LPIPS上遙遙領先。在DTU上,新方法在所有指標上都超過了Zero-1-to-3和零樣本PixelNeRF模型,而不僅僅是LPIPS,如表2所示。

作者介紹

Kyle Sargent

斯坦福大學的一名博士生,從2022年秋季開始,在斯坦福人工智能實驗室工作,導師是Jiajun Wu和李飛飛。

他還曾在谷歌研究院擔任學生研究員。