阿里Qwen2正式開源,性能全方位包圍Llama-3

斯坦福團隊套殼清華大模型的事件不斷發酵后,中國模型在世界上開始得到了更多關注。不少人發現,原來中國已經有不少成熟的大模型正在趕超國外。

HuggingFace 平臺和社區負責人 Omar Sanseviero 曾表示,AI 社區一直在「忽視」中國機器學習生態系統的工作,他們正在用有趣的大語言模型、視覺大模型、音頻和擴散模型做一些令人驚奇的事情,如 Qwen、Yi、DeepSeek、Yuan、WizardLM、ChatGLM、CogVLM、Baichuan、InternLM、OpenBMB、Skywork、ChatTTS、Ernie、HunyuanDiT 等。

今日,阿里云通義千問團隊 Qwen2 大模型開源的消息吸引了眾多 AI 開發者的目光。Qwen2-72B 性能超過了業界著名的開源模型 Llama3-70B,也超過文心 4.0、豆包 pro、混元 pro 等眾多國內閉源大模型。所有人均可在魔搭社區和 Hugging Face 免費下載通義千問最新開源模型。

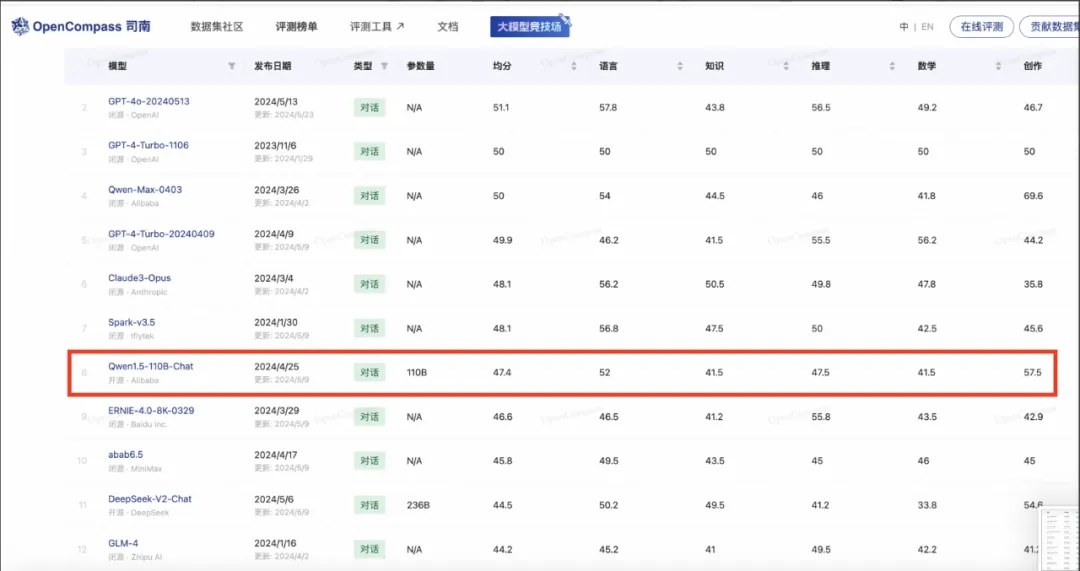

相比今年 2 月推出的通義千問 Qwen1.5,Qwen2 整體性能實現代際飛躍。而在上海人工智能實驗室推出的權威模型測評榜單 OpenCompass 中,此前開源的 Qwen1.5-110B 已領先于文心 4.0 等一眾國內閉源模型。可見 Qwen2 的能力更加非凡。

OpenCompass 大模型測評榜單上,此前開源的 Qwen1.5-110B 已領先于文心 4.0 等一眾國內閉源模型。

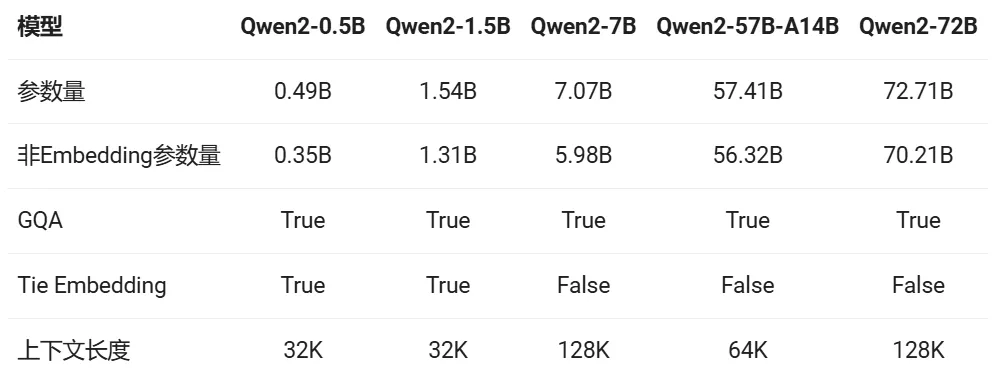

本次 Qwen2 系列包括五種尺寸的基礎和指令調優模型,包括 Qwen2-0.5B、Qwen2-1.5B、Qwen2-7B、Qwen2-57B-A14B 和 Qwen2-72B。

魔搭社區模型下載地址:

- Qwen2-72B https://modelscope.cn/models/qwen/Qwen2-72B

- Qwen2-72B-Instruct https://modelscope.cn/models/qwen/Qwen2-72B-Instruct

在先前的 Qwen1.5 系列中,只有 32B 和 110B 的模型使用了 GQA(Grouped-Query Attention)。而這一次,Qwen2 系列所有尺寸的模型都使用了 GQA。這讓大家能夠更加方便地體驗到 GQA 帶來的推理加速和顯存占用降低的優勢。針對小尺寸模型,由于 embedding 參數量較大,使用了 Tie Embedding 的方法讓輸入和輸出層共享參數,增加非 embedding 參數的占比。

此外,所有的預訓練模型均在 32K tokens 的數據上進行訓練,并且研究團隊發現其在 128K tokens 時依然能在 PPL 評測中取得不錯的表現。然而,對指令微調模型而言,除 PPL 評測之外還需要進行大海撈針等長序列理解實驗。在該表中,作者根據大海撈針實測結果,列出了各個指令微調模型所支持的最大上下文長度。而在使用 YARN 這類方法時,Qwen2-7B-Instruct 和 Qwen2-72B-Instruct 均實現了長達 128K tokens 上下文長度的支持。

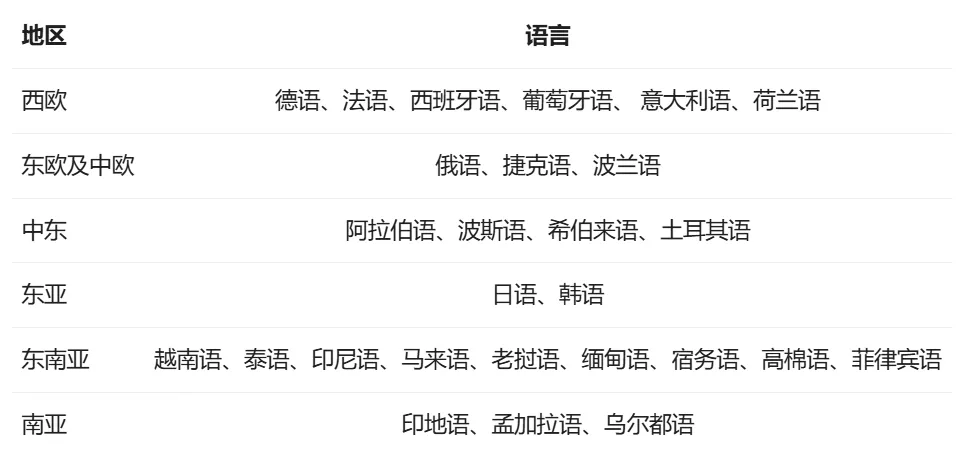

研究團隊投入了大量精力研究如何擴展多語言預訓練和指令微調數據的規模并提升其質量,從而提升模型的多語言能力。盡管大語言模型本身具有一定的泛化性,他們還是針對性地對除中英文以外的 27 種語言進行了增強,并針對性地優化了多語言場景中常見的語言轉換(code switch)問題,使模型當前發生語言轉換的概率大幅度降低。使用容易觸發語言轉換現象的提示詞進行測試,觀察到 Qwen2 系列模型在此方面能力的顯著提升。

性能一覽

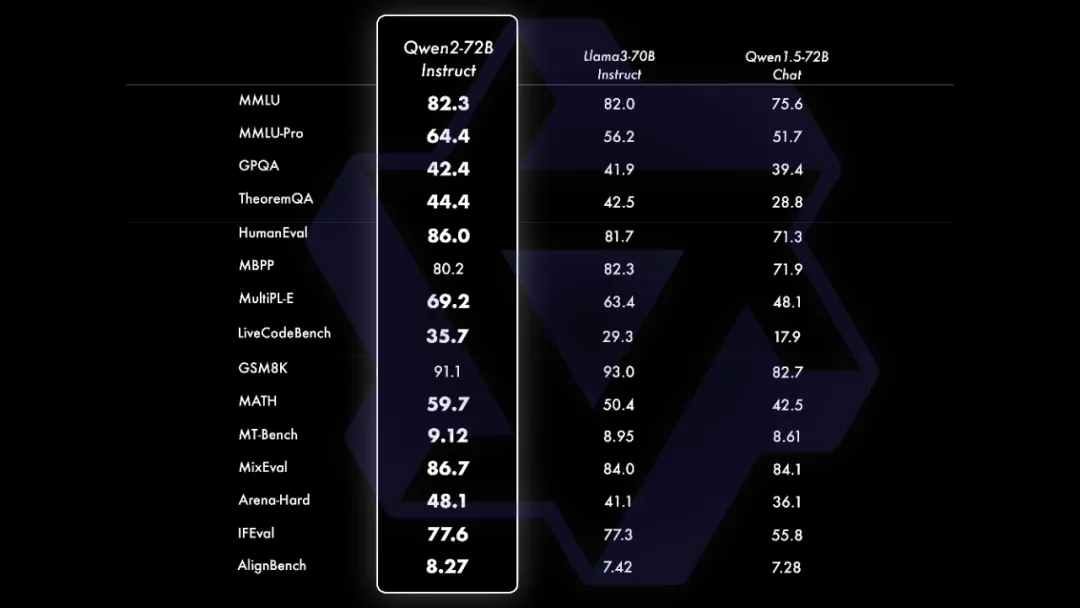

Qwen2-72B 在針對預訓練語言模型的評估中,對比當前最優的開源模型,Qwen2-72B 在包括自然語言理解、知識、代碼、數學及多語言等多項能力上均顯著超越當前領先的模型,如 Llama-3-70B 以及 Qwen1.5 最大的模型 Qwen1.5-110B。這得益于其預訓練數據及訓練方法的優化。

大規模預訓練后,研究團隊對模型進行精細的微調,以提升其智能水平,讓其表現更接近人類。這個過程進一步提升了代碼、數學、推理、指令遵循、多語言理解等能力。微調過程遵循的原則是使訓練盡可能規模化的同時并且盡可能減少人工標注。

研究團隊探索了如何采用多種自動方法以獲取高質量、可靠、有創造力的指令和偏好數據,其中包括針對數學的拒絕采樣、針對代碼和指令遵循的代碼執行反饋、針對創意寫作的回譯、針對角色扮演的 scalable oversight 等。在訓練方面,開發團隊結合了有監督微調、反饋模型訓練以及在線 DPO 等方法,還采用了在線模型合并的方法減少對齊稅。

Qwen2-72B-Instruct 在 16 個基準測試中的表現優異,在提升基礎能力以及對齊人類價值觀這兩方面取得了較好的平衡。相比 Qwen1.5 的 72B 模型,Qwen2-72B-Instruct 在所有評測中均大幅超越,并且取得了匹敵 Llama-3-70B-Instruct 的表現。而在小模型方面,Qwen2 系列模型基本能夠超越同等規模的最優開源模型甚至更大規模的模型。相比近期推出的業界最優模型,Qwen2-7B-Instruct 依然能在多個評測上取得顯著的優勢,尤其是代碼及中文理解上。

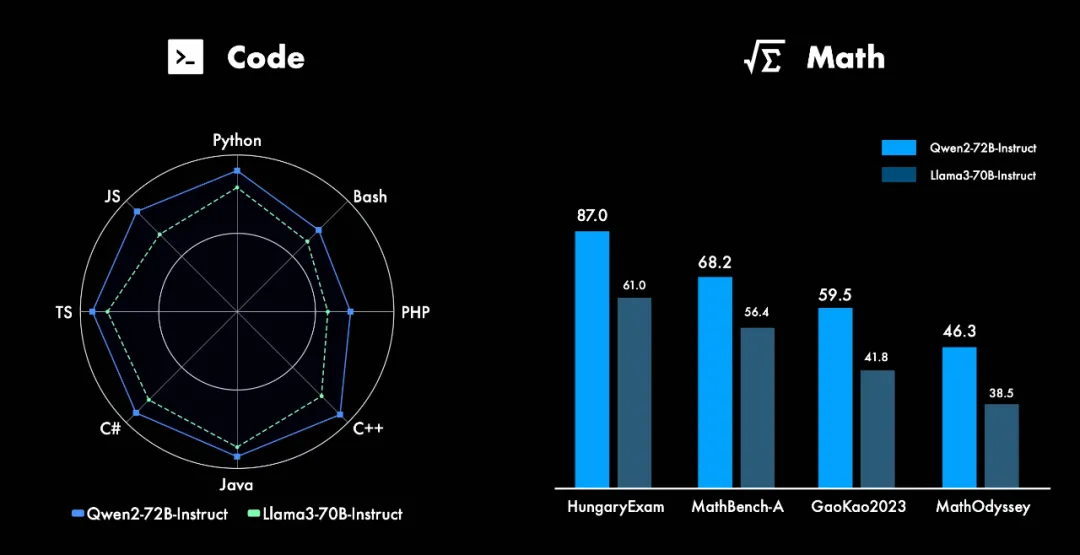

在代碼方面,Qwen2 的研發中融入了 CodeQwen1.5 的成功經驗,實現了在多種編程語言上的顯著效果提升。而在數學方面,大規模且高質量的數據幫助 Qwen2-72B-Instruct 實現了數學解題能力的飛升。

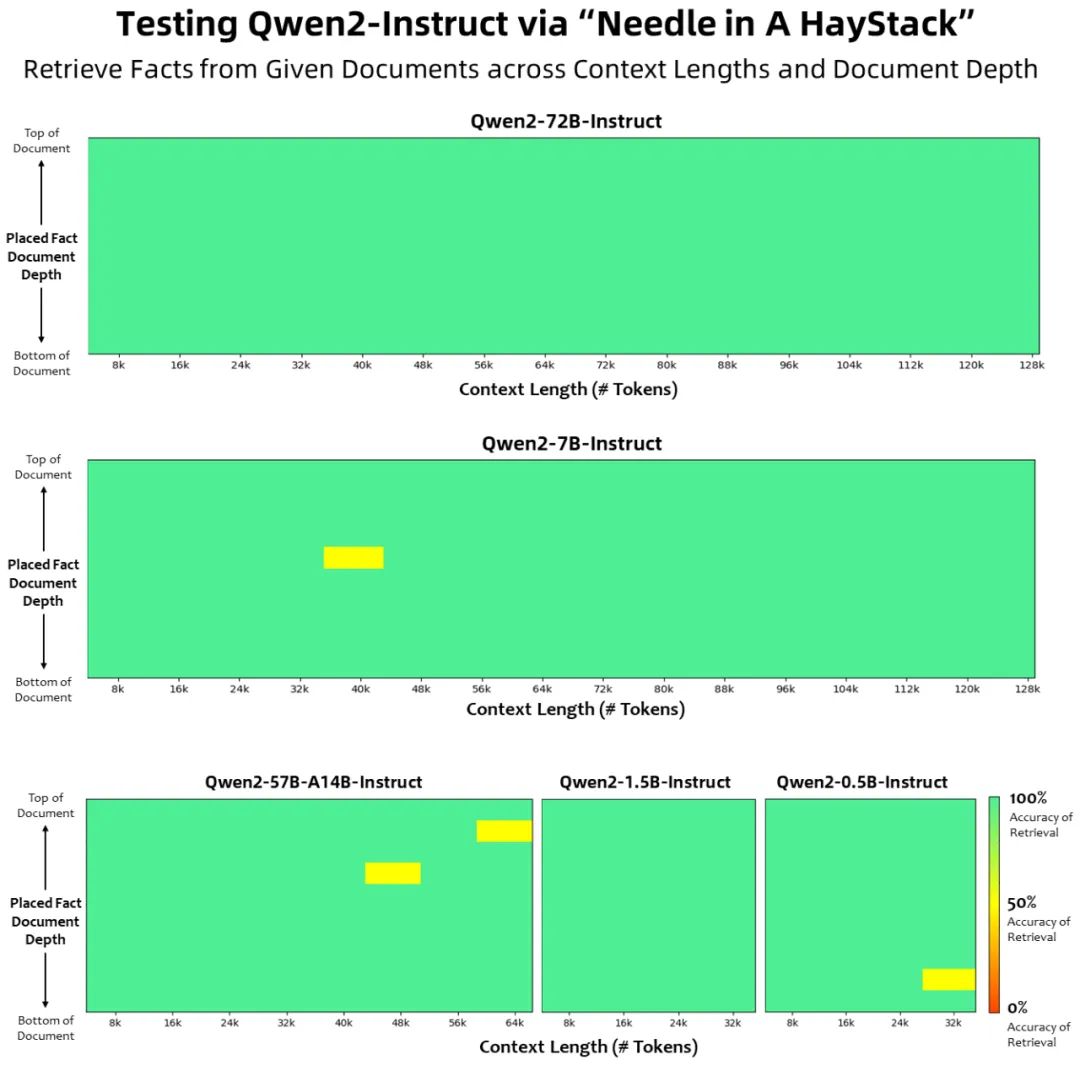

Qwen2 系列中的所有 Instruct 模型,均在 32k 上下文長度上進行訓練,并通過 YARN 或 Dual Chunk Attention 等技術擴展至更長的上下文長度。下圖展示了其在 Needle in a Haystack 測試集上的結果。值得注意的是,Qwen2-72B-Instruct 能夠完美處理 128k 上下文長度內的信息抽取任務

此外,Qwen2 系列中的其他模型的表現也十分突出:Qwen2-7B-Instruct 幾乎完美地處理長達 128k 的上下文;Qwen2-57B-A14B-Instruct 則能處理 64k 的上下文長度;而該系列中的兩個較小模型則支持 32k 的上下文長度。

自 2023 年 8 月開源以來,通義千問不僅在國內開源社區中影響巨大,更是在全球開源社區中占據重要的位置。今日,Qwen2 系列模型的 API 第一時間登陸阿里云百煉平臺。在 Llama 開源生態之外,全球開發者現在擁有了更多的選擇。