馬斯克豪擲40億購10萬張H100訓Grok 3!自曝Grok 2下月上線,巨額博弈劍指OpenAI

一邊造火箭,一邊造新能源車,一邊在推特評論區到處冒泡的馬斯克繼Grok 1.5發布后繼續為自己的AI初創公司造勢。

在回帖中,馬斯克宣布xAI的大語言模型Grok 2將于8月推出。

并且馬斯克為大家劃重點:在數據訓練方面將有大跨步。

Grok是馬斯克正式進入生成式AI這條賽道推出的AI聊天機器人,來自一個與OpenAI、谷歌、Meta等巨頭同時扳手腕的初創公司xAI,不僅開源還造超算中心,可謂野心勃勃。

自今年3月以來,xAI陸續推出了Grok 1.5大語言模型和首個多模態模型Grok1.5 Vision。

xAI曾表示,Grok 1.5V在多學科推理、文檔理解、科學圖表、表格處理等多領域「都能媲美現有的前沿多模態模型」。

今年5月,馬斯克表示,xAI是一家新公司,因此Grok仍有大量準備工作要做,才能與谷歌Deepmind和OpenAI相抗衡。

后來者要居上,xAI一直在暗暗發力,直指模型性能,期望能給大公司上壓力。

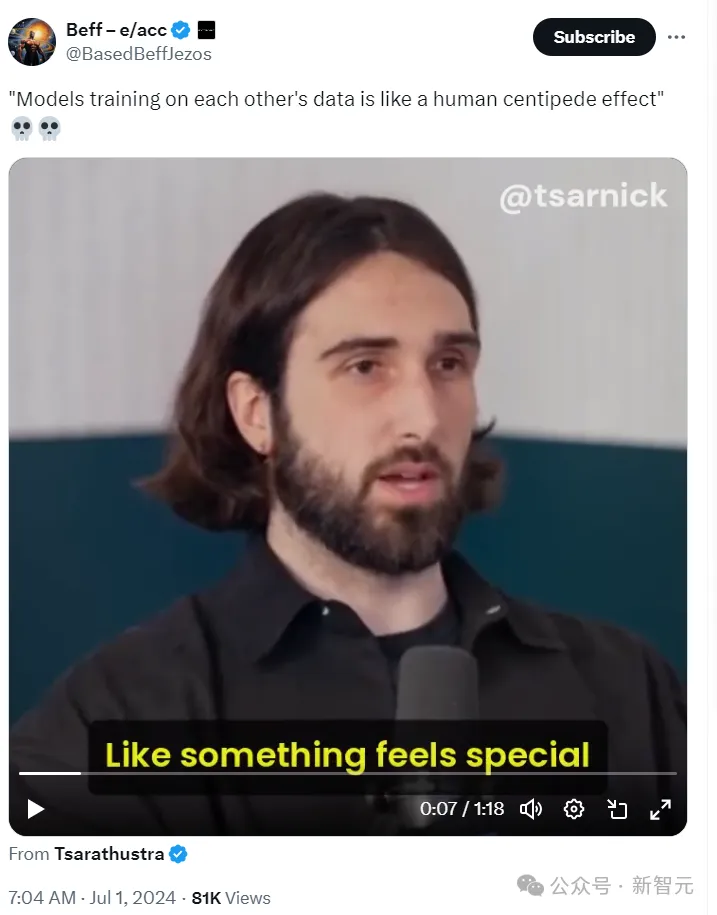

Grok 2:數據訓練飛躍或有效解決「人體蜈蚣效應」

馬斯克宣布Grok 2將在8月推出這條回帖的原帖也頗有意味。

原帖中,Cohere首席執行官Aidan Gomez表示,由于許多人工智能模型都是根據OpenAI的輸出結果進行訓練的,因此會產生「人體蜈蚣效應」,即模型會產生相同的輸出結果。

對于這一現象,使用大語言模型的用戶應該深有體會。

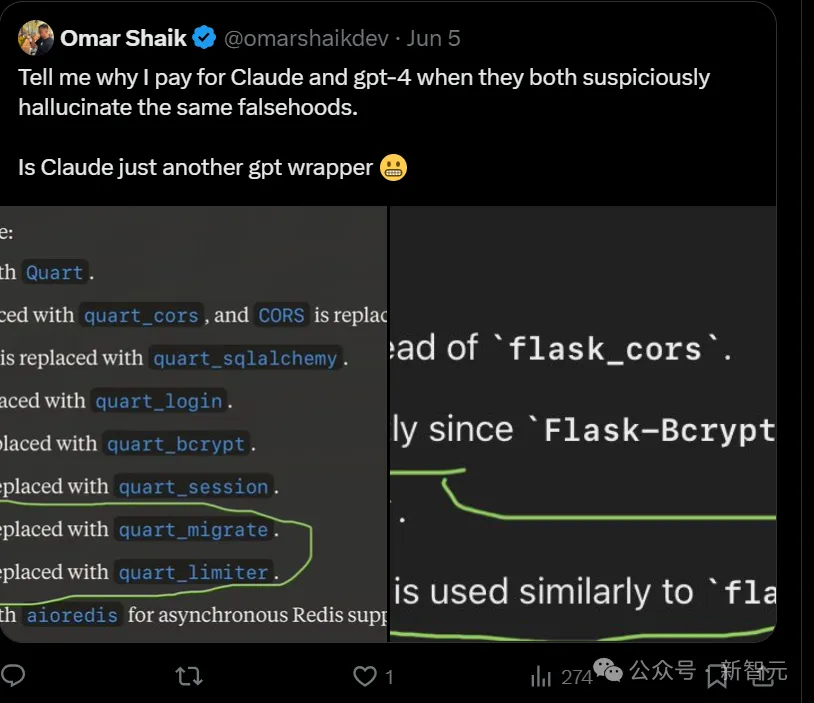

有一位推特網友發現,他雖然付了GPT-4和Claude兩份的錢,卻得到了同一份相同的錯誤答案。

這個千載難逢的抹黑GPT的機會,馬斯克自然不會錯過。

他與OpenAI之間的戰火早已彌漫了4個月,前段時間甚至向法院發起訴訟,指控OpenAI違反合同。

于是,借此天賜良機,馬斯克狠狠地拉踩OpenAI,為即將推出的Grok造勢。

他發帖表示,從互聯網語料中清除掉LLM合成的錯誤數據,形成高質量數據集需要大量的工作,而8月份推出的Grok 2將是這方面的巨大進步。

消息一出,前腳才被OpenAI封鎖API,后腳又被鴿GPT-4o語音功能的傷心用戶們紛紛表示,要轉投這個出身豪門的Grok的懷抱。

等不及了!我老早就用Grok比GPT用的多了!

等不及看到下一代Grok了!Grok 2公布之日,就是OpenAI退訂之時。

奧特曼表示:

Grok 3:豪擲40億美元買10萬個H100訓練模型

馬斯克公布完Grok 2發行時間,繼續回復表示Grok 3將在年底推出。

并且在經過10萬個英偉達H100 GPU的訓練后,將成為「特別的東西」。

的確特別,首要就是特別壕。

一筆訂單十位數。那個無人在意的角落里,老黃又靠「賣鏟子」賺翻了。

科技公司都在競相打造更加智能的人工智能產品,H100自然成為這場AI軍備競賽的香餑餑。

H100 GPU作為AI的關鍵組件、硅谷的熱門商品,據估計每塊成本在3萬到4萬美元之間,馬斯克的十位數訂單可能有團購價。

這意味著,Grok 3正在價值30億至40億美元的人工智能芯片上接受訓練。但目前還不清楚這些芯片是否是xAI直接購買的,從云服務提供商那里租用GPU計算也是可能的。

The Information在5月份報道稱,馬斯克的xAI初創公司正在與甲骨文公司洽談,準備斥資100億美元租用云服務器。

可以確定的是,馬斯克的xAI近年來的確直接購買了大量的H100。

例如,據報道,特斯拉首席執行官將原定用于特斯拉的一批價值5億美元的英偉達H100轉用于xAI。

可以想到,基于10萬個GPU訓練的Grok 3將比Grok 2更上一層樓。

馬斯克在今年4月接受挪威主權基金負責人Nicolai Tangen采訪時說,Grok 2需要大約2萬張H100來進行訓練。

到目前為止,xAI已經發布了Grok 1和Grok 1.5,最新的Grok 1.5只提供給早期測試者和X(前身為Twitter)上的用戶。

評論區也尤其關注了Grok 2和Grok 3的用戶使用范圍,可以看出,大家對10萬張H100訓練出來的模型頗有期待。

10萬個GPU聽起來確實很多,但是,像Meta這樣的其他科技巨頭正在購買更多的GPU。

Mark Zuckerber今年1月表示,到2024年底,Meta將購買約35萬個英偉達H100 GPU。

并且,Meta將擁有包括其他GPU在內的約60萬個芯片。也就是說,Meta將花費約180億美元打造AI芯片。

H100芯片的囤積數量,也成為AI人才衡量公司實力的重要標準。

人工智能初創公司Perplexity的創始人兼首席執行官Aravind Srinivas談到,他曾試圖挖一名Meta的人工智能研究人員,但遭到拒絕,部分原因是Zuckerber保有了大量H100芯片。

Srinivas表示,我想從Meta聘請一位非常資深的研究員,你知道他們怎么說嗎?

這位研究員無情拒絕,「等你有1萬個H100 GPU的時候再來找我吧。」

由此可見,AI的核心是掌握算力,要想掌握數據,就得掌握運行數據芯片。

數據中心親自監工

買買買之后,「工作狂」馬斯克自然不會停下腳步。

分析師Adam Jonas在6月26日公開表示,如今AI數據中心在美國各地落地,導致美國周邊電網用量激增。

而特斯拉迅速擴張的儲能業務將幫助xAI在AI大戰中占領一席之地。

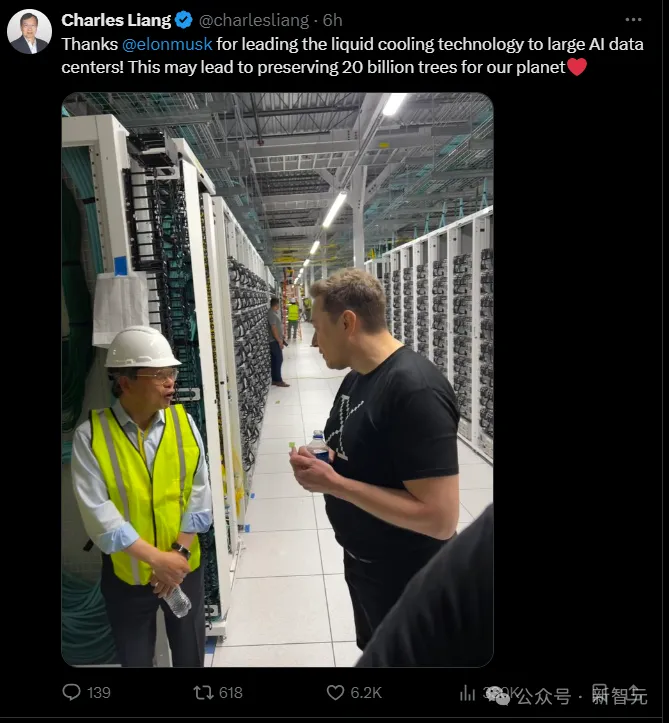

這不,supermicro CEO和創始人Chales Liang發推公布和馬斯克在數據中心的合照。

非常感謝馬斯克引領液冷技術進入大型AI數據中心!新技術有可能幫助地球保護200億棵樹免于砍伐!

網友調侃道,馬斯克要不就別睡了,要不數據中心打個地鋪瞇一會兒。

根據美國對數據中心的節能要求,全國范圍內新建數據中心要求PUE<1.2,而傳統的風冷制冷方式已經無法滿足數據中心的散熱需求,更加高效的液冷方案應運而生。

如何降低能耗也一直是各家公司關注的核心問題,而液冷技術具有冷卻效率高、節能環保、穩定性強的優點。

因此,在人工智能領域,隨著AI智算的需求爆發,液冷方案已經成為AI數據中心的首選。