警惕:與 ChatGPT 共享業務數據可能十分危險

您已經在使用ChatGPT了嗎?或者您正在考慮使用它來簡化操作或改善客戶服務?雖然ChatGPT提供了許多好處,但重要的是,您要意識到與ChatGPT這樣的人工智能工具共享敏感業務數據相關的安全風險。下面,我們概述了一些關鍵問題,并就如何降低與ChatGPT共享公司數據的風險提供了建議。

ChatGPT不存儲用戶的輸入數據,是嗎?

聊天機器人從用戶輸入中記憶和學習的影響可能是深遠的:想象一下,您正在做一場內部演示,其中包含了新的企業數據,揭示了一個將在董事會會議上討論的企業問題。將這些專有信息泄露出去可能會損害股價、消費者態度和客戶信心。更糟糕的是,議程上的法律事項被泄露可能會使公司承擔真正的責任。但是,僅僅把這些東西輸入聊天機器人中,這些事情真的會發生嗎?

研究公司Cyberhaven于今年2月就這一問題進行了深入探索,結果指出,如果第三方根據該高管提供的信息向ChatGPT詢問某些問題,那么輸入ChatGPT的機密數據可能會被泄露給第三方。

英國國家網絡安全中心(NCSC)在3月份分享了對此事的進一步見解,指出ChatGPT和其他大型語言模型(LLM)目前不會自動將信息從查詢添加到模型中供其他人查詢。也就是說,在查詢中包含信息不會導致潛在的私有數據被合并到LLM中。然而,提供LLM的組織(就ChatGPT而言,指的是OpenAI)將能看到查詢。

這些查詢會被存儲起來,幾乎肯定會在某個時候用于開發和訓練LLM服務或模型。這可能意味著LLM提供商(或其合作伙伴/承包商)能夠讀取查詢,并可能以某種方式將它們合并到未來的版本中。

2021年6月,來自蘋果、斯坦福大學、谷歌、哈佛大學等的研究人員發表了一篇論文,揭示了類似于ChatGPT的語言學習模型GPT-2可以準確地從訓練文檔中回憶起敏感信息。

報告發現,GPT-2可以調用具有特定個人標識符的信息,重新創建精確的文本序列,并在提示時提供其他敏感信息。這些“訓練數據提取攻擊”可能會對機器學習模型研究人員的安全構成越來越大的威脅,因為黑客可能能夠訪問機器學習研究人員的數據并竊取他們受保護的知識產權。

總而言之,我們有理由擔憂與ChatGPT共享敏感業務數據會威脅企業安全,并造成無法挽回的后果。

與ChatGPT共享敏感數據的風險

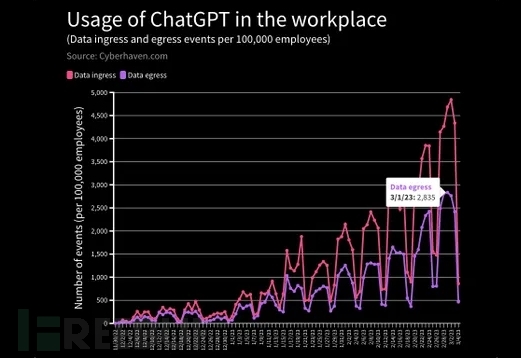

據數據安全公司Cyberhaven發布的統計數據顯示,平均每家公司每周會向ChatGPT發布數百次敏感數據,涉及客戶或患者信息、源代碼、機密數據和監管信息等等,這些請求引起了嚴重的網絡安全問題。

【ChatGPT在工作場所使用情況】

對于組織來說,理解并緩解與ChatGPT共享敏感數據的風險,以保護其資產、維護客戶信任并遵守法規要求是至關重要的。具體來說,這些風險涵蓋以下幾點:

1. 數據隱私和保密風險

優先考慮公司敏感信息的隱私和機密性是至關重要的。請注意,當您使用ChatGPT時,實際上是在與外部實體共享組織數據。人工智能模型處理這些數據以生成所需的輸出,這可能導致意外地將敏感信息暴露給第三方。

您可以始終決定不允許ChatGPT將企業數據用于培訓目的。然而,即使在這種情況下,您與ChatGPT分享的任何公司數據都將通過互聯網發送,并可能存儲在某個地方進行處理,以便回答您的問題。

在將業務數據輸入ChatGPT之前,請確保您了解人工智能提供商的數據存儲、使用和保留策略,并實施強大的數據保護措施。

2. 知識產權風險

當與ChatGPT共享信息時,企業的知識產權(IP)可能會無意泄露。為了減輕這種風險,請避免與人工智能工具共享專有數據、商業機密或版權材料。最近的一個突出案例是三星員工在ChatGPT中無意泄露了公司的秘密。

3. 數據合規風險

許多國家都有數據保護法規,例如歐盟的《通用數據保護條例(GDPR)》和《加州消費者隱私法案》(CCPA)。這些法案管理企業如何收集、存儲和處理個人信息。如果您在ChatGPT中無意地分享了個人數據,可能會讓企業暴露于合規風險上。

緩解建議

1.制定使用政策

ChatGPT的使用和可訪問性可以是一把雙刃劍,因為它增加了員工濫用或濫用的風險。此外,員工也可能會被誘惑使用人工智能工具來實現非相關的目的。為了解決這些問題,必須建立清晰的使用策略和指導方針,詳細規定在使用ChatGPT時可接受和不可接受的行為。

去年年初以來,在發現ChatGPT生成的文本中有疑似商業機密的情況后,不少科技巨頭已經開始提醒自己的員工不要在使用ChatGPT時輸入敏感信息數據。無獨有偶,微軟也曾表示,只要員工不與ChatGPT分享機密信息,就可以在工作時使用。

2.教育員工相關風險

人員始終是攻擊鏈中最薄弱的環節,因此對員工進行教育和培訓同樣至關重要。組織必須確保他們了解負責任地使用ChatGPT以及濫用ChatGPT的潛在后果。這包括讓他們意識到數據隱私問題、知識產權風險和合規要求。

3.利用先進技術

識別和控制員工提交給ChatGPT的數據并非沒有挑戰。當員工在ChatGPT中輸入公司數據時,他們不是上傳文件,而是將內容復制粘貼到他們的網絡瀏覽器中。許多安全產品都是圍繞保護文件(被標記為機密)不被上傳而設計的,但一旦內容從文件中復制出來,他們將無法跟蹤它。

為了提高可見性,組織應該在其安全web網關(SWG)上實施策略,以識別人工智能工具的使用,還可以應用數據丟失預防(DLP)策略來識別哪些數據被提交給這些工具。

結語

雖然ChatGPT提供了非凡的功能,但理解和管理相關的安全風險是至關重要的。通過實施強有力的數據保護措施,遵守數據保護法規,保護知識產權和監控員工使用,組織可以最大限度地降低這些風險,并利用ChatGPT的力量推動業務向前發展。

原文鏈接:

- https://www.endare.com/insights/are-you-sharing-company-data-with-chatgpt

- https://www.csoonline.com/article/574799/sharing-sensitive-business-data-with-chatgpt-could-be-risky.html