LLM推理性能受輸出格式影響,JSON最嚴重

輸出格式不同,竟然還能影響大模型發(fā)揮?!

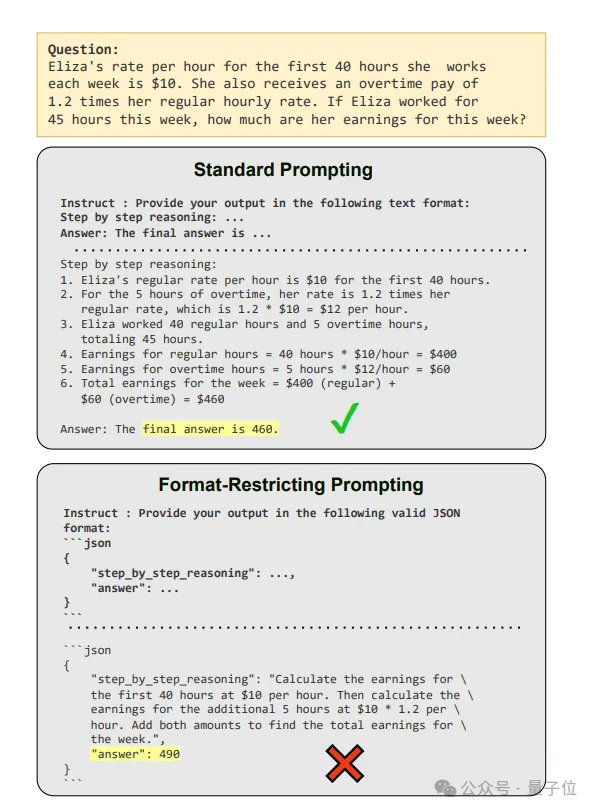

兩種提示下讓大語言模型(LLMs)解同一道數(shù)學題,問題如下:

Eliza每周工作的前40小時,每小時的工資是10美元,加班費每小時x1.2。如果Eliza這周工作了45小時,她這周的收入是多少?

思維鏈prompt:“按照以下格式提供輸出,逐步推理:…回答:最終答案是…”。

格式限制prompt:“按照以下有效的JSON格式提供輸出:…(具體JSON格式見圖)“。

正確答案是460,可以看出,思維鏈(讓模型一步步思考)奏效,格式限制(“以JSON格式輸出”)卻失敗了!!

這是臺灣大學和Appier AI Research新研究中的一幕,他們發(fā)現(xiàn)——

格式限制這玩意兒會降低LLMs的推理能力,且限制越嚴推理越差。(主打一個叛逆)

不過好消息是,能治。

他們發(fā)現(xiàn),最佳解決方案是搞個“二次轉換”(倒爺是吧),即LLMs首先用自然語言回答問題,然后再將答案轉換為目標格式。

在這個過程中,他們對比了GPT-3.5 Turbo、Claude 3 Haiku、Gemini 1.5 Flash等不同模型在生成不同格式數(shù)據(jù)時的性能差異,結果又發(fā)現(xiàn):

GPT喜歡YAML、Claude喜歡XML、Gemini/Gemma喜歡JSON。(主打各有所愛)

看完研究,有網(wǎng)友點出了它對平衡結構化生成和任務推理的意義:

格式限制會降低LLMs推理能力

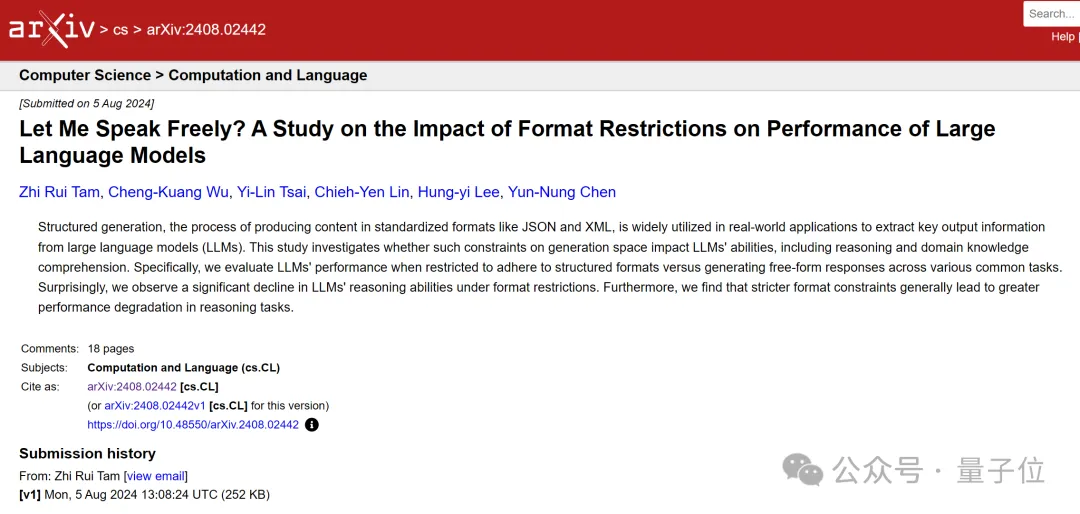

上述研究已發(fā)表在arXiv上,論文主要揭示了,在格式限制下,LLMs的推理能力顯著下降,尤其是在JSON模式下。

一直以來,將LLMs納入工業(yè)應用程序的一個主要障礙是它們缺乏對標準化輸出格式的遵守。

一種常見解決方法是結構化生成,即通過格式限制讓LLMs以JSON或XML等標準化格式提供輸出。

不過話說回來,雖然有多種方式可以實現(xiàn)這種限制,但后續(xù)影響卻無人研究。(限制是否影響模型性能呢?)

說干就干,研究人員采用3種常見方法來評估不同格式限制對下游性能的影響:

- JSON-mode:通過預定義的標記空間限制LLMs的輸出

- FRI:指導LLMs生成符合特定模式的標準化格式響應

- NL-to-Format:兩步過程,首先用自然語言回答問題,然后轉換為目標格式

對了,還要加上自然語言(NL),它是最不受限的格式,允許模型以自然語言自由地回答問題。

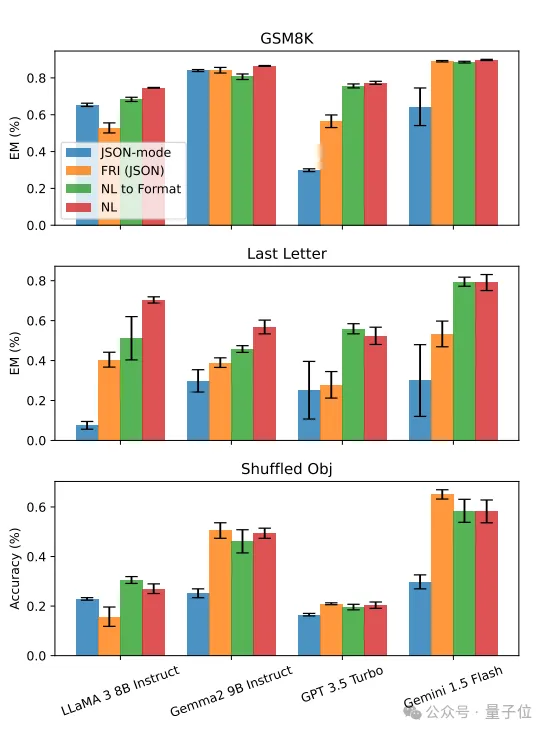

評估對象是GSM8K(包含自然語言環(huán)境中的數(shù)學問題)和Last Letter Concatenation(最后一個字母連接任務)這兩個需要精確匹配答案的數(shù)據(jù)集,以及Shuffled Objects(洗牌對象追蹤任務)。

他們發(fā)現(xiàn),在這些涉及推理的任務中,更寬松的提示通常會得到更好的結果。

同時,JSON模式在大多數(shù)情況下表現(xiàn)最差,其次是格式限制指令(FRI),然后是自然語言到格式(NL to Format)轉換,以及自然語言(NL)提示。

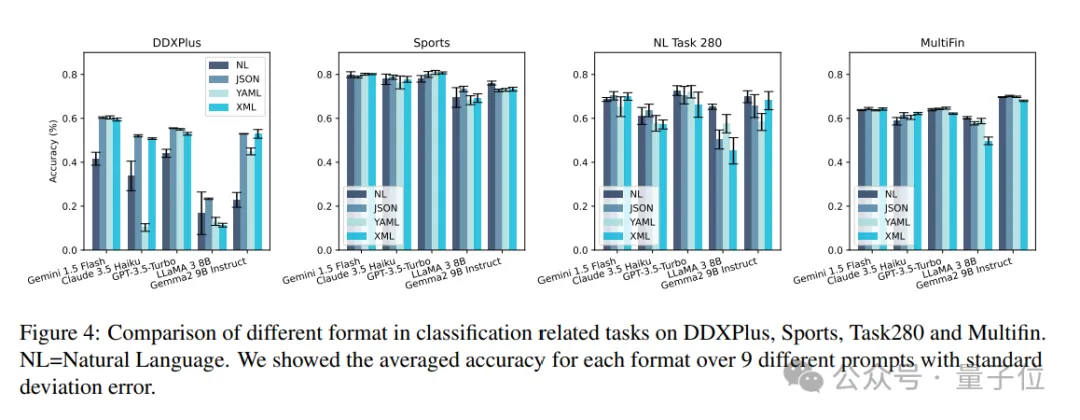

研究還發(fā)現(xiàn),不同的LLMs對不同的數(shù)據(jù)格式表現(xiàn)出不同的偏好。

例如,GPT更喜歡YAML格式,Claude更喜歡XML格式,而Gemini/Gemma則更傾向于JSON格式。

不過,在分類任務中,格式限制可能提高了準確性,因為它減少了可能的答案選擇,從而降低了錯誤率。

他們進一步總結了格式限制會降低模型推理能力的原因,主要包括:

- 限制了模型生成必要中間推理步驟的能力。

- 強制的格式要求可能與模型自然生成答案的方式不兼容。

- 格式錯誤可能導致即使推理正確,答案也因為格式問題而被判定為錯誤。

好消息:能治

針對這一問題,他們提出了幾種應對之策:

首先,前面提到了JSON模式在大多數(shù)情況下表現(xiàn)最差,最后才是自然語言到格式(NL to Format)轉換。

那么反過來說,解決格式限制的最佳方案就成了NL to Format,即LLMs首先用自然語言回答問題,然后再將答案轉換為目標格式。這種方式允許推理與格式遵守分離,從而表現(xiàn)更佳。

此外,結構化輸出中的鍵順序對LLMs的回答方式有重要影響。

例如在使用GPT-3.5 Turbo時,100%的JSON-mode響應錯誤地將“answer” 鍵位于 “reasoning” 之前,這導致模型直接給出答案,而不是展示思考過程。

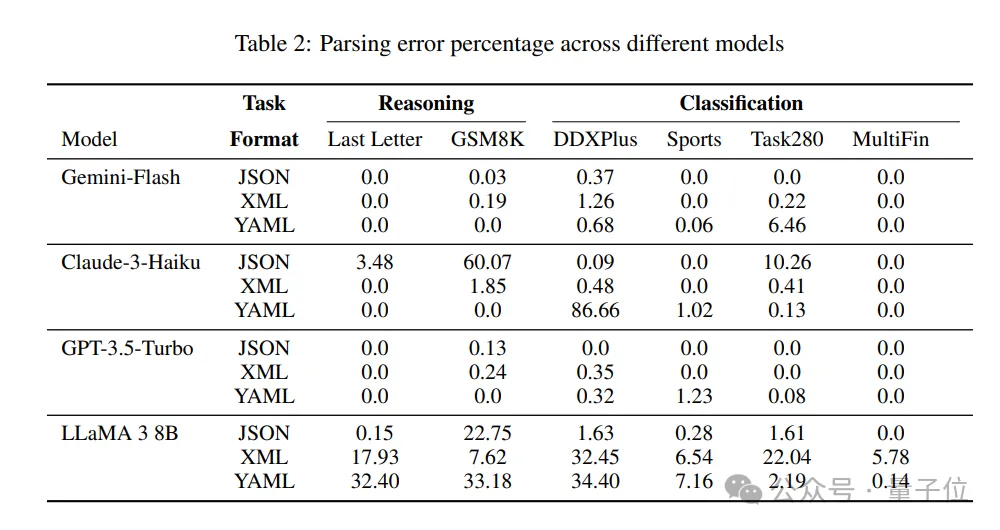

研究還表明,格式限制導致的解析錯誤不是性能差異的主要原因。

例如,在LLaMA 3 8B模型中,Last Letter任務的JSON格式解析錯誤率僅為0.15%,但與自然語言響應相比,性能差距達到了38.15%。

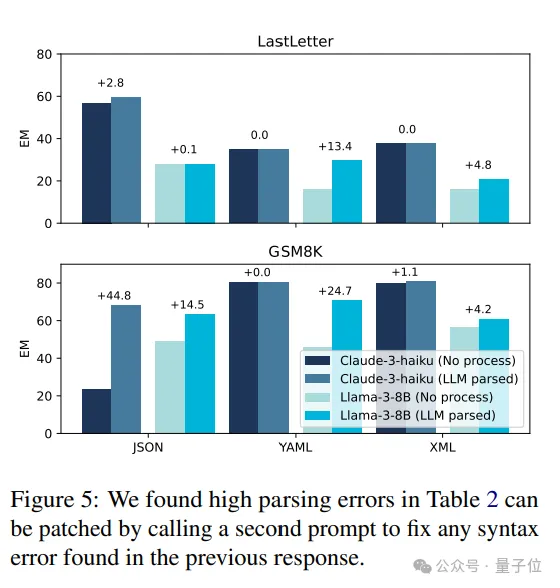

而且可以通過糾正提示來減輕這些錯誤,例如對于Claude-3-Haiku模型,在Last Letter任務中,通過糾正步驟,JSON和YAML格式的準確率分別提高了+2.8%和+44.8%。

以上也意味著,在應用LLMs時,需要在易于解析的格式和保留固有推理能力之間找到平衡點。

最后,研究人員在論文中提醒了:

相比于正則表達式,LLMs作為答案解析器能夠提供更加深入和準確的文本理解,不僅僅局限于表面的模式匹配,而是能夠真正理解答案的含義和上下文。

論文:https://arxiv.org/abs/2408.02442