10行代碼讓大模型數(shù)學(xué)提升20%,“野路子”研究谷歌也測(cè)上了,主要作者全靠自學(xué)成才

只要不到10行代碼,就能讓大模型數(shù)學(xué)能力(GSM8k)提升20%!

幾名獨(dú)立學(xué)者提出了大模型采樣的改進(jìn)方案,引起了開(kāi)源社區(qū)的關(guān)注。

目前該方法已在Mistral-7B上取得成效,在Llama3-70B上的測(cè)試也正在進(jìn)行。

這種方法叫做最小p采樣(min-p sampling),目的是平衡生成文本的連貫性和多樣性。

簡(jiǎn)單說(shuō)就是讓模型在不同場(chǎng)合發(fā)揮不同的特性,例如在事實(shí)問(wèn)題上保持性能穩(wěn)定,在寫(xiě)作等場(chǎng)景中又能發(fā)揮創(chuàng)意。

目前該方法已在Mistral-7B上取得成效,在Llama-70B上的測(cè)試也即將進(jìn)行。

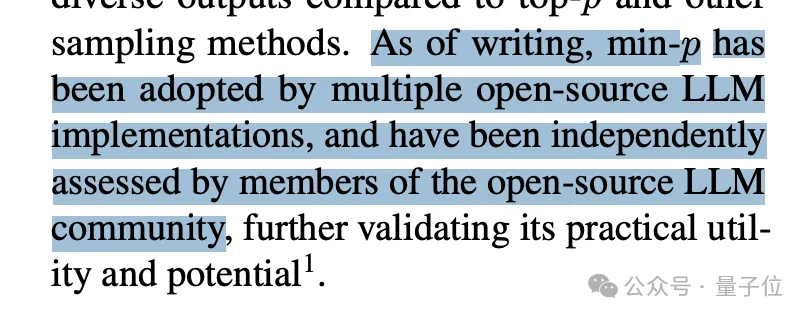

在論文中作者提到,該方法已經(jīng)獲得了開(kāi)源社區(qū)的廣泛應(yīng)用。

同時(shí)作者還透露,Anthropic和谷歌等閉源模型廠商也已經(jīng)或正在針對(duì)min-p進(jìn)行測(cè)試。

消息也得到了谷歌方面的確認(rèn),從OpenAI跳槽到谷歌的開(kāi)發(fā)者社區(qū)負(fù)責(zé)人Logan Kilpatrick已經(jīng)回復(fù)說(shuō)“On it”(在做了)。

微軟Copilot的研究人員Abram Jackson看了后表示,這是他看到的首個(gè)有關(guān)推理過(guò)程token采樣的改進(jìn),未來(lái)還有很大進(jìn)步空間。

值得一提的是,這項(xiàng)受到廣泛關(guān)注的研究,主要作者M(jìn)inh Nhat Nguyen根本沒(méi)系統(tǒng)學(xué)過(guò)CS,而是靠自學(xué)成才。

在一家名為Apart Research的AI安全研究機(jī)構(gòu)幫助下,Minh和團(tuán)隊(duì)其他成員一起完成了該項(xiàng)目。

動(dòng)態(tài)調(diào)整抽樣閾值

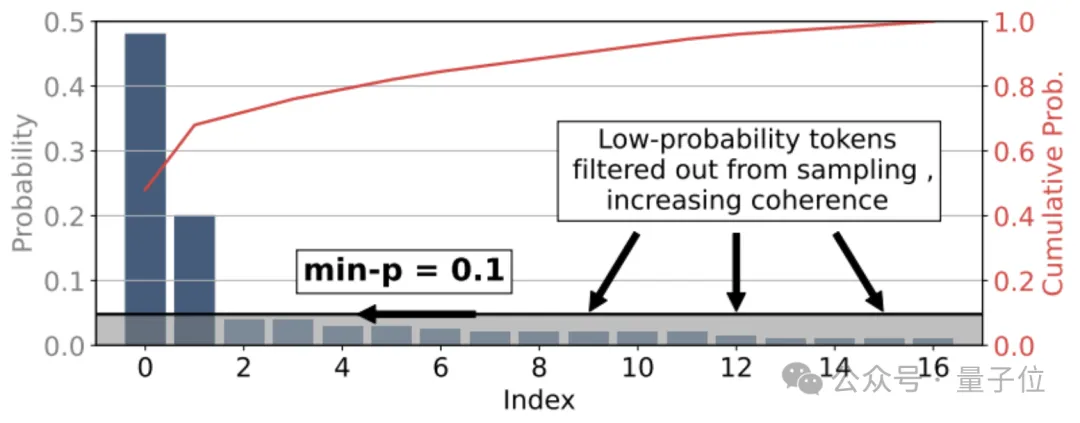

min-p是一種動(dòng)態(tài)截?cái)喑闃?/span>方法,其核心是根據(jù)每一步token分布的最大概率,來(lái)縮放最小概率閾值。

這樣做的目的,主要在于平衡生成文本的連貫性和多樣性,特別是在temperature較高的條件下。

具體來(lái)說(shuō),min-p引入了一個(gè)基礎(chǔ)概率閾值p_base,表示進(jìn)入采樣池的最低概率要求。

在每一步生成token時(shí),min-p會(huì)將p_base與當(dāng)前概率分布中最大的token概率p_max相乘,得到一個(gè)縮放后的絕對(duì)閾值p_scaled。

只有概率大于等于p_scaled的token,才能夠進(jìn)入采樣池。

當(dāng)模型對(duì)某個(gè)token的預(yù)測(cè)概率非常高(即p_max很大)時(shí),p_scaled的值也會(huì)很高,導(dǎo)致采樣池大幅縮小,絕大多數(shù)低概率token被過(guò)濾,只留下少數(shù)高把握的選擇,確保了輸出的連貫性;

而當(dāng)模型對(duì)所有token的預(yù)測(cè)概率都比較接近(p_max較低)時(shí),p_scaled的值也會(huì)相應(yīng)變低,放寬了對(duì)采樣池的要求,納入更多中等概率的token,給予模型更多發(fā)揮空間,生成更加多樣化的內(nèi)容。

在確定采樣池后,min-p會(huì)根據(jù)temperature對(duì)token概率分布進(jìn)行縮放。

它將token的對(duì)數(shù)概率除以一個(gè)溫度參數(shù)τ,并進(jìn)行歸一化后,就得到了temperature縮放后的概率分布。

大于1的τ值會(huì)使概率分布更加平緩,增加低概率token被選中的機(jī)會(huì);

τ小于1時(shí)則會(huì)使分布更加尖銳,強(qiáng)化高概率token的優(yōu)勢(shì)。

最后,min-p從縮放后的采樣池中,按照調(diào)整后的概率分布,隨機(jī)抽取下一個(gè)token。

穩(wěn)定性和創(chuàng)意,“我全都要”

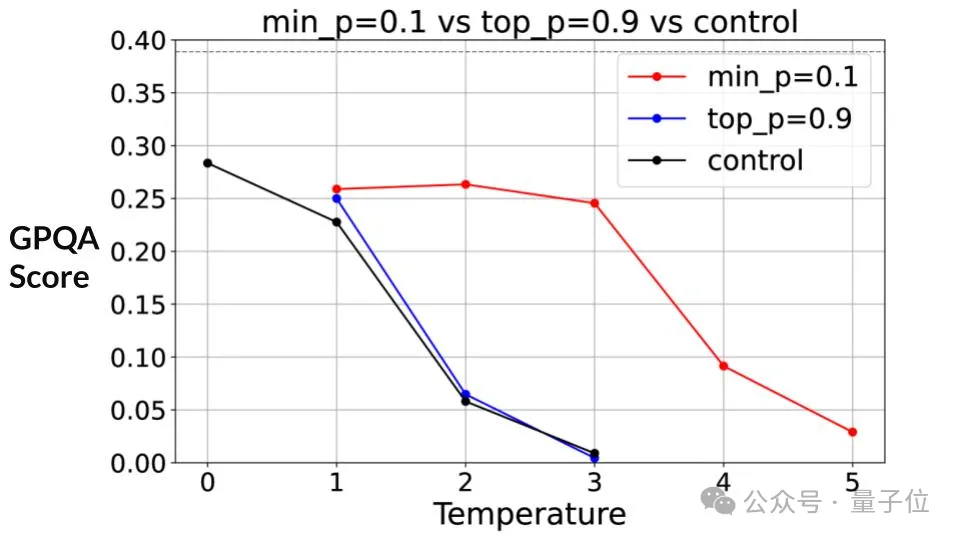

min-p方法的效果究竟如何呢?作者使用了Mistral-7B作為基礎(chǔ)模型進(jìn)行了測(cè)試,我們來(lái)分場(chǎng)景看一下結(jié)果。

在推理任務(wù)中,作者采用了GPQA數(shù)據(jù)集。當(dāng)temperature為1時(shí),可以看到min-p相比于過(guò)去的top-p顯現(xiàn)出了微小的優(yōu)勢(shì)。

隨著temperature增加,GPQA得分整體上呈現(xiàn)出了下降趨勢(shì),但可以觀察到min-p的下降明顯比top-p更慢。

直到temperature達(dá)到3時(shí)min-p的下降趨勢(shì)才變得明顯,此時(shí)top-p的得分已接近0。

也就是說(shuō),相比于top-p,min-p在推理任務(wù)中更好地保持了所需要的穩(wěn)定性。

同樣需要保持穩(wěn)定性能的還有數(shù)學(xué)類(lèi)任務(wù),這里作者使用了GSM8K數(shù)據(jù)集進(jìn)行了測(cè)試。

結(jié)果min-p所對(duì)應(yīng)的分?jǐn)?shù)隨temperature的下降比在GPQA中更快,但仍然緩于top-p方式。

第三類(lèi)任務(wù)是創(chuàng)意寫(xiě)作,這時(shí)對(duì)穩(wěn)定性的要求就不是那么高了,而是需要模型發(fā)揮更多的創(chuàng)意。

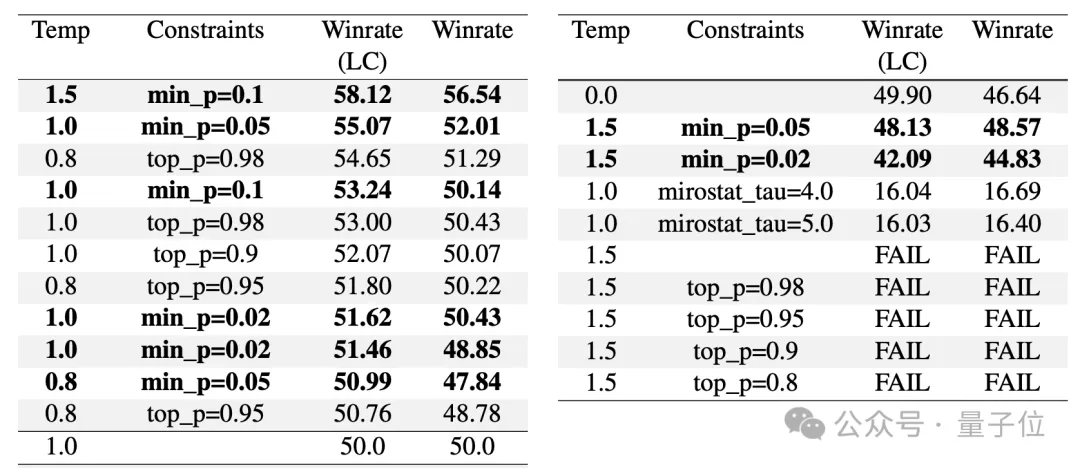

這項(xiàng)測(cè)試使用AlpacaEval數(shù)據(jù)集完成,實(shí)驗(yàn)數(shù)據(jù)是從開(kāi)源社區(qū)的一名獨(dú)立評(píng)估者那里獲得的。

實(shí)驗(yàn)結(jié)果顯示,在temperature=1.5、min-p=0.1的設(shè)置下,min-p的性能尤其突出,可生成top-p方法難以生成的創(chuàng)意寫(xiě)作內(nèi)容。

在該參數(shù)下,min-p方法得到的文本獲得了58.12%的人類(lèi)評(píng)判優(yōu)選率,遠(yuǎn)高于其他方法在類(lèi)似設(shè)置下的表現(xiàn)。

論文地址:https://arxiv.org/abs/2407.01082

GitHub:https://github.com/menhguin/minp_paper/