ICLR 驚現[10,10,10,10]滿分論文,ControlNet 作者新作,Github 5.8k 顆星

四個 10 分!罕見的一幕出現了。

您正在收看的,不是中國夢之隊的跳水比賽,而是 ICLR 2025 的評審現場。

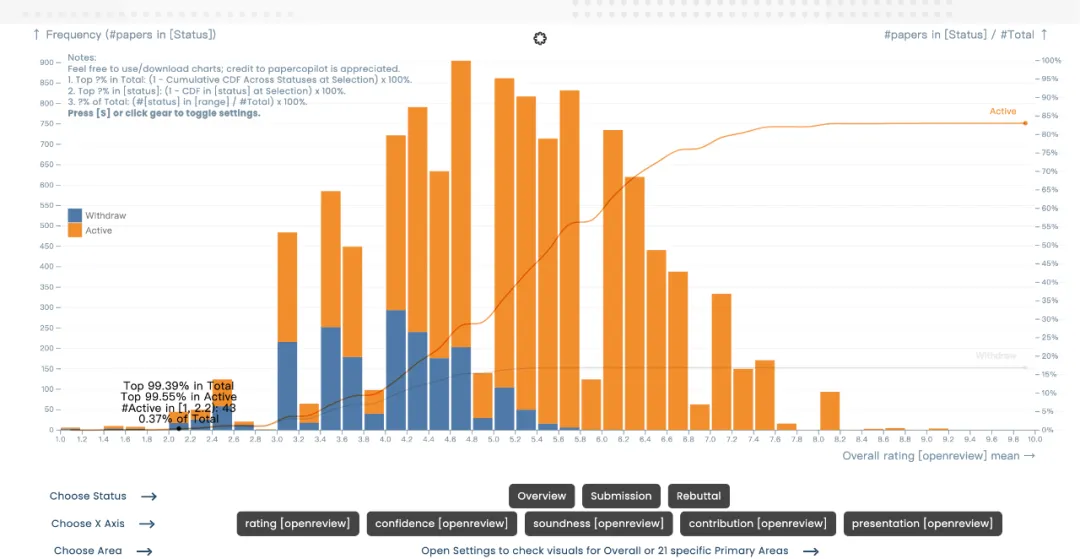

雖說滿分論文不是前無古人,后無來者,但放在平均分才 4.76 的 ICLR,怎么不算是相當炸裂的存在呢。

https://papercopilot.com/statistics/iclr-statistics/iclr-2025-statistics/

這篇征服了列位審稿人的論文,正是 ControlNet 作者張呂敏的新作 IC-Light。我們很少看到一篇論文,能夠讓四位審稿人給出高度一致的「Rating: 10: strong accept, should be highlighted at the conference」。

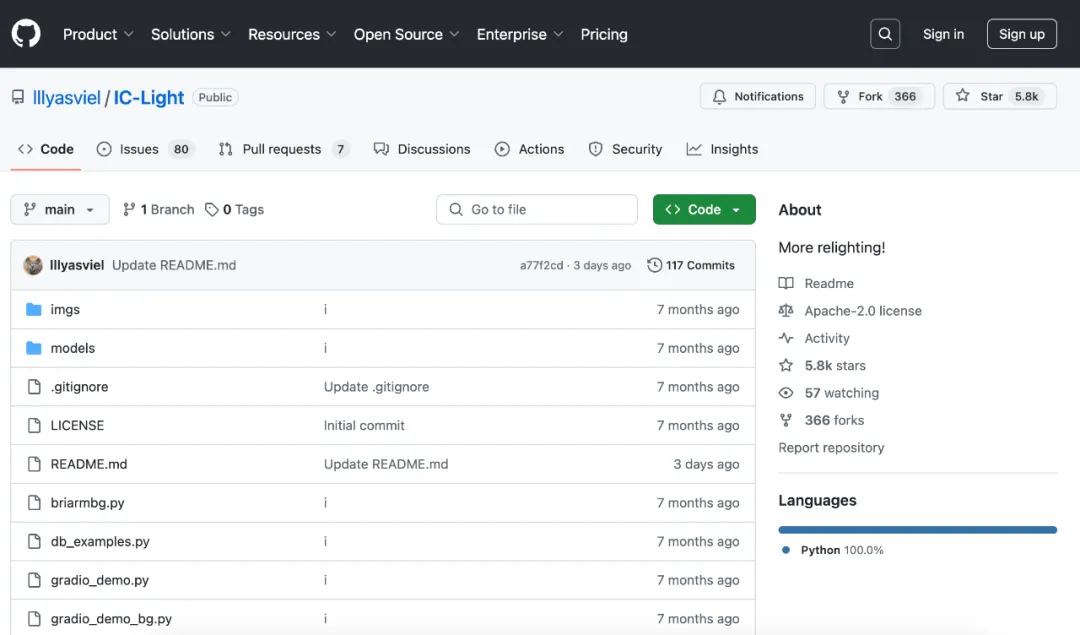

早在向 ICLR 投稿之前,IC-Light 就已經在 Github 上開源半年了,收獲了 5.8k 的星標,足見其效果之優秀。

最初版本是基于 SD 1.5 和 SDXL 實現的,而就在前幾天,團隊又推出了 V2 版本,適配了 Flux,效果也更上一層樓。

感興趣的朋友們,可以直接試玩。

- Github 項目:https://github.com/lllyasviel/IC-Light?tab=readme-ov-file

- V2 版本:https://github.com/lllyasviel/IC-Light/discussions/98

- 試玩鏈接:https://huggingface.co/spaces/lllyasviel/IC-Light

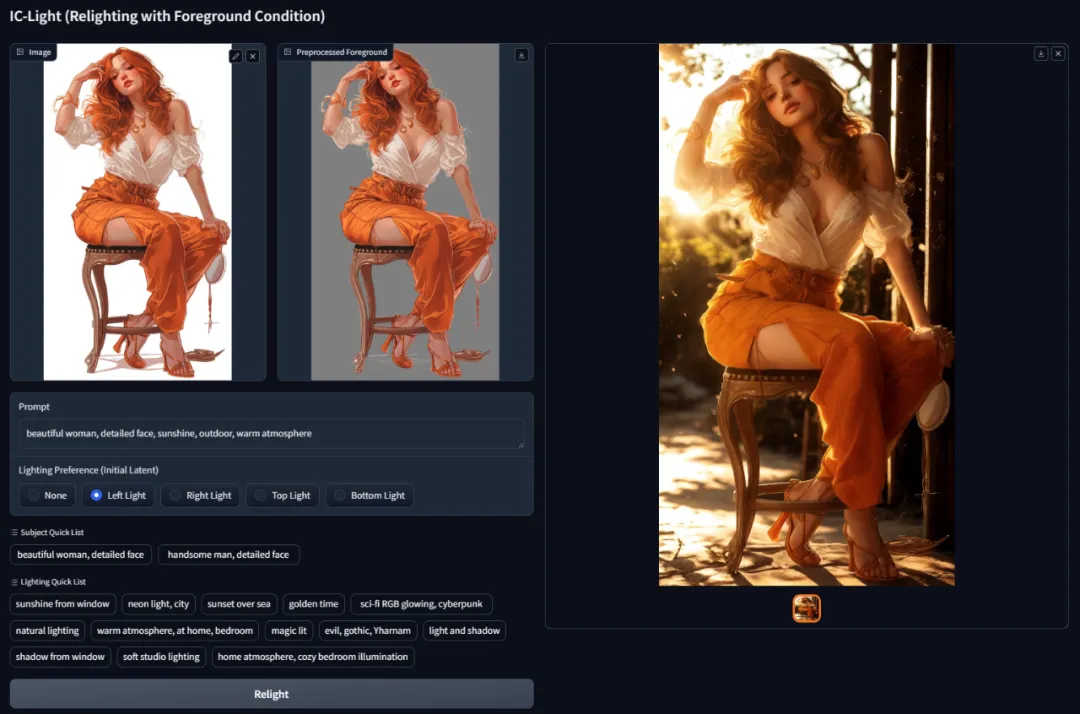

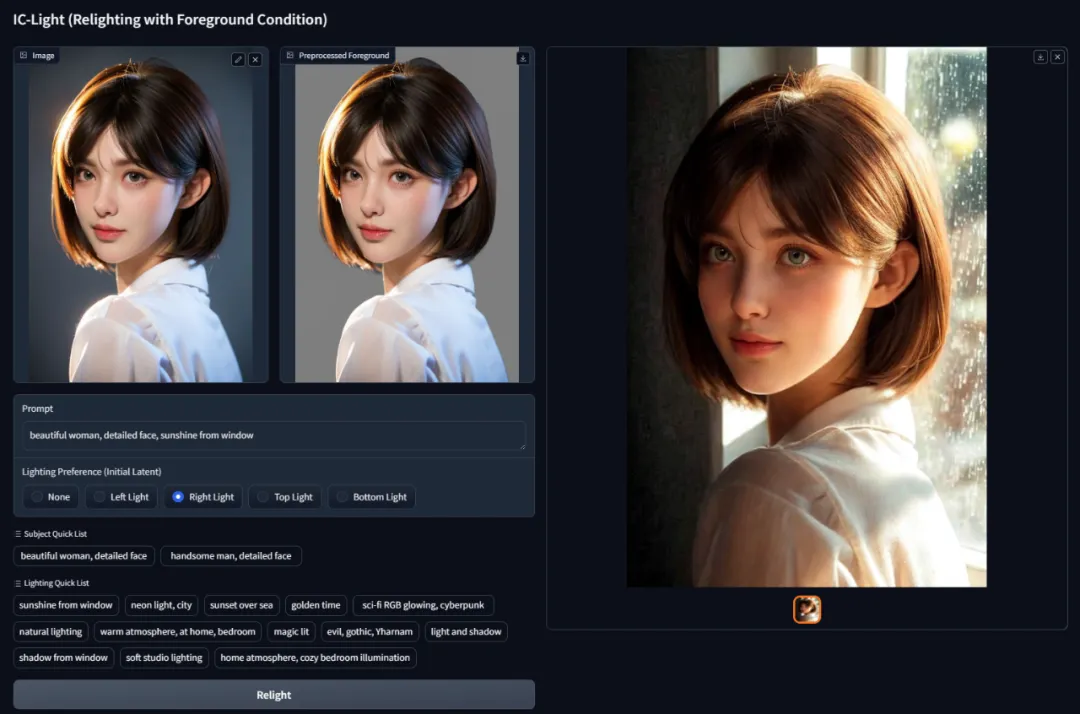

IC-Light 是一個基于擴散模型的照明編輯模型,可以通過文本精準控制圖像的光照效果。

也就是說,要放在 PS 里打開蒙版、打開 alpha 通道,調試明暗分離才能搞定的光影效果,用上 IC-Light,就變成了「動動嘴皮子的事」。

輸入 prompt,要讓光從窗戶里打進來,于是就能看到陽光透過雨后的窗戶,在人物側臉打出柔和的輪廓光。

IC-Light 不僅精準地還原了光線的方向,還精準地呈現了光透過玻璃的漫射效果。

對霓虹燈這樣的人工光源,IC-Light 的效果同樣出色。

根據提示詞,原本在教室里的場景立馬爆改賽博朋克風格:霓虹燈的紅藍雙色打在人物身上,營造出深夜都市特有的科技感和未來感。

模型不僅準確還原了霓虹燈的色彩滲透效果,還保持了人物的一致性。

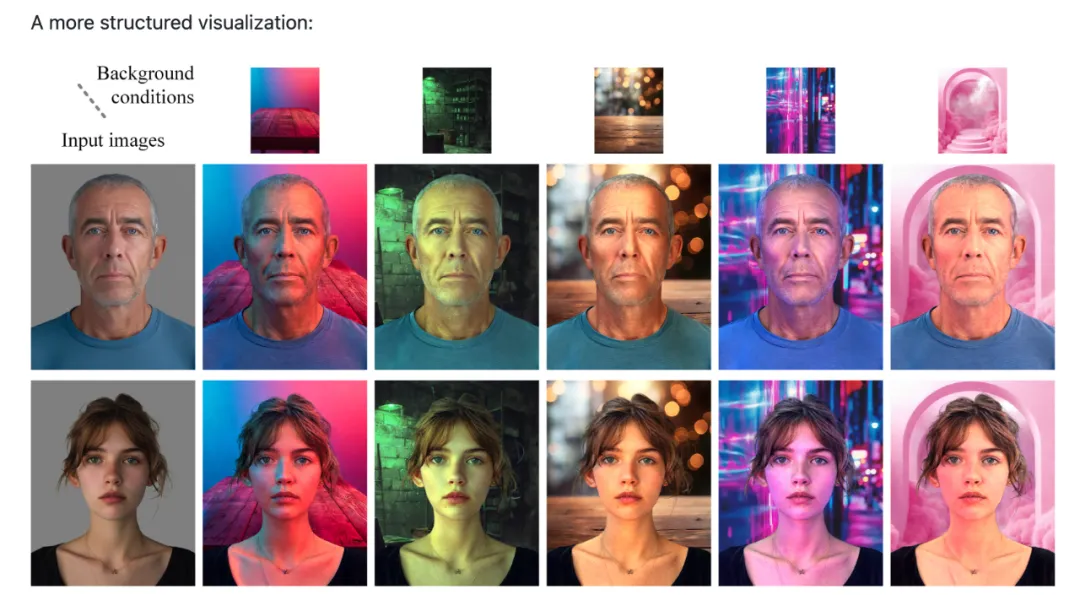

IC-Light 還支持上傳背景圖片,來改變原圖的光照。

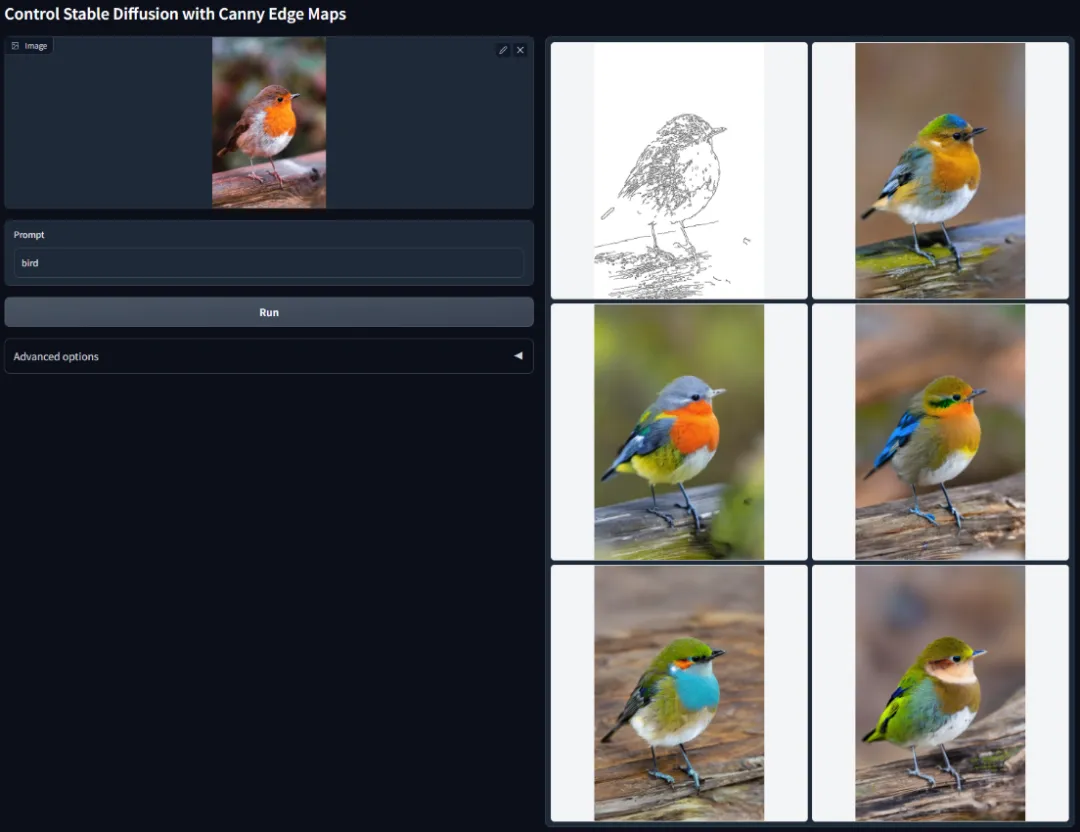

而說到 ControlNet,大家應該都不陌生,它可是解決了 AI 繪畫界一個老大難問題。

Github 項目:https://github.com/lllyasviel/ControlNet

之前,Stable Diffusion 最讓人頭疼的就是無法精確控制圖像細節。不管是構圖、動作、面部特征還是空間關系,即便提示詞已經做了很詳細的規定,但 SD 生成的結果,依然要堅持 AI 獨特的想法。

但 ControlNet 的出現就好像是給 SD 裝上了「方向盤」,許多商業化的工作流也因此催生。

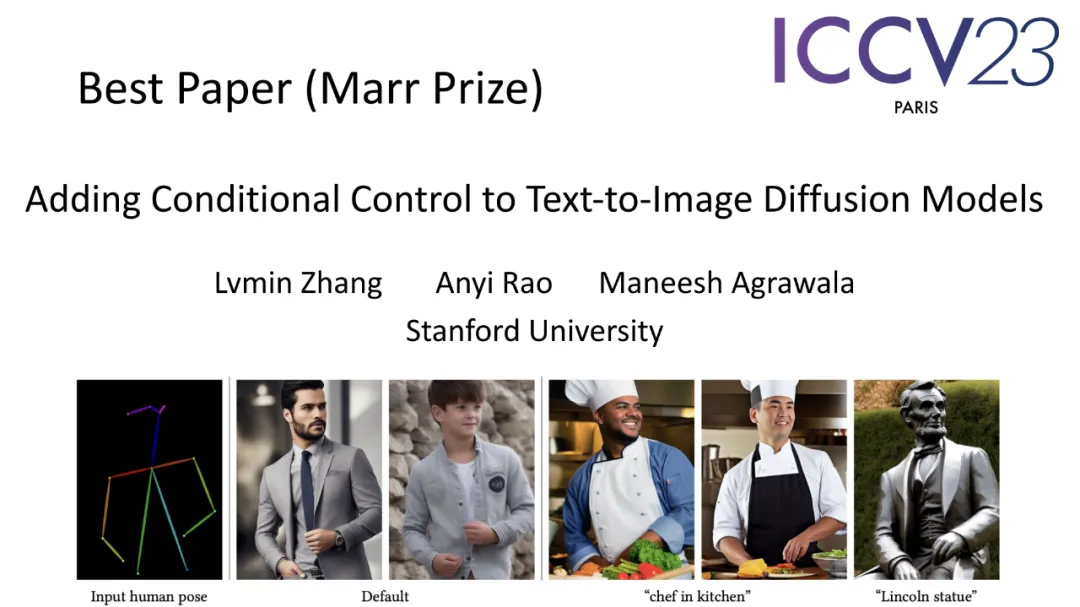

學術應用兩開花,ControlNet 在 ICCV 2023 摘下了馬爾獎(最佳論文獎)的桂冠。

雖然很多業內人士表示在卷得飛起的圖片生成領域,真正的突破越來越難。但張呂敏似乎總能另辟蹊徑,每次出手都能精準命中用戶需求。這一次也不例外。

在現實世界中,光照和物體表面的材質是緊密關聯的。比如你看到一個物體時,很難分清楚是光線還是材質,讓物體呈現出是我們眼中樣子。因此,在讓 AI 編輯光線時,也很難做到不改變物體本身的材質。

以前的研究想通過構建特定的數據集來解決這個問題,但收效甚微。而 IC-Light 的作者發現用 AI 合成生成的數據加上一些人工處理,能達到不錯的效果。這個發現對整個研究領域都有啟發意義。

ICLR 2025 剛放榜之時,IC-Light 就憑借「10-10-8-8」穩坐最高分論文的寶座。

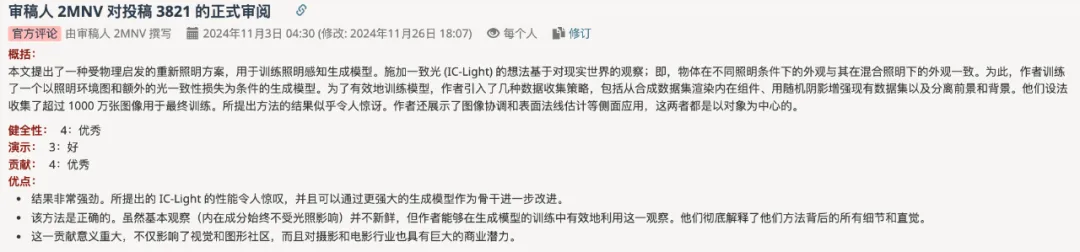

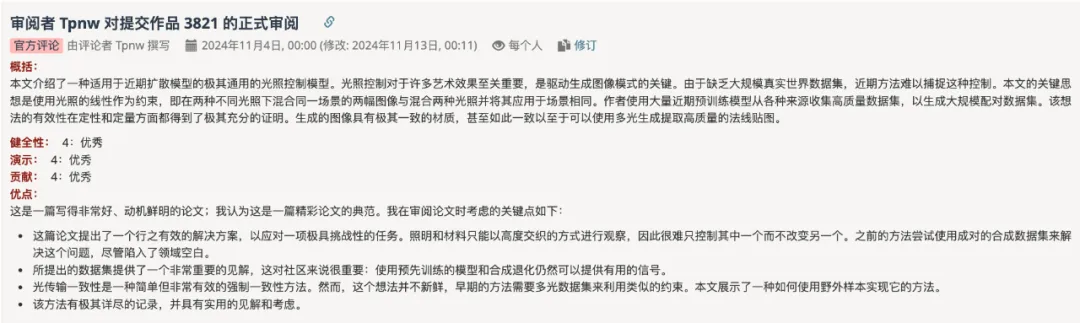

審稿人們在審稿意見里也不乏贊美之詞:

「這是一篇精彩論文的典范!」

「我認為所提出的方法和由此產生的工具將立即對許多用戶有用!」

在 rebuttal 結束,補了一些參考文獻和實驗之后。那兩位給 8 分的審稿人也欣然改成了滿分。

下面,就讓我們一起來看看滿分論文具體都寫了什么。

研究細節

- 論文標題:Scaling In-the-Wild Training for Diffusion-based Illumination Harmonization and Editing by Imposing Consistent Light Transport

- 論文鏈接:https://openreview.net/pdf?id=u1cQYxRI1H

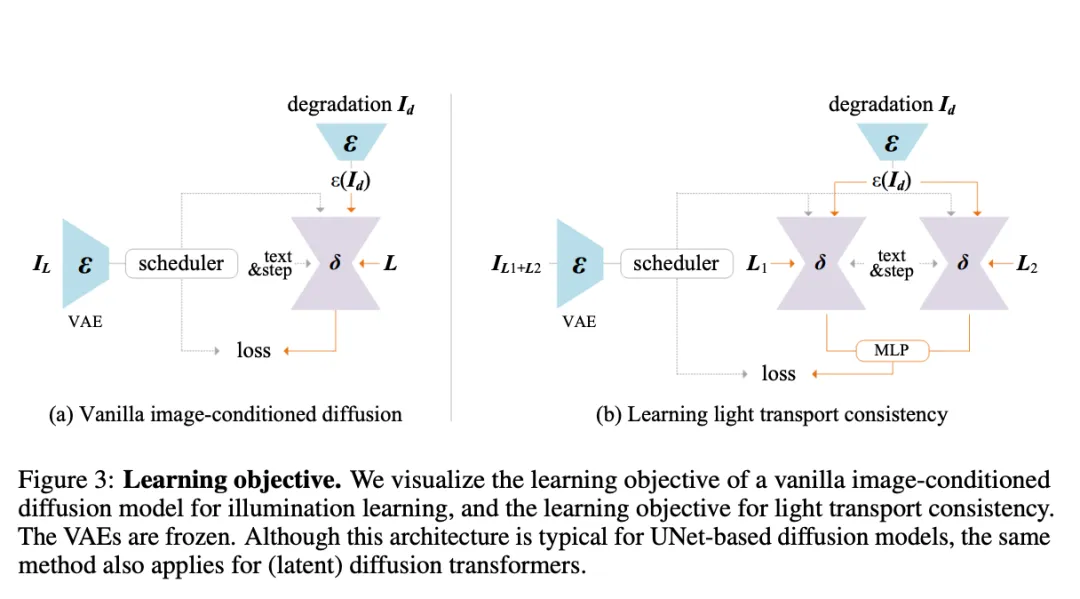

在這篇論文中,研究者根據光傳輸獨立性的物理原理,提出了在訓練過程中強加一致光(IC-Light)傳輸的方法,其物理原理是:不同光照條件下物體外觀的線性混合與混合光照下的外觀一致。

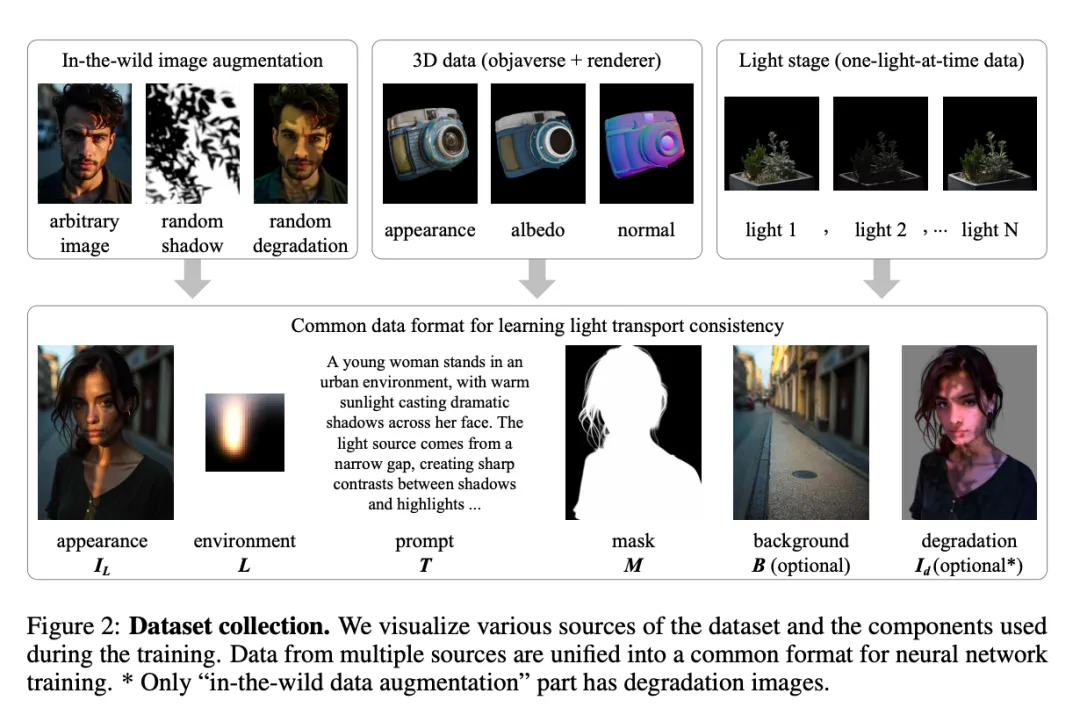

如圖 2 所示,研究者利用多種可用數據源對照明效果的分布進行建模:任意圖像、3D 數據和燈光舞臺圖像。這些分布可以捕捉現實世界中各種復雜的照明場景,背光、邊緣光、輝光等。為簡單起見,此處將所有數據處理為通用格式。

但學習大規模、復雜和嘈雜的數據是一項挑戰。如果沒有合適的正則化和約束條件,模型很容易退化為與預期光照編輯不符的隨機行為。研究者給出的解決方案是在訓練過程中植入一致光(IC-Light)傳輸。

通過施加這種一致性,研究者引入了一個強大的、以物理為基礎的約束條件,確保模型只修改圖像的光照方面,同時保留反照率和精細圖像細節等其他固有屬性。這種方法可以在 1000 多萬個不同樣本上進行穩定、可擴展的訓練,樣本包括來自光照舞臺的真實照片、渲染圖像以及帶有合成光照增強的野外圖像。本文提出的方法能夠提高光照編輯的精度,降低不確定性,減少偽影,同時不改變基本的外觀細節。

總體來說,這篇論文的貢獻主要包括:

(1) 提出了 IC-Light,一種通過施加一致光傳輸來擴展基于擴散的光照編輯模型訓練的方法,確保在保留內在圖像細節的同時進行精確的光照修改;

(2) 提供了預訓練的光照編輯模型,以促進不同領域內容創建和處理中的光照編輯應用;

(3) 通過大量實驗驗證了這種方法的可擴展性和性能,顯示了它在處理各種光照條件時與其他方法的不同之處;

(4) 介紹了其他應用,如法線貼圖生成和藝術照明處理,進一步展示了該方法在真實世界、實際場景中的多功能性和魯棒性。

實驗結果

在實驗中,研究者驗證了擴大訓練規模和數據源多樣化可以增強模型的魯棒性,并能提高各種與光照相關的下游任務的性能。

消融實驗證明,在訓練過程中應用 IC-Light 方法可以提高光照編輯的準確性,從而保留反照率和圖像細節等內在屬性。

此外,與在更小或更結構化的數據集上訓練的其他模型相比,本文方法適用于更廣泛的光照分布,如邊緣照明、背光照明、魔法發光、日落光暈等。

研究者還展示了該方法處理更多野外照明場景的能力,包括藝術照明和合成照明效果。此外還探討了生成法線貼圖等更多應用,并討論了這種方法與典型主流幾何估計模型之間的差異。

消融實驗

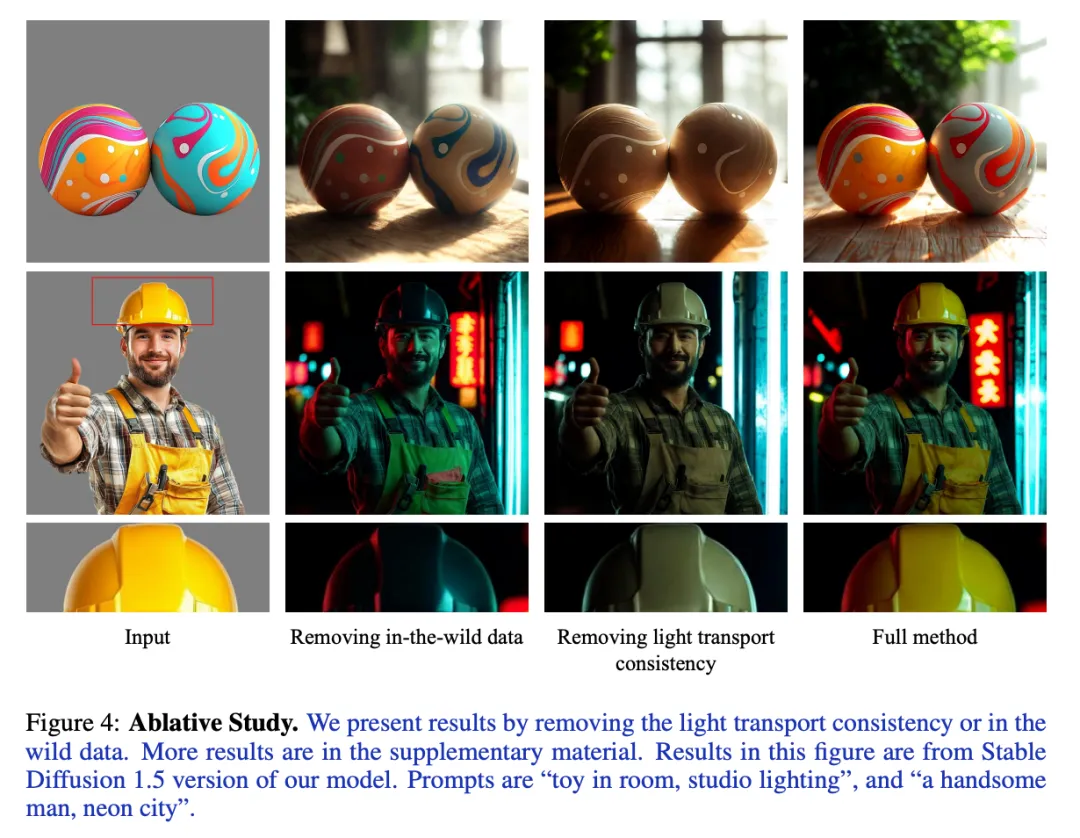

研究者首先恢復了訓練中的模型,但刪除了野外圖像增強數據。如圖 4 所示,移除野外數據嚴重影響了模型的泛化能力,尤其是對于肖像等復雜圖像。例如,訓練數據中不存在的肖像中的帽子經常會以不正確的顏色呈現(如從黃色變為黑色)。

研究者還嘗試了移除光傳輸一致性。沒有了這一限制,模型生成一致光照和保留反照率(反射顏色)等固有屬性的能力明顯下降。例如,一些圖像中的紅色和藍色差異消失了,輸出結果中也出現了明顯的色彩飽和度問題。

而完整的方法結合了多種數據源,并加強了光傳輸的一致性,產生了一個能夠在各種情況下通用的均衡模型。它還保留了細粒度圖像細節和反照率等固有屬性,同時減少了輸出圖像的誤差。

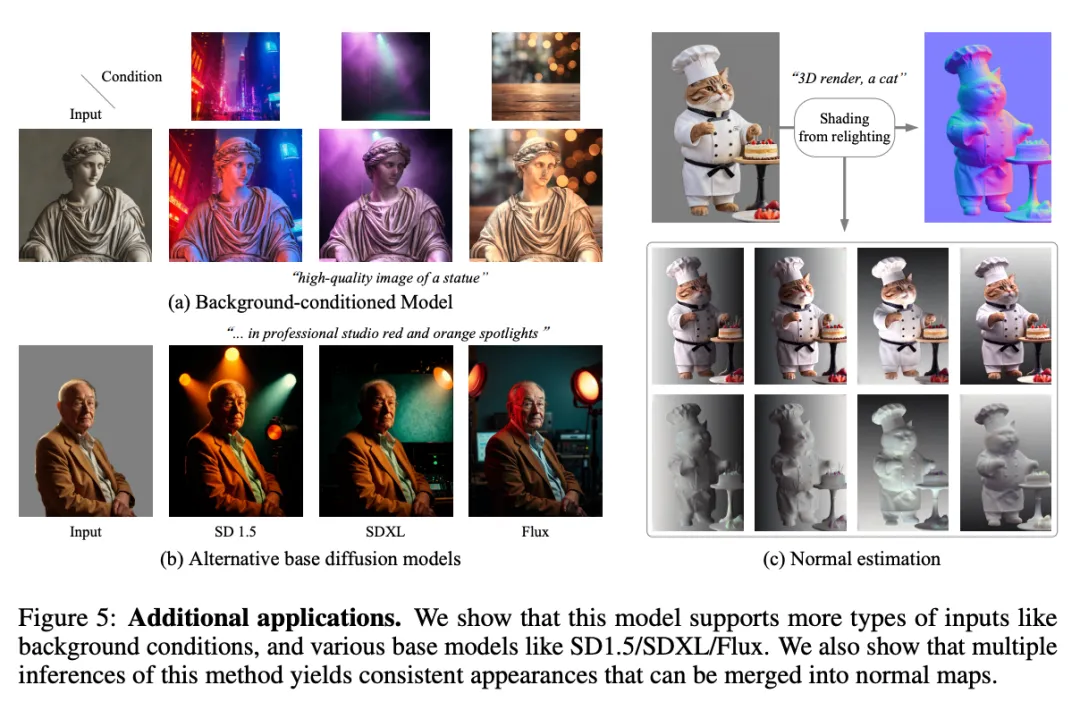

其他應用

如圖 5 所示,研究者還展示了其他應用,例如利用背景條件進行光照協調。通過對背景條件的額外通道進行訓練,本文的模型可以完全根據背景圖像生成照明,而無需依賴環境映射。此外,模型還支持不同的基礎模型,比如 SD1.5、SDXL 和 Flux,這些模型的功能在生成的結果中都有所體現。

定量評估

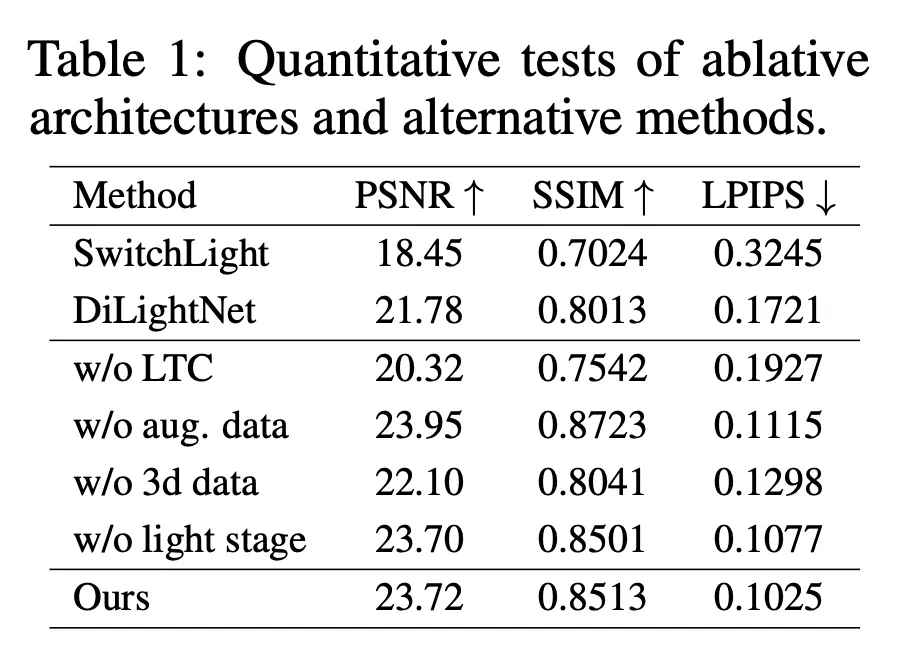

在定量評估中,研究者使用了峰值信噪比(PSNR)、結構相似性指數(SSIM)和學習感知圖像補丁相似性(LPIPS)等指標。并從數據集中提取了 50000 個未見過的 3D 渲染數據樣本子集進行評估,確保模型在訓練過程中沒有遇到過這些樣本。

測試的方法有 SwitchLight、DiLightNet,以及本文方法不包含某些組件(例如,不包含光傳輸一致性、不包含增強數據、不包含三維數據和不包含燈光舞臺數據)的變體。

如表 1 所示,就 LPIPS 而言,本文方法優于其他方法,表明其具有卓越的感知質量。僅在三維數據上訓練的模型獲得了最高的 PSNR,這可能是由于對渲染數據的評估偏差所致(因為本次測試僅使用了三維渲染數據)。結合多種數據源的完整方法在感知質量和性能之間取得了平衡。

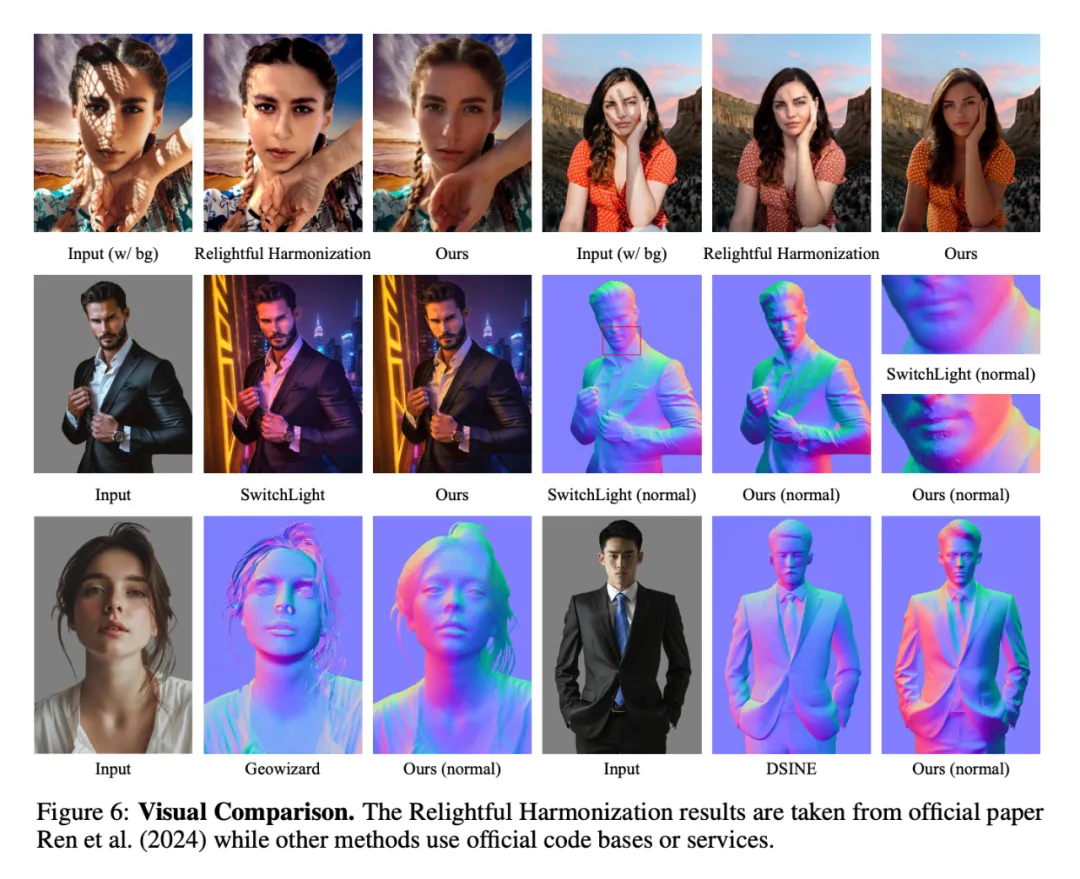

視覺對比

研究者還與之前的方法進行了直觀比較。如圖 6 所示,與 Relightful Harmonization 相比,由于訓練數據集更大更多樣化,本文模型對陰影的魯棒性更高。SwitchLight 和本文模型產生了具有競爭力的重新照明結果。這種方法的法線貼圖質量更細致一些,這要歸功于從多個表象中合并和推導陰影的方法。此外,與 GeoWizard 和 DSINE 相比,該模型生成的人類法線貼圖質量更高。

更多研究細節,可參考原論文。