剛剛,OpenAI Sora正式炸裂登場,網頁擠爆了!

OpenAI 12 天連更的第三個工作日,重磅發布終于來了!

正如直播之前大家在評論區預想的一樣,視頻生成大模型 Sora 正式版終于露面!

算起來,距離今年 2 月 16 日 Sora 的發布已經過去了近 10 個月的時間。

如今,廣大網友終于可以體驗 Sora 強大的視頻生成能力!

同時,OpenAI 開發了 Sora 的新版本 ——Sora Turbo,它比二月份的預覽版模型快得多。今天該版本將作為獨立產品提供給 ChatGPT Plus 和 Pro 用戶。

據今天的直播介紹,Sora 用戶可以生成 1080p 分辨率、最長 20 秒、寬屏、豎屏或方形的視頻。并且用戶可以利用資源進行擴展、remix 和融合,或者基于文本生成全新的內容。OpenAI 開發了全新的界面,讓使用文本、圖像和視頻來提示 Sora 變得更加容易,同時故事板工具讓用戶可以精準地指定每個幀的輸入。

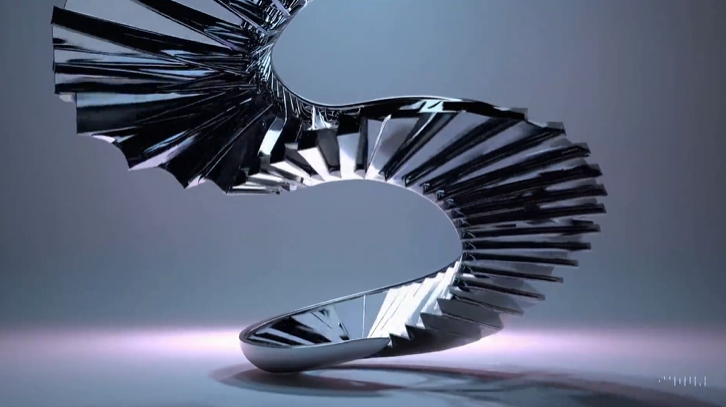

我們可以先看幾個生成視頻示例:

提示:鏡頭霧氣彌漫,色彩對比鮮明,捕捉到的感覺是低能見度的鏡頭質量,提供一種即時感和混亂感。該場景從 17 世紀海盜船上水手的視角展示了搖晃的鏡頭。海浪沖擊木制船體時,地平線劇烈搖晃,難以辨別細節。突然,一只巨大的海怪從洶涌的大海中突然出現。它巨大而滑溜的觸手危險地伸出,黏糊糊的附肢以可怕的力量纏繞著船。當水手們慌亂地爭先恐后地面對這個可怕的海洋生物時,視野發生了劇烈變化。氣氛非常緊張,混亂中可以聽到船的呻吟聲和大海的咆哮聲。

提示:洛克菲勒中心到處都是金毛獵犬!無論你放眼望去,都是金毛獵犬。這是紐約夜間的冬季仙境,還有一棵巨大的圣誕樹。背景中可以看到出租車和其他紐約元素

山姆?奧特曼表示,最令他興奮的一點是與其他人共同創作的便捷性,感覺就像是一個有趣的新事物。大家可以將 Sora 看作視頻版的 GPT-1。

OpenAI 研究科學家 Noam Brown 表示,Sora 是 scale 力量最直觀的展示。

對于 Sora 的發布,有網友表示,這是最好的圣誕節禮物,也有稱 Sora 將是游戲改變者。

通過文字、圖片或視頻

讓你的想象力栩栩如生

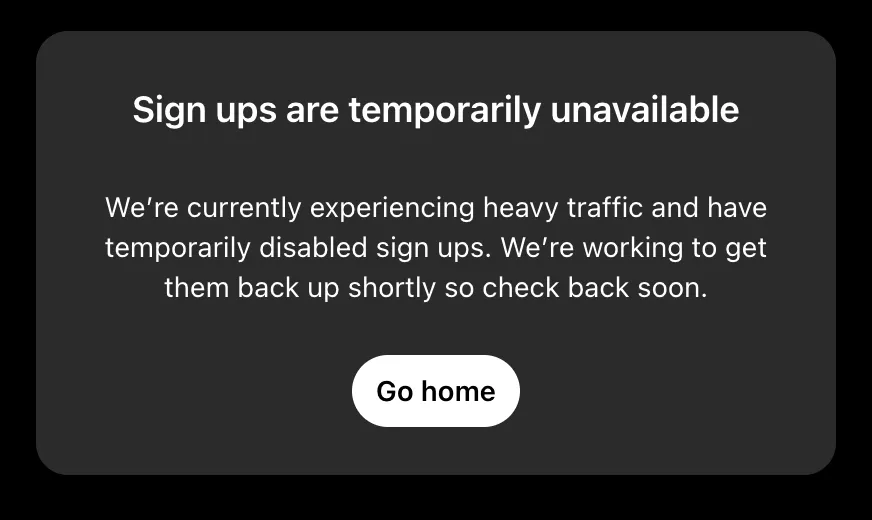

懷著激動的心情,機器之心也想上手嘗鮮 Sora!奈何想要體驗的網友太多,一直登錄不上:

體驗地址:https://sora.com/onboarding

那就先為讀者們展示下官方放出的 Sora 的能力吧。

使用 Remix 替換、刪除或重新構想視頻中的元素

打開通往圖書館的大門

將門替換為法式門

門外的場景替換為月球景觀

Re-cut:找到并隔離最佳幀,然后向任一方向延伸它們以完成場景

Storyboard:在時間線上組織和編輯視頻的獨特序列

視頻前 114 幀的場景是「一片廣闊的紅色景觀,遠處停靠著一艘宇宙飛船。」

接著,可以將視頻的 114-324 幀的場景變換為:「從宇宙飛船內部向外看,一位太空牛仔站在畫面的中央。」

最后,可以將視頻內容描述為「宇航員眼睛的特寫鏡頭,眼睛被針織面料制成的面罩所框住。」

Loop:使用 Loop 剪輯并創建無縫重復的視頻

Blend:將兩個視頻合并為一個無縫剪輯

Style presets:使用「Presets」創建和分享激發自己想象力的風格

更多 Sora 生成的驚艷視頻,也需要廣大網友們的想象力去創造了。

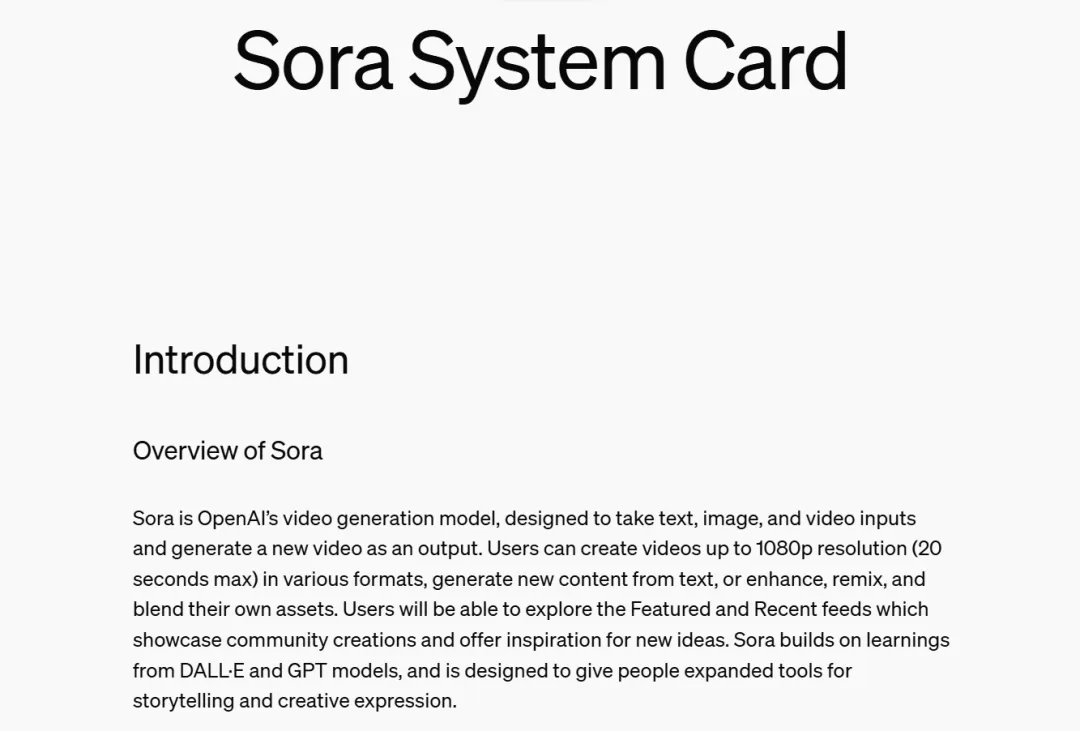

Sora 正式版系統卡

在今年 2 月份,Sora 剛發布時,OpenAI 曾公布了 Sora 的技術報告(參閱:我在模擬世界!OpenAI 剛剛公布 Sora 技術細節:是數據驅動物理引擎)。

OpenAI 認為,擴展視頻生成模型是構建物理世界通用模擬器的一條有前途的途徑。

今天隨著 Sora 的正式發布,OpenAI 也放出了 Sora 的系統卡(System Card),感興趣的開發者們可以深挖一下技術細節。

地址:https://openai.com/index/sora-system-card/

Sora 是 OpenAI 的視頻生成模型,旨在獲取文本、圖像和視頻輸入并生成新視頻作為輸出。用戶可以創建各種格式的高達 1080p 分辨率(最長 20 秒)的視頻。

Sora 建立在 DALL?E 和 GPT 模型的基礎上,旨在為人們提供創意表達的工具。

Sora 是一種擴散模型,它從看起來像靜態噪聲的基本視頻開始生成新視頻,通過多個步驟消除噪聲來逐漸對其進行轉換。通過一次為模型提供多幀預測,Sora 解決了一個具有挑戰性的問題,即確保畫面主體即使暫時離開視野也能保持不變。與 GPT 模型類似,Sora 使用 transformer 架構,釋放出卓越的擴展性能。

Sora 使用 DALL?E 3 中的重描述(recaptioning)技術,該技術涉及為視覺訓練數據生成高度描述性的字幕(captions)。因此,Sora 能夠更忠實地遵循生成視頻中用戶的文本指令。

除了能夠僅根據文本指令生成視頻之外,該模型還能夠獲取現有的靜態圖像并從中生成視頻,準確地將圖像內容動畫化并關注細節。該模型還可以獲取現有視頻并對其進行擴展或填充缺失幀。Sora 是能夠理解和模擬現實世界的模型的基礎,OpenAI 認為 Sora 將成為通往 AGI 的重要里程碑。

在數據方面,正如 OpenAI 在 2 月的技術報告中所述,Sora 從大型語言模型中汲取靈感,這些模型通過互聯網規模數據的訓練來獲得通才能力。LLM 得以確立新范式,部分得益于創新了 token 使用的方法。研究人員們巧妙地將文本的多種模態 —— 代碼、數學和各種自然語言統一了起來。

在 Sora 中,OpenAI 考慮了生成視覺數據的模型如何繼承這種方法的好處。大型語言模型有文本 token,而 Sora 有視覺 patch。此前的研究已經證明 patch 是視覺數據模型的有效表征。OpenAI 發現 patch 是訓練生成各種類型視頻和圖像的模型的可擴展且有效的表征。

在更高層面上,OpenAI 首先將視頻壓縮到較低維的潛在空間,然后將表征分解為時空 patch,從而將視頻轉換為 patch。

Sora 接受過各種數據集的訓練,包括公開數據、通過合作伙伴獲取的專有數據以及內部開發自定義數據集:

- 公開可用的數據。這些數據主要從行業標準的機器學習數據集和網絡爬蟲中收集。

- 來自數據合作伙伴的專有數據。OpenAI 建立合作伙伴關系來獲取非公開數據。例如,與 Shutterstock? Pond5 合作構建、提供人工智能生成的圖像。OpenAI 還委托創建適合自己需求的數據集。

- 人工數據。來自人工智能訓練師、紅隊隊員和員工的反饋。

更多細節,讀者們可以查看系統卡介紹。

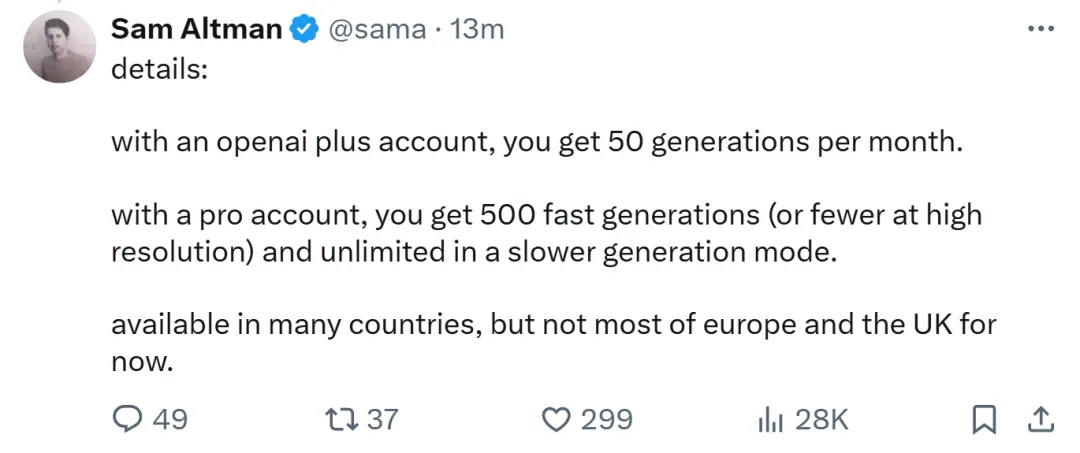

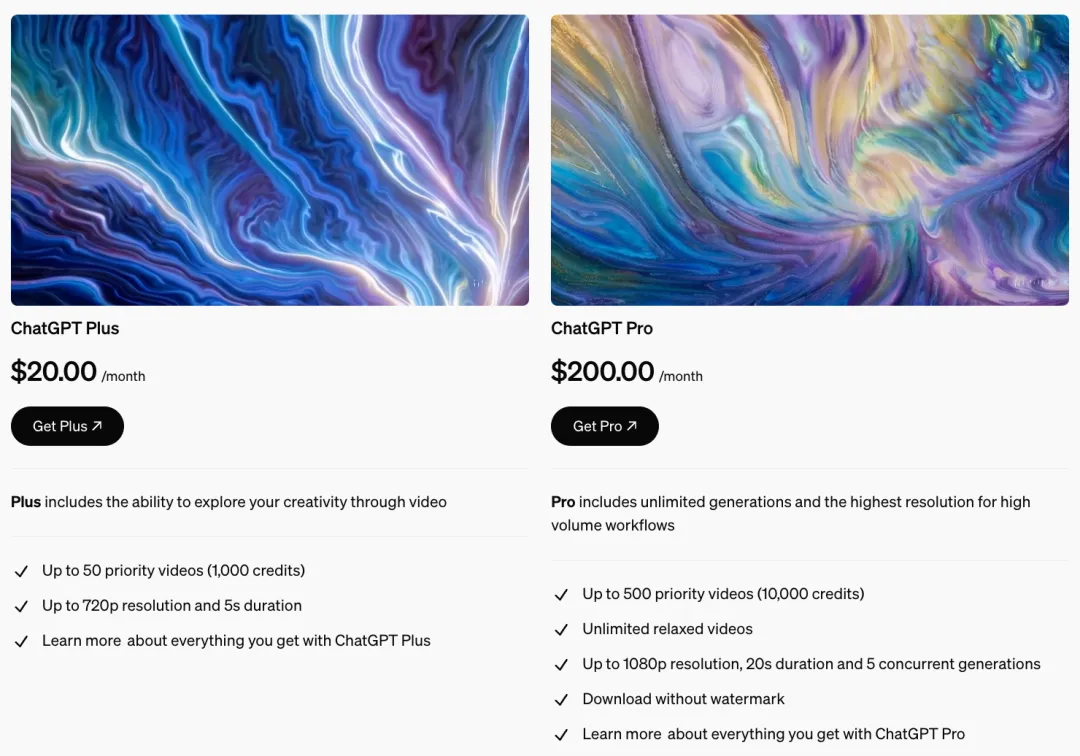

價格權益

當然,隨著 Sora 的正式發布,OpenAI 也公布了使用價格。看來,也并不便宜:

20 美元一個月的 ChatGPT Plus 用戶可以享受的視頻生成權益包括:

- 最多 50 個優先視頻(1000 個積分)

- 分辨率高達 720p,時長為 5 秒

200 美元一個月的 ChatGPT Pro 用戶可以享受的視頻生成權益包括:

- 最多 500 個優先視頻(10000 個積分)

- 無限 relaxed 視頻

- 分辨率高達 1080p,持續時間為 20 秒,可并發生成 5 個

- 下載無水印

畢竟期待了這么久。你們沖不沖?