學會區分大模型——大模型的分類,讓你更清晰的認識大模型 原創

“ 亂花漸欲迷人眼,學會從根本上認識問題”

現在市面上大模型如百花齊放,對很多人來說一堆大模型帶來的不是簡單方便,而是亂七八糟以及迷茫。

因為不知道不同的大模型之間有什么區別,也不知道自己需要什么樣的大模型;就拿huggingface來說,上面的模型有幾十萬,有幾個人能弄明白它們都是干什么的?

因此,我們首先需要學會的就是大模型的分類,對大模型分門別類之后就知道哪些大模型是做什么的,自己需要的是什么了。

大模型的分類

事實上直接說大模型并不是特別準確,大模型指的是具有龐大參數的機器學習或者深度學習模型。

根據模型的參數量可以分為大/中/小三種類型,不同的模型對資源要求不同,應用的場景也不同;比如一些小模型可能會安裝到移動設備之上。

按任務類型分類

根據任務類型,大模型可以分為生成式模型,判別式模型和混合模型。

生成式模型:這種模型主要用于生成內容,包括文本,圖像,音視頻等;典型的比如GPT模型。

判別式模型:判別式模型主要應用于分類,預測等任務;如圖像分類,文本分類等;比如Bert模型。

混合模型:混合模型結合生成式和判別式模型的能力,能夠在生成內容的同時進行分類或判別任務。

當然,這個按任務分類只是進行簡單的分類,如果再細化還有更多的分類方式,比如情感分析等。

按數據模態分類

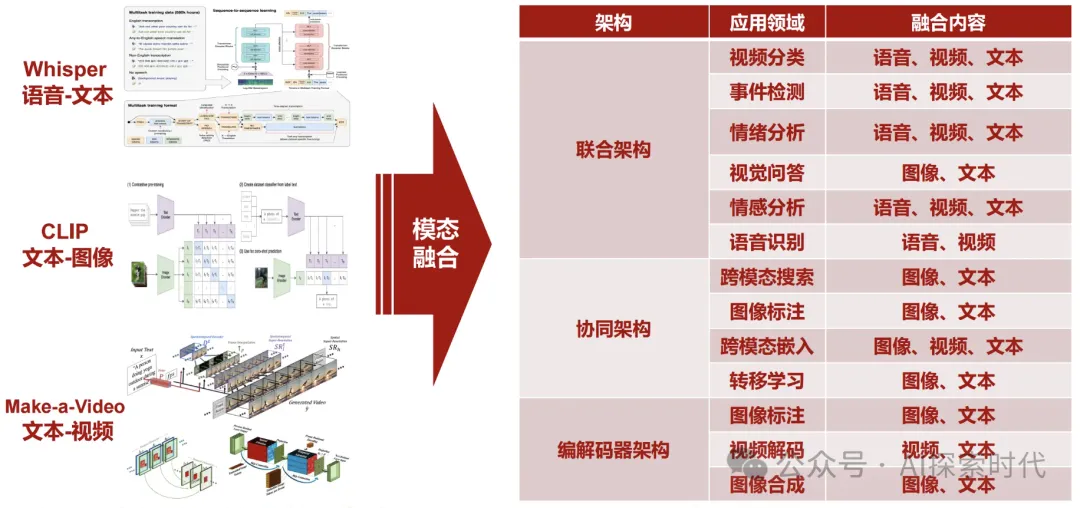

根據數據模態,大模型主要分為兩類,一類是單模態模型,一類是多模態模型。

單模態模型:單模態就是僅支持一種模態數據的模型,比如支持文本或者圖片等類型的模型;如ResNet處理圖像,BERT模型處理文本。

多模態模型:能夠同時處理多種類型的數據,如文本,圖像,音視頻等;如CLIP模型結合了文本和圖像處理的功能。

按訓練方法分類

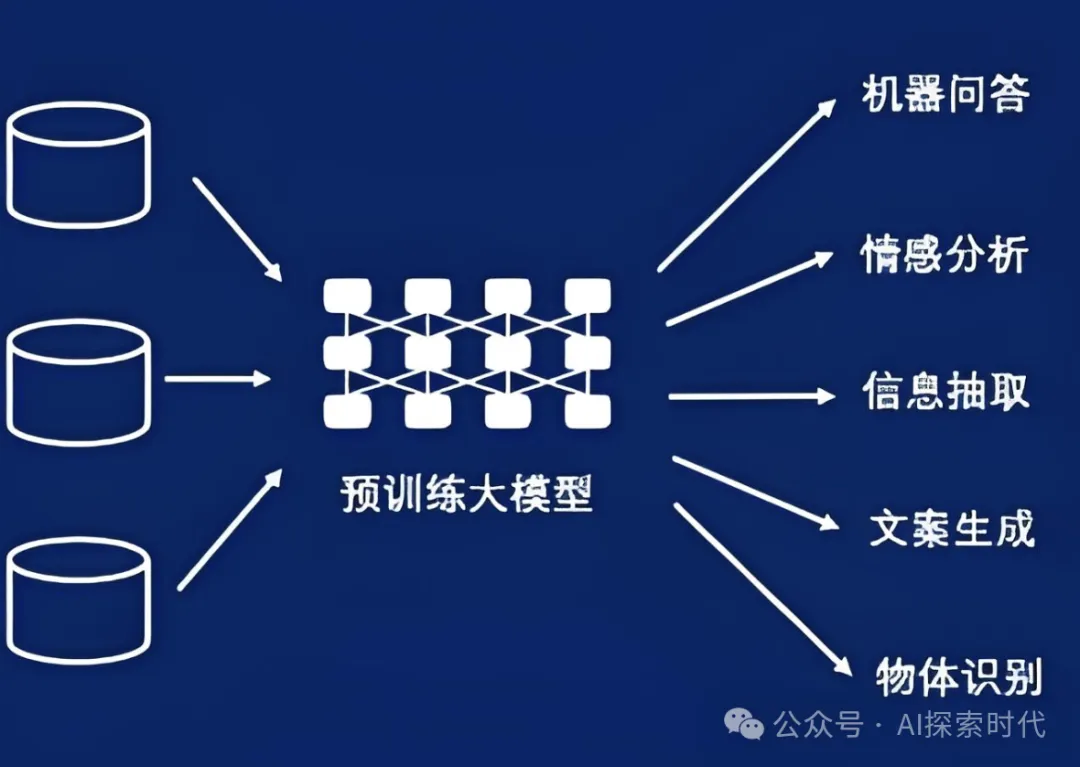

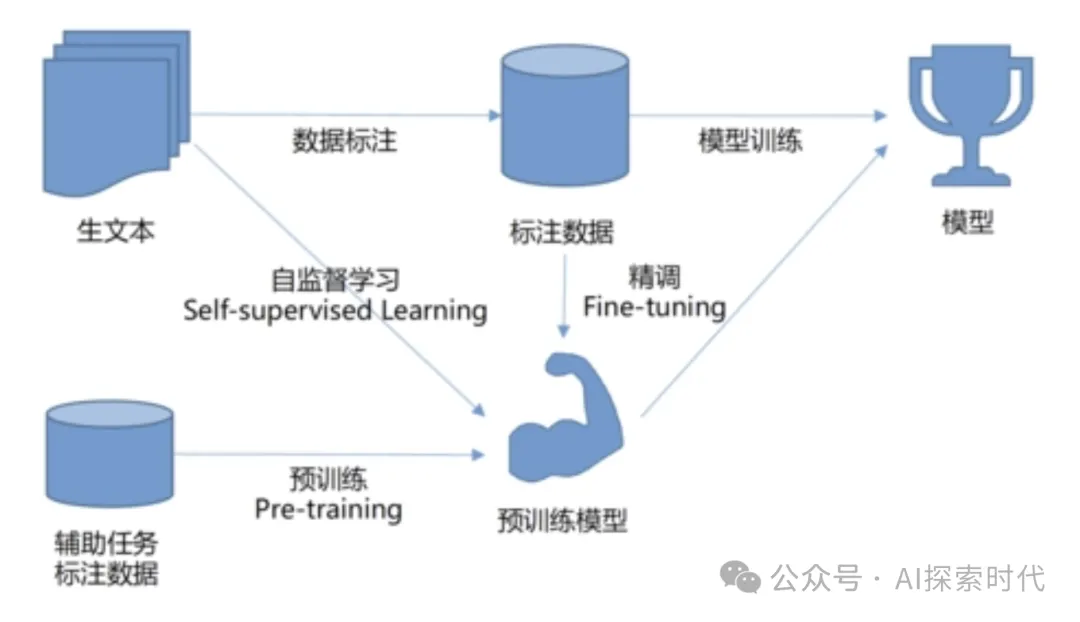

按訓練方法進行分類,主要有預訓練模型,從零訓練模型和遷移學習模型。

預訓練模型:通常在大規模數據集上進行預訓練,然后通過微調適應特定任務,如GPT,BERT等。

從零訓練模型:從頭開始訓練的模型,通常在特定任務上訓練,數據集要求較高。

遷移學習模型:遷移學習通常是指在一個任務中學習的知識遷移到另一個相關任務中;能夠減少訓練時間并提升性能。

按應用領域分類

按照應用領域分類,主要分為自然語言處理,計算機視覺模型,以及語音處理模型等。

自然語言處理模型:專門用于處理和理解人類的語言,如文本生成,翻譯,情感分析等任務。

計算機視覺模型:用于處理和理解圖像或視頻數據,如圖像分類,目標檢測,圖像生成等任務。

語音處理模型:用于處理語音信號,包括語音識別,合成,情感分析等任務。

按模型架構分類

按模型架構分類,主要分為transformer架構,卷積神經網絡和循環神經網絡以及長短期記憶網絡。

transformer架構:transformer架構應該就不用多說了,大名鼎鼎的GPT就是基于Transformer架構,廣泛應用于自然語言處理和多模態任務中。

卷積神經網絡:主要應用于計算機視覺任務中。

循環神經網絡和長短期記憶網絡:傳統上用于處理時間序列數據或語音處理任務。

當然,大模型的分類還有多種不同的形式,以上分類方式是目前比較主流的方式而已。比如說有應用于代碼開發的代碼生成模型,用于數據處理的數據分析模型等。

弄清楚模型的分類,有助于加深對模型的理解;比如說有人提到GPT,你就能知道它是一個基于Transformer架構的,能夠進行自然語言處理與生成的預訓練模型。

本文轉載自公眾號AI探索時代 作者:DFires

原文鏈接:??https://mp.weixin.qq.com/s/nver-8r0MJOc1ShByjplWg??????????