谷歌發(fā)布Imagen 3,超過(guò)SD3、DALL?E-3

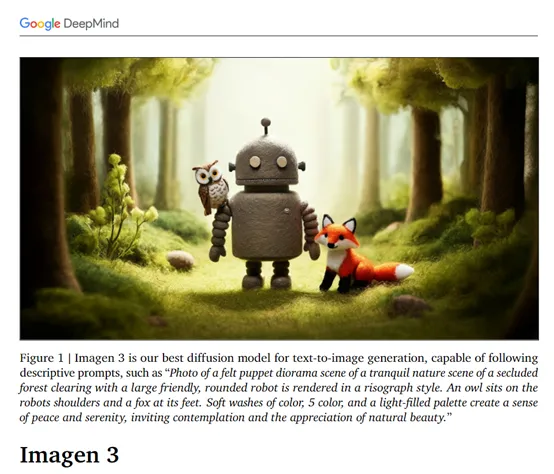

谷歌DeepMind發(fā)布了全新文生圖模型Imagen 3,在文本語(yǔ)義還原、色彩搭配、文本嵌入、圖像細(xì)節(jié)、光影效果等方面相比第二代大幅度提升。

Imagen 3的評(píng)測(cè)效果也比SD3、DALL?E-3、Midjourney等知名開(kāi)閉源模型更好。目前,Imagen 3已經(jīng)可以在美國(guó)地區(qū)使用,未來(lái)谷歌會(huì)持續(xù)擴(kuò)大使用范圍。

論文地址:https://arxiv.org/abs/2408.07009

傳統(tǒng)的擴(kuò)散模型通常從隨機(jī)噪聲開(kāi)始,然后通過(guò)一系列迭代步驟逐步恢復(fù)圖像的真實(shí)細(xì)節(jié)。但在處理高維復(fù)雜數(shù)據(jù)、圖像質(zhì)量和多樣性以及訓(xùn)練穩(wěn)定性方面有一些缺點(diǎn),同時(shí)開(kāi)發(fā)成本也比較高,而谷歌的Imagen 3使用了潛空間擴(kuò)散模型。

潛空間是指一個(gè)被壓縮的表示形式,模型可以在這個(gè)表示形式中進(jìn)行操作,而不是直接在原始圖像像素上進(jìn)行。使得Imagen 3 更容易處理高分辨率圖像,因?yàn)樗苊饬酥苯釉谙袼丶?jí)進(jìn)行復(fù)雜的計(jì)算,而是專注于學(xué)習(xí)圖像的高級(jí)特征表示。

所以,在Imagen 3模型中,數(shù)據(jù)不再是靜態(tài)的實(shí)體,而是被視為一個(gè)動(dòng)態(tài)的、隨時(shí)間演變的過(guò)程。這個(gè)過(guò)程從數(shù)據(jù)的清晰狀態(tài)開(kāi)始,逐漸向混沌狀態(tài)過(guò)渡,將數(shù)據(jù)點(diǎn)推向一個(gè)模糊不清的潛空間。然后,模型需要逆轉(zhuǎn)這一過(guò)程,從充滿噪聲的潛空間中,逐步恢復(fù)出清晰的數(shù)據(jù)圖像。

簡(jiǎn)單來(lái)說(shuō),就像一位藝術(shù)家在創(chuàng)作一幅畫(huà),首先在畫(huà)布上隨意涂抹顏料,然后逐漸勾勒出清晰的輪廓和細(xì)節(jié)。潛空間擴(kuò)散模型正是以這樣的逆過(guò)程,從混沌中尋找秩序,從噪聲中提煉出有意義的信息。

潛空間擴(kuò)散模型為Imagen 3帶來(lái)了三大顯著的技術(shù)優(yōu)勢(shì):1)極大地提升了圖像的生成質(zhì)量。傳統(tǒng)模型在生成高分辨率圖像時(shí),往往難以平衡圖像的細(xì)節(jié)和整體的一致性。而Imagen 3通過(guò)潛空間的逆向過(guò)程,能夠在保持圖像細(xì)節(jié)的同時(shí),生成高分辨率、高清晰度的圖像。

2)潛空間擴(kuò)散模型在處理復(fù)雜文本提示時(shí)表現(xiàn)出了卓越的能力。不僅能夠理解文本的基本含義,還能夠捕捉到文本中隱含的細(xì)微差別和深層含義,從而生成與文本描述高度一致的圖像。

3)潛空間擴(kuò)散模型的逆向生成過(guò)程為模型提供了更多的創(chuàng)新空間。在逆擴(kuò)散過(guò)程中,模型可以探索不同的圖像生成路徑,從而生成出更加多樣化和具有創(chuàng)新性的圖像。這種創(chuàng)新性不僅體現(xiàn)在圖像的多樣性上,還體現(xiàn)在模型能夠根據(jù)文本描述創(chuàng)造出全新的視覺(jué)內(nèi)容。

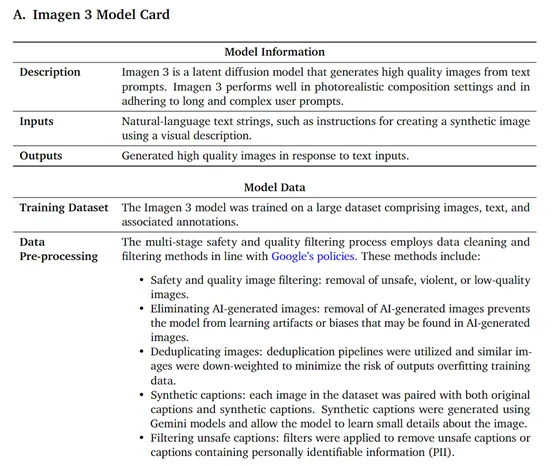

訓(xùn)練過(guò)程方面,Imagen 3在大規(guī)模且豐富的數(shù)據(jù)集上進(jìn)行了預(yù)訓(xùn)練,使得模型能夠?qū)W習(xí)到圖像內(nèi)容和文本描述之間的復(fù)雜關(guān)聯(lián)。隨后,模型通過(guò)多階段的擴(kuò)散過(guò)程,學(xué)習(xí)如何在潛空間中表示這些圖像和文本,包括學(xué)習(xí)如何將圖像和文本映射到一個(gè)共同的潛在空間,并在引入噪聲后,如何將數(shù)據(jù)點(diǎn)從清晰狀態(tài)轉(zhuǎn)變?yōu)槟:隣顟B(tài),最終在逆向過(guò)程中從噪聲中恢復(fù)出清晰的圖像。

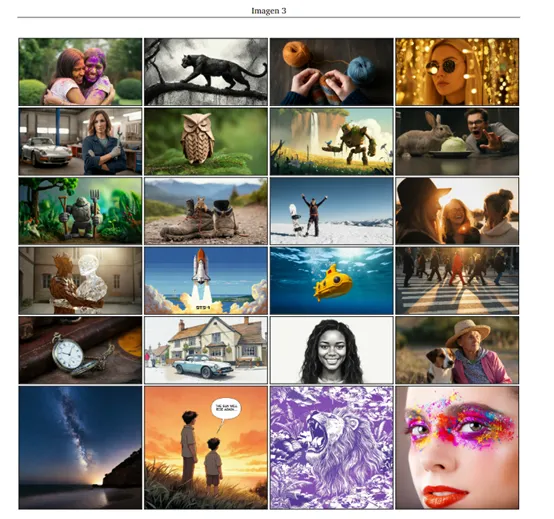

以下是Imagen 3生成的圖片欣賞。

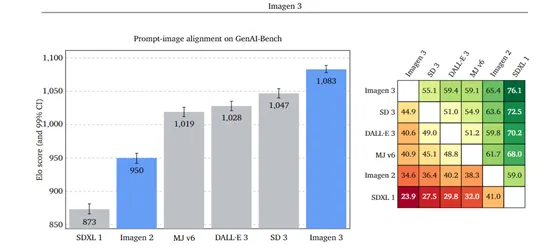

為了評(píng)估 Imagen 3 的性能,團(tuán)隊(duì)將其與其他先進(jìn)的模型進(jìn)行了對(duì)比,包括 Imagen 2、DALL?E-3、Midjourney v6、SD3和 Stable Diffusion XL 1.0。通過(guò)廣泛的人類評(píng)估和基準(zhǔn)測(cè)試評(píng)估,Imagen 3 在多個(gè)方面展現(xiàn)出了卓越的性能。

例如,在 GenAI - Bench 數(shù)據(jù)集上,Imagen 3 明顯比 DALL?E 3、Midjourney v6、SD3和SDXL 1等模型更受用戶青睞。

在提示 - 圖像對(duì)齊方面,Imagen 3 表現(xiàn)出了極強(qiáng)的能力,能夠準(zhǔn)確地將輸入的文本提示轉(zhuǎn)化為相應(yīng)的圖像內(nèi)容。與DALL?E-3等他模型相比,對(duì)提示的理解更為精準(zhǔn),生成的圖像能夠更緊密地貼合提示的意圖,無(wú)論是對(duì)于簡(jiǎn)單明了的提示,還是復(fù)雜詳細(xì)的提示,Imagen 3 都能展現(xiàn)出較強(qiáng)的理解和生成能力。

本文轉(zhuǎn)自 AIGC開(kāi)放社區(qū) ,作者:AIGC開(kāi)放社區(qū)