讓智能體像孩子一樣觀察別人學習動作,跨視角技能學習數據集EgoExoLearn來了

在探索人工智能邊界時,我們時常驚嘆于人類孩童的學習能力 —— 可以輕易地將他人的動作映射到自己的視角,進而模仿并創新。當我們追求更高階的人工智能的時候,無非是希望賦予機器這種與生俱來的天賦。

由上海人工智能實驗室,南京大學,中科院深圳先進技術研究院牽頭,聯合東京大學,復旦大學,浙江大學,中國科學技術大學等高校的學生和研究者,共同公布了跨視角技能學習數據集EgoExoLearn,為機器人賦予了通過觀察他人學習新動作的能力。

- 論文鏈接:https://arxiv.org/abs/2403.16182

- 代碼與數據集鏈接:https://github.com/OpenGVLab/EgoExoLearn

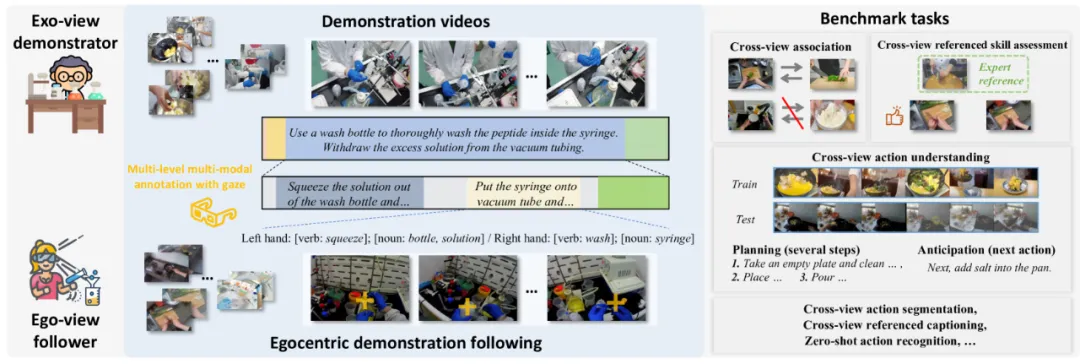

EgoExoLearn 數據集獨辟蹊徑,采集了第一視角與第三視角的視頻素材。第一視角視頻捕捉了人們學習第三視角演示動作的全過程,這種視角的轉換與融合,為機器模擬人類學習模式提供了寶貴的數據資源。

數據集的構建不僅涵蓋了日常生活的瑣碎場景,更延伸到了專業實驗室的復雜操作。EgoExoLearn 精心收錄了總計 120 小時的視角與示范視頻,旨在讓機器在多種環境下都能有效學習。

除視頻外,研究者還記錄了高質量的注視數據,并輔以詳盡的多模態標注。這些數據與標注的結合,構建了一個全面模擬人類學習過程的平臺,有助于解決機器在不同視角下對異步動作過程的建模難題。

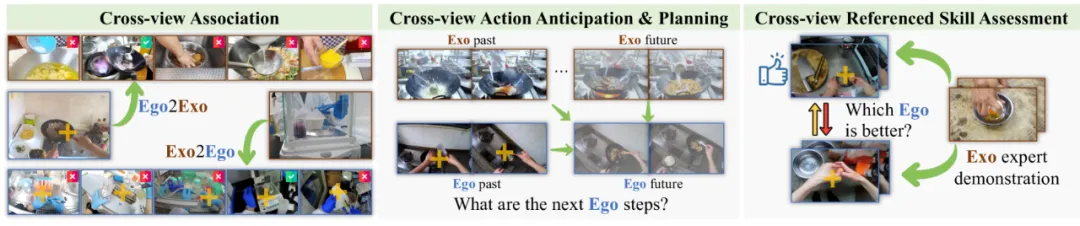

為了全面評估 EgoExoLearn 數據集的價值,研究者提出了一系列基準測試,如跨視角關聯、跨視角行動規劃及跨視角參考技能評估等,并進行了深入的分析。展望未來,EgoExoLearn 將成為跨視角行動橋接的重要基石,為機器人無縫學習真實世界中的人類行為提供堅實支撐。

期待 EgoExoLearn 數據集能助力 AI 技術的進一步突破,推動機器人從單純的模仿走向真正的智能,實現與人類社會的和諧共存與共同發展。

研究背景

從孩童時期開始,人類就具備觀察他人行為并將其映射到自己視角的能力,這種能力在進行高試錯成本的實際操作(如危險化學實驗)時尤為有益。隨著人工智能系統的最新進展,下一代 AI 智能體將會在更通用的場景中執行任務。

然而,與人類不同,訓練這些 AI 智能體通常需要在類似環境中拍攝的演示視頻作為訓練數據,這些視頻的視角還必須與 AI 智能體一致(例如,第一視角)。盡管有很多工作嘗試了在不同場景中收集此類數據,對于 AI 智能體來說,直接從不同地點和不同視角拍攝的演示視頻中學習仍然至關重要。實現這一能力可以充分利用大規模公開教學視頻數據的潛力,并且在人機合作場景中尤其是在新環境中有巨大作用。

目前朝這個目標努力的工作大致可以分為兩個方向。一種是在模擬環境中學習模型,但這些模型在現實世界中的泛化仍然很困難。另一個方向是從現實世界中的人類活動中學習。然而,直接結合現有的多視角數據集的嘗試通常會產生質量或規模較差的數據集。同時,目前這個方向的少數現有數據集只記錄了在同一環境和時間同步方式下拍攝的自我中心和外部中心視角視頻。在現實中,跟隨演示時,通常需要橋接在不同地點和不同時間執行的一系列程序性動作。目前還沒有可用于探索如何在現實的自我中心和外部中心視角中橋接異步程序性活動的數據集。

為了解決數據集缺乏問題,研究者提出了 EgoExoLearn,這是一個大規模數據集,包含演示視頻和相應的第一視角跟做視頻。其中攝像機佩戴者跟隨演示視頻中的動作,并在不同環境中執行相同任務。針對日常生活輔助和專業技能輔助這兩個潛在應用,EgoExoLearn 包含了 747 個視頻序列,總時長達 120 小時,涵蓋場景包括日常食物制作和專業實驗室實驗。值得注意的是,EgoExoLearn 中的第一視角視頻包含了顯示人類執行任務時視覺注意力的眼動信號。這為更好地連接第一視角和第三視角中的行動提供了寶貴的線索。

更進一步,研究者分析了人類的跨視角理解能力,并相應地引入了新的任務和基準,希望這些可以對開發具有類似能力的下一代具身 AI 智能體起到重要幫助。當人類執行一個動作時,他 / 她可以將自我中心視角中正在進行的動作與演示中相應的動作聯系起來并進行描述。通過演示視頻中的知識,人類可以知道所需的動作步驟,并預測下一步應該是什么。此外,通過與演示的比較,人類還可以評估自己的技能水平。

基于上述分析,研究者設計了以下新任務:1) 跨視角關聯,2) 跨視角動作理解,3) 跨視角參考技能評估,以及 4) 跨視角參考視頻字幕。每個基準都經過精心定義、標注,并具體實現了相應模型。此外,研究者還首次探索了眼動在這些任務中的作用。研究者希望這個數據集能夠為未來鏈接不同視角中的異步程序性動作的工作提供資源,從而激發設計擅長從現實世界人類演示中學習并將程序性動作映射到機器人中心視角的 AI 智能體。

數據集介紹

場景和任務

研究者考慮了程序性的目標導向任務,這些任務涵蓋了從日常的食物制作到專業的實驗室實驗。這種選擇基于它們所體現的兩個未來體現性 AI 代理需要能夠橋接自我 - 外部活動的潛在領域:日常生活輔助和專業支持。

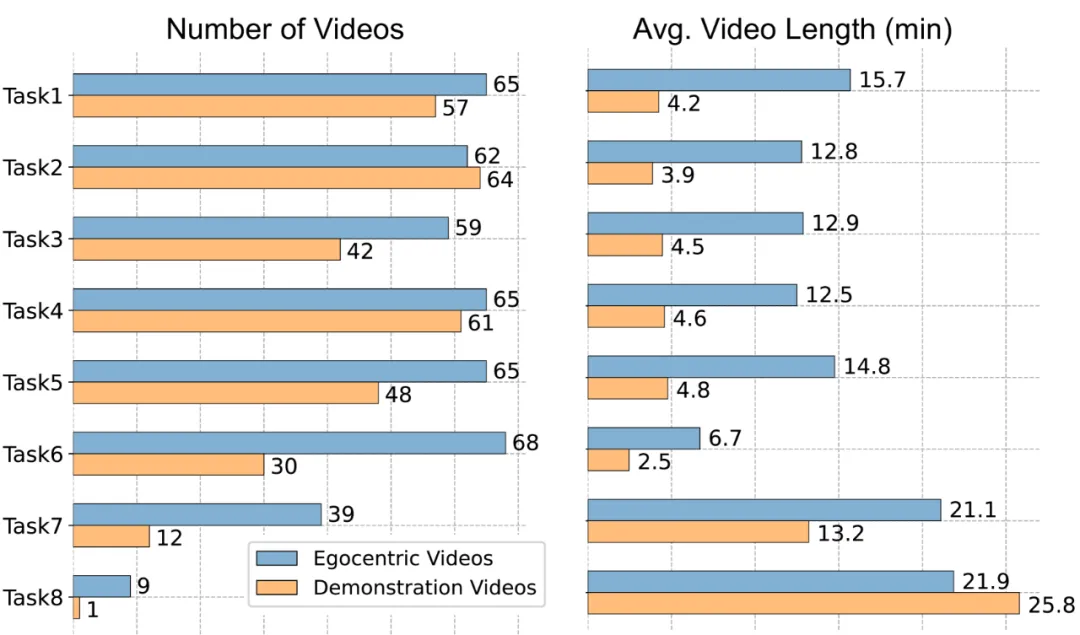

具體來說,EgoExoLearn 包含了 5 種日常任務(例如烹飪)和 3 種專業實驗室任務(例如固相肽合成)。研究者在 4 個不同的廚房和 3 個不同的實驗室中錄制了自我中心視角的視頻。下表顯示了每個任務的視頻數量以及平均視頻長度。

數據收集流程

在每次收集開始之前,參與者需要完成一份問卷,收集基本的人口統計信息以及他們自我評估的執行指定任務的專長。然后在每次錄制中,參與者將被要求從提供的列表中選擇一個或幾個外部中心視角的演示視頻,并仔細學習詳細的程序。一旦準備好了,他們將戴上 Pupil Invisible Glasses,完成眼動校準,并開始復制演示視頻中執行的任務。雖然不鼓勵,但參與者在錄制過程中被允許重新觀看演示視頻。在每次錄制之后,參與者被要求重新進行眼動校準,以確保眼動數據的準確性。對于 5 個日常任務,外部中心演示視頻是手動從 YouTube 等在線視頻平臺策劃的。對于實驗室實驗,外部中心演示視頻是由資深實驗室成員錄制的教程。

數據集標注與統計

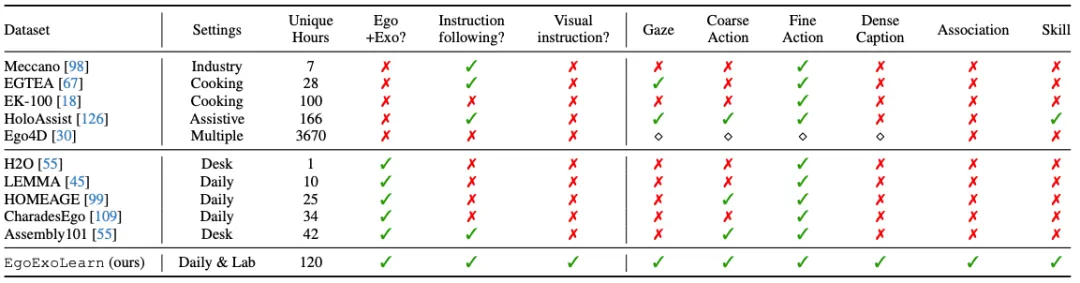

為了促進本文數據集在開發能夠有效彌合自我和外部視角之間差距的算法方面,研究者提供了詳細的多模態人類標注。粗略級別的語言標注、細致級別的語言標注、翻譯與解析、技能水平標注。據了解,目前還沒有與本文設置相同、可以直接比較的數據集。因此,研究者在下表中列舉了本文數據集的各個方面,并與相關數據集進行了比較分析。EgoExoLearn 以其「視覺演示跟隨」設置獨特地豐富了該領域。除了這一獨特設置之外,它還是第一個包括時間限定的語言字幕、標注的跨視角關聯和多標簽視頻片段的自我中心數據集。同其他第一視角視頻數據集的對比如下:

新基準 Benchmarks

為了評估連接異步的第一視角 - 第三視角程序性動作的能力,研究者引入了 4 個新的基準 benchmark,如下圖所示:

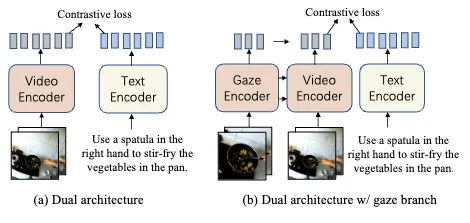

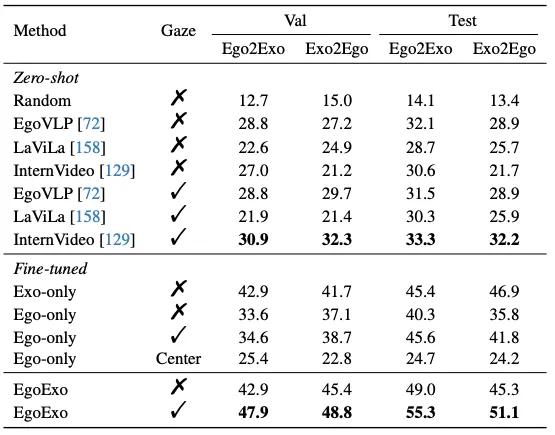

1) 跨視角關聯 (cross-view association),探究模型有沒有將不同視角的相同動作聯系起來的能力,分為 Ego2Exo 和 Exo2Ego 兩個設定。在(ego2exo)的情況下,給定一個自我中心視頻,模型需要從一組候選的外部中心樣本中預測出執行相同動作的相應外部中心視頻。這里考驗了模型對單一視角動作的理解能力,還考驗了模型在跨視角情境下的泛化能力和預測準確性。基線模型與結果如下:

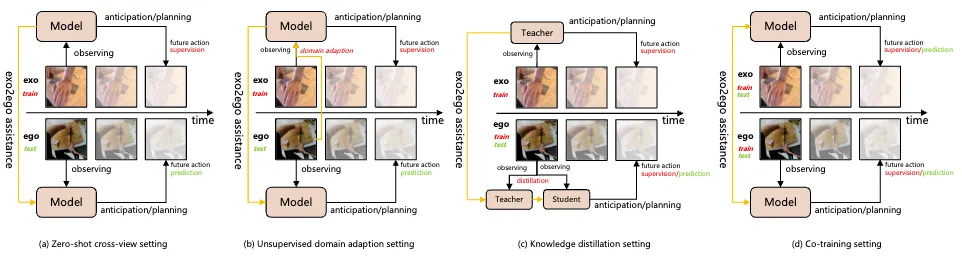

2) 跨視角動作理解 (cross-view action understanding),細分為三個子任務:跨視角動作預測、跨視角動作規劃和跨視角動作分割。此外,研究者還探索了注視點(gaze)在協助這些任務中的作用。下圖是四種訓練設定與基線模型性能:

3) 跨視角參考技能評估 (cross-view referenced skill assessment) 主要目標是評估第一視角操作者的技能水準。研究者引入了第三視角的專家操作視頻作為參考,通過與參考視頻的對比,技能評估可以變得更加準確。基線模型與結果如下圖所示:

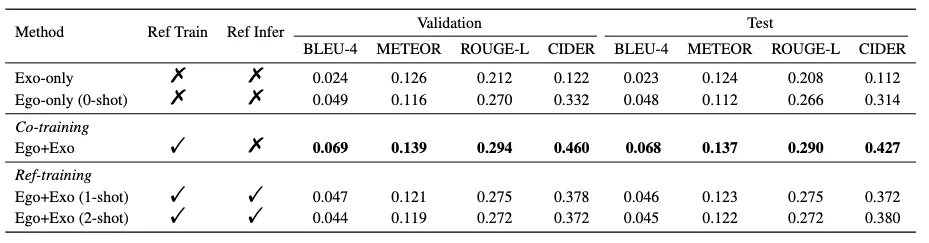

4) 跨視角參考視頻描述 (cross-view referenced captioning)。使用另一個視角的視頻作為參考,此項任務旨在提高模型利用跨視角參考而更好的進行視頻描述的能力。模型設計和基線性能如下:

結論

對于下一代具身智能在現實世界中執行復雜任務而言,能夠連接第一和第三視角中的異步程序性動作的能力是必不可少的。作為一個基礎步驟,EgoExoLearn 包含了豐富的第一視角視頻,其中每個視頻都是在跟隨第三視角演示視頻的程序時拍攝的。這種現實的設置,結合多模態人工高質量標注,能夠構建 4 個新穎的基準測試。而這些基準作為一個多功能的平臺,可以被用于研究如何橋接跨視角的異步活動。EgoExoLearn 還可以促進新的研究方向,例如如何更好地利用注視和與手相關的標注。基準測試的結果表明,當前模型在連接第一和第三視角的異步活動方面尚有不足,未來還有顯著的改進空間。

本文轉自 機器之心 ,作者:機器之心