一文搞懂AI大模型的四個核心技術

在日新月異的生成式AI領域,幾個核心的專業術語不僅頻繁出現在討論、報告和會議中,更是技術發展的關鍵驅動力。它們分別是:“Prompt Engineering(提示工程)”、“Function Calling(函數調用)”、“RAG(檢索增強生成)”和“Fine-tuning(微調)。

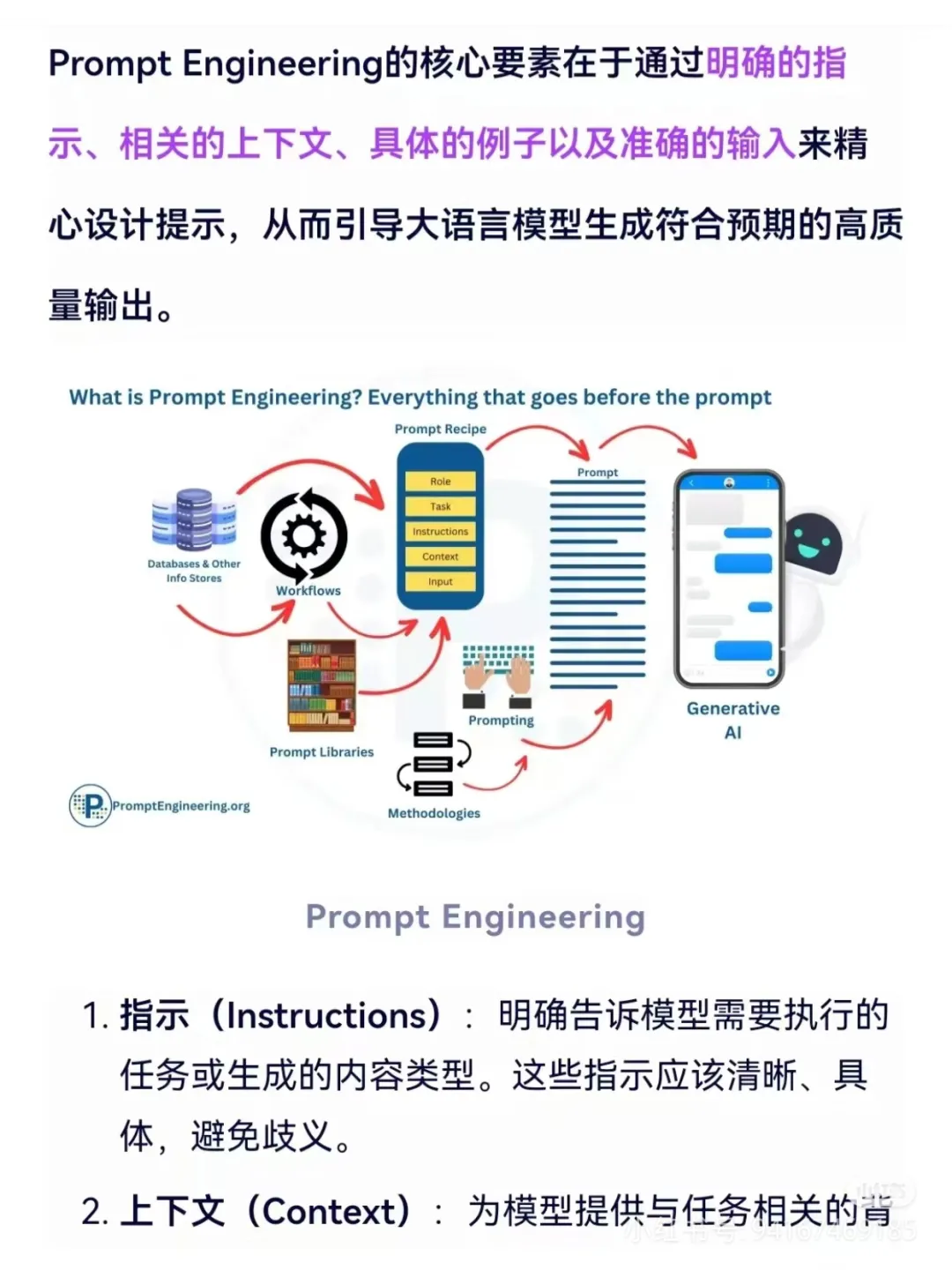

? Prompt Engineering(提示工程):

提示工程是一種技術,通過設計、實驗和優化輸入提示詞(Prompt)來引導預訓練語言模型生成所需響應或完成特定任務。它的核心在于通過精確的提示詞,明確告訴模型需要執行的任務、提供的背景信息、期望的輸出格式等,從而引導模型生成高質量、準確的輸出。

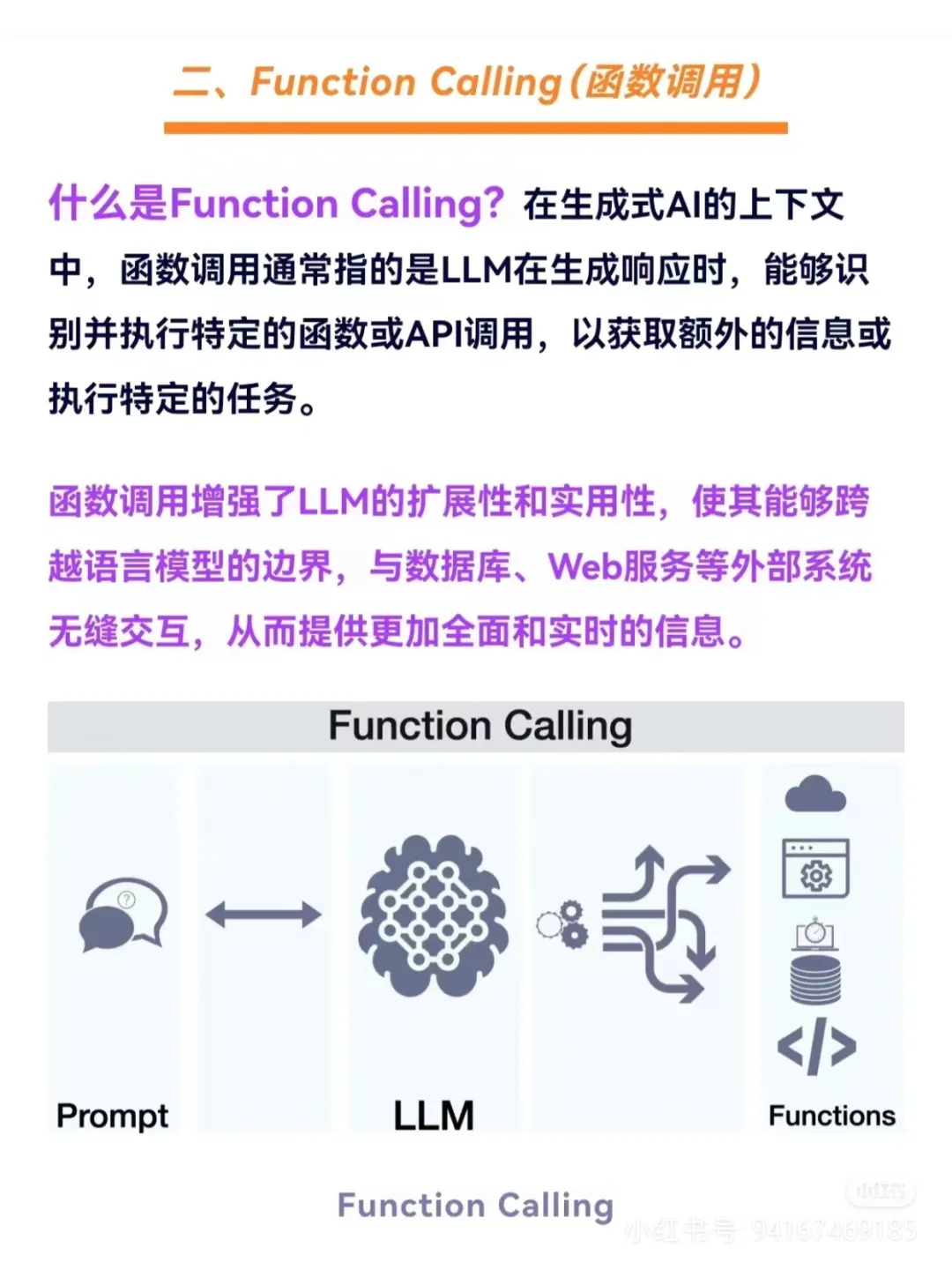

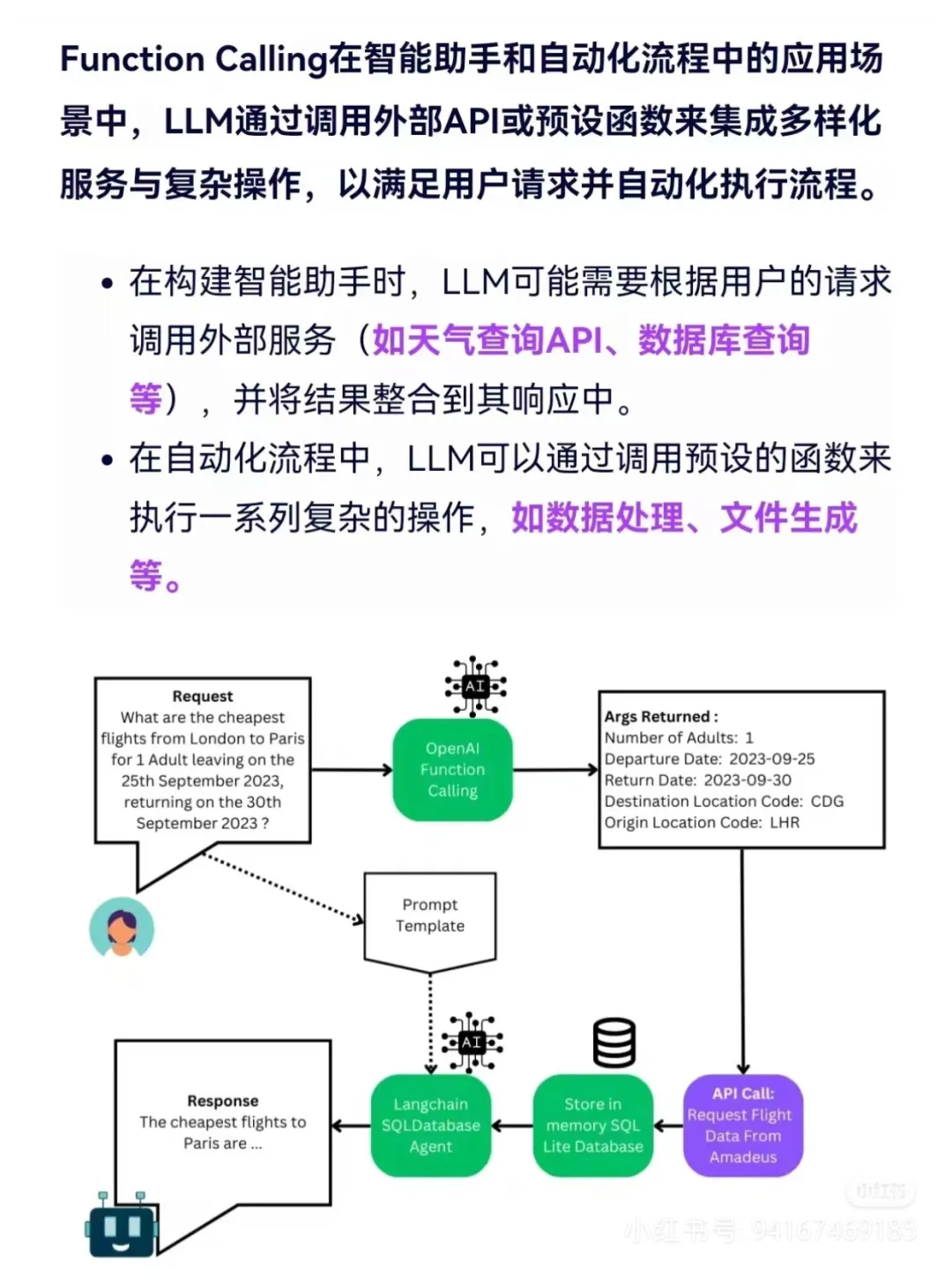

? Function Calling(函數調用):

函數調用是一種能力,允許大型語言模型在生成文本的過程中調用外部函數或服務。它涉及將用戶的自然語言請求轉換為可執行的函數調用,并生成符合預定義函數簽名的結構化輸出,如JSON對象。函數調用使您能夠更可靠地從模型中獲取結構化數據。

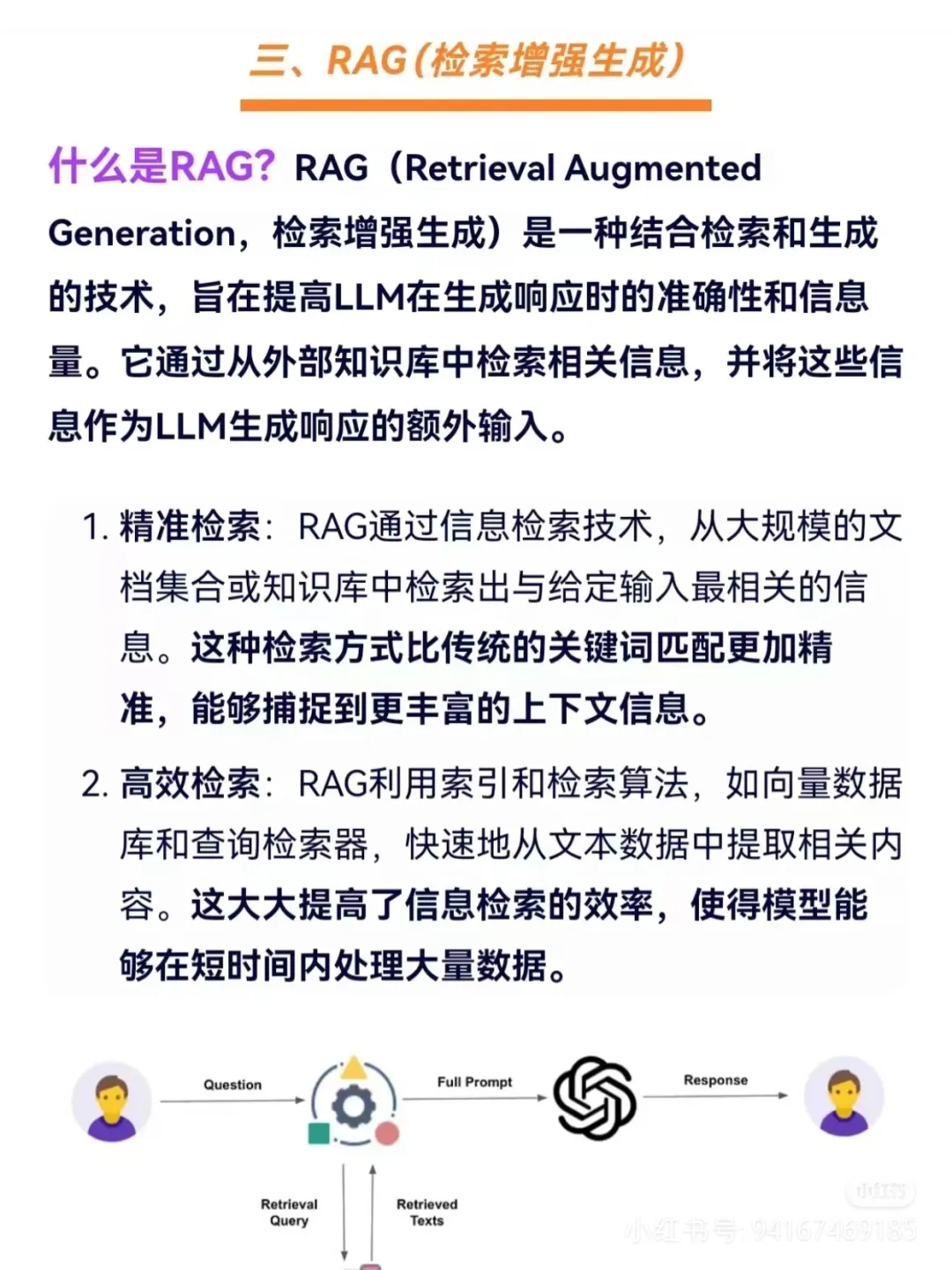

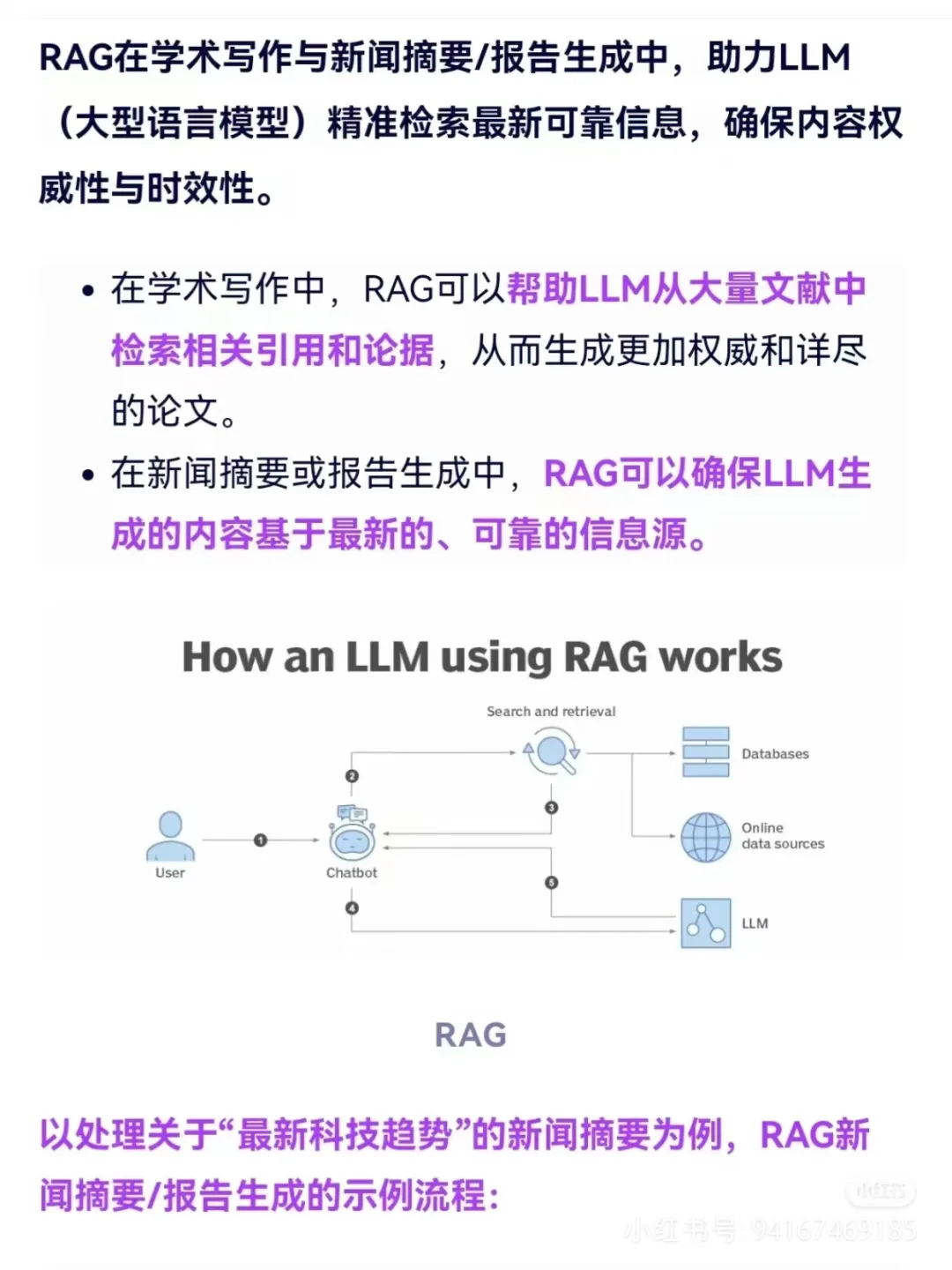

? RAG(檢索增強生成):

檢索增強生成(Retrieval Augmented Generation)為大語言模型提供了從數據源檢索信息的能力,并以此為基礎生成回答。RAG 結合了信息檢索技術和大語言模型的提示功能,即模型根據搜索算法找到的信息作為上下文來查詢回答問題。它主要包含數據準備階段和檢索生成階段,涉及數據提取、分塊、向量化、數據入庫等環節。

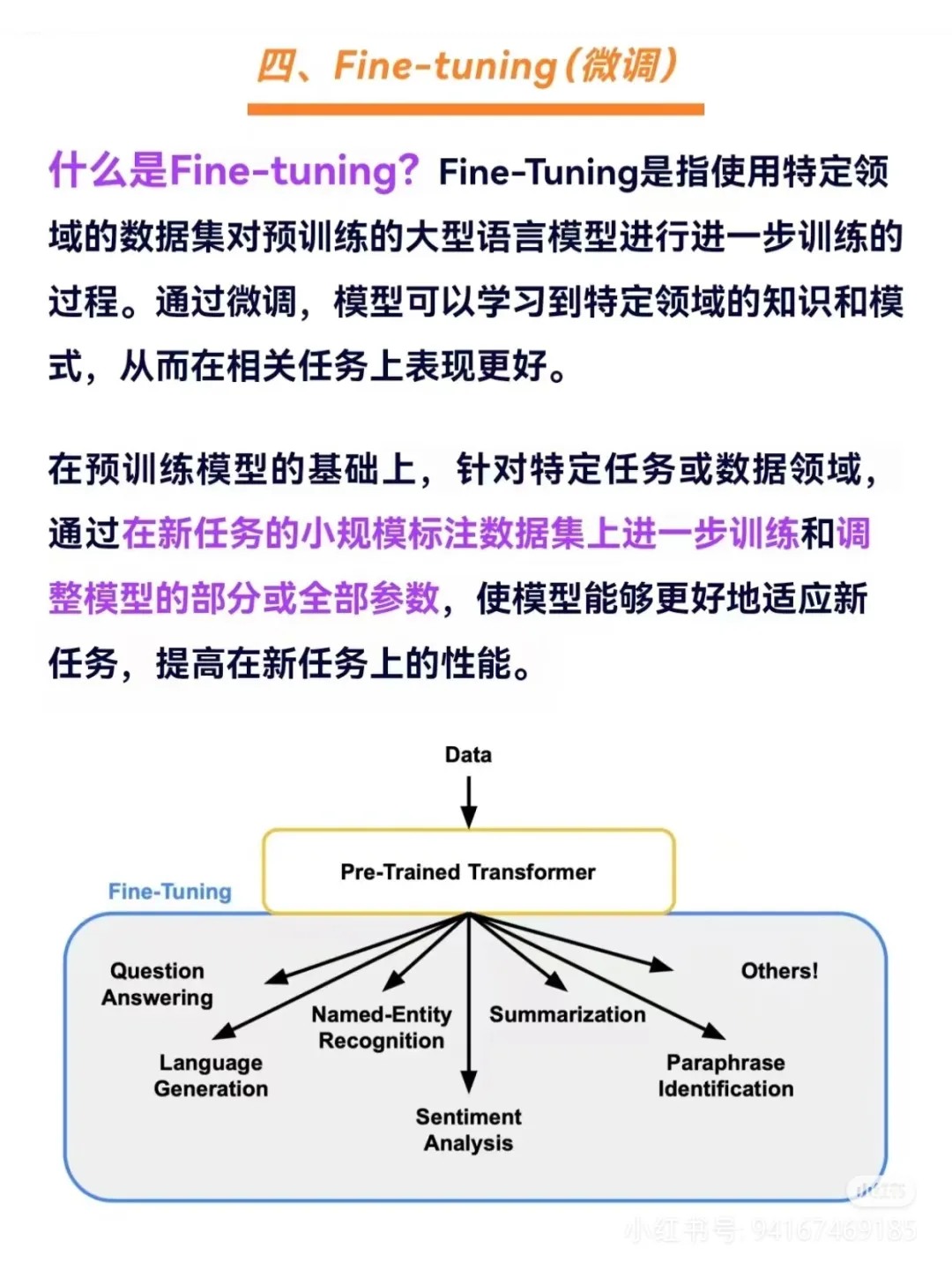

? Fine-tuning(微調):

微調是模型適應特定任務的關鍵步驟,它可以通過不同的方式進行,如Prefix Tuning、Prompt Tuning、P-Tuning、P-Tuning v2、Adapter Tuning和LoRA等。微調通過在預訓練模型的基礎上,進一步調整模型參數以適應特定的任務或數據集,提高模型在特定任務上的表現。

這些技術都是大模型開發中的重要概念,各自有不同的應用場景和優勢。下面分享一個圖文筆記整理的材料,便于大家學習和理解。

本文轉載自公眾號數字化助推器 作者:天涯咫尺TGH