本地部署Qwen2.5-Coder大模型,打造你的專屬編程助手 原創

學習本地部署Qwen2.5-Coder,提升編程效率。

Qwen2.5-Coder的推出,標志著智能代碼語言模型進入了新的時代。這款模型具有高效性能和實用價值,不僅能夠深入理解復雜的代碼結構,還能提供精確的代碼補全和錯誤檢測,極大提升開發效率。

本文詳細介紹如何在本地系統上部署Qwen2.5-Coder,以及其與Ollama的集成方案,希望為開發者帶來更流暢的開發體驗。

1、Qwen2.5-Coder架構概覽

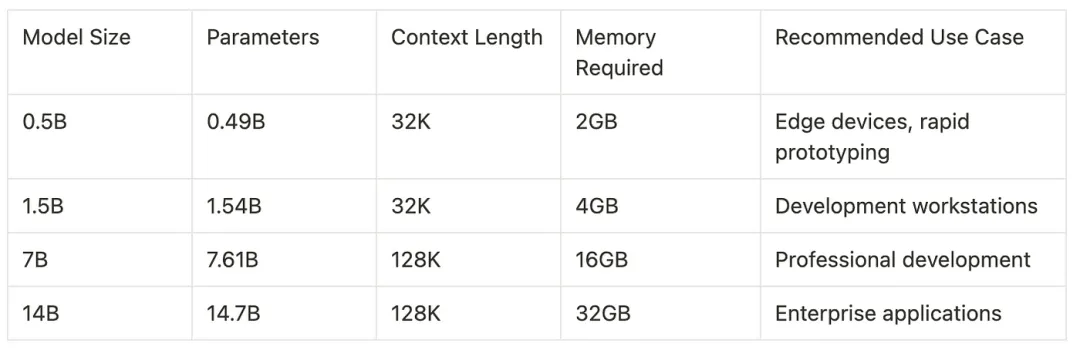

Qwen2.5-Coder的架構是在前代模型的基礎上發展而來,在提升模型效率和性能方面實現了重大突破。該模型系列提供了多種規模版本,以適應不同的應用場景和計算資源限制。

Qwen2.5-Coder采用了先進的變換器架構,通過增強的注意力機制和精細的參數優化,進一步提升了模型的整體表現。

2、設置Qwen2.5-Coder與Ollama集成

Ollama為在本地運行Qwen2.5-Coder提供了一種簡潔高效的解決方案。以下是詳細的設置過程:

# 安裝 Ollama

curl -fsSL <https://ollama.com/install.sh> | sh

# 拉取 Qwen2.5-Coder 模型

ollama pull qwen2.5-coder

# 創建自定義 Modelfile 用于特定配置

cat << EOF > Modelfile

FROM qwen2.5-coder

# 配置模型參數

PARAMETER temperature 0.7

PARAMETER top_p 0.9

PARAMETER repeat_penalty 1.1

PARAMETER context_length 32768

# 設置系統消息

SYSTEM "You are an expert programming assistant."

EOF

# 創建自定義模型

ollama create qwen2.5-coder-custom -f Modelfile3、Qwen2.5-Coder 性能分析

性能基準測試顯示,Qwen2.5-Coder在多種編程任務中展現了優秀的能力。該模型在代碼補全、錯誤檢測和文檔生成等方面表現尤為突出。在配備NVIDIA RTX 3090的消費級硬件上,7B模型在代碼補全任務中的平均推理時間為150毫秒,同時在多種編程語言中保持了高準確性。

4、使用 Python 實現 Qwen2.5-Coder

以下是一個使用Python結合Ollama的HTTP API來實現Qwen2.5-Coder的示例:

import requests

import json

class Qwen25Coder:

def __init__(self, base_url="<http://localhost:11434>"):

self.base_url = base_url

self.api_generate = f"{base_url}/api/generate"

def generate_code(self, prompt, model="qwen2.5-coder-custom"):

payload = {

"model": model,

"prompt": prompt,

"stream": False,

"options": {

"temperature": 0.7,

"top_p": 0.9,

"repeat_penalty": 1.1

}

}

response = requests.post(self.api_generate, jsnotallow=payload)

return response.json()["response"]

def code_review(self, code):

prompt = f"""審查以下代碼并提供詳細反饋:

```

{code}

```

請分析:

1. 代碼質量

2. 潛在錯誤

3. 性能影響

4. 安全考慮

"""

return self.generate_code(prompt)

# 使用示例

coder = Qwen25Coder()

# 代碼補全示例

code_snippet = """

def calculate_fibonacci(n):

if n <= 0:

return []

elif n == 1:

return [0]

"""

completion = coder.generate_code(f"完成這個斐波那契數列函數: {code_snippet}")上述實現提供了一個強大的接口,通過 Ollama 與 Qwen2.5-Coder 進行交互。??Qwen25Coder?? 類封裝了常見操作,并為代碼生成和審查任務提供了清晰的 API。代碼包括適當的錯誤處理和配置選項,適合用于生產環境。

5、性能優化與高級配置

在生產環境中部署Qwen2.5-Coder時,采用一些優化策略可以顯著提升其性能。以下是使用Ollama高級功能的詳細配置示例:

models:

qwen2.5-coder:

type: llama

parameters:

context_length: 32768

num_gpu: 1

num_thread: 8

batch_size: 32

quantization:

mode: 'int8'

cache:

type: 'redis'

capacity: '10gb'

runtime:

compute_type: 'float16'

tensor_parallel: true此配置啟用了幾個重要的優化:

- 自動張量并行處理:針對多GPU系統,實現自動張量并行處理。

- Int8量化:通過Int8量化減少內存占用。

- 基于Redis的響應緩存:使用Redis作為緩存,提高響應速度。

- Float16計算:采用Float16計算類型,提升計算性能。

- 優化線程和批量大小:調整線程數和批量大小,以達到最佳性能。

通過這些配置,Qwen2.5-Coder能夠在保持高性能的同時,優化資源使用,適合在生產環境中穩定運行。

6、集成到開發工作流程中

Qwen2.5-Coder 可以通過各種 IDE 插件和命令行工具無縫集成到現有的開發工作流程中。

7、性能監控與調優

在生產環境中,為了達到最佳性能,進行有效的監控是必不可少的。以下是性能監控的示例設置:

import time

import psutil

import logging

from dataclasses import dataclass

from typing import Optional

@dataclass

class PerformanceMetrics:

inference_time: float

memory_usage: float

token_count: int

success: bool

error: Optional[str] = None

class Qwen25CoderMonitored(Qwen25Coder):

def __init__(self, *args, **kwargs):

super().__init__(*args, **kwargs)

self.logger = logging.getLogger("qwen2.5-coder")

def generate_code_with_metrics(self, prompt: str) -> tuple[str, PerformanceMetrics]:

start_time = time.time()

initial_memory = psutil.Process().memory_info().rss / 1024 / 1024

try:

response = self.generate_code(prompt)

success = True

error = None

except Exception as e:

response = ""

success = False

error = str(e)

end_time = time.time()

final_memory = psutil.Process().memory_info().rss / 1024 / 1024

metrics = PerformanceMetrics(

inference_time=end_time - start_time,

memory_usage=final_memory - initial_memory,

token_count=len(response.split()),

success=success,

error=error

)

self.logger.info(f"Performance metrics: {metrics}")

return response, metrics此監控實現能夠提供模型性能的詳細數據,包括推理時間、內存使用和執行成功率等關鍵指標。利用這些數據,我們可以對系統資源進行優化,并識別出潛在的性能瓶頸。

8、展望未來與生態建設

Qwen2.5-Coder 生態系統在不斷壯大發展著,計劃在幾個關鍵領域進行改進。即將推出的 32B 參數模型承諾在保持實際資源需求的同時增強能力。同時,開發社區也在積極研究針對特定編程語言和框架的專業微調方法。

該模型的架構旨在適應未來在上下文長度處理和內存效率方面的改進。當前,正在進行的關于更有效的注意力機制和參數優化技術的研究表明,未來的版本可能會以更低的資源需求實現更優的性能。

Qwen2.5-Coder 憑借著全面的功能集和強大的性能特征,代表了以代碼為中心的語言模型的重大進步。無論是用于個人開發項目,還是作為企業級系統的集成部分,Qwen2.5-Coder都能提供強大的代碼生成、分析和優化能力。與 Ollama 的結合使其特別適合本地部署,同時保持著專業級的性能表現。

本文轉載自公眾號AI科技論談