淺看大模型用于Text2SQL的綜述 原創(chuàng)

前言

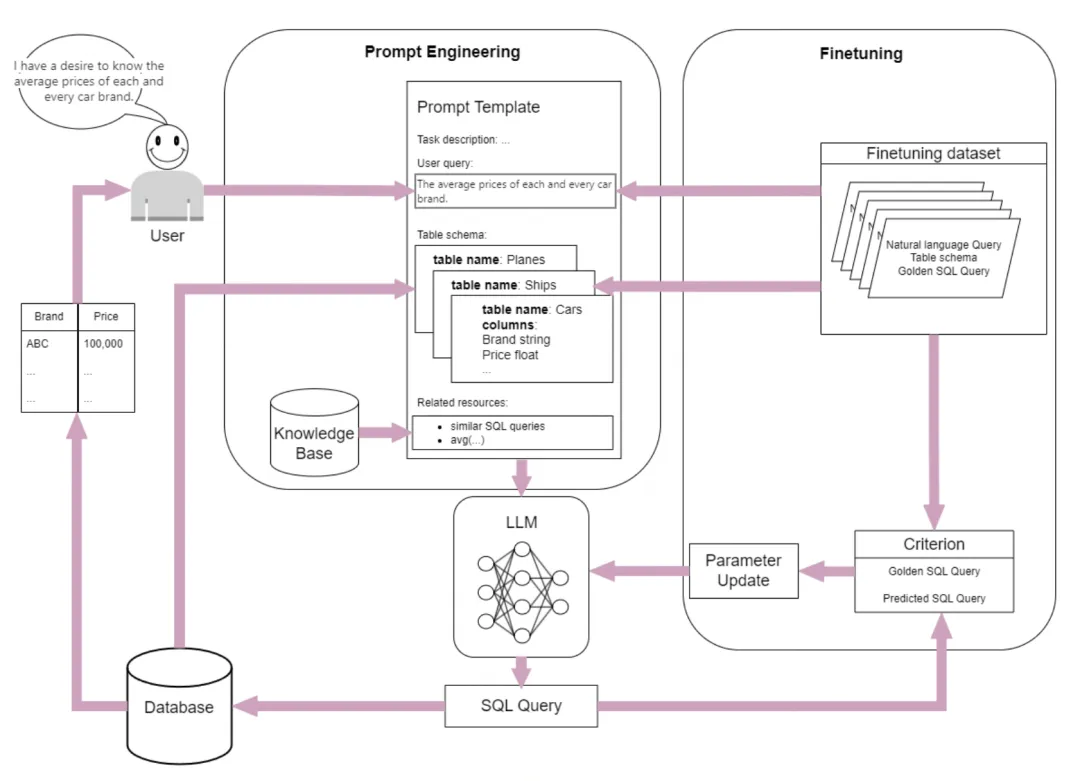

我們來看看大模型在text2sql上的一篇綜述,大模型的發(fā)展,出現(xiàn)了一系列新方法,主要集中在提示工程(prompt engineering)和微調(diào)(fine-tuning)上。這篇綜述提供了LLMs在Text-to-SQL任務(wù)中的全面概述,討論了基準(zhǔn)數(shù)據(jù)集、提示工程、微調(diào)方法和未來的研究方向。

Text2SQL

利用大型語言模型(LLMs)解決文本到SQL任務(wù)的方法,主要包括提示工程和微調(diào)兩大類。

1.提示工程

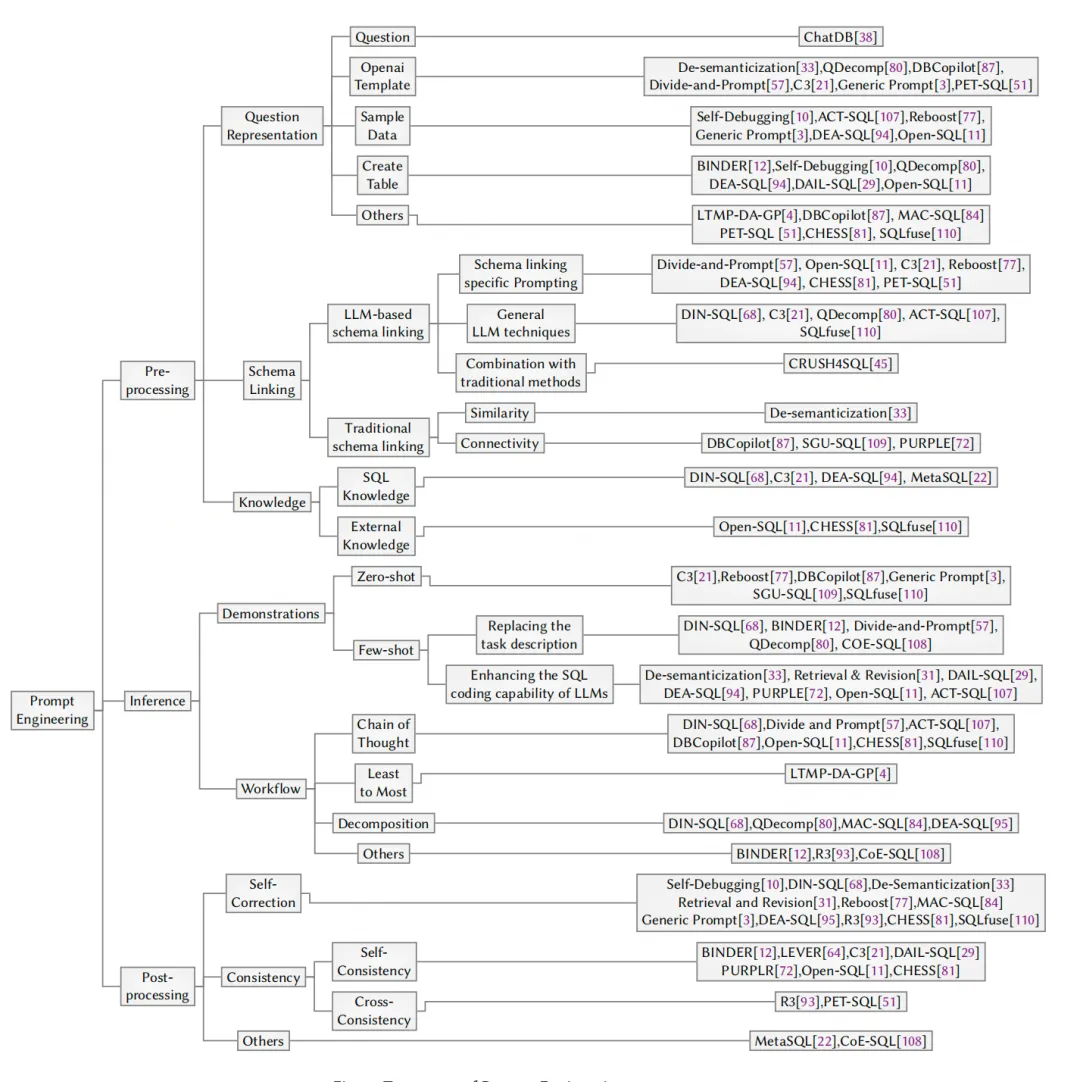

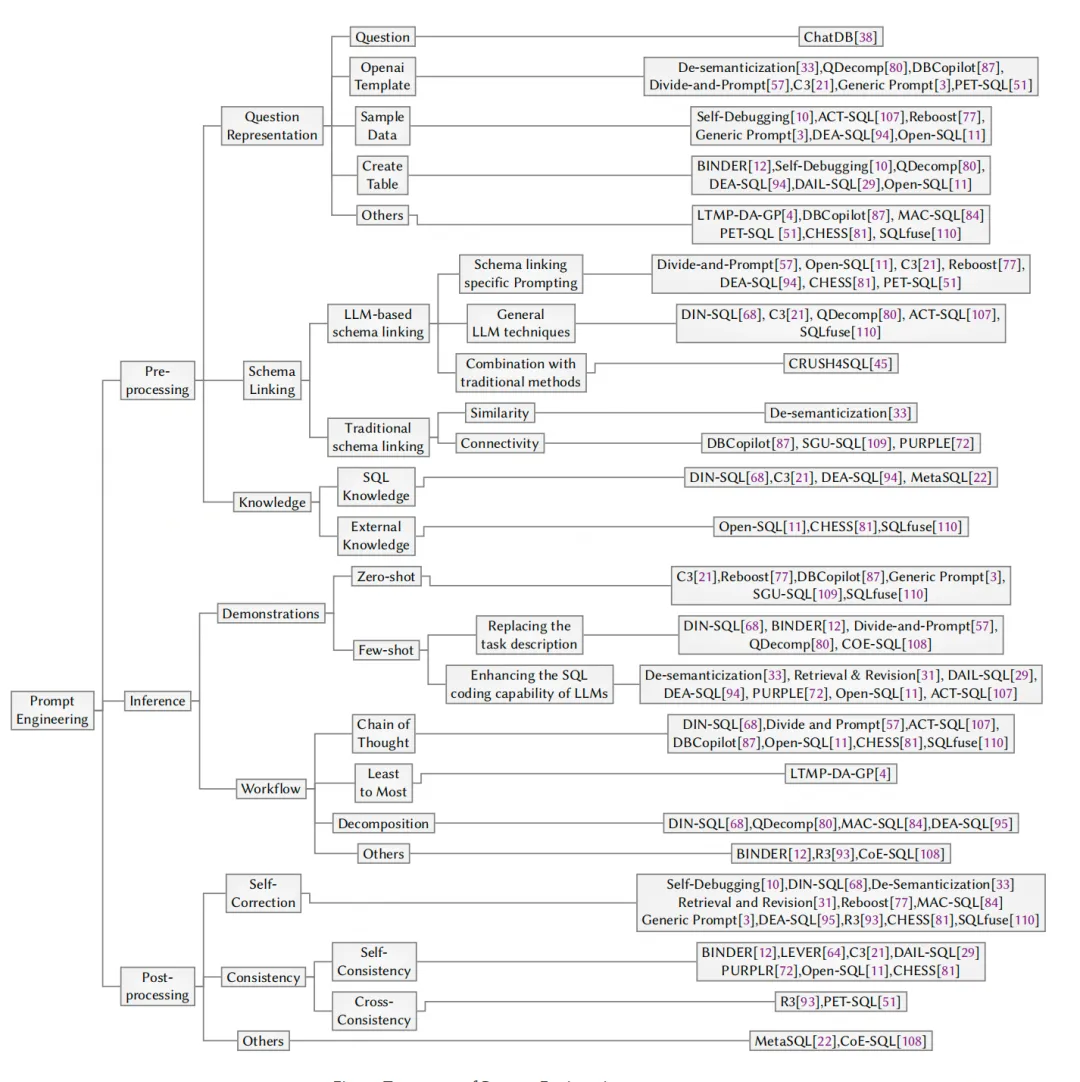

提示工程通過設(shè)計(jì)結(jié)構(gòu)化的提示,使LLMs能夠理解任務(wù)需求并生成相應(yīng)的SQL查詢。提示工程分為三個(gè)階段:預(yù)處理、推理和后處理。

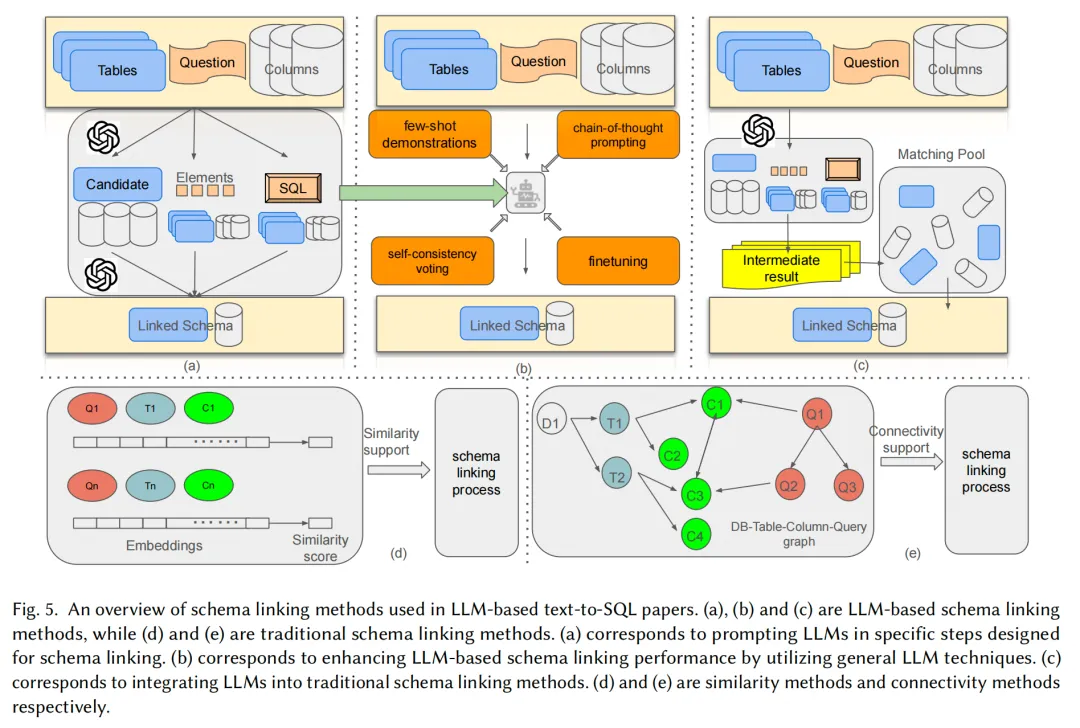

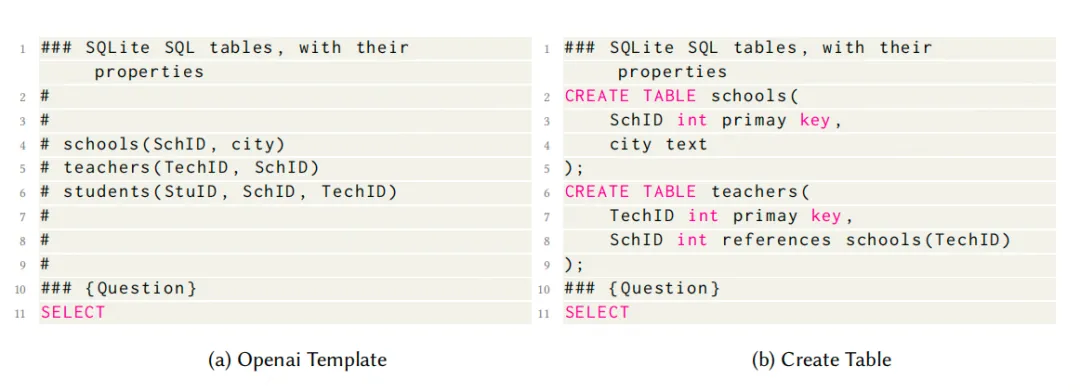

- 預(yù)處理:包括問題描述和數(shù)據(jù)庫模式的格式化和布局,以及引入額外的SQL知識或外部知識。問題描述可以采用Openai模板或"Create Table"布局,樣本數(shù)據(jù)可以幫助LLM更好地理解數(shù)據(jù)庫內(nèi)容。

- 推理:在接收到用戶問題和數(shù)據(jù)庫模式后,生成相應(yīng)的SQL查詢。推理過程可以設(shè)計(jì)特定的工作流,如Chain-of-Thought和Least-to-Most方法,也可以使用Demonstrations來增強(qiáng)SQL生成能力。

- 后處理:對生成的SQL進(jìn)行優(yōu)化,提高其性能和穩(wěn)定性。常見的后處理方法包括自校正(Self-Correction)和一致性方法(Self-Consistency和Cross-Consistency)。

2.微調(diào)

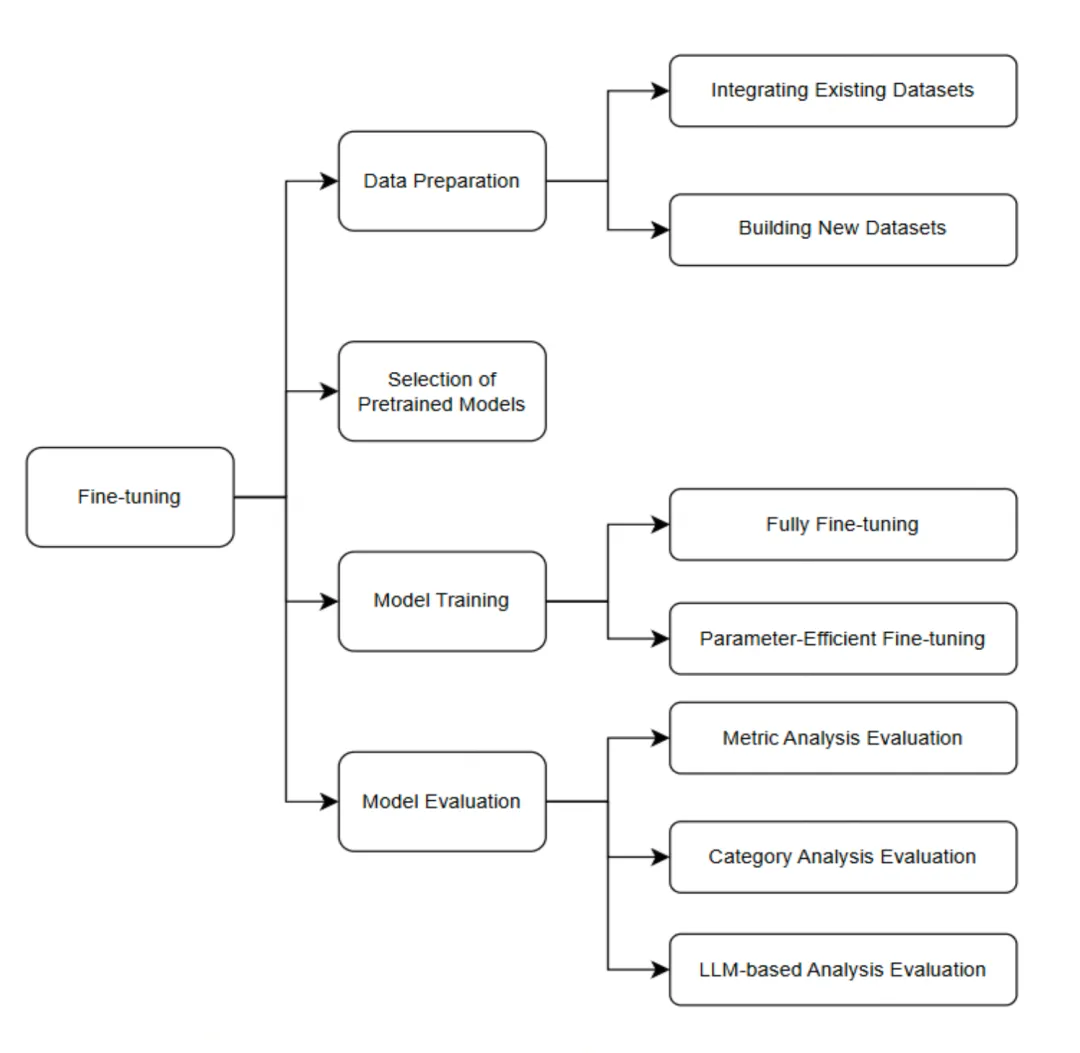

微調(diào)通過在特定任務(wù)數(shù)據(jù)上訓(xùn)練LLMs來提升其性能。微調(diào)過程包括數(shù)據(jù)準(zhǔn)備、預(yù)訓(xùn)練模型選擇、模型微調(diào)和模型評估。

- 數(shù)據(jù):可以通過整合現(xiàn)有數(shù)據(jù)集或構(gòu)建新數(shù)據(jù)集來獲取訓(xùn)練數(shù)據(jù)。新數(shù)據(jù)集可以通過半自動(dòng)或全自動(dòng)的方法生成。

- 預(yù)訓(xùn)練模型選擇:選擇適合的預(yù)訓(xùn)練模型進(jìn)行微調(diào),考慮模型參數(shù)規(guī)模、預(yù)訓(xùn)練語料庫和計(jì)算能力等因素。

- 模型微調(diào):采用全量微調(diào)和參數(shù)高效微調(diào)等方法。參數(shù)高效微調(diào)通過僅微調(diào)少量模型參數(shù)來提高訓(xùn)練效率。

- 模型評估:通過綜合指標(biāo)分析、分類分析和基于LLM的分析評估來衡量模型性能。常用的評估指標(biāo)包括精確集匹配準(zhǔn)確率(EM)、執(zhí)行準(zhǔn)確率(EX)、測試集準(zhǔn)確率(TS)和有效效率得分(VES)。

參考文獻(xiàn)

A Survey on Employing Large Language Models for Text-to-SQL Tasks,https://arxiv.org/pdf/2407.15186v3

本文轉(zhuǎn)載自公眾號大模型自然語言處理 作者:余俊暉

?著作權(quán)歸作者所有,如需轉(zhuǎn)載,請注明出處,否則將追究法律責(zé)任

已于2024-12-6 09:54:51修改

贊

收藏

回復(fù)

分享

微博

QQ

微信

舉報(bào)

回復(fù)

相關(guān)推薦