TinyR1-32B-Preview: 通過全新分支合并蒸餾技術讓大模型瘦身不掉智商

圖片

圖片

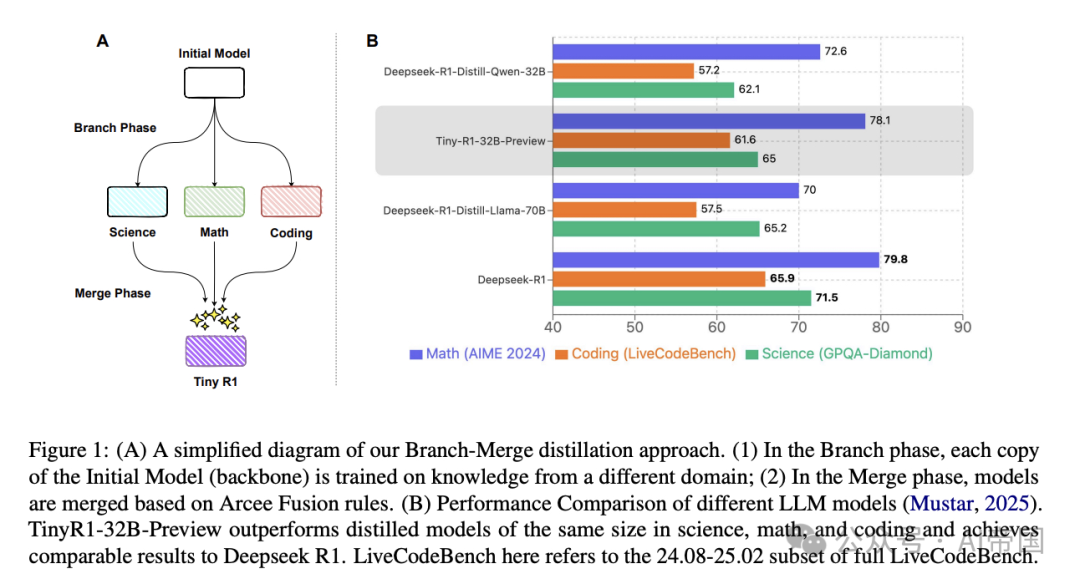

圖1:(A) 我們的分支合并蒸餾方法的簡化圖解。(1) 在分支階段,初始模型(骨干網絡)的每個副本都在不同領域的知識上進行訓練;(2) 在合并階段,模型基于Arcee Fusion規則進行合并。(B) 不同LLM模型的性能比較(Mustar, 2025)。TinyR1-32B-Preview在科學、數學和編程領域的表現優于同等規模的蒸餾模型,并達到了與Deepseek R1相當的結果。這里的LiveCodeBench指的是完整LiveCodeBench的24.08-25.02子集。

你是否好奇:為什么大語言模型一定要那么"大"?能不能讓它們變得更"小"卻依然聰明?今天,我為大家帶來一項突破性的研究成果——TinyR1-32B-Preview模型,它通過創新的"分支合并蒸餾"(Branch-Merge Distillation)技術,用僅有671B參數5%的規模,實現了接近DeepSeek-R1旗艦模型的推理能力。這可能意味著,未來我們每個人都能在自己的設備上運行強大的AI模型!

1、傳統蒸餾方法的困境:小模型為何難以保持高精度?

傳統的模型蒸餾技術雖然能讓大模型"瘦身",但往往陷入一個兩難困境:

(1)數據選擇難題:需要精心挑選最相關的領域數據并調整它們的比例進行聯合訓練,這個過程耗時且容易出錯

(2)梯度沖突問題:同時優化多個領域會導致任務之間相互干擾,阻礙整體學習進度

(3)性能天花板:傳統方法蒸餾出的小模型難以達到專業任務所需的性能水平

這些問題嚴重制約了傳統數據混合蒸餾的效果,導致小模型無法實現理想的性能水平。

2、分支合并蒸餾:創新性的兩階段知識傳遞

為解決上述問題,研究團隊提出了全新的分支合并蒸餾方法,它包含兩個關鍵階段:

(1)分支階段(Branch Phase): 將知識從統一的大型教師模型(如DeepSeek-R1 671B)選擇性地蒸餾到幾個專門的學生模型中。具體來說,團隊構建了三個專業數據集:

1)數學領域:從NuminaMath1.5篩選出58K個樣本,并配合OpenR1的解決方案

2)編程領域:從OpenThoughts數據集過濾形成20K個編碼解決方案軌跡

3)科學領域:利用DeepSeek-R1生成8.6K個科學問題的思維鏈軌跡

然后,他們基于DeepSeek-R1-Distill-Qwen-32B模型,對這三個領域分別進行監督微調(SFT),得到了三個專業領域的專家模型。

(2)合并階段(Merge Phase): 通過Arcee Fusion技術將不同領域的專家模型合并成一個統一模型。這種合并不是簡單的參數平均,而是通過三個精細步驟進行:

1)重要性評分:計算每個參數的重要性

2)動態選擇:確定參數更新的閾值

3)選擇性整合:只集成超過閾值的重要參數

這種方法通過聚焦最顯著的變化,避免了過度更新并維持了模型穩定性。

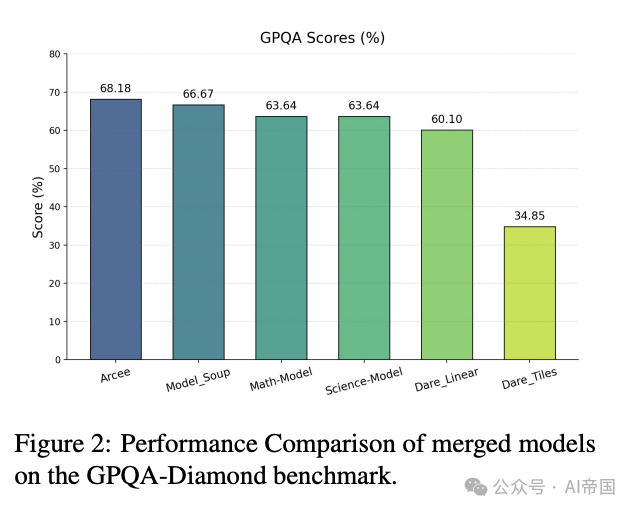

3、驚人的成果:小模型也能有大智慧

圖片

圖片

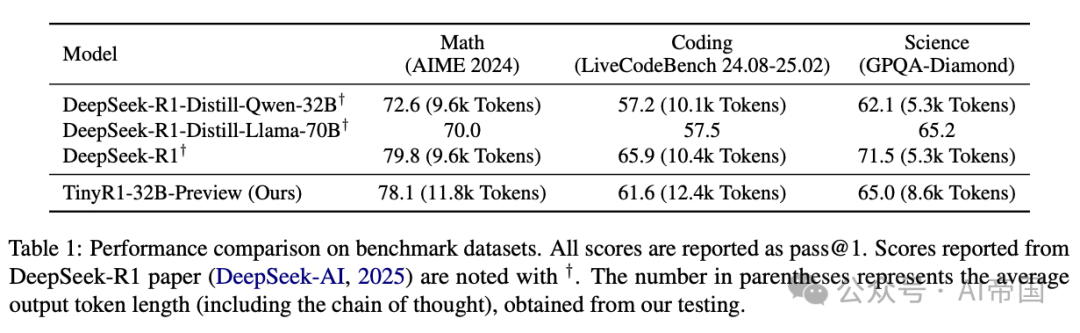

經過嚴格評測,TinyR1-32B-Preview模型取得了令人矚目的成績:

1)性能大幅提升:相比于backbone模型DeepSeek-R1-Distill-Qwen-32B,在數學領域提升了5.5個百分點,編程領域提升了4.4個百分點,科學領域提升了2.9個百分點

2)超越更大模型:總體上超過了DeepSeek-R1-Distill-Llama-70B(數學+8.1,編程+4.1,科學-0.2)

3)接近旗艦模型:性能接近DeepSeek-R1旗艦模型(數學-1.7,編程-4.3,科學-6.5)

4)推理成本可控:生成的輸出token數量僅比R1略多(數學+23%,編程+19%,科學+62%)

5)參數量大幅減少:模型參數量更小,更適合用戶和小團隊在本地部署

圖片

圖片

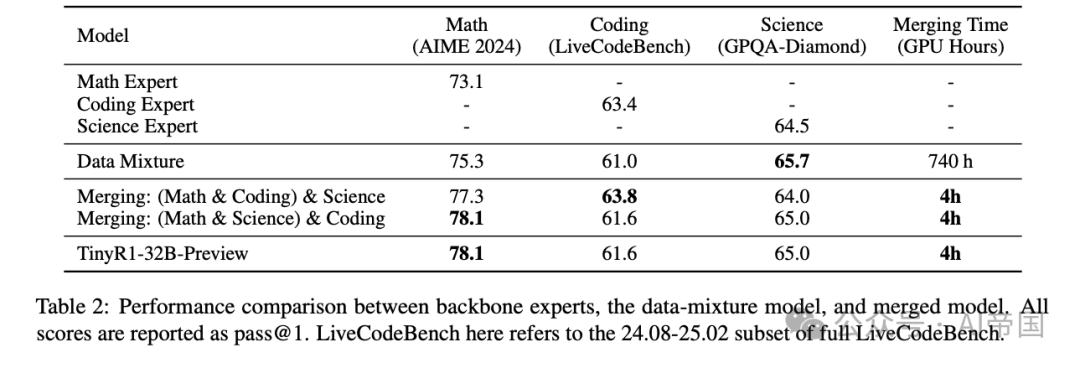

4、高效與簡便:90%時間成本節省

圖片

圖片

分支合并蒸餾方法不僅提高了模型精度,還顯著降低了時間和計算成本:

1)合并階段成本大降:與傳統方法相比,合并階段節省了90%的時間(4個H800 GPU僅需0.5小時 vs. 32個H800 GPU需要23小時)

2)總復制成本可控:TinyR1-32B-Preview的理想復制成本為744個H800 GPU小時,約1500美元(不包括消融實驗和參數搜索)

3)"免費午餐":模型合并既降低了計算開銷,又通過避免混合數據重新SFT帶來的延遲,顯著加速了模型發布過程

更重要的是,研究團隊承諾將開源他們的模型、所有數據、訓練代碼、評估代碼和日志,使任何人都能重現他們的結果。

5、未來展望:更多可能性正在展開

這項研究成果打開了大模型瘦身的新思路,團隊也提出了幾個有前景的未來發展方向:

1)探索替代骨干模型:例如,使用Qwen-Instruct模型作為骨干進行SFT

2)發布各種規模的模型:擴展模型陣容以滿足不同需求

3)深入研究實驗細節影響:進一步分析各種實驗設置如何影響最終性能

思考與啟示:分支合并蒸餾技術的出現,讓我們看到了大模型瘦身的新可能。它不僅解決了傳統蒸餾方法的局限,更為AI的普及與個性化部署鋪平了道路。未來,更小、更高效、更智能的AI模型將走進每個人的生活,改變我們與技術交互的方式。你是否已經準備好,迎接這個人人都能擁有強大AI的時代?

論文標題:TinyR1-32B-Preview: Boosting Accuracy with Branch-Merge Distillation

論文鏈接:???https://arxiv.org/abs/2503.04872??

本文轉載自??AI帝國??,作者:無影寺