深度學習領域的一些關鍵概念

1. 神經網絡

神經元:模擬人腦神經元,通過輸入、權重、偏置和激活函數計算輸出。

激活函數:引入非線性特性,如ReLU提供正值輸出,Sigmoid提供0到1之間的輸出。

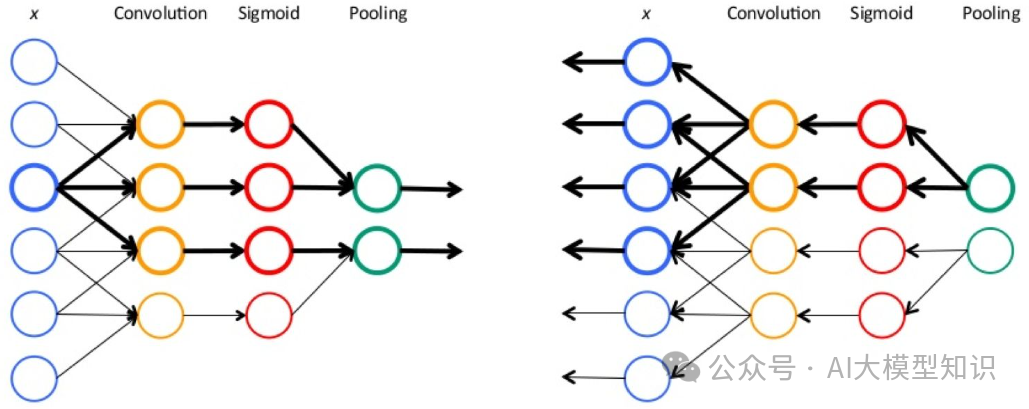

前向傳播:輸入數據在網絡中層層傳遞,計算并得到最終輸出。

反向傳播:通過計算損失函數梯度,優化網絡權重,提高模型性能。

2. 損失函數與優化

損失函數:衡量模型預測與實際值差異,如均方誤差(MSE)計算預測值與真實值差的平方和。

優化算法:如梯度下降,通過迭代調整權重,最小化損失函數。

學習率:控制模型學習速度,太大可能導致錯過最小值,太小則收斂緩慢。

3. 網絡架構

全連接神經網絡:每個神經元都與前一層的所有神經元相連接,用于各種分類和回歸任務。

卷積神經網絡(CNN):使用卷積層和池化層,適用于圖像識別、物體檢測等任務。

遞歸神經網絡(RNN):處理序列數據,如時間序列分析、語音識別。

4. 長期依賴與注意力機制

長短期記憶網絡(LSTM):具有記憶單元和門控機制,學習長期依賴信息,適用于語言模型、機器翻譯。

注意力機制:使模型關注輸入數據的重要部分,提高性能,如Transformer模型用于機器翻譯。

5. 正則化與優化

過擬合:模型在訓練數據上表現良好,但在新數據上表現差,泛化能力不足。

正則化:如L1和L2正則化,通過懲罰大權重,防止過擬合。

Dropout:隨機丟棄神經元,提高模型的泛化能力,減少過擬合。

6. 應用領域

自然語言處理(NLP):利用深度學習處理文本數據,如情感分析、文本生成。

計算機視覺:利用深度學習處理圖像和視頻數據,如人臉識別、自動駕駛。

7. 數據處理與增強

數據預處理:對數據進行標準化、歸一化等操作,提高模型性能。

數據增強:通過變換數據,增加訓練數據的多樣性和數量,提高模型泛化能力。

8. 模型評估與調試

模型評估:使用準確率、召回率、F1分數等指標,評估模型性能。

學習曲線:分析模型在不同訓練階段的表現,如訓練誤差和驗證誤差。

9. 框架與工具

Keras:一個高層神經網絡API,簡化模型構建、訓練和評估。

TensorFlow:一個開源的軟件庫,用于數據流和可微分編程,廣泛應用于深度學習。

PyTorch:一個開源的機器學習庫,動態計算圖,易于調試和實驗。

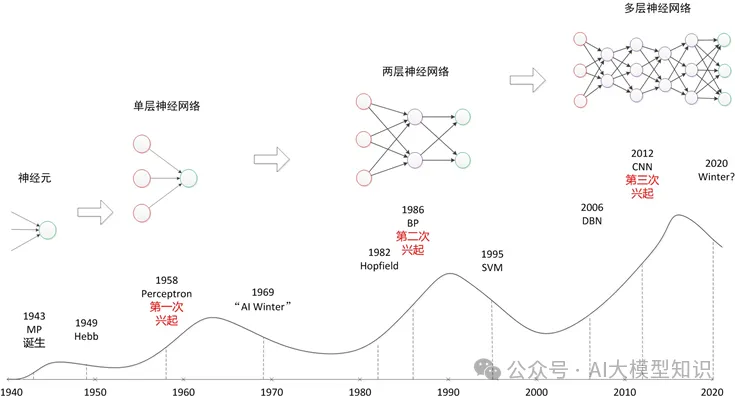

回顧一下神經網絡發展的歷程。神經網絡的發展歷史曲折蕩漾,既有被人捧上天的時刻,也有摔落在街頭無人問津的時段,中間經歷了數次大起大落。從單層神經網絡(感知器)開始,到包含一個隱藏層的兩層神經網絡,再到多層的深度神經網絡,一共有三次興起過程。見下圖。