卷積神經網絡之父:人工智能下一步從視頻中學習常識

智東西(公眾號:zhidxcom)

編 | origin

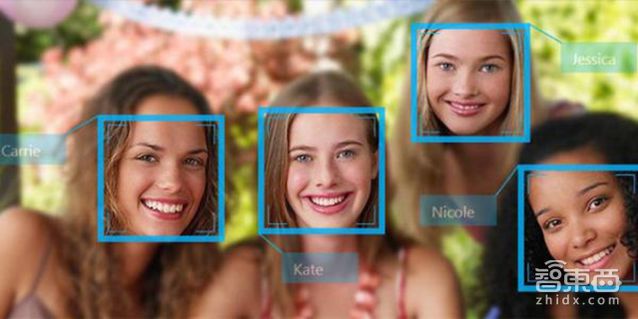

YannLeCun作為深度學習領域的大牛,近幾年帶動Facebook的人工智能項目飛速前進,其勢頭比之谷歌也不落下風。如今Facebook的人臉識別技術DeepFace已經能夠識別超過4億張人臉,而YannLeCun對此并不滿足,他認為機器視覺不該滿足于從圖片中進行識別,下一步機器應當從視頻中“學習常識”。

五年前,研究者們在圖像識別的準確性上,取得了巨大的突破。這背后的技術,人工神經網路,促成了近來人工智能的繁榮。它使谷歌和Faceboo得以讓你在自己的相冊中使用搜索功能,也讓一批使用面部識別的應用程序得以問世。

Facebook的AI研究團隊負責人兼紐約大學教授,開創性地將神經網絡運用在了機器視覺領域。他認為這個領域仍然有很大的發展空間,這個領域取得的進步可能會催生出懂得常識的軟件系統。

問:現在的機器視覺水平如何?

YannLeCun:如果你的圖片有顯著的主體,那么只需要標注主體的類別就好。如果有足夠多的數據——大概每個類別一千張圖片,那么我們就能識別相當具體的事物:比如某個品牌的汽車,某個特定品種的植物,某種特定血統的狗。我們還能識別更抽象的事物,比如風景圖、日落,婚禮或者生日party。就在五年前我們還不清楚這個問題是可以解決的。(現在我們已經把它攻克了)但是這并不是說視覺問題已經解決了。

問:那什么關鍵問題是還沒解決的?

YannLeCun:在為圖片和視頻自動生成字幕和注釋這方面,人們已經努力了很多年。此前已誕生過一些看上去很可觀的方式,但實際上它們并沒有那么可靠。它們的適用范圍極大受限于它們是如何被訓練的。對于大多數系統,如果你給它們提供包含其他種類物體或者是處在非常規情境下的圖片,它們的識別狀況會慘不忍睹。它們不具備常識。

問:視覺和常識有什么聯系?

YannLeCun:這取決于你在和誰交流——即使在Facebook內部,大家對此也有不同的意見。你可以和一套智能系統只用語言交流,問題是語言是一條帶寬很低的信息通道。人們能夠通過語言傳遞大量信息是因為他們擁有很多的背景知識來解釋這些信息。

其他人認為,向AI系統提供足夠信息的唯一方法是將其視覺感知作為基礎,而視覺圖像的信息含量比語言要大得多。這時如果你再告訴機器“這是一個智能手機”,“這是一個壓路機”,“這有些東西你能推動但那些不行”,那么機器可能會學習到關于這個世界如何運行的一些基本知識。

這有點像嬰兒的學習方式——而嬰兒在沒有明確指示的情況下就能非常多地了解這個世界。

我們非常想讓機器通過看視頻或者其他的途徑來獲得大量的體現了現實世界規律的事實。這將最終使它們獲得常識。幼年動物與嬰兒出生后頭幾個月的學習過程非常有趣——他們僅僅通過觀察就在短時間內對這個世界產生了驚人的理解。而現在的機器仍然會被各種方式輕易地愚弄,因為它們對這個世界的認識實在是太少了。

問:在讓智能系統通過觀察進行學習這個方面,有什么進展?

YannLeCun:一套學習系統應該是可以預測未來的,我們對這個想法非常感興趣。你向學習系統展示幾幀視頻,然后它來預測接下去會發生什么。如果我們能訓練出一套能完成這種工作的系統,那么我想我們就搭建起了無監督學習系統的基礎技術。我認為,這會是一個節點,為許多有趣的東西開創可能性。它的應用范圍也不會僅局限于機器視覺——這是我們在AI領域不斷進取的重要組成部分。