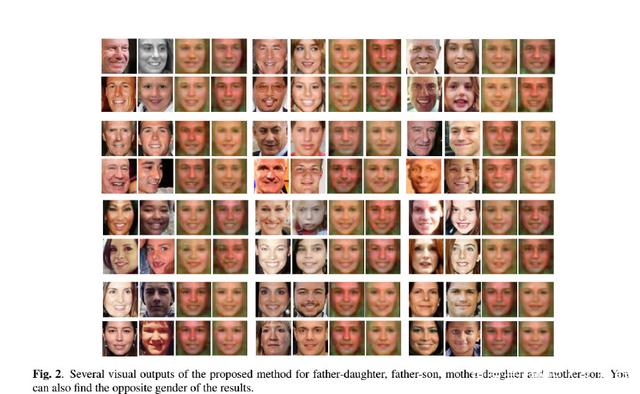

人工智能通過父母照片合成可能的子女面孔,深度學習親緣關系生成摘要:在本文中,我們提出了一個親緣關系生成器網絡,可以通過分析他/她父母的照片來合成一個可能的子女面孔。 為此,我們專注于通過提出新穎的解決方案來處理整篇論文中親緣關系數據集的稀缺性問題。 為了提取可靠的特征,我們將預先訓練的臉部模型集成到親屬關系臉部生成器。 此外,生成器網絡正規化與一個額外的人臉數據集和敵對損失,以減少過度擬合有限的樣本。 ***,我們調整周期域轉換以獲得更穩定的結果。 在野外家庭(FIW)數據集上進行實驗。 實驗結果表明,與基準結構相比,文獻中提供的貢獻提供了重要的性能改進,并且我們提出的方法產生了有希望的感知結果。

人工智能通過父母照片合成可能的子女面孔,深度學習親緣關系生成簡介:人類的大腦可以通過分析面部部分的分化模式來驗證照片中的親屬關系。這個特征是一個有力的證據,表明大腦如何令人著迷地復雜。最近,已經提出了大量方法來實現計算機進行親緣關系驗證,因為基于學習的深度模型已經顯示出令人印象深刻的能力來從面部自動提取這些潛在模式[22,18,8]。特別是,這些方法勝過了人類為各種識別問題而獲得的性能[17,22]。最終,模型的輸出可用于識別失蹤人員,子女/父母搜索以及追蹤推薦服務的一些統計數據。然而,通過分析他們的父母照片來猜測可能的孩子的面孔,相反地,更直觀地看待問題并不是激發作為原始問題(即識別和驗證)的動機。就我們所知,解決這個問題的興趣也很有限[10],即使有幾種有前途的方法可以從基于生成深度模型的大數據集合中合成人臉。

人工智能通過父母照片合成可能的子女面孔,深度學習親緣關系生成貢獻:總的來說,這個問題的目的(即合成親屬關系的面部)是,對于父母照片(母親或父親)的給定輸入,一種方法通過利用潛伏面部來合成兒童最可能的面部展現在父母面前的特征。但是,模型的魯棒性,特別是對于深度模型,強烈依賴于訓練樣本的數量和數據集的多樣性。此外,目前可用的血緣關系驗證數據集相當小,模型應根據此限制進行調整,以達到令人滿意的結果。在本文中,我們提出了一個完全卷積網絡(FCN),它利用編碼器層的響應在潛在空間中變換父面,并迭代解碼這些響應以重建可能的親緣關系面。

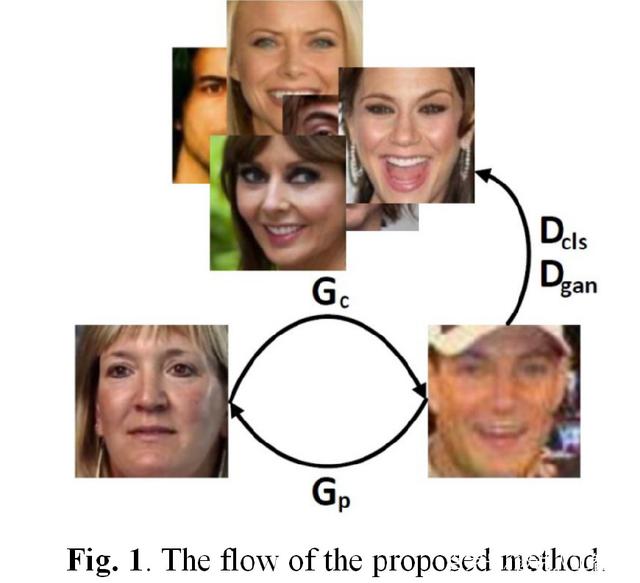

為此,我們提出了三種新的對親緣關系人臉合成的標準FCN的貢獻:1)我們使用一個預先訓練好的編碼層網絡,這個網絡在大規模數據集上進行了人臉識別優化。最終,這允許我們提取更多魯棒的隱藏特征,即使面數量有限的人臉模擬為人臉合成。 2)雖然使用編碼層提供了幾個優點,如人員識別的精度,但由于隱藏特征的大維度,解碼層可以很容易地過度訓練數據。最終,這個問題變得更加復雜,以推廣針對不同面部情景的***解決方案。因此,我們利用大規模無監督數據的對抗性損失來緩解過度擬合及其泛化能力。3)***,我們采用循環域變換[27](即從父母到孩子以及孩子到父母的變換),這導致更穩定的結果。本文的結構如下。首先,我們回顧關于人臉綜合和親屬驗證的文獻,因為這些步驟是我們問題的兩個主要基礎。后來,提出的方法的細節被提出用于親屬合成。***,報告實驗結果,并解釋本文的***評論。

人工智能通過父母照片合成可能的子女面孔,深度學習親緣關系生成相關工作:在本節中,人臉綜合和親屬驗證將被詳細討論,因為這是有效親緣合成的兩個關鍵要素。人臉綜合:人臉綜合的早期研究最初是為了從低分辨率圖像中推測人臉幻覺來推斷他們的高頻細節[2,19]。在這些作品中,眼睛,山脈和對稱等人臉的共同特征得到了特別的加強。然而,它們的主要限制是解決方案嚴格依賴于數據(即沒有泛化能力)和自然圖像流形學習(即記憶)可以堅持只將圖像塊從低分辨率轉換到高分辨率的情況通過對***所有可能的解決方案進行平均。同樣,基于自動編碼器(AE)的方法對于解決方案也有類似的缺點。 [10]旨在通過基于AE推動面部動態(即表情)和視覺外觀來生成親屬面孔,因此它能夠將個人表情轉移給未來的孩子。

變分自動編碼器(VAE)[16]是通過根據編碼器層的輸入計算隨機潛變量來合成圖像的概率方式。因此,這實際上改進了模型的泛化,并獲得了各種圖像合成問題以及人臉的各種結果。然而,它仍然沒有達到問題的復雜性(即,它低估了固定大小參數的問題,即均值和方差值)。***,獲得過度平滑的結果。

最近,生成敵對網絡(GAN)[12,23,3]產生了感知令人印象深刻的圖像生成結果。特別是,通過結合各種姿勢,表情,性別,膚色和頭發類型,可以以不適當的方式實現面部合成。此外,它允許用戶通過簡單的解決方案來將圖像轉換到不同的域[14,5]。 GAN優于VAE / AE的解釋見[9],其中GAN保留關于該問題的精細解決方案,而VAE / AE粗略地近似。

親屬驗證:親屬驗證/識別通過融合皮膚顏色和/或從面部照片顯示的高階梯度模式[24,25],最初是基于手工制作的淺膚色特征。此外,探索使用視頻而不是單一的圖像[6],作者聲稱它可以用時空外觀,隱式的面部表情來驗證人臉。最近,深度模型獲得了***的問題表現[26,18,8,21]。一般來說,他們的解決方案是基于從可用面部模型轉移可訓練參數,并且由于樣本稀缺而用親屬關系數據進行微調。***,特征空間經常被學習與三重損失類似于人臉識別問題[22]。