淺顯易懂!「高中數(shù)學(xué)」讀懂梯度下降的數(shù)學(xué)原理

| 「過早優(yōu)化是罪惡之源。」

——計算機科學(xué)家和數(shù)學(xué)家 Donald Ervin Knuth |

敏捷(agile)是軟件開發(fā)過程中的一個廣為人知的術(shù)語。其背后的基本思想很簡單:快速構(gòu)建出來→發(fā)布它→獲得反饋→基于反饋進行修改→重復(fù)這一過程。這種做法的目標(biāo)是讓產(chǎn)品親近用戶,并讓用戶通過反饋引導(dǎo)你,以實現(xiàn)錯誤最少的可能好的產(chǎn)品。另外,改進的步驟也需要很小,并且也應(yīng)該讓用戶能持續(xù)地參與進來。在某種程度上講,敏捷軟件開發(fā)過程涉及到快速迭代。而梯度下降的基本過程也差不多就是如此——盡快從一個解開始,盡可能頻繁地測量和迭代。

目標(biāo)

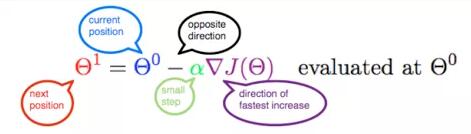

梯度下降算法是一個迭代過程,能讓我們得到一個函數(shù)的最小值(這里先不提一些額外的注意事項)。下面的公式將整個梯度下降算法匯總成為了一行:

但我們是怎么得到這個公式的?實際上很簡單,而且僅包含一些高中數(shù)學(xué)知識(小編:海外高中數(shù)學(xué)?捂臉)。我們希望能通過這篇文章在線性回歸模型的背景中理解和再現(xiàn)這一公式。

一個機器學(xué)習(xí)模型

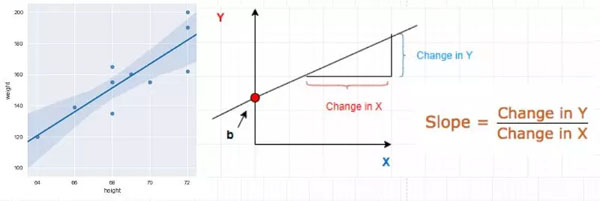

設(shè)有一些在一個 2D 空間中的數(shù)據(jù)點。假設(shè)這些數(shù)據(jù)與一組學(xué)生的身高和體重有關(guān)。我們希望預(yù)測這些量之間的某種關(guān)系,以使我們可以預(yù)測未來某個新學(xué)生的體重。這本質(zhì)上是監(jiān)督式機器學(xué)習(xí)技術(shù)的一個簡單案例。

現(xiàn)在,讓我們在空間中畫一條任意的線,并使其穿過某些數(shù)據(jù)點。那么這條線的方程即為 Y = mX + b,其中 m 是斜率,b 是這條線在 Y 軸上的截距。

預(yù)測:

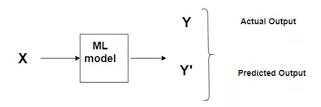

給定一組已知的輸入和它們對應(yīng)的輸出。機器學(xué)習(xí)模型會嘗試基于這些數(shù)據(jù)預(yù)測新輸入的輸出結(jié)果。

機器學(xué)習(xí)過程

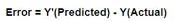

誤差(Error)即為兩個預(yù)測結(jié)果之間的差異。

與其相關(guān)的概念是成本函數(shù)或損失函數(shù)。

成本函數(shù)

成本函數(shù)/損失函數(shù)評估的是我們的機器學(xué)習(xí)算法的性能表現(xiàn)。損失函數(shù)計算的是單個訓(xùn)練樣本的誤差,成本函數(shù)則是損失函數(shù)在整個訓(xùn)練集上的平均。因此,我會交替地使用這兩個術(shù)語。

基本上而言,成本函數(shù)能告訴我們在給定了 m 和 b 的值時模型在預(yù)測方面的表現(xiàn)「有多好」。

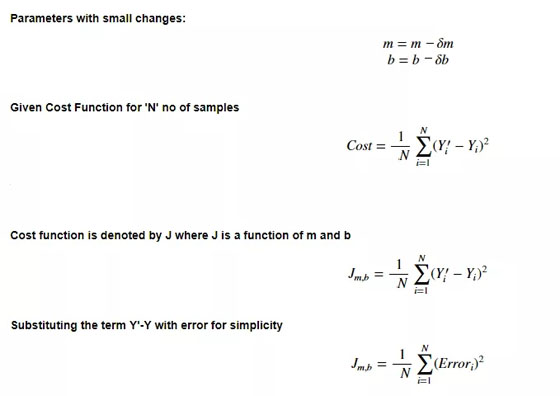

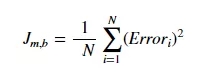

比如說,如果數(shù)據(jù)集中共有 N 個點,而對于所有這 N 個數(shù)據(jù)點,我們希望最小化其誤差。因此成本函數(shù)就將是總平方誤差,即:

N 個數(shù)據(jù)點的成本函數(shù)

為什么我們要用平方差而不直接使用絕對差呢?因為平方差能讓我們更輕松地推導(dǎo)出一條回歸線。實際上,為了找到那條線,我們需要計算成本函數(shù)的一階導(dǎo)數(shù),而計算絕對值的倒數(shù)比計算平方值的導(dǎo)數(shù)要難得多。

1. 最小化成本函數(shù)

任何機器學(xué)習(xí)算法的目標(biāo)都是最小化成本函數(shù)。

這是因為實際值和預(yù)測值之間的誤差越低,就說明算法在學(xué)習(xí)上的表現(xiàn)就越好。因為我們希望得到低的誤差值,所以我們希望這些m 和 b 值所得到的誤差盡可能最小。

2. 我們究竟如何最小化任意函數(shù)?

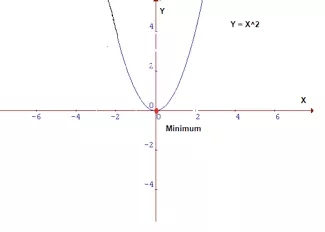

仔細觀察,我們的成本函數(shù)是 Y=X² 的形式。在笛卡爾坐標(biāo)系中,這是一個拋物線方程,可以畫成下圖形式:

拋物線

要最小化上述函數(shù),我們需要找到能得到低 Y值的 X 值,即紅點位置。因為這是一張2D 圖,所以定位其最小值很容易,但在更高維度上情況卻非如此。在這些情況下,我們需要設(shè)計一個能定位最小值的算法,這個算法就是梯度下降。

梯度下降

梯度下降是最常用的優(yōu)化算法之一,也是目前最常用的優(yōu)化神經(jīng)網(wǎng)絡(luò)的方式。這是一種用于尋找函數(shù)最小值的迭代式優(yōu)化算法。

1. 直觀理解

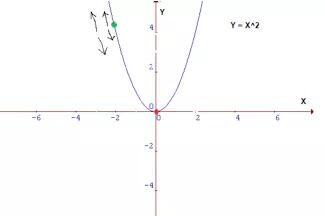

假設(shè)你正沿著下面的圖行走,而且目前正位于綠點位置。你的目標(biāo)是到達最小值,即紅點位置;但在你的位置處,你無法看到最小值在哪里。

可能的動作會是這樣:

- 你可能向上或向下

- 如果你決定了要走的方向,為了到達目的地,你可能跨一大步,也可能走一小步。

本質(zhì)上講,為了到達最小值,你應(yīng)該知道兩件事:走哪條路和步子邁多大。

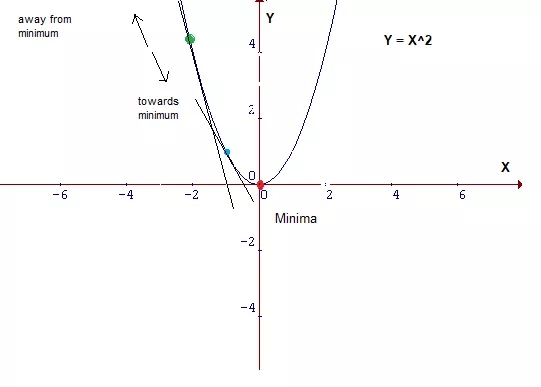

梯度下降算法可使用導(dǎo)數(shù)幫助我們有效且高效地做這些決定。導(dǎo)數(shù)是源自微積分的一個術(shù)語,可作為圖在特定點的斜率而進行計算。所以,如果我們有能力計算這條切線,我們可能就能夠算出為到達最小值所應(yīng)選擇的方向。我們將在后文更詳細地介紹這一點。

2. 最小值

在上圖中,我們可以在綠點畫一條切線,我們知道,如果我們向上移動,我們就將遠離最小值或者反過來。另外,這條切線也能讓我們了解斜率的陡峭程度。

藍點處的斜率沒有綠點處陡,這意味著從藍點到達最小值所需的步幅比在綠點處要小得多。

3. 成本函數(shù)的數(shù)學(xué)解釋

現(xiàn)在,讓我們將上面介紹的一切寫成數(shù)學(xué)公式。在等式 y = mX+b 中,m 和 b 是其參數(shù)。在訓(xùn)練過程中,它們的值會進行較小的變化。我們將這個小變化表示成δ。參數(shù)的值將分別以m=m-δm和 b=b-δb 的方式更新。這里我們的目標(biāo)是找到y(tǒng)=mx+b 中能使誤差最小的 m 和 b 值,即最小化成本函數(shù)的值。

重寫成本函數(shù):

其思想是,通過計算函數(shù)的導(dǎo)數(shù)和斜率,我們可以找到該函數(shù)的導(dǎo)數(shù)/斜率。

學(xué)習(xí)率

到達最小值或底部的步幅大小被稱為學(xué)習(xí)率。更大的步幅/更高的學(xué)習(xí)率可以覆蓋更大區(qū)域,但卻有越過最小值的風(fēng)險。另一方面,更小的步幅/更低的學(xué)習(xí)率到達低點需要消耗大量時間。

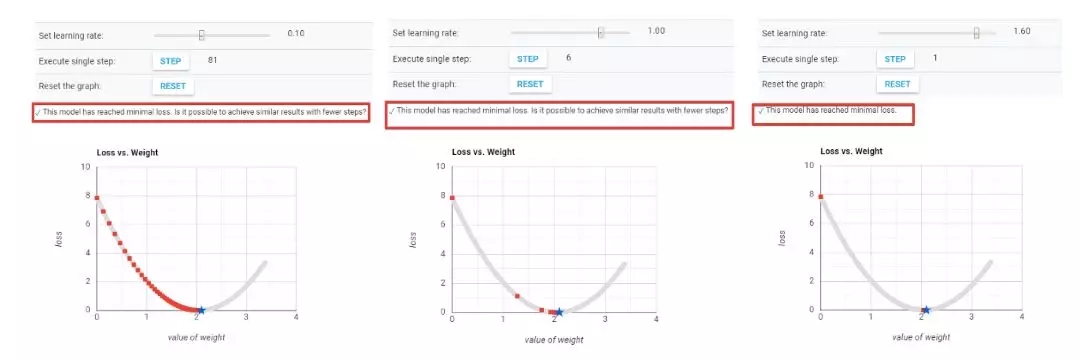

下面的圖片展示了學(xué)習(xí)率的概念。在第三張圖中,我們用最少的步驟到達了最小值。這是這一問題的學(xué)習(xí)率。

可以看到,當(dāng)學(xué)習(xí)率過低時,需要很多步驟才能收斂。而當(dāng)學(xué)習(xí)率過高時,梯度下降將無法到達最小值,如下圖所示。

不同學(xué)習(xí)率的實驗結(jié)果可參考:

https://developers.google.com/machine-learning/crash-course/fitter/graph。

導(dǎo)數(shù)

機器學(xué)習(xí)在優(yōu)化問題中使用導(dǎo)數(shù)。梯度下降等優(yōu)化算法使用導(dǎo)數(shù)來實際決定是增大還是減小權(quán)重,以增大或減小目標(biāo)函數(shù)。

如果我們可以計算出一個函數(shù)的導(dǎo)數(shù),我們就會知道要繼續(xù)的方向就是最小化該函數(shù)的方向。我們主要是處理兩個來自微積分的概念:

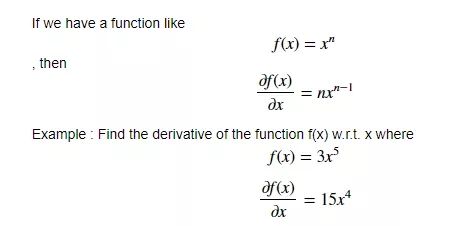

1. 冪規(guī)則

冪規(guī)則計算的是提升成冪的變量的導(dǎo)數(shù)。

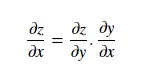

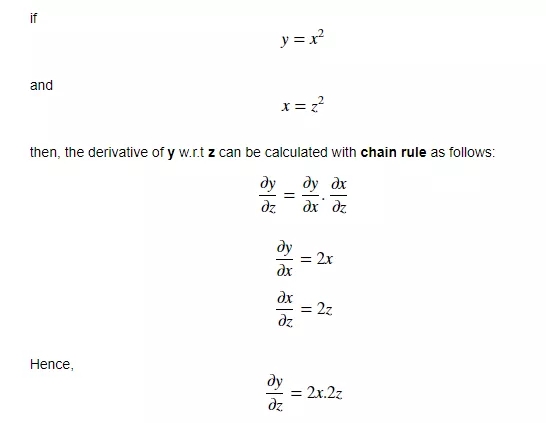

2. 鏈式法則

鏈式法則用于計算復(fù)合函數(shù)的導(dǎo)數(shù)。鏈式法則可以使用萊布尼茲符號表示如下:

如果變量 z 依賴于變量 y,而變量 y 又依賴于變量 x,則 y 和 z 是因變量,而且 z 也通過中間變量依賴于 x。這被稱為鏈式法則,用數(shù)學(xué)式可寫成:

讓我們通過一個例子來理解:

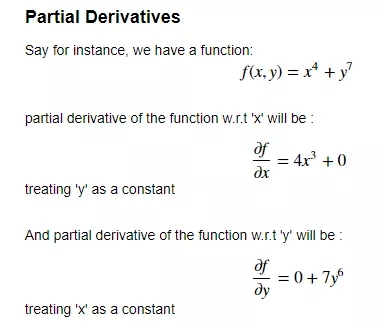

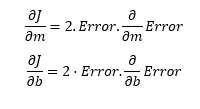

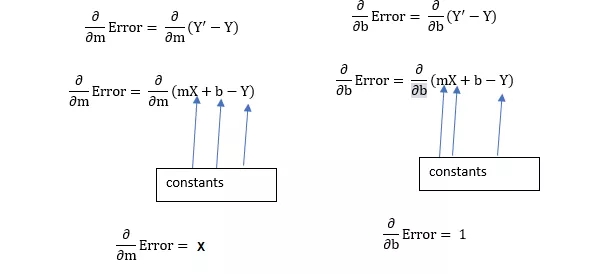

將冪規(guī)則和鏈式法則用于導(dǎo)數(shù),我們可以計算成本函數(shù)相對于 m 和 b 的變化方式。這涉及到偏導(dǎo)數(shù)的概念,即如果一個函數(shù)有兩個變量,則尋找該函數(shù)相對于一個變量的偏導(dǎo)數(shù)的方法是將另一個變量視為常量。用例子解釋會更清楚:

3. 計算梯度下降

現(xiàn)在我們將這些微積分規(guī)則應(yīng)用于我們原來的等式,并找到成本函數(shù)相對于 m 和 b 的導(dǎo)數(shù)。重訪成本函數(shù):

為了簡單,讓我們擺脫其中的求和符號。這個求和部分很重要,尤其是涉及到隨機梯度下降(SGD)與批梯度下降的概念時。在批梯度下降的過程中,我們一次性檢查所有訓(xùn)練樣本的誤差;而在 SGD 過程中,我們每次檢查每個誤差。但是,為了簡單起見,我們假設(shè)我們每次檢查每個誤差。

現(xiàn)在,我們來計算與 m 和 b 相關(guān)的誤差的梯度:

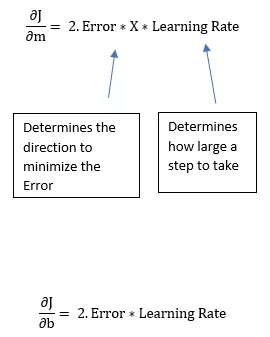

將這些值放回成本函數(shù),并將其與學(xué)習(xí)率相乘:

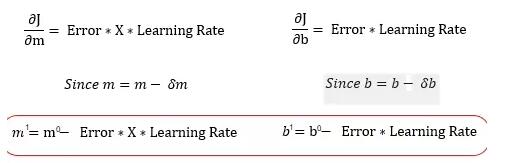

現(xiàn)在,這個等式中的 2 并不是那么重要,因為它只是表示我們的學(xué)習(xí)率有兩倍或一半那么大。所以我們直接丟掉它。因此,最終這整篇文章都濃縮成了兩個表示梯度下降的簡單等式。

m¹,b¹ = 下個位置參數(shù);m⁰,b⁰ = 當(dāng)前位置參數(shù)。

因此,為了求解梯度,我們使用新的 m 和 b 值迭代我們的數(shù)據(jù)點并計算偏導(dǎo)數(shù)。這個新梯度能指出成本函數(shù)在當(dāng)前位置的斜率以及我們應(yīng)該移動的方向,以便更新我們的參數(shù)。我們的更新的大小受學(xué)習(xí)率控制。

總結(jié)

這篇文章的目的是展示梯度下降的概念。我們使用了梯度下降作為線性回歸的優(yōu)化策略。通過繪制擬合線來測量學(xué)生身高和體重之間的關(guān)系。但是,需要重點指出,這個線性回歸示例是為了演示簡單而選擇的,梯度下降也可用于其它機器學(xué)習(xí)技術(shù)。

原文鏈接:

https://towardsdatascience.com/understanding-the-mathematics-behind-gradient-descent-dde5dc9be06e

【本文是51CTO專欄機構(gòu)“機器之心”的原創(chuàng)譯文,微信公眾號“機器之心( id: almosthuman2014)”】