面向神經(jīng)機(jī)器翻譯的篇章級單語修正模型

本文轉(zhuǎn)自雷鋒網(wǎng),如需轉(zhuǎn)載請至雷鋒網(wǎng)官網(wǎng)申請授權(quán)。

《面向神經(jīng)機(jī)器翻譯的篇章級單語修正模型》[1]是EMNLP2019上一篇關(guān)于篇章級神經(jīng)機(jī)器翻譯的工作。針對篇章級雙語數(shù)據(jù)稀缺的問題,這篇文章探討了如何利用篇章級單語數(shù)據(jù)來提升最終性能,提出了一種基于目標(biāo)端單語的篇章級修正模型(DocRepair),用來修正傳統(tǒng)的句子級翻譯結(jié)果。

1、背景

近幾年來,神經(jīng)機(jī)器翻譯迅速發(fā)展,google在2017年提出的Transformer模型[2]更是使得翻譯質(zhì)量大幅提升,在某些領(lǐng)域已經(jīng)可以達(dá)到和人類媲美的水平[3]。然而,如今的大部分機(jī)器翻譯系統(tǒng)仍是基于句子級的,無法利用篇章級的上下文信息,如何在機(jī)器翻譯過程中有效利用篇章級信息是當(dāng)今的研究熱點之一。

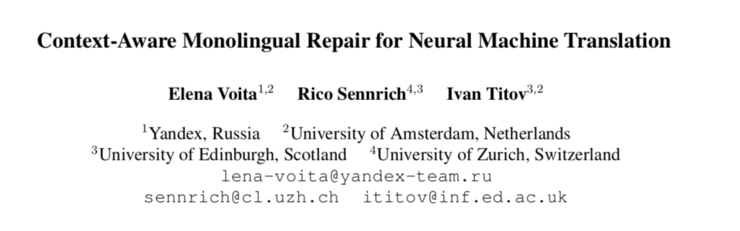

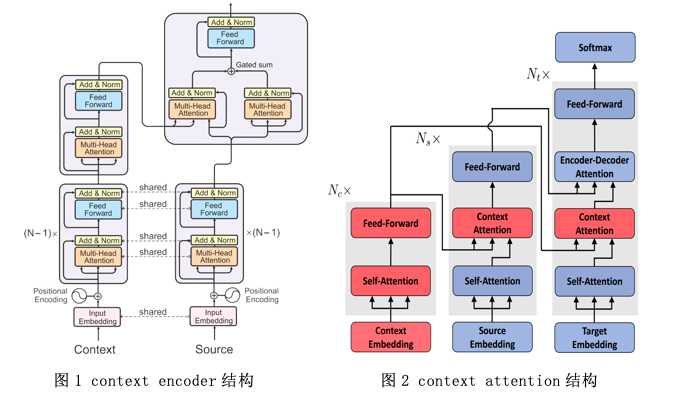

隨著基于自注意力機(jī)制的Transformer模型在機(jī)器翻譯任務(wù)中廣泛應(yīng)用,許多之前基于循環(huán)神經(jīng)網(wǎng)絡(luò)(RNN)機(jī)器翻譯模型的篇章級方法不再適用。最近,許多研究人員嘗試對Transformer進(jìn)行改進(jìn),在編碼或解碼階段引入上下文信息。Voita等人[4]首先提出了一種基于Transformer的模型(圖1)的篇章級翻譯模型,在傳統(tǒng)的模型之外,額外增加了一個上下文編碼器(context encoder)用來編碼上下文信息,然后和當(dāng)前句子的編碼結(jié)果進(jìn)行融合,送到解碼器。張嘉誠等人[5]采用了另外一種做法,分別在編碼器和解碼器中增加了一個上下文注意力(context attention)子層(圖2)用來引入上下文信息。還有一些研究人員嘗試使用二階段(two-pass)模型的方式[6][7],首先進(jìn)行句子級解碼,然后使用一個篇章級解碼器結(jié)合句子級解碼結(jié)果和源語上下文編碼來進(jìn)行篇章級解碼。此外,一些工作對篇章級翻譯需要引入那些上下文信息進(jìn)行了探究。

上述工作在機(jī)器翻譯的過程中引入上下文信息,將篇章級翻譯作為一個整體過程。這種方式建模更加自然,但是需要足夠的篇章級雙語數(shù)據(jù)進(jìn)行訓(xùn)練。然而,實際中篇章級雙語數(shù)據(jù)很難獲取,作者就是針對篇章級雙語數(shù)據(jù)稀缺的問題提出了DocRepair模型。

2、DocRepair模型

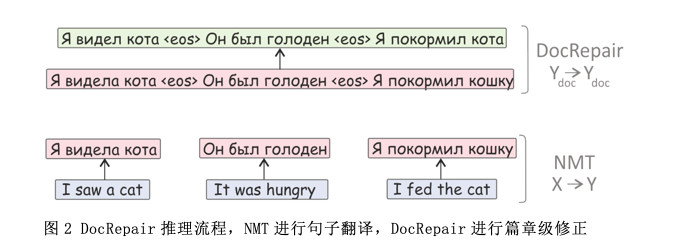

和二階段的方法類似,DocRepair模型也是對句子級結(jié)果的修正,但是不同點在于,DocRepair模型僅僅需要使用單語數(shù)據(jù)。作為一個單語的序列到序列模型(seq2seq)模型,DocRepair模型需要將上下文不一致的句子組映射到一個一致的結(jié)果,來解決上下文的不一致性,過程如圖2。

模型的訓(xùn)練語料來自于容易獲取的篇章級單語語料。單語數(shù)據(jù)中上下文一致的句子組作為模型輸出,而通過round-trip的方式構(gòu)建的上下文不一致的句子組作為模型輸入。round-trip分為兩個階段,需要正向和反向兩個翻譯系統(tǒng)。首先使用反向的翻譯模型將目標(biāo)端的篇章級單語數(shù)據(jù)翻譯到源語端,得到丟失了句子間上下文信息的源語結(jié)果,然后通過正向的翻譯模型將源語結(jié)果翻譯回目標(biāo)端,得到最終需要的上下文不一致的目標(biāo)端數(shù)據(jù),整體流程如圖3所示。

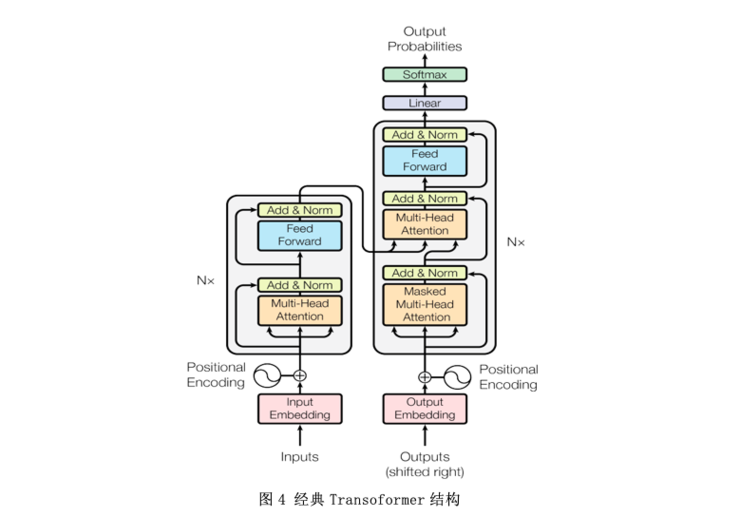

DocRepair模型采用了標(biāo)準(zhǔn)的Transformer結(jié)構(gòu)(圖4),模型輸入為不包含上下文信息的句子序列,通過一個分隔令牌連接成一個長序列,模型輸出為修正后的上下文一致的序列,去掉分隔令牌得到最終結(jié)果。

作者提出的這種結(jié)構(gòu)可以看作一個自動后編輯系統(tǒng),獨立于翻譯模型,最大的優(yōu)點就在于只需要使用目標(biāo)端單語數(shù)據(jù)就能構(gòu)造訓(xùn)練集。相對應(yīng)的,這種方法引入了額外的結(jié)構(gòu),增加了整體系統(tǒng)的復(fù)雜度,使得訓(xùn)練和推理代價變大。同時,由于僅僅在目標(biāo)端根據(jù)翻譯結(jié)果進(jìn)行修正,完全沒有引入源語端的信息,DocRepair模型可能沒有充分考慮到上下文信息。之前的一些工作也證實了源語端上下文信息在篇章級機(jī)器翻譯中的作用,如何利用源語端的單語數(shù)據(jù)來更好地提取上下文信息也是未來一個值得研究的方向。

3、實驗

為了驗證方法的有效性,作者從BLEU、篇章級專用測試集和人工評價三個角度進(jìn)行了對比實驗。實驗在英俄任務(wù)上進(jìn)行,數(shù)據(jù)集使用了開放數(shù)據(jù)集OpenSubtitles2018。

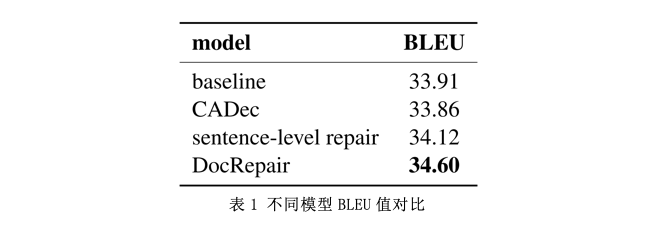

表1是DcoRepair的對比實驗結(jié)果。其中,baseline采用了Transformer base模型,CADec[7]為一個兩階段的篇章級翻譯模型。同時,為了驗證DocRepair模型在篇章級翻譯上有效性,而不僅僅是因為對句子進(jìn)行后編輯使得翻譯質(zhì)量提升,同樣訓(xùn)練了一個基于句子級的repair模型。可以看到,DocRepair在篇章級機(jī)器翻譯上是有效的,比sentence-level repair模型高出0.5 BLEU,同時對比baseline和CADec有0.7 BLEU的提升。

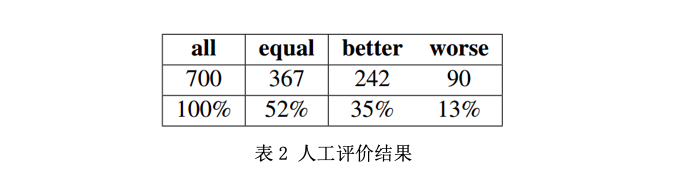

人工評價使用了來自通用測試集的700個樣例,不包含DocrePair模型完全復(fù)制輸入的情況。如表2所示,52%的樣例被人工標(biāo)注成具有相同的質(zhì)量,剩余的樣例中,73%被認(rèn)為DocrePair輸出更有優(yōu)勢,同樣證實了模型的有效性。

為了分析DocRepair對篇章級翻譯中特定問題的有效性,作者在專為英俄篇章級翻譯現(xiàn)象構(gòu)造的數(shù)據(jù)集[9]上進(jìn)行了驗證,結(jié)果如表3。deixis代表了句子間的指代問題,lex.c表示篇章中實體翻譯的一致性問題,ell.infl和ell.VP分別對應(yīng)了源語端中包含而目標(biāo)語端不存在的名詞形態(tài)和動詞省略現(xiàn)象。

在指代、詞匯選擇和名詞形態(tài)省略問題中,DocRepair具有明顯優(yōu)勢,而在動詞省略問題中,DocRepair模型對比CADec低了5百分點。可能的原因是DocRepair模型僅僅依賴于目標(biāo)端單語,而采用round-trip方式構(gòu)造的訓(xùn)練集中很少包含動詞缺失的樣本,使得模型很難做出正確預(yù)測。

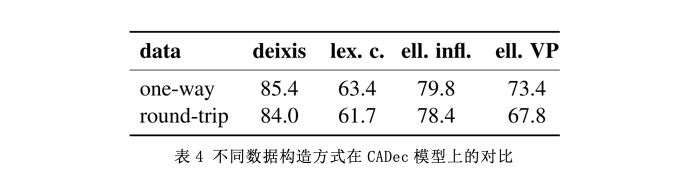

為了驗證單語數(shù)據(jù)的局限性,作者在DocRepair模型上進(jìn)行了不同數(shù)據(jù)構(gòu)造方式的對比實驗,結(jié)果如表4。one-way表示拿雙語數(shù)據(jù)中的源語替換round-trip的第一步反向過程。可以看出,one-way的方式要整體高于round-trip方式,而其中對于round-trip方式最難的問題就是動詞省略。

4、總結(jié)

這篇工作提出了完全基于目標(biāo)端單語的DocRepair模型,用來修正機(jī)器翻譯結(jié)果,解決篇章級不一致性。同時對DcoRepair在具體篇章級問題中的性能進(jìn)行了分析,指出了僅僅依賴于單語數(shù)據(jù)和round-trip的構(gòu)造方式的局限性。

以往的工作大多關(guān)注于在解碼過程中如何融合上下文信息,但是性能往往受限于篇章級雙語數(shù)據(jù)的稀缺。這篇工作為我們提供了一個新思路,可以避免雙語數(shù)據(jù)稀缺的問題,但是也引出了一個新的問題。篇章級翻譯的目標(biāo)是解決傳統(tǒng)句子級翻譯中丟失句子間上下文信息的問題,而在這種后編輯的方法中,僅僅使用了目標(biāo)端的一組沒有上下文一致性的翻譯結(jié)果就可以通過單語修正模型獲得一致性的結(jié)果,缺乏對源語的關(guān)注。筆者認(rèn)為,在雙語稀缺的情況下,如何更好的引入源語上下文信息也是一個有趣的問題。

參考文獻(xiàn)

[1] Voita, Elena, Rico Sennrich, and Ivan Titov. "Context-Aware Monolingual Repair for Neural Machine Translation." arXiv preprint arXiv:1909.01383 (2019).

[2] Vaswani, Ashish, et al. "Attention is all you need." Advances in neural information processing systems. 2017.

[3] Hassan, Hany, et al. "Achieving human parity on automatic chinese to english news translation." arXiv preprint arXiv:1803.05567 (2018).

[4] Voita, E., Serdyukov, P., Sennrich, R., & Titov, I. (2018). Context-aware neural machine translation learns anaphora resolution. arXiv preprint arXiv:1805.10163.

[5] Zhang, J., Luan, H., Sun, M., Zhai, F., Xu, J., Zhang, M., & Liu, Y. (2018). Improving the transformer translation model with document-level context. arXiv preprint arXiv:1810.03581.

[6] Xiong, H., He, Z., Wu, H., & Wang, H. (2019, July). Modeling coherence for discourse neural machine translation. In Proceedings of the AAAI Conference on Artificial Intelligence (Vol. 33, pp. 7338-7345).

[7] Voita, E., Sennrich, R., & Titov, I. (2019). When a Good Translation is Wrong in Context: Context-Aware Machine Translation Improves on Deixis, Ellipsis, and Lexical Cohesion. arXiv preprint arXiv:1905.05979.