機器學習:使用批歸一化有哪些缺點?

批歸一化(Batch Normalization)是深度學習領域的重大突破之一,也是近年來研究人員討論的熱門話題之一。批歸一化是一種被廣泛采用的技術,能夠使訓練更快、更穩定,并已成為深度學習領域很具影響力的方法之一。然而,它仍然存在一些要注意的問題。

為什么要使用批歸一化?

什么是批歸一化

在訓練深度學習模型過程中,當我們更新之前的權重時,每個中間激活層的輸出分布在每次迭代中都會發生變化。這種現象被稱為內部協變移位(ICS)。為了防止這種情況的發生,就需要修正所有的分布。簡單地說,如果遇到了一些分布移位的問題,我們應該不讓它們移位,以幫助進行梯度優化并防止梯度消失,這將有助于我們的神經網絡更快地訓練。因此,減少這種ICS是驅動批歸一化發展的關鍵原理。

它是怎么運行的

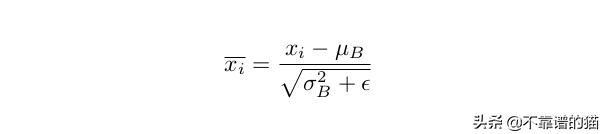

批歸一化通過減去批次上的經驗均值除以經驗標準差來歸一化前一個輸出層的輸出。這將有助于數據看起來像高斯分布。

其中mu和sigma_square分別是batch均值和batch方差。

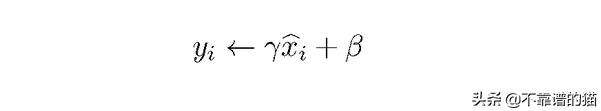

我們根據兩個可學習的參數γ和β學習了新的均值和協方差。

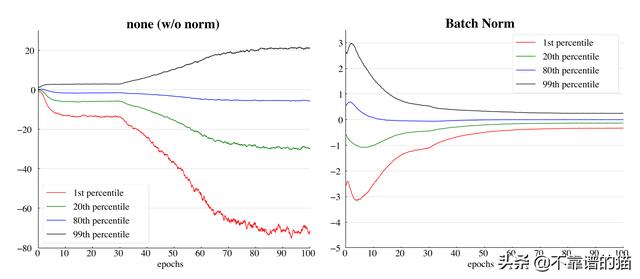

VGG-16網絡的中間卷積層的特征分布輸出

好處

我將列舉使用批歸一化的一些好處,但由于涉及到大量的文章,因此我不會贅述。

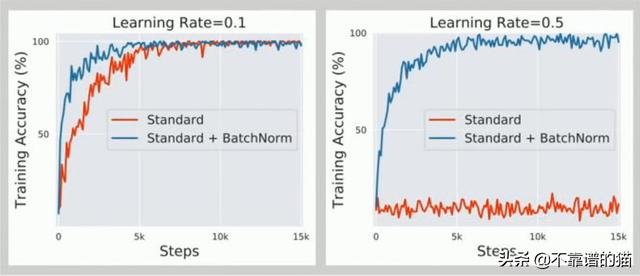

- 收斂更快。

- 降低了初始權重的重要性。

- 對超參數的魯棒性。

- 泛化所需的數據更少。

批歸一化的問題

回到本文的動機,在許多情況下,批歸一化可能會影響性能或者根本不起作用。

使用小的batch sizes時不穩定

如上所述,批歸一化層必須計算均值和方差,以便對整個batch的前一個輸出進行歸一化。

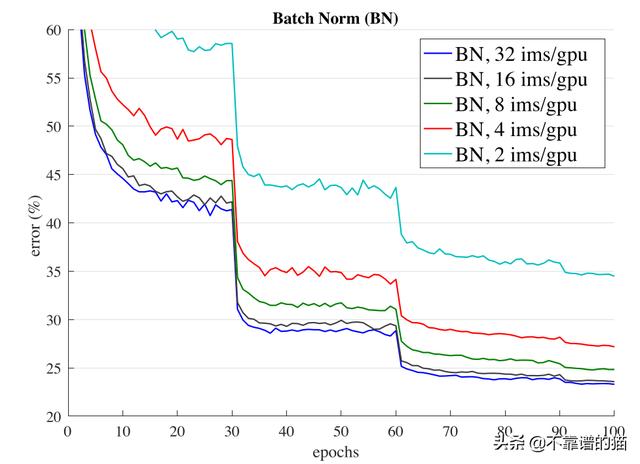

ResNet-50的批歸一化驗證誤差

上面是ResNet-50的驗證誤差圖。如果batch size保持為32,那么最終驗證誤差將在23左右,并且隨著batch size的減小,誤差會不斷減小(batch size不能為1,因為它本身就是均值)。損失有很大的不同(大約10%)。

如果小batch size是一個問題,為什么我們不使用更大的batch size呢?實際上,我們不能在每種情況下都使用較大的batch size。在進行微調時,我們不能使用大的batch size,以避免使用大梯度傷害我們的模型。在分布式訓練中,大的batch size最終將作為一組小的batch sizes分布在實例中。

會導致訓練時間增加

NVIDIA和卡耐基梅隆大學進行的實驗結果表明,“即使批歸一化不占用大量計算資源,但收斂所需的總迭代次數卻減少了。每次迭代的時間可能會顯著增加”,并且隨著batch size的增加,訓練時間可能進一步增加。

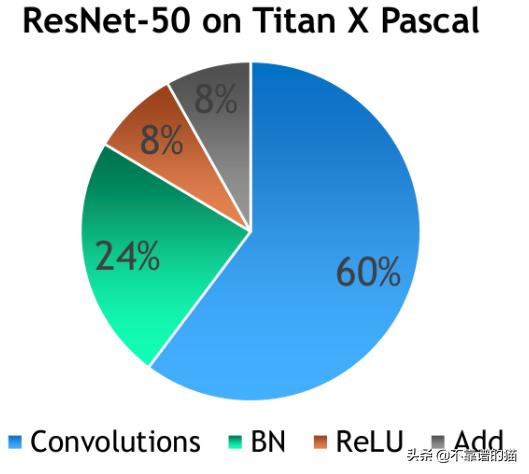

使用Titan X Pascal在ImageNet上的ResNet-50訓練時間分布

如您所見,批歸一化消耗了總訓練時間的1/4。原因是因為批歸一化要求對輸入數據進行兩次迭代:一次用于計算batch統計信息,另一次用于對輸出進行歸一化。

在測試/推斷階段不穩定

例如,考慮實際應用程序:“對象檢測”。在訓練對象檢測器時,我們通常使用大的batch size(默認情況下,YOLOv4和Faster-RCNN都以batch size= 64進行訓練)。但是在將這些深度學習模型投入生產后,這些模型并不像訓練時那么有效。這是因為它們是用大的batch size進行訓練的,而在實時情況下,它們得到的batch size等于1,因為它必須處理每一幀。如前所述,當使用batch size為1時,它本身就是均值,因此歸一化層將無法有效地處理所謂的“內部協變移位”。

不利于在線學習

與batch學習相比,在線學習是一種學習技術,通過依次(或單獨地,或通過稱為mini-batches的small groups)向系統提供數據實例,對系統進行增量式訓練。每一個學習步驟既快速又廉價,因此系統可以在新數據到達時動態地學習新數據。

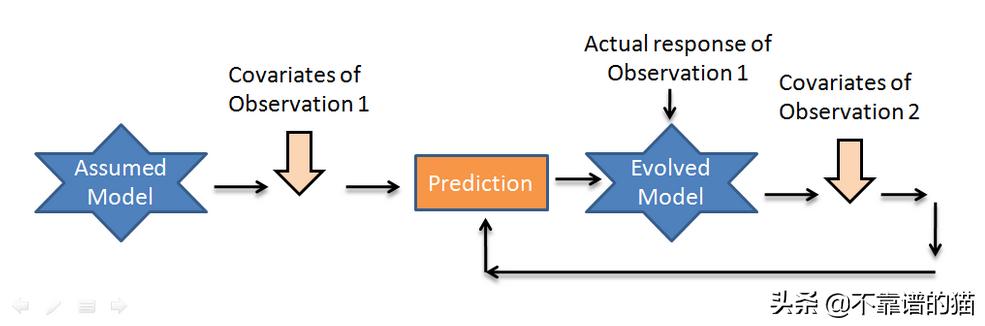

典型的在線學習管道

由于它依賴于外部數據源,數據可以單獨到達,也可以成批到達。由于每次迭代中batch size的變化,它不能很好地概括輸入數據的規模和shift,這最終會影響性能。

不適用于循環神經網絡

在卷積神經網絡中,盡管批歸一化可以顯著提高訓練速度和泛化能力,但事實證明,它們很難應用于循環體系結構。批歸一化可以應用于RNN的堆棧之間,其中歸一化是“垂直”應用(即每個RNN的輸出),但是它不能“水平”應用(即在時間步之間),因為重復的rescaling會導致梯度爆炸。

備選方案

在無法進行批歸一化的情況下,可以使用以下幾種替代方法:

- 層歸一化。

- 實例歸一化。

- 組歸一化(+權重標準化)。

- 同步批歸一化。

最后

批歸一化盡管是深度學習開發中的一個里程碑技術,但是它仍會有一些問題,這表明歸一化技術仍有改進的空間。