如何獲取高精度CV模型?快來(lái)試試百度EasyDL超大規(guī)模視覺(jué)預(yù)訓(xùn)練模型

在深度學(xué)習(xí)領(lǐng)域,有一個(gè)名詞正在被越來(lái)越頻繁地得到關(guān)注:遷移學(xué)習(xí)。它相比效果表現(xiàn)好的監(jiān)督學(xué)習(xí)來(lái)說(shuō),可以減去大量的枯燥標(biāo)注過(guò)程,簡(jiǎn)單來(lái)說(shuō)就是在大數(shù)據(jù)集訓(xùn)練的預(yù)訓(xùn)練模型上進(jìn)行小數(shù)據(jù)集的遷移,以獲得對(duì)新數(shù)據(jù)較好的識(shí)別效果,因其能夠大量節(jié)約新模型開(kāi)發(fā)的成本,在實(shí)際應(yīng)用中被更廣泛地關(guān)注。基于此,百度EasyDL零門檻AI開(kāi)發(fā)平臺(tái)引入了超大規(guī)模視覺(jué)預(yù)訓(xùn)練模型,結(jié)合遷移學(xué)習(xí)工具,幫助開(kāi)發(fā)者使用少量數(shù)據(jù),快速定制高精度AI模型。

高質(zhì)量數(shù)據(jù)獲取難度高,遷移學(xué)習(xí)提升模型效果

在訓(xùn)練一個(gè)深度學(xué)習(xí)模型時(shí),通常需要大量的數(shù)據(jù),但數(shù)據(jù)的采集、標(biāo)注等數(shù)據(jù)準(zhǔn)備過(guò)程會(huì)耗費(fèi)大量的人力、金錢和時(shí)間成本。為解決此問(wèn)題,我們可以使用預(yù)訓(xùn)練模型。以預(yù)訓(xùn)練模型A作為起點(diǎn),在此基礎(chǔ)上進(jìn)行重新調(diào)優(yōu),利用預(yù)訓(xùn)練模型及它學(xué)習(xí)的知識(shí)來(lái)提高其執(zhí)行另一項(xiàng)任務(wù)B的能力,簡(jiǎn)單來(lái)說(shuō)就是在大數(shù)據(jù)集訓(xùn)練的預(yù)訓(xùn)練模型上進(jìn)行小數(shù)據(jù)集的遷移,以獲得對(duì)新數(shù)據(jù)較好的識(shí)別效果,這就是遷移學(xué)習(xí)(Transfer Learning)。遷移學(xué)習(xí)作為一種機(jī)器學(xué)習(xí)方法,廣泛應(yīng)用于各類深度學(xué)習(xí)任務(wù)中。在具體實(shí)現(xiàn)遷移學(xué)習(xí)時(shí),有多種深度網(wǎng)絡(luò)遷移方法,其中的Fine-tune(微調(diào))是最簡(jiǎn)單的一種深度網(wǎng)絡(luò)遷移方法,它主要是將已訓(xùn)練好的模型參數(shù)遷移到新的模型來(lái)幫助新模型訓(xùn)練。

針對(duì)一個(gè)具體的模型開(kāi)發(fā)任務(wù),我們通常會(huì)選擇在公開(kāi)的大數(shù)據(jù)集上訓(xùn)練收斂、且效果較好的模型,作為預(yù)訓(xùn)練權(quán)重,在此基礎(chǔ)上使用業(yè)務(wù)數(shù)據(jù)對(duì)模型進(jìn)行Fine-tune。在Fine-tune時(shí),默認(rèn)源域(預(yù)訓(xùn)練模型)、目標(biāo)域數(shù)據(jù)集(用戶業(yè)務(wù)數(shù)據(jù)集)需要具有較強(qiáng)相關(guān)性,即數(shù)據(jù)同分布,這樣我們才能利用預(yù)訓(xùn)練模型的大量知識(shí)儲(chǔ)備,快速高效地訓(xùn)練出針對(duì)特定業(yè)務(wù)場(chǎng)景并具有優(yōu)秀效果的模型。

但在實(shí)際應(yīng)用場(chǎng)景中,很多用戶會(huì)面臨數(shù)據(jù)集與源數(shù)據(jù)集分布不同的問(wèn)題。比如,預(yù)訓(xùn)練模型的數(shù)據(jù)都是自然風(fēng)景,但用戶的數(shù)據(jù)集都是動(dòng)漫人物。類似這種源數(shù)據(jù)集和目標(biāo)數(shù)據(jù)差別較大的問(wèn)題,在具體應(yīng)用中較易導(dǎo)致負(fù)向遷移,具體表現(xiàn)為訓(xùn)練收斂慢,模型效果差等。

因此,一個(gè)包含各類場(chǎng)景、覆蓋用戶各類需求的超大規(guī)模數(shù)據(jù)集就十分重要,通過(guò)這個(gè)包羅萬(wàn)象的超大規(guī)模數(shù)據(jù)集訓(xùn)練所得的模型,才能夠更好地適應(yīng)來(lái)自各行各業(yè)用戶的需求,更好地Fine-tune用戶的業(yè)務(wù)數(shù)據(jù)集,幫助用戶在自己的數(shù)據(jù)集上得到效果更好的模型。

百度超大規(guī)模預(yù)訓(xùn)練模型便在此背景下產(chǎn)生,在視覺(jué)方向,百度自研超大規(guī)模視覺(jué)預(yù)訓(xùn)練模型覆蓋圖像分類與物體檢測(cè)兩個(gè)方向。圖像分類的預(yù)訓(xùn)練模型,用海量互聯(lián)網(wǎng)數(shù)據(jù),包括10萬(wàn)+的物體類別,6500萬(wàn)的超大規(guī)模圖像數(shù)量,進(jìn)行大規(guī)模訓(xùn)練所得,適應(yīng)于各類圖像分類場(chǎng)景;物體檢測(cè)的預(yù)訓(xùn)練模型,用800+的類別,170萬(wàn)張圖片以及1000萬(wàn)+物體框的數(shù)據(jù)集,進(jìn)行大規(guī)模訓(xùn)練所得,適應(yīng)于各類物體檢測(cè)應(yīng)用場(chǎng)景。相對(duì)于普通使用公開(kāi)數(shù)據(jù)集訓(xùn)練的預(yù)訓(xùn)練模型,在各類數(shù)據(jù)集上都有不同程度效果提升,模型效果和泛化性都有顯著提升。

真實(shí)測(cè)試數(shù)據(jù)展示百度超大規(guī)模視覺(jué)預(yù)訓(xùn)練模型的強(qiáng)大能力

(以下實(shí)驗(yàn)數(shù)據(jù)集均來(lái)自不同行業(yè))

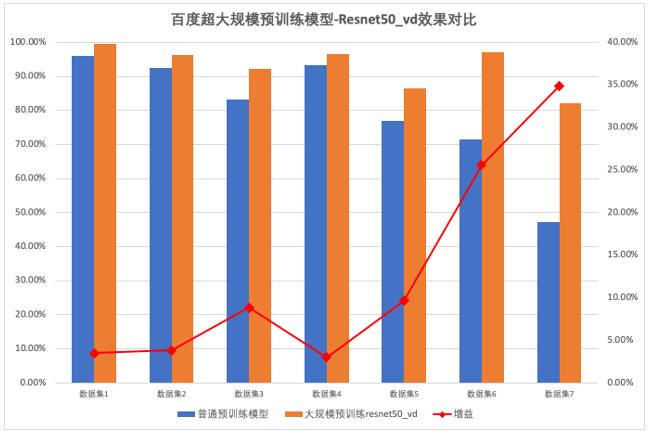

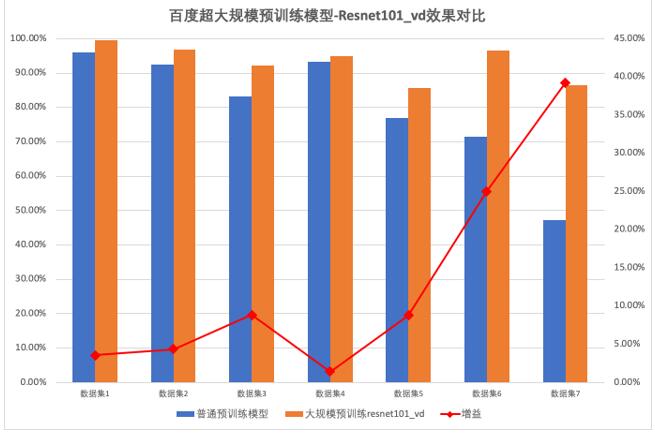

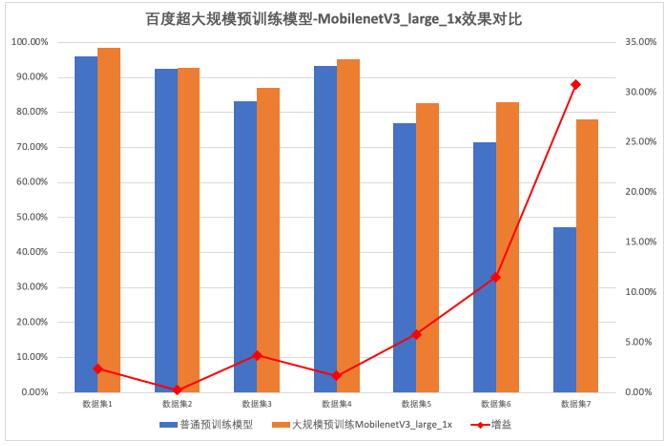

圖像分類

在圖像分類模型中,使用百度超大規(guī)模預(yù)訓(xùn)練模型的Resnet50_vd相比普通模型在各類數(shù)據(jù)集上模型效果平均提升12.76%,使用百度超大規(guī)模預(yù)訓(xùn)練模型的Resnet101_vd,相比于普通預(yù)訓(xùn)練模型,平均提升13.03%,使用百度超大規(guī)模預(yù)訓(xùn)練模型的MobilenetV3_large_1x,相比于普通預(yù)訓(xùn)練模型,平均提升8.04%。

基于百度超大規(guī)模預(yù)訓(xùn)練模型訓(xùn)練出來(lái)的ResNet50_vd,ResNet101_vd和MobileNetV3_large_x1_0,其中比較特殊的幾個(gè)模型,EffcientNetB0_small是去掉SE模塊的EffcientNetB0,在保證精度變化不大的同時(shí),大幅提升訓(xùn)練和推理速度,ResNeXt101_32x16d_wsl 是基于超大量圖片的弱監(jiān)督預(yù)訓(xùn)練模型,準(zhǔn)確率高,但預(yù)測(cè)時(shí)間相對(duì)增加,Res2Net101_vd_26w_4s則是在單個(gè)殘差塊內(nèi)進(jìn)一步構(gòu)造了分層的殘差類連接,比ResNet101準(zhǔn)確度更高。

并且,為了進(jìn)一步提升圖像分類模型的模型效果,在訓(xùn)練層面,圖像分類新增了mix_up和label_smoothing功能,可以在單標(biāo)簽分類任務(wù)中,根據(jù)模型的訓(xùn)練情況選擇開(kāi)啟或者關(guān)閉。mix_up是一種數(shù)據(jù)增強(qiáng)方式,它從訓(xùn)練樣本中隨機(jī)抽取了兩個(gè)樣本進(jìn)行簡(jiǎn)單的隨機(jī)加權(quán)求和,并保存這個(gè)權(quán)重,同時(shí)樣本的標(biāo)簽也對(duì)應(yīng)地用相同的權(quán)重加權(quán)求和,然后預(yù)測(cè)結(jié)果與加權(quán)求和之后的標(biāo)簽求損失,通過(guò)混合不同樣本的特征,能夠減少模型對(duì)錯(cuò)誤標(biāo)簽的記憶力,增強(qiáng)模型的泛化能力。Label_smoothing是一種正則化的方法,增加了類間的距離,減少了類內(nèi)的距離,避免模型對(duì)預(yù)測(cè)結(jié)果過(guò)于confident而導(dǎo)致對(duì)真實(shí)情況的預(yù)測(cè)偏移,一定程度上緩解由于label不夠soft導(dǎo)致過(guò)擬合的問(wèn)題。

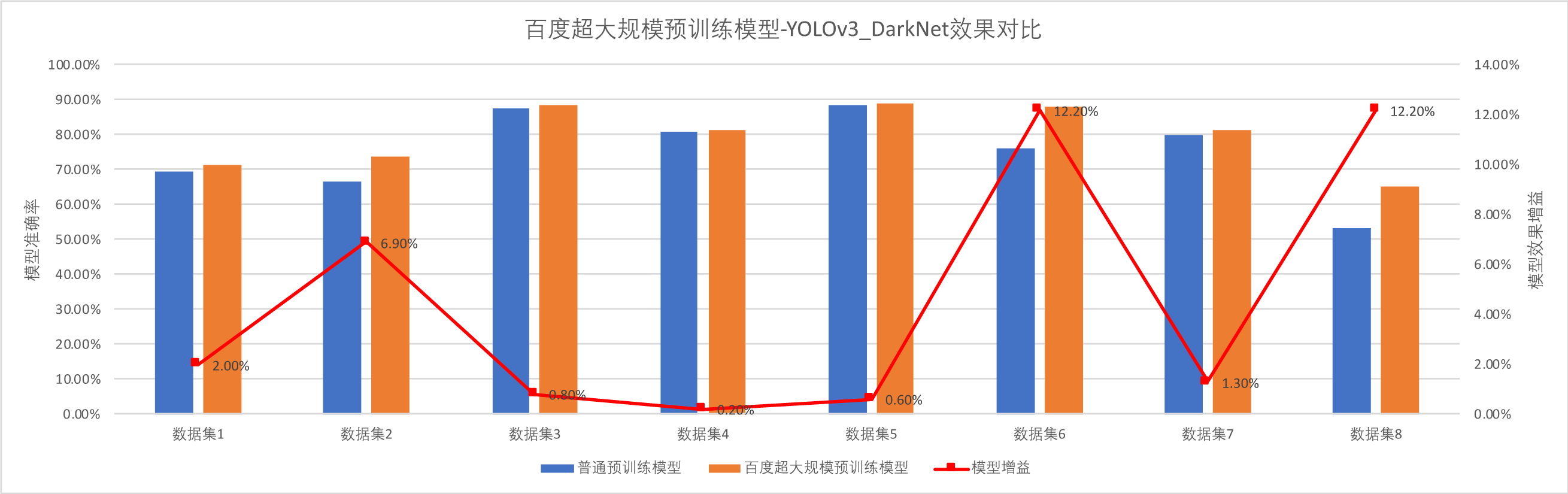

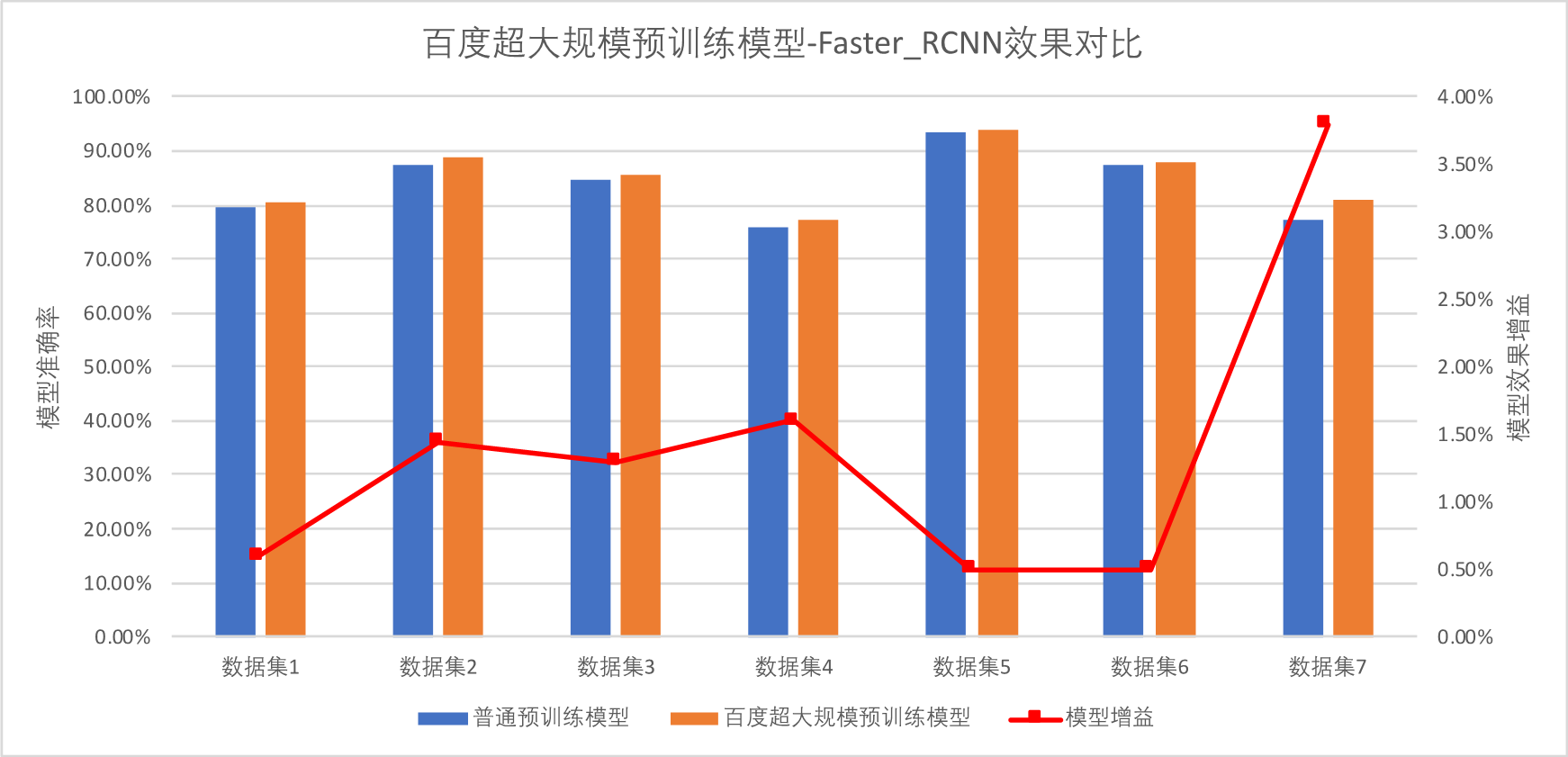

物體檢測(cè)

在物體檢測(cè)模型中,使用百度超大規(guī)模預(yù)訓(xùn)練模型的YOLOv3_DarkNet相比普通模型在各類數(shù)據(jù)集上模型效果平均提升4.53 %,使用百度超大規(guī)模預(yù)訓(xùn)練模型的Faster_RCNN,相比于普通預(yù)訓(xùn)練模型,平均提升1.39%。

并且,在物體檢測(cè)方向,EasyDL內(nèi)置基于百度超大規(guī)模預(yù)訓(xùn)練模型訓(xùn)練出來(lái)的YOLOv3_Darknet、Faster_R-CNN_ResNet50_FPN,其中,Cascade_Rcnn_ResNet50_FPN通過(guò)級(jí)聯(lián)多個(gè)檢測(cè)器以及設(shè)置不同IOU的重采樣機(jī)制,使得檢測(cè)器的精度、和定位的準(zhǔn)確度進(jìn)一步提升。此外,針對(duì)用戶的需求,新增兩種YOLOv3的變種模型,其中,YOLOv3_MobileNetV1,是將原來(lái)的YOLOv3骨架網(wǎng)絡(luò)替換為MobileNetv1,相比YOLOv3_DarkNet, 新模型在GPU上的推理速度提升約73%。而YOLOv3_ResNet50vd_DCN是將骨架網(wǎng)絡(luò)更換為ResNet50-VD,相比原生的DarkNet53網(wǎng)絡(luò)在速度和精度上都有一定的優(yōu)勢(shì),在保證GPU推理速度基本不變的情況下,提升了1%的模型效果,同時(shí),因增加了可形變卷積,對(duì)不規(guī)則物體的檢測(cè)效果也有一定的正向提升。

綜合多項(xiàng)數(shù)據(jù)可以發(fā)現(xiàn),百度超大規(guī)模視覺(jué)預(yù)訓(xùn)練模型對(duì)比公開(kāi)數(shù)據(jù)集訓(xùn)練的預(yù)訓(xùn)練模型,效果提升明顯。

EasyDL零門檻高效定制高精度AI模型

百度EasyDL是基于飛槳深度學(xué)習(xí)平臺(tái),面向企業(yè)開(kāi)發(fā)者推出的零門檻AI開(kāi)發(fā)平臺(tái),一站式支持智能標(biāo)注、模型訓(xùn)練、服務(wù)部署等全流程功能,內(nèi)置豐富的預(yù)訓(xùn)練模型,支持圖像分類、物體檢測(cè)、文本分類、音視頻分類等多類模型,支持公有云/私有化/設(shè)備端等靈活部署方式。EasyDL目前已在工業(yè)、零售、制造、醫(yī)療等領(lǐng)域廣泛落地。

在模型的開(kāi)發(fā)與應(yīng)用過(guò)程中,從數(shù)據(jù)準(zhǔn)備、模型訓(xùn)練到服務(wù)部署,開(kāi)發(fā)者在每個(gè)環(huán)節(jié)都可能面對(duì)不同的門檻與難點(diǎn)。

在數(shù)據(jù)準(zhǔn)備階段,如何針對(duì)業(yè)務(wù)需求選擇適當(dāng)?shù)挠?xùn)練數(shù)據(jù)并正確標(biāo)注?

進(jìn)入到模型訓(xùn)練環(huán)節(jié),如何選擇恰當(dāng)?shù)哪P停仍撊绾翁嵘?/em>

到達(dá)部署的“最后一公里”,硬件如何選型,又如何快速完成業(yè)務(wù)集成?

解答疑問(wèn)的機(jī)會(huì)來(lái)了!

本周六,AI快車道降臨“世界歷史名城”西安,開(kāi)源框架高階營(yíng)也將由百度資深研發(fā)工程師們,從開(kāi)發(fā)全流程、目標(biāo)檢測(cè)、“全能”OCR、最前沿的NLP技術(shù)、部署工具、昆侖芯片六大方向展開(kāi)深度講解,歡迎有AI應(yīng)用的、熱愛(ài)深度學(xué)習(xí)技術(shù)等尋求技術(shù)突破的開(kāi)發(fā)者們來(lái)【高新希爾頓酒店7層3號(hào)廳】進(jìn)行交流,期待在這樣一個(gè)歷史、科研、教育、工業(yè)都重點(diǎn)發(fā)展的城市與大家共建AI之路!

同日,AI快車道【EasyDL零門檻模型開(kāi)發(fā)營(yíng)】也在【西安高新希爾頓酒店7層1號(hào)廳】,百度資深研發(fā)高工將會(huì)用半天時(shí)間,深入淺出講解技術(shù)原理、結(jié)合業(yè)務(wù)與技術(shù)解析行業(yè)標(biāo)桿案例,手把手帶領(lǐng)學(xué)員完成模型開(kāi)發(fā)!更有設(shè)備端模型技術(shù)原理介紹與展示、研發(fā)現(xiàn)身說(shuō)法分享多年累計(jì)模型效果提升經(jīng)驗(yàn),助你短時(shí)間超高效取得EasyDL模型開(kāi)發(fā)真經(jīng)!

同時(shí),也會(huì)在線上同步直播,掃描海報(bào)二維碼或點(diǎn)擊報(bào)名鏈接,報(bào)名進(jìn)群獲取完整課表與直播鏈接!

報(bào)名鏈接:https://paddle.wjx.cn/jq/93404058.aspx?udsid=793872