解決機(jī)器學(xué)習(xí)最大弊病?馬普所聯(lián)合Google再探「因果學(xué)習(xí)」

當(dāng)你看到一個(gè)棒球運(yùn)動(dòng)員擊球時(shí),你可以推斷出不同元素之間的因果關(guān)系:

例如,在看到球棒和棒球運(yùn)動(dòng)員的手臂同步移動(dòng)之后,你可以知道,是球員的手臂導(dǎo)致了球棒的移動(dòng),而不是球棒的移動(dòng)導(dǎo)致了球員手臂的移動(dòng)。

此外,你也不需要?jiǎng)e人告訴才知道球棒正在引起球運(yùn)動(dòng)方向的突然改變。

這些推論是我們?nèi)祟惖闹庇X,我們?cè)诤苄〉臅r(shí)候就擁有了它——沒有人明確指導(dǎo)這件事情,僅僅通過觀察這個(gè)世界就可以。

但是對(duì)于在圍棋、國(guó)際象棋等復(fù)雜任務(wù)中成功超越人類的機(jī)器學(xué)習(xí)算法來說,因果關(guān)系的推理仍然是一個(gè)大的挑戰(zhàn)。

機(jī)器學(xué)習(xí)算法,尤其是深度神經(jīng)網(wǎng)絡(luò),尤其擅長(zhǎng)從大量數(shù)據(jù)中找到微妙的模式,它們可以實(shí)時(shí)轉(zhuǎn)錄音頻,每秒標(biāo)注數(shù)千張的圖像和視頻幀,并檢查x射線和核磁共振掃描出的癌癥模式。

然而,它們很難做出簡(jiǎn)單的因果推論,就好比剛才提到的棒球例子。

在一篇名為「因果表示學(xué)習(xí)」(Towards Causal Representation Learning)的文章中,馬普所的智能系統(tǒng)研究部、蒙特利爾研究所的算法學(xué)習(xí)部以及Google Rsearch的研究人員討論了針對(duì)因果學(xué)習(xí)的一系列問題——他們研究了機(jī)器學(xué)習(xí)模型中缺乏因果表示所帶來的挑戰(zhàn),并且提供了創(chuàng)建可以學(xué)習(xí)因果表示的人工智能系統(tǒng)的啟示和方向。

這篇研究,可能是突破機(jī)器學(xué)習(xí)中的因果表示領(lǐng)域中一些主要挑戰(zhàn)的關(guān)鍵。

機(jī)器學(xué)習(xí)為何受限?原來是常見假設(shè)「惹的禍」

為什么機(jī)器學(xué)習(xí)不能超越其所在的狹窄的領(lǐng)域,并收到訓(xùn)練數(shù)據(jù)的限制?

針對(duì)這個(gè)問題,在這篇論文中,作者表示道:

「機(jī)器學(xué)習(xí)經(jīng)常忽略動(dòng)物大量使用的信息:比如對(duì)世界的干預(yù)、領(lǐng)域轉(zhuǎn)移、時(shí)間結(jié)構(gòu)等。

總的來說,我們「討厭」這些因素,并試圖把他們?cè)O(shè)計(jì)出來。」

「與此一致的是,目前機(jī)器學(xué)習(xí)的大多數(shù)成功,都?xì)w結(jié)于對(duì)適當(dāng)收集得來的獨(dú)立和同分布(i.i.d.) 數(shù)據(jù)進(jìn)行的大規(guī)模模式識(shí)別。」

在這里,我們需要簡(jiǎn)單介紹一下一個(gè)常見的機(jī)器學(xué)習(xí)術(shù)語:「i.i.d.」

這個(gè)術(shù)語主要假設(shè)問題空間中的隨機(jī)觀測(cè)不相互依賴,且有恒定的發(fā)生概率——一個(gè)最簡(jiǎn)單的例子就是拋硬幣或者擲骰子。

當(dāng)涉及到計(jì)算機(jī)視覺等更加復(fù)雜的領(lǐng)域的時(shí)候,機(jī)器學(xué)習(xí)工程師試圖通過在非常大的樣本集上訓(xùn)練模型將問題轉(zhuǎn)化為i.i.d.領(lǐng)域中。

這么做的假設(shè)是,如果有足夠的例子,機(jī)器學(xué)習(xí)模型可以將問題的一般分布編碼到它的參數(shù)中。

但是在現(xiàn)實(shí)世界中,由于訓(xùn)練數(shù)據(jù)中無法考慮和控制的因素,這一分布往往會(huì)發(fā)生變化——

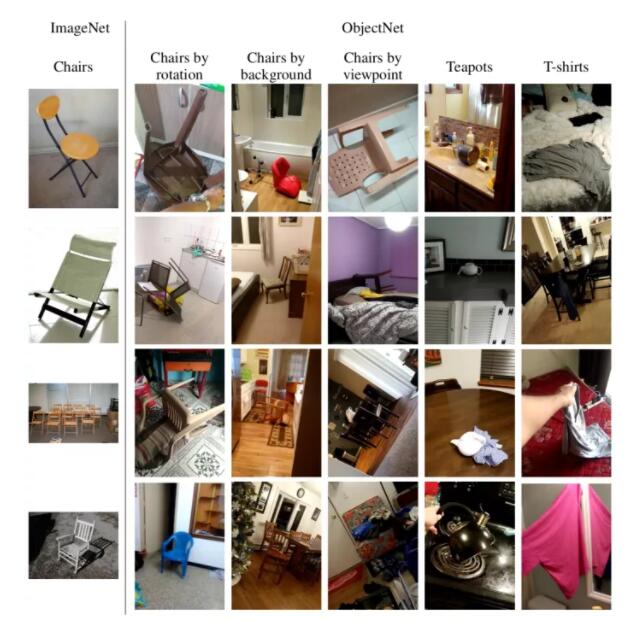

比如,即使是訓(xùn)練了數(shù)百萬張圖像的卷積神經(jīng)網(wǎng)絡(luò),當(dāng)在新的光照條件下、從略微不同的角度或者新的背景下「看」到物體時(shí),也可能會(huì)失敗。

在訓(xùn)練集中的物體vs在現(xiàn)實(shí)生活中的物體

解決這些問題的努力主要包括在更多的例子上訓(xùn)練機(jī)器學(xué)習(xí)模型。但是,隨著環(huán)境變的越來越復(fù)雜,通過增加更多的訓(xùn)練實(shí)例來覆蓋整個(gè)分布就變得不太可能。在人工智能必須與世界互動(dòng)的領(lǐng)域,比如機(jī)器人和自動(dòng)駕駛汽車,這個(gè)情況就變得更為顯著。

缺乏對(duì)因果關(guān)系的理解使得我們很難做出預(yù)測(cè),也很難處理新的情況——這也就是為什么你會(huì)看到自動(dòng)駕駛汽車在經(jīng)過數(shù)百萬英里的訓(xùn)練之后,卻仍然會(huì)犯奇怪和危險(xiǎn)的錯(cuò)誤的原因。

研究人員寫道:

「要在i.i.d.環(huán)境之外對(duì)對(duì)象進(jìn)行很好的概括,不僅需要學(xué)習(xí)變量之間的統(tǒng)計(jì)關(guān)聯(lián),還需要學(xué)習(xí)一個(gè)潛在的因果模型。」

因果模型還允許人們將以前獲得的知識(shí)應(yīng)用于新的領(lǐng)域。

例如,當(dāng)你學(xué)習(xí)了一款即時(shí)戰(zhàn)略游戲,比如《魔獸爭(zhēng)霸》,你可以快速的將你的知識(shí)應(yīng)用于其他類似的游戲《星際爭(zhēng)霸》和《帝國(guó)時(shí)代》中。

然而,機(jī)器學(xué)習(xí)算法的遷移學(xué)習(xí)僅限于非常膚淺的用途:比如微調(diào)圖像分類器來檢測(cè)新類型的對(duì)象。

在更復(fù)雜的任務(wù)中,比如學(xué)習(xí)電子游戲,機(jī)器學(xué)習(xí)模型需要大量的訓(xùn)練(需要玩數(shù)千年),并且對(duì)環(huán)境的微小變化反應(yīng)很差(例如,開啟新地圖或者規(guī)則的微小變化)。

「當(dāng)學(xué)習(xí)一個(gè)因果模型時(shí),我們應(yīng)該需要更少的例子來適應(yīng)大多數(shù)知識(shí),比如創(chuàng)造一個(gè)模塊,這樣這個(gè)模型可以在不需要進(jìn)一步訓(xùn)練的情況下重用。」

克服外界干擾,各種條件下因果學(xué)習(xí)依然「穩(wěn)的一批」

如上文所說,為什么i.i.d.有這些已知的弱點(diǎn),卻仍然是機(jī)器學(xué)習(xí)的主導(dǎo)形式?

那是因?yàn)椋兇饣谟^察的方法是可以擴(kuò)展的:

我們可以通過添加更多的訓(xùn)練數(shù)據(jù),來繼續(xù)實(shí)現(xiàn)精度的增量提高,此外,我們還可以通過添加更多的計(jì)算能力來加速訓(xùn)練過程。

事實(shí)上,深度學(xué)習(xí)最近取得成功的一個(gè)關(guān)鍵因素,就是更多可用的數(shù)據(jù),以及更加強(qiáng)大的處理器。

此外,基于i.i.d.的模型很容易評(píng)估:

首先,我們獲取一個(gè)大型數(shù)據(jù)集,將其拆分為訓(xùn)練集和測(cè)試集,然后對(duì)訓(xùn)練數(shù)據(jù)調(diào)整模型,并通過測(cè)量其在測(cè)試集上的預(yù)測(cè)精度來驗(yàn)證其性能,接著繼續(xù)訓(xùn)練,直到達(dá)到所需的精度。

目前,已經(jīng)有很多公共數(shù)據(jù)集提供了這樣的基準(zhǔn)測(cè)試,比如ImageNet、CIFAR-10和MNIST。此外,如COVID-19診斷的covid - x數(shù)據(jù)集和威斯康星州乳腺癌診斷數(shù)據(jù)集之類具有特定任務(wù)的數(shù)據(jù)集也是如此。

在所有情況下,我們所要面對(duì)的挑戰(zhàn)都是一樣的——那就是開發(fā)一個(gè)可以根據(jù)統(tǒng)計(jì)規(guī)律預(yù)測(cè)結(jié)果的機(jī)器學(xué)習(xí)模型。

然而,正如該論文作者所觀察到的一樣,精確的預(yù)測(cè)往往不足以為決策提供信息。

例如,在新冠病毒大流行期間,許多機(jī)器學(xué)習(xí)系統(tǒng)開始失敗,因?yàn)樗麄冇?xùn)練針對(duì)的是統(tǒng)計(jì)規(guī)律,而不是因果關(guān)系。隨著生活模式的改變,模型的準(zhǔn)確性下降了。

當(dāng)外界的干預(yù)改變了一個(gè)問題的統(tǒng)計(jì)分布時(shí),因果模型仍然是穩(wěn)健的。

比如,當(dāng)你第一次看到一個(gè)物體時(shí),你的大腦會(huì)下意識(shí)地從它的外觀中排除光線因素,這也就是為什么我們?cè)谛碌墓庹諚l件下看到一個(gè)物體時(shí)可以認(rèn)出它的原因。

此外,因果模型還允許我們對(duì)之前沒見過的情況作出反應(yīng),并思考反事實(shí):我們不需要把車開下懸崖才知道會(huì)發(fā)生什么。

反事實(shí)在減少機(jī)器學(xué)習(xí)模型所需要的訓(xùn)練實(shí)例數(shù)量方面發(fā)揮了重要作用。

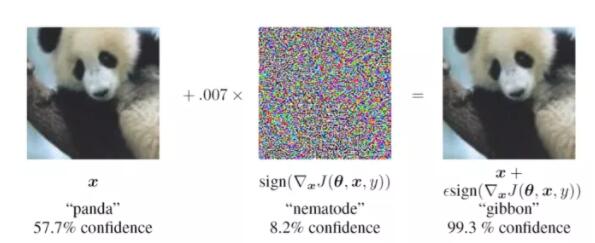

因果關(guān)系在處理對(duì)抗攻擊的時(shí)候也很關(guān)鍵——如果添加一些微小的變化,機(jī)器學(xué)習(xí)系統(tǒng)會(huì)以意想不到的方式失敗。

「這些攻擊顯然違反了作為統(tǒng)計(jì)機(jī)器學(xué)習(xí)基礎(chǔ)的i.i.d.假設(shè)」,論文作者寫道。

此外,論文作者還補(bǔ)充道,對(duì)抗性漏洞證明了人類智能和機(jī)器學(xué)習(xí)算法的魯棒性機(jī)制存在差異。

研究人員指出,因果模型可能是「對(duì)抗」對(duì)抗性攻擊的一種可能防御方法。

對(duì)抗攻擊目標(biāo)機(jī)器學(xué)習(xí)對(duì)先驗(yàn)知識(shí)的敏感度。在這幅圖像中,如果添加一層覺察不到的的噪聲,那么,卷積神經(jīng)網(wǎng)絡(luò)就會(huì)誤判其成長(zhǎng)臂猿

從廣義上講,因果關(guān)系可以解決機(jī)器學(xué)習(xí)缺乏泛化性的問題。研究人員寫道:「公平地說,大多數(shù)當(dāng)前的實(shí)踐(解決i.i.d.基準(zhǔn)問題)和大多數(shù)理論結(jié)果(關(guān)于在i.i.d.設(shè)置中的泛化性)都未能解決跨問題泛化的嚴(yán)峻挑戰(zhàn)。」

將因果關(guān)系添加到機(jī)器學(xué)習(xí)模型,未來前景如何?

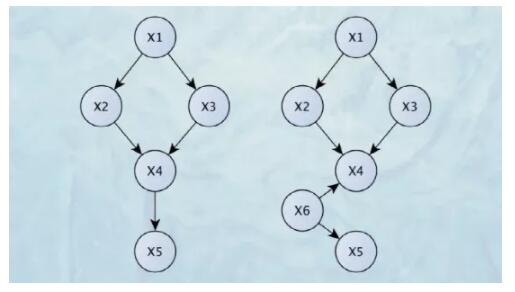

在這篇論文中,研究人員還匯集了一些概念和原則,這些概念和原則,對(duì)于創(chuàng)建因果機(jī)器學(xué)習(xí)模型至關(guān)重要。

其中的兩個(gè)概念包括「結(jié)構(gòu)因果模型」和「獨(dú)立因果模型」。

總的來說,該原則表明,AI系統(tǒng)應(yīng)該可能夠識(shí)別因果變量,并分離他們對(duì)環(huán)境的影響,而不是尋找表面的統(tǒng)計(jì)相關(guān)性。

這種機(jī)制使得模型可以檢測(cè)不同的對(duì)象,而不用考慮視角、背景、照明和其他噪音等因素。

理清這些因果變量,將使得人工智能系統(tǒng)在應(yīng)對(duì)不可預(yù)測(cè)的變化和外界干預(yù)的時(shí)候表現(xiàn)更加穩(wěn)健。因此,因果人工智能模型不需要龐大的訓(xùn)練數(shù)據(jù)集。

「一旦因果模型可用,無論是通過外部人類知識(shí)還是學(xué)習(xí)過程,因果推理都可以允許(它)對(duì)干預(yù)、反事實(shí)和潛在結(jié)果得出結(jié)論」,論文作者表示。

此外,作者還探索了如何將這些概念應(yīng)用于機(jī)器學(xué)習(xí)的不同分支,其中就包括強(qiáng)化學(xué)習(xí)——這對(duì)于智能代理嚴(yán)重依賴于探索環(huán)境和通過試錯(cuò)發(fā)現(xiàn)解決方案的問題至關(guān)重要。

因果結(jié)構(gòu)可以幫助強(qiáng)化學(xué)習(xí)的訓(xùn)練更加有效,因?yàn)樗试S使主體從訓(xùn)練的一開始就做出明智的決定,而不是采取隨機(jī)和非理性的行動(dòng)。

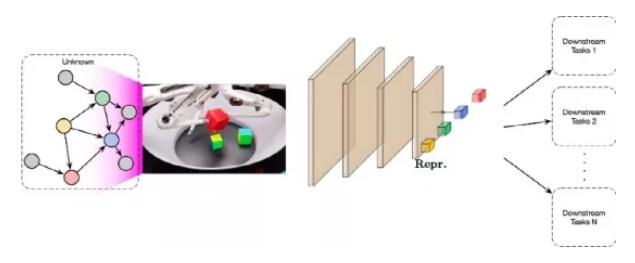

結(jié)合機(jī)器學(xué)習(xí)機(jī)制和結(jié)構(gòu)因果模型,研究人員為人工智能系統(tǒng)提供了想法:

「結(jié)合結(jié)構(gòu)因果建模和表示學(xué)習(xí),我們應(yīng)該努力講SCM嵌入到更大的機(jī)器學(xué)習(xí)模型中,這些模型的輸入和輸出可能是高維非結(jié)構(gòu)化的,但SCM至少可以運(yùn)作這些內(nèi)部系統(tǒng)的一部分。

其結(jié)果可能是一個(gè)模塊化的架構(gòu),不同的模塊可以單獨(dú)調(diào)整,并用于新的任務(wù)。」

這些概念使得我們更接近于在大腦的不同領(lǐng)域和區(qū)域間連接和重用知識(shí)和技能的人類思維。

然而,值得注意的是,本文中提出的想法時(shí)在概念層面上的。

但有趣的事,研究人員從該領(lǐng)域的許多并行工作中獲得了靈感。這篇論文的引用中包含了朱迪亞·珀?duì)査龅墓ぷ鳎且晃猾@得圖靈獎(jiǎng)的科學(xué)家,這位科學(xué)家以其在因果推理方面的工作而聞名。

珀?duì)栔毖圆恢M地批評(píng)了純深度學(xué)習(xí)方法。與此同時(shí),這篇論文的共同作者之一、另一位圖靈獎(jiǎng)得主Yoshua Bengio是深度學(xué)習(xí)的先驅(qū)之一。

本文還包含了一些與加里·馬庫(kù)斯(Gary Marcus)提出的混合人工智能模型相似的想法,該模型將符號(hào)系統(tǒng)的推理能力與神經(jīng)網(wǎng)絡(luò)的模式識(shí)別能力相結(jié)合。

雖然目前還不清楚這幾種方法中哪一種能夠幫助解決機(jī)器學(xué)習(xí)的因果關(guān)系問題,但來自不同思想流派的觀點(diǎn)匯集在一起可以保證會(huì)產(chǎn)生有趣的結(jié)果。

「就其核心而言,i.i.d.模式識(shí)別只是一種數(shù)學(xué)抽象,而因果關(guān)系對(duì)于大多數(shù)形式的有生命的學(xué)習(xí)來說可能是必不可少的」,作者寫道。

「到目前為止,機(jī)器學(xué)習(xí)一直忽略了因果關(guān)系的完整整合,而本文認(rèn)為,整合因果概念確實(shí)會(huì)讓機(jī)器學(xué)習(xí)受益。」