瑞萊智慧RealAI打造人工智能安全技術工具 推動行業可信發展

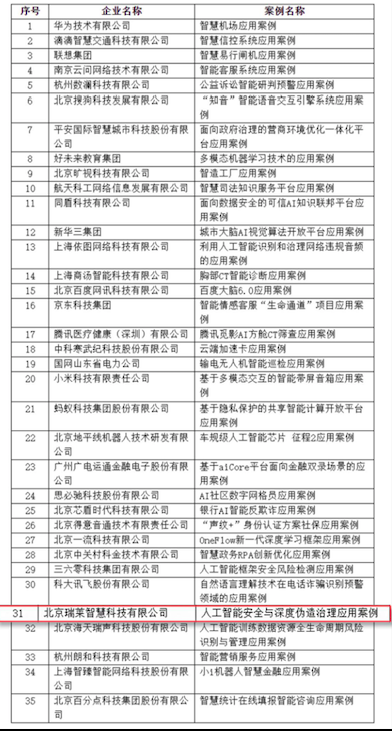

4月26日,由國家互聯網信息辦公室主辦人工智能分論壇舉辦,論壇以“人工智能—社會實驗視角下的社會治理”為主題。各產業相關領域專家代表一同圍繞人工智能發展可能帶來的風險和問題,探討人工智能賦能社會治理的規律和經驗,共同推進人工智能產業健康發展。論壇期間,由中央網信辦信息化發展局組織評選的“人工智能企業典型應用案例”正式發布,本次案例評選在發現和挖掘人工智能行業的最新場景和杰出企業,進一步推動我國人工智能健康穩定發展。經人工智能社會實驗專家組評審,瑞萊智慧RealAI的“人工智能安全與深度偽造治理應用案例”成功入選,與華為、百度、曠視、商湯、依圖等企業共同位列其中。

瑞萊智慧RealAI CEO田天介紹,由于當前的人工智能仍處在初級階段,算法本身存在不安全、不可解釋等結構性缺陷,這就導致技術漏洞可能被用于惡意攻擊,通過對抗性數據污染、算法修改、惡意樣本等方式對算法進行深層次攻擊,讓人工智能系統“精神紊亂”,以高置信度給出錯誤輸出。這產生的后果將可能威脅到人類財產生命安全。比如通過佩戴特定設計、有對抗攻擊能力的眼鏡等實體物件,導致能夠攻破手機解鎖、線上身份認證、線下安防等領域的AI系統,讓安全驗證形同虛設。甚至在交通領域,車輛的輔助駕駛或自動駕駛系統也可能因為AI算法缺陷而喪失正常的視覺識別能力,錯誤識別交通指示牌、“看不到”大型障礙物等,嚴重威脅人身和財產安全。

本次論壇主題切實討論人工智能發展可能帶來的風險和問題,作為“人工智能企業典型應用案例”入選企業,瑞萊智慧RealAI的“人工智能安全與深度偽造治理應用案例”為治理工作提出了有效技術方案。據介紹,北京瑞萊智慧科技有限公司是孵化自清華人工智能研究院的官方產學研機構,依托其自身“產學研”一體化優勢,瑞萊智慧創新性地提出了“攻防動態平衡”機制,以子之矛、攻子之盾,通過攻防對抗不斷升級,演練出針對性的防御技術。通過對抗性算法研究,先于黑客發現并修補漏洞,避免攻擊隱患;通過生成更為逼真的深度偽造視頻,再訓練出更為領先的檢測算法。

在此基礎上,瑞萊智慧RealAI打造出一套完備且行之有效的技術工具來輔助解決人工智能安全問題。比如,業內首個人工智能安全平臺RealSafe,通過集成領先攻防算法,支持對AI系統進行自動化的安全檢測與防御加固,提升AI系統對對抗樣本等攻擊手段的識別能力。在應對濫用方面,瑞萊智慧推出DeepReal深度偽造檢測工具和一體機,能夠高效精準的判斷視頻、圖片等內容素材是否是經過AI偽造,能夠有效避免輿情、預警濫用等。這次入選的“人工智能安全與深度偽造治理應用案例”也正是基于這兩大技術平臺打造,能夠有效避免人工智能落地應用過程面臨的潛在安全隱患。

當前,人工智能研究高度開放,這也導致人工智能技術的濫用風險激增,直接性造成風險漏洞的出現。此外,人工智能既有多學科綜合、高度復雜等特性,帶有天然的技術壁壘,給監管部門的監督管理和風險防范提出了不小的挑戰。

同時也有專家表示,人工智能設計者的價值導向和行為偏好易于被有意或無意地反映到算法、數據當中,并通過機器學習被人工智能所承繼,進而演進為算法歧視。而在具體適用過程中,容易受到對抗樣本的干擾或污染,被應用者二次形塑,做出背離設計初衷的錯誤決策。專家重點提到,在人工智能飛速發展的當下,安全問題日益凸顯,需要我們加強對潛在風險的研判和防范,切實維護好利益和安全,確保人工智能安全可靠、可控。

田天表示,人工智能治理是一個長期的工作,“技術”與“制度”需同步推進,前者解決技術的不安全性與脆弱性,后面從應用層面給出規范與指引。