美版“騰訊停更APP”,美國對“AI算法”立法,未審核禁止發布

前幾天,騰訊公司旗下產品存在違規,被累計通報達4批次。工信部對騰訊采取過渡性指導措施,所有APP上新或者發布新版本,都必須經過工信部技組織技術檢測,合格后方能正常上架。

近幾年來,中國正在不斷加強對互聯網監管,取得極為明顯的成績,APP各種彈窗、誘導點擊、惡意索取權限的現象基本上消失。

世界各國也緊跟中國腳步,就在上個月,美國紐約市通過了一項法律,雇主在招聘或者提拔員工時,使用的人工智能算法必須進行審計,審計不通過將不能使用。此外,當人工智能在招聘或者提拔員工時,發揮了什么作用,還必須告訴求職者。

曾在紐約自動化決策系統工作組任職的紐約大學副教授Julia Stoyanovich表示,她和學生最近檢查了一種招聘工具,發現它會根據應聘者的畢業院校、口音、是否戴眼鏡等條件,來給招聘者打分。

除了紐約州,美國其他州也不甘寂寞。在華盛頓特區,國會議員正在起草一項法案,要求企業評估用于醫療保健、住房、就業或教育等領域的自動化決策系統,并將調查結果報告給聯邦貿易委員會。

美國特供版“人工智能”

為什么美國開始加強對“AI”的監管?答案竟然是無處不在的“種族歧視。”

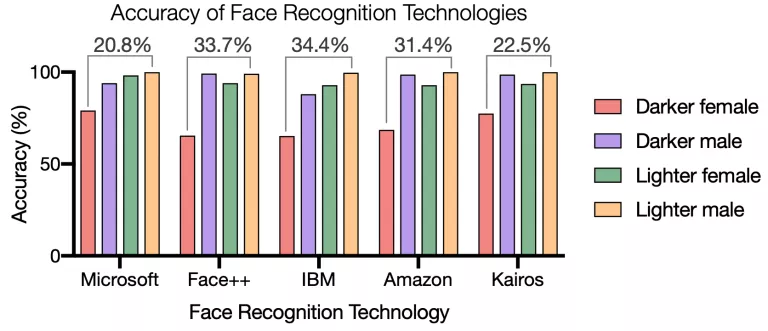

美國是一個多人種的移民國家,因為技術原因,人工智能對不同人種的識別率都不太一樣。美國國家標準與技術研究員曾經做過一項研究,發現189種人臉識別算法,對有色人種女性的識別準確率最低,卻對淺膚色男性識別的準確率最高。

這就涉及到兩個問題“性別歧視”和“種族歧視。”美國對后者尤為敏感。

因為人工智能的這一缺點,美國曾經發生過多起因人工智能引起的糾紛。一名密歇根男子,因為人工智能識別錯誤的原因,不得不申請破產;租客自動篩選工具傷害了許多買房或者租房的有色人種。

在Facebook上,由于人工智能的存在,黑人比起白人更容易被誤判;自動化評分系統,會對學生和老師進行打分,卻更容易將深色膚色的人,標記為在考試中作弊……

中國規范人工智能

在中國,規范人工智能技術更多考慮的是被濫用的問題。

今年315晚會上,曝光了人臉識別被濫用的問題。科勒衛浴等商家在眾多門店安全人臉攝像頭,未經用戶同意,就將人臉信息、性別、年齡和衣著記錄下來,對客戶進行分類。店員即可根據顧客的特點精準營銷。

一些旅游景點、小區門禁強制游客或者業主使用人臉識別的報道也屢見不鮮。

為此,中國陸陸續續出臺了許多法律法規文件進行規范。特別是在今年8月份,中國國家互聯網信息辦公室發布了《關于加強互聯網信息服務算法綜合治理的指導意見》,它被美國科技和創業新聞門戶網站Venturebeat 認為,是迄今為止管理人工智能系統最全面的文件,在這方面,沒有哪個國家比中國走得更遠。