英偉達新核彈GPU:4nm制程800億晶體管,全新Hopper架構太炸了

本文經AI新媒體量子位(公眾號ID:QbitAI)授權轉載,轉載請聯系出處。

他來了他來了,老黃帶著英偉達的最新一代GPU來了。

之前大家猜的5nm錯了,一手大驚喜,老黃直接上了臺積電4nm工藝。

新卡取名H100,采用全新Hopper架構,直接集成了800億個晶體管,比上一代A100足足多了260億個。

內核數量則飆到了前所未有的16896個,達到上一代A100卡的2.5倍。

浮點計算和張量核心運算能力也隨之翻了至少3倍,比如FP32就達到了達到60萬億次/秒。

特別注意的是,H100面向AI計算,針對Transformer搭載了優化引擎,讓大模型訓練速度直接×6。

(可算知道5300億參數的威震天-圖靈背后的秘訣了。)

作為一款性能爆炸的全新GPU,不出意外,H100將與前輩V100、A100一樣成為AI從業者心心念念的大寶貝。

不過不得不提,它的功耗也爆炸了,達到了史無前例的700W,重回核彈級別。

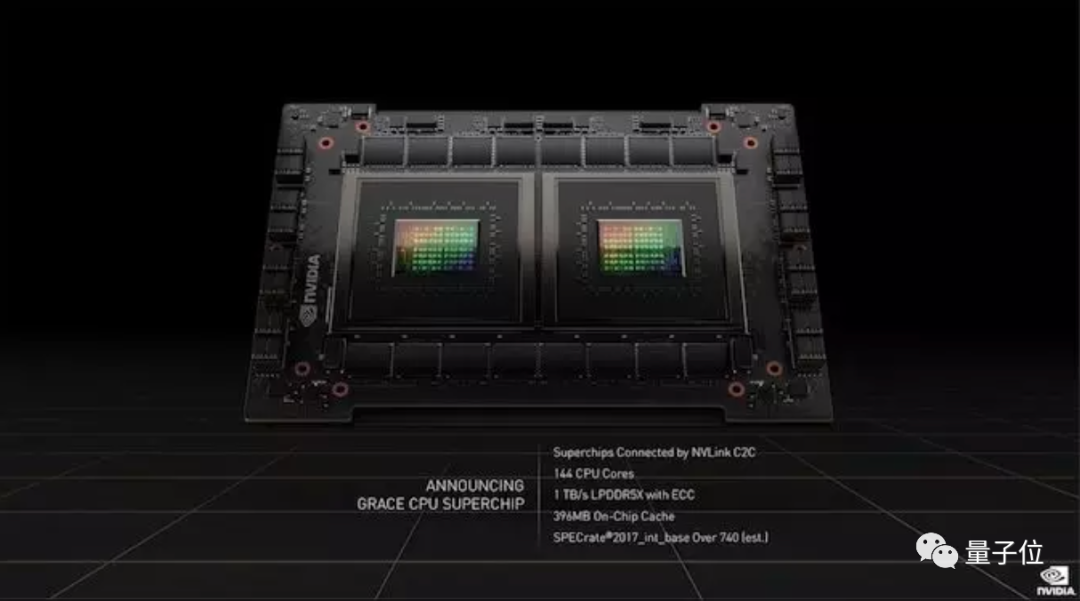

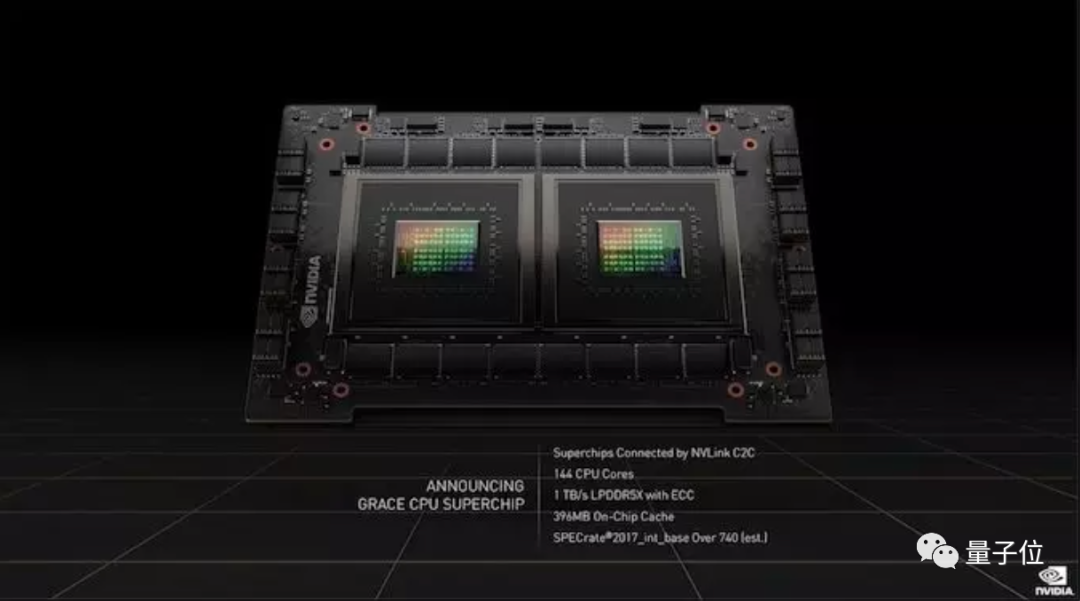

關于自研的Grace CPU,這次大會也公布了更多細節。

沒想到,老黃從庫克那里學來一手1+1=2,兩塊CPU“粘”在一起組成了CPU超級芯片——Grace CPU Superchip。

Grace CPU采用最新Arm v9架構,兩塊總共擁有144個核心,擁有1TB/s的內存帶寬,比蘋果最新M1 Ultra的800GB/s還高出一截。

基于全新CPU、GPU基礎硬件,這次發布會也帶來了下一代企業級AI基礎設施DXG H100、全球最快AI超算Eos。

當然,英偉達作為真正的元宇宙先驅,也少不了Omniverse上的新進展。

下面具體來看看。

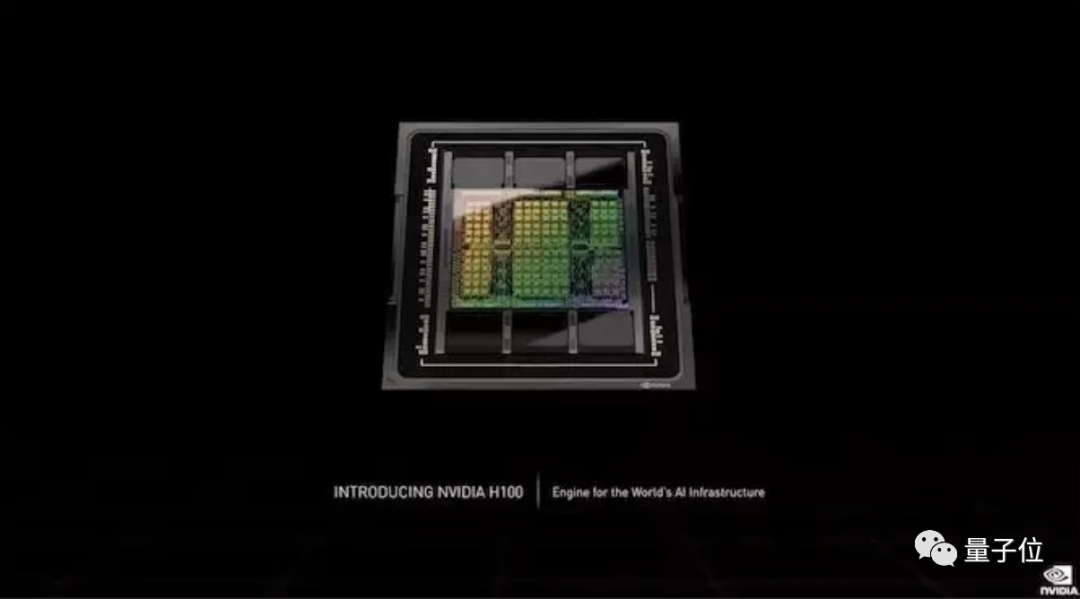

首款Hopper架構GPU,性能暴增

作為上一代GPU架構A100(安培架構)的繼承者,搭載了全新Hopper架構的H100有多突飛猛進?

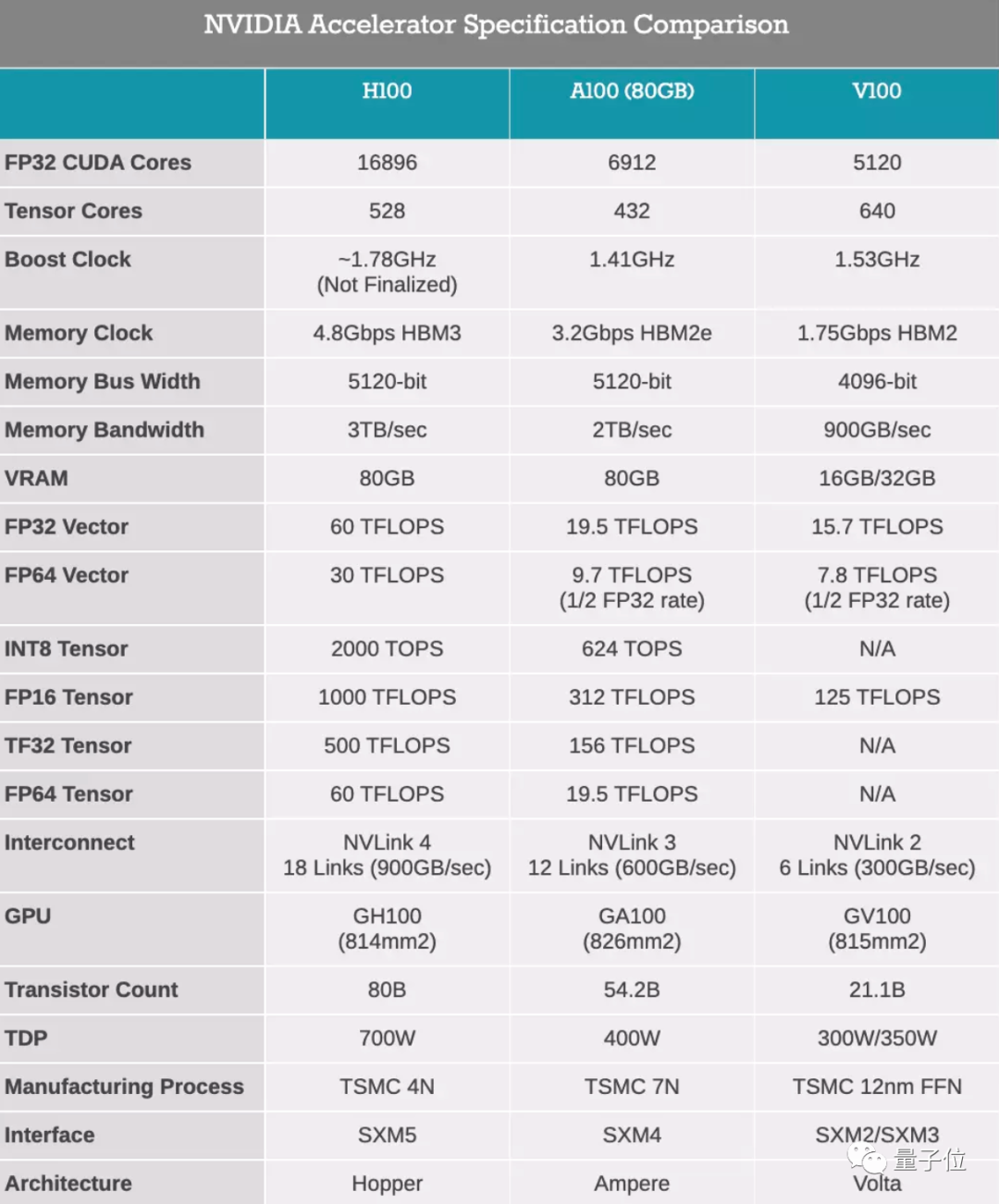

話不多說,先上參數:

老黃可謂下血本,先是直接采用了臺積電4nm工藝,晶體管一口氣集成了800億個。

要知道,上一代A100還只是7nm架構,這次發布會出來前,外界不少聲音猜測老黃會用5nm制程,結果一發布就給大家來了個大驚喜。

最恐怖的是CUDA核心直接飆升到了16896個,直接達到了A100的近2.5倍。(要知道從V100到A100的時候,核心也不過增加那么一絲絲)

這次可不能感慨老黃刀法精準了。

再看浮點運算和INT8/FP16/TF32/FP64的張量運算,性能基本全部提升3倍不止,相比來看,前兩代的架構升級也顯得小打小鬧。

這也使得H100的熱功耗(TDP)直接達到了前所未有的700w,英偉達“核彈工廠”名副其實(手動狗頭)。

話又說回來,這次H100也是首款支持PCle 5.0和HBM3的GPU,數據處理速度進一步飛升——內存帶寬達到了3TB/s。

這是什么概念?

老黃在發布會上神秘一笑:只需要20個H100在手,全球互聯網流量我有。

整體參數細節究竟如何,與前代A100和V100對比一下就知道了:

△圖源@anandtech

值得一提的是,Hopper架構的新GPU和英偉達CPU Grace名字組在一起,就成了著名女性計算機科學家Grace Hopper的名字,這也被英偉達用于命名他們的超級芯片。

Grace Hopper發明了世界上第一個編譯器和COBOL語言,有“計算機軟件工程第一夫人”之稱。

訓練3950億參數大模型僅1天

當然,Hopper的新特性遠不止體現在參數上。

這次,老黃特意在發布會上著重提到了Hopper首次配備的Transformer引擎。

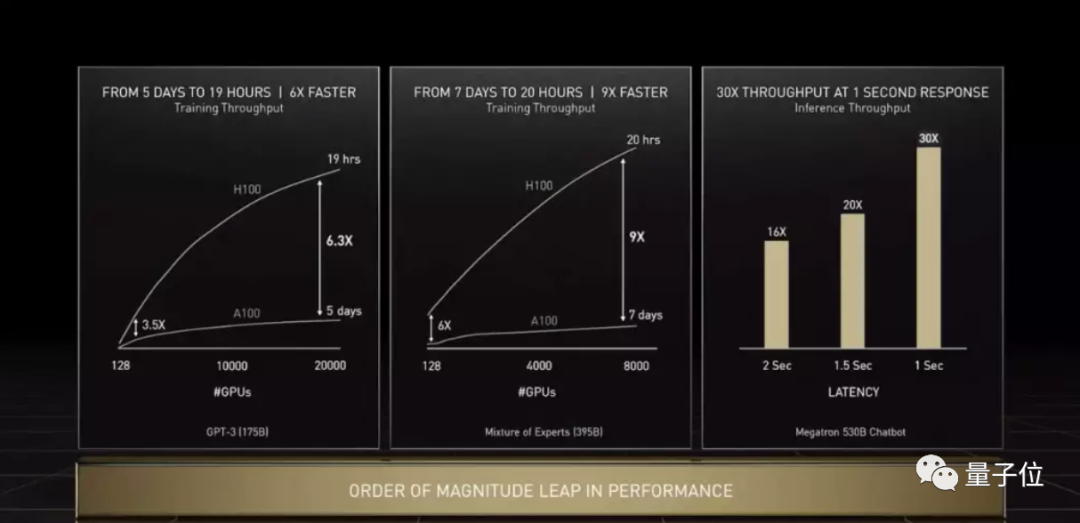

嗯,專為Transformer打造,讓這類模型在訓練時保持精度不變、性能提升6倍,意味著訓練時間從幾周縮短至幾天。

怎么表現?

現在,無論是訓練1750億參數的GPT-3 (19小時),還是3950億參數的Transformer大模型(21小時),H100都能將訓練時間從一周縮短到1天之內,速度提升高達9倍。

推理性能也是大幅提升,像英偉達推出的5300億 Megatron模型,在H100上推理時的吞吐量比A100直接高出30倍,響應延遲降低到1秒,可以說是完美hold住了。

不得不說,英偉達這波確實突入了Transformer陣營。

在此之前,英偉達一系列GPU優化設計基本都是針對卷積架構進行的,接近要把“I love 卷積”這幾個字印在腦門上。

要怪只怪Transformer最近實在太受歡迎。(手動狗頭)

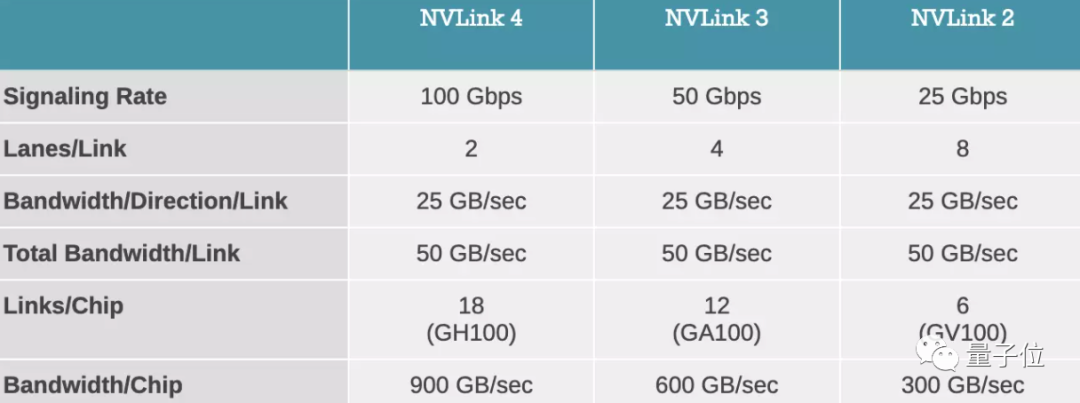

當然,H100的亮點不止如此,伴隨著它以及英偉達一系列芯片,隨后都會引入NVIDIA NVLink第四代互連技術。

也就是說,芯片堆堆樂的效率更高了,I/O帶寬更是擴展至900GB/s。

這次,老黃還著重提到了GPU的安全性,包括實例之間具有隔離保護、新GPU具有機密計算功能等。

當然,數學計算能力也提升了。

這次H100上新的DPX指令可以加速動態規劃,在運算路徑優化和基因組學在內的一系列動態規劃算法時速度提升了7倍。

據老黃介紹,H100會在今年第三季度開始供貨,網友調侃“估計也便宜不了”。

目前,H100有兩個版本可選:

一個就是功率高達700W的SXM,用于高性能服務器;另一個是適用于更主流的服務器PCIe,功耗也比上一代A100的300W多了50W。

4608塊H100,打造全球最快AI超算

H100都發布了,老黃自然不會放過任何一個搭建超級計算機的機會。

基于H100推出的最新DGX H100計算系統,與上一代“烤箱”一樣,同樣也是配備8塊GPU。

不同的是,DGX H100系統在FP8精度下達到了32 Petaflop的AI性能,比上一代DGX A100系統整整高了6倍。

各GPU之間的連接速度也變得更快,900GB/s的速度接近上一代的1.5倍。

最關鍵的是,這次英偉達還在DGX H100基礎上,搭建了一臺Eos超級計算機,一舉成為AI超算界的性能TOP 1——

光就18.4 Exaflops的AI計算性能,就比日本的“富岳”(Fugaku)超級計算機快了4倍。

這臺超算配備了576個DGX H100系統,直接用了4608塊H100。

即使是傳統科學計算,算力也能達到275 Petaflops (富岳是442 Petaflops),躋身前5的超算是沒什么問題。

“拼裝”CPU,跑分成了TOP1

本次GTC大會,老黃仍然“提了幾嘴”超級服務器芯片Grace。

它在去年4月份的GTC大會就已經有所亮相,和當時一樣,老黃表示:有望2023年可以開始供貨,反正今年是不可能碰上了。

不過,Grace的性能倒是值得一提,有了“驚人進展”。

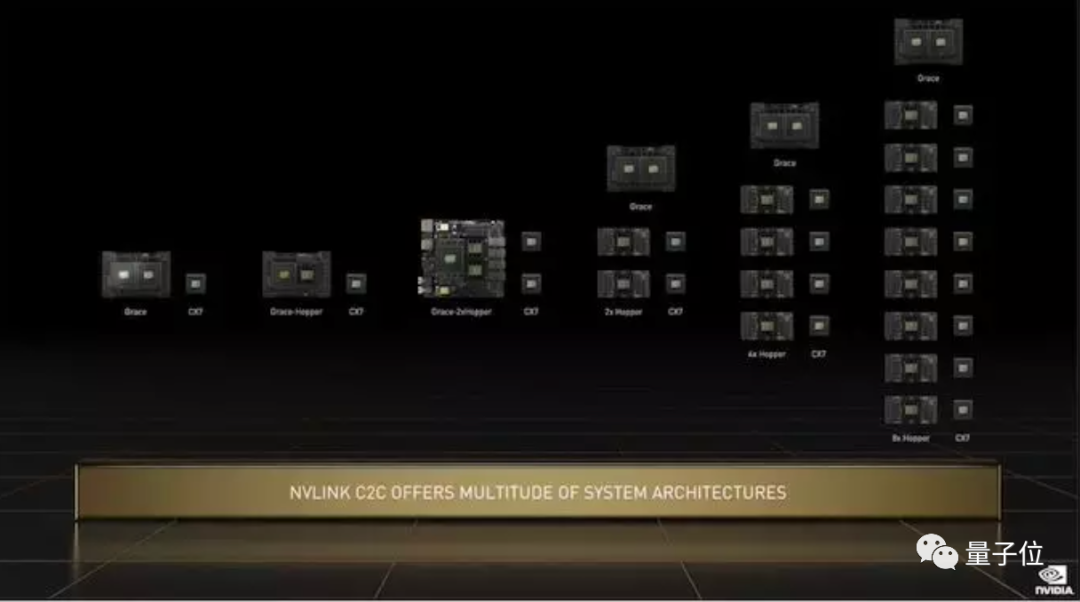

它被用在兩個超級芯片中:

一個是Grace Hopper超級芯片,單MCM,由一個Grace CPU和一個Hopper架構的GPU組成。

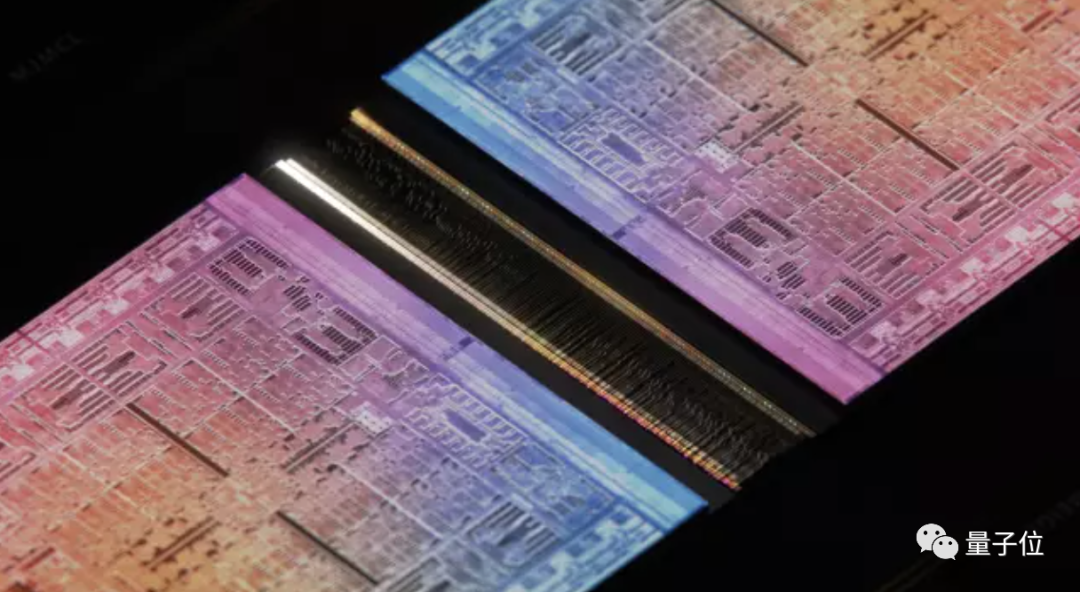

一個是Grace CPU超級芯片,由兩個Grace CPU組成,通過NVIDIA NVLink-C2C技術互連,包括144個Arm核心,并有著高達1TB/s的內存帶寬——帶寬提升2倍的同時,能耗“只要”500w。

很難不讓人聯想到蘋果剛發的M1 Ultra,看來片間互連技術的進展,讓“拼裝”成了芯片行業一大趨勢。

Grace超級芯片在SPECrate?2017_int_base基準測試中的模擬性能達到了740分,是當前DGX A100 搭載的CPU的1.5倍(460分)。

Grace超級芯片可以運行在所有的NVIDIA計算平臺,既可作為獨立的純CPU系統,也可作為 GPU加速服務器,利用NVLink-C2C技術搭載一塊至八塊基于Hopper架構的GPU。

(嗯,剛說完,老黃的芯片堆堆樂就堆上了。)

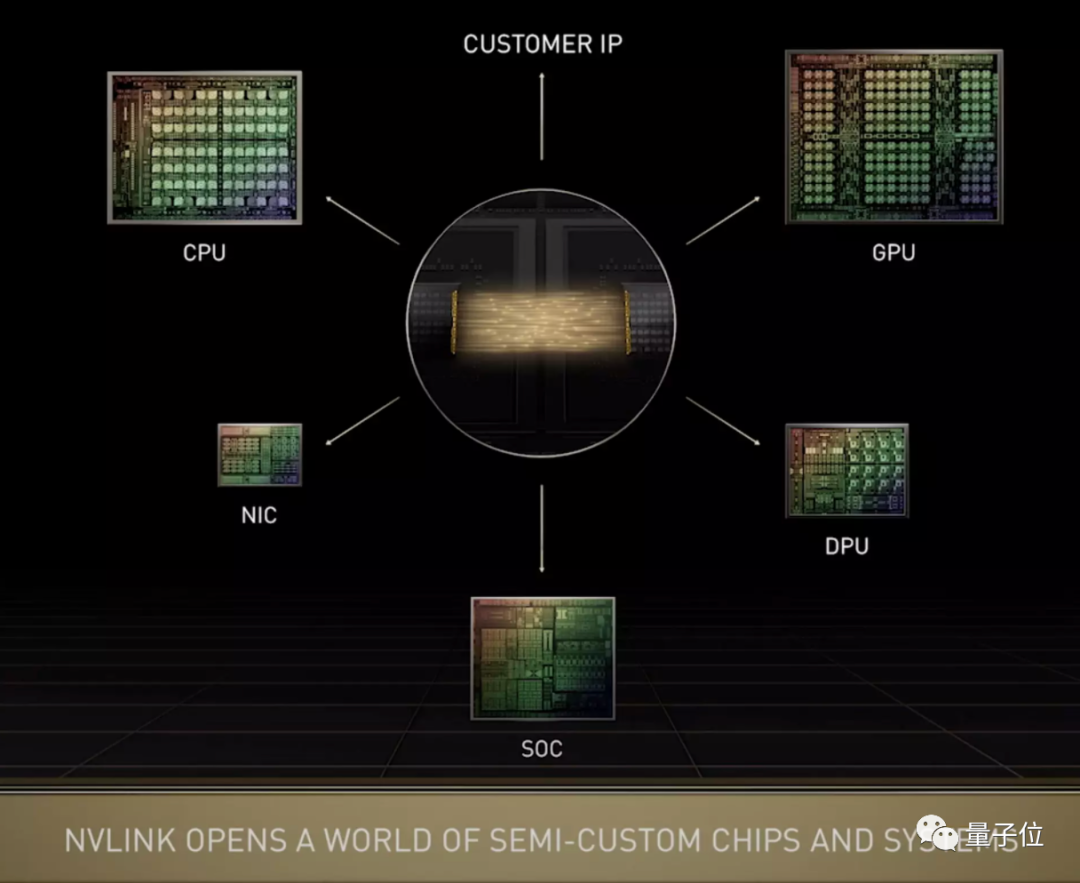

值得一提的是,英偉達對第三方定制芯片開放了NVLink-C2C。

它是一種超快速的芯片到芯片、裸片到裸片的互連技術,將支持定制裸片與NVIDIA GPU、CPU、DPU、NIC 和SOC之間實現一致的互連。

或許,任天堂新掌機可以期待一波?

連工業也要在元宇宙里搞

當然,除了上述內容之外,這次英偉達也透露了不少與工業應用相關的案例。

而無論是自動駕駛、還是包括虛擬工廠的數字孿生等場景,都與計算機渲染和仿真技術有著密不可分的關系。

英偉達認為,工業上同樣能通過在虛擬環境中模擬的方式,來增加AI訓練的數據量,換而言之就是“在元宇宙里搞大訓練”。

例如,讓AI智能駕駛在元宇宙里“練車”,利用仿真出來的數據搞出半真實環境,增加一些可能突發故障的環境模擬:

又例如,搞出等比例、與現實環境中材料等參數完全一樣的“數字工廠”,在建造前先提前開工試運行,以及時排查可能出現問題的環境。

除了數字孿生,數字資產的生產也是元宇宙早期建設階段需要著重考慮的部分。

在這方面,英偉達推出了隨時隨地能在云端協作的Omniverse Cloud。

最有意思的是,這次發布會上還演示了一套AI驅動虛擬角色系統。

現實中3天,虛擬角色在元宇宙里靠強化學習苦練10年功夫。

等練成一身本領,出來無論到游戲還是動畫里都是個好“動作演員”。

用它生成動畫無需再綁定骨骼、k幀,用自然語言下指令即可,就像導演和真人演員一樣溝通,大大縮短開發流程。

要論元宇宙基建還得看老黃啊。

Venturebeat對此評價稱,“這些案例給元宇宙賦予了真正的意義”。

那么,你看好英偉達的omniverse前景嗎?

更多詳情,可以戳完整演講地址(帶中字哦):https://www.nvidia.cn/gtc-global/keynote/?nvid=nv-int-bnr-223538&sfdcid=Internal_banners