無監督為每個像素都打上標簽!再也不用為1小時視頻花800個小時了

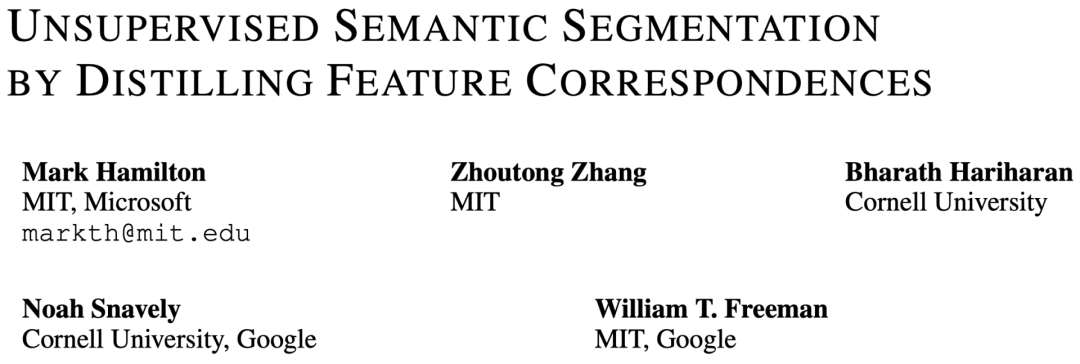

趁著ICLR 2022頒獎之際,MIT、康奈爾、谷歌和微軟「炫耀」了一篇全新的SOTA——

給世界上每一個像素都打上標簽,而且無需人工!

論文地址:https://arxiv.org/abs/2203.08414

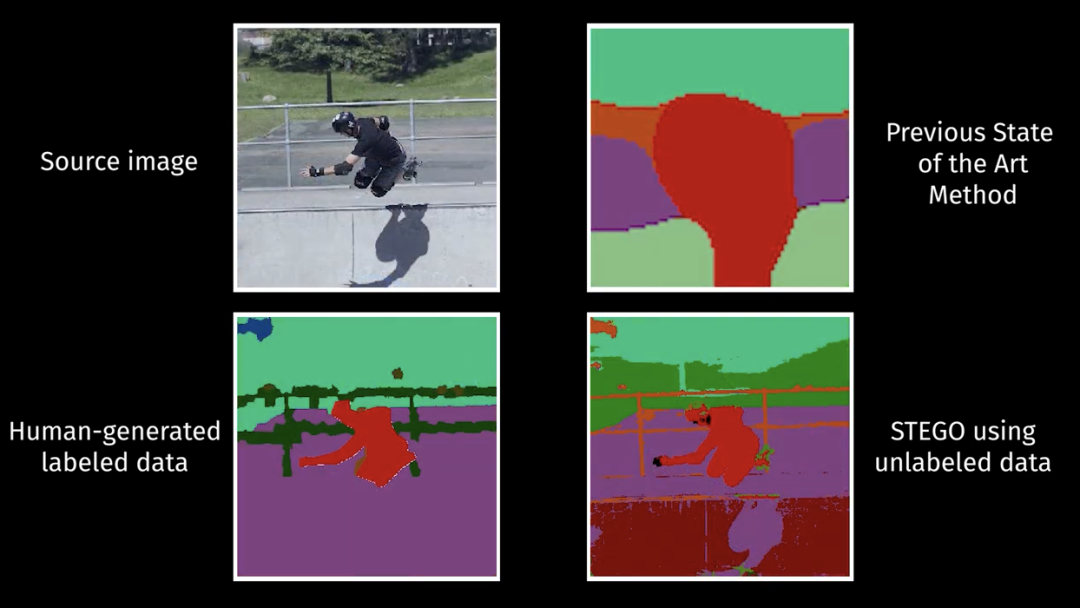

從對比圖的效果來看,這個方法有時候甚至比人工還細致啊,甚至連陰影都做了標注。

不過遺憾是的是,雖然看著十分酷炫,但并沒有入圍獲獎名單(包括提名)。

不放過任何一個像素!

說回到CV領域,其實,給數據做標注這個問題已經困擾了學界很久。

對于人類來說,不管是牛油果還是土豆泥,甚至是「外星母艦」,只需要看一眼,就能認出來。

但是對于機器,就沒這么簡單了。

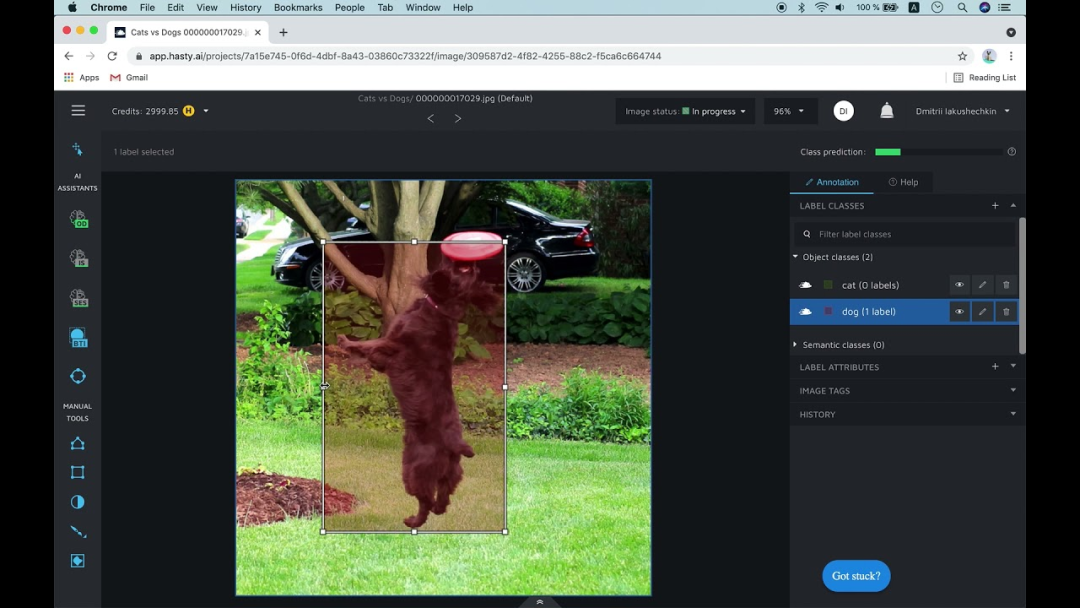

想制作一個用于訓練的數據集,就需要在圖像中把特定的內容框出來,而這件事目前來說基本只能靠人工手動進行。

比如,一只坐在草地上的狗,這時你就需要先把這只狗圈出來,并備注上——「狗」,然后再給后面那片地備注上「草」。

基于此,訓練出的模型才能將「狗」和「草地」區分開。

而且,這件事情非常令人頭疼。

你不去做吧,模型就很難識別出物體、人類或其他重要的圖像特征。

做吧,又非常麻煩。

對人類標注者而言,分割圖像比分類或目標檢測要花費約100倍的精力。

僅僅是標注1個小時的數據就需要花費800個小時。

數據標注打工人:我也要畢業了?

為了讓人類不用再去忍受「標注」的折磨(當然主要還是為了推進技術的進步),剛才提到的這群科學家便提出了一種新的基于Transformer的方法「STEGO」,從而在無監督的情況下完成圖像語義分割任務。

無監督語義分割的目的是在圖像語料庫中發現并定位具有語義意義的類別,而無需任何形式的標注。

為了解決這一問題,STEGO算法必須為每個像素生成具有重要意義且足夠緊湊的特征,以形成不同的簇。

與以往的端到端的模型不同,STEGO提出了將特征學習與聚類分離的方法,會尋找出現在整個數據集中的相似圖像,然后,它將這些相似的對象關聯在一起,以做到像素級別的標簽預測。

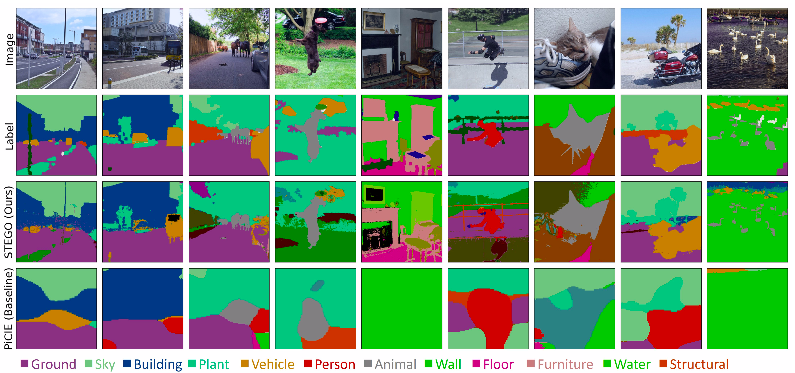

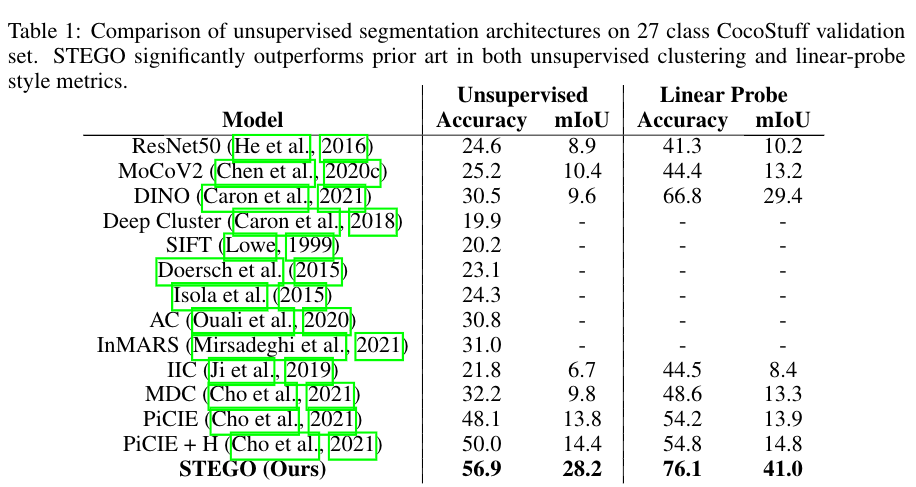

在CocoStuff數據集上,27種類別的無監督語義分割任務(包括地面、天空、建筑、草坪、機動車、人、動物等)。

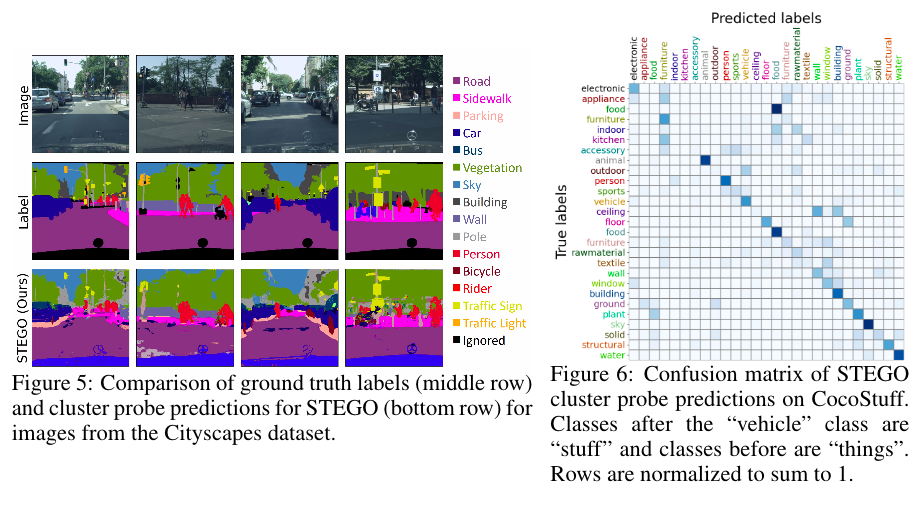

基線方法對比Cho等人2021年提出的PiCIE方法,圖片結果顯示,STEGO的語義分割預測結果在沒有忽略關鍵對象的同時,保留了局部細節特征。

STEGO是怎么做到在沒有標記的情況下,為每個像素分配標簽的呢?

STEGO原理和結構

STEGO使用2021年Caron等人提出的DINO模型作為特征提取器,圖片顯示了原圖像(左圖)中的標記的藍色、紅色和綠色點是如何進行像素特征關聯學習的。

藍色為天空,綠色表示草坪、紅色表示騎摩托的人

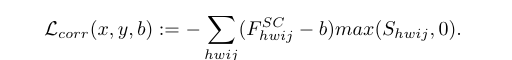

STEGO的核心是一種新的損失函數,它鼓勵特征形成緊湊的簇,同時保留它們在整個圖像語料庫中的關系。

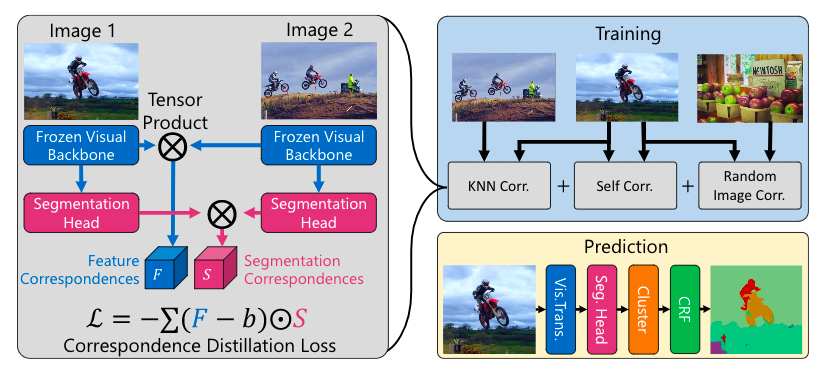

使用下式中損失函數進行訓練,以提取圖像與自身、其K近鄰(KNN)像素點和其他隨機圖像之間的特征關系,對應下圖中的三個灰色部分。

下圖顯示了STEGO結構。STEGO的訓練網絡由一個無需進行微調和預訓練的網絡構成,使用此結構通過全局平均池(GAP)提取全局圖像特征。然后在特征空間構造每個圖像的K近鄰查找表。

這種Frozen Visual Backbone結構相比其他方法,訓練耗時非常短,在一張NVIDIA V100 GPU卡上只需要不到2小時。

預測結構的最后一個組件是聚類和CRF細化步驟,STEGO的分割特征往往會形成清晰的聚類,使用MacQueen等人1967年提出的基于acosine距離的小批量K-均值算法來提取這些聚類簇,并根據STEGO的連續特征計算為形成的簇分配類別。聚類后,使用CRF對這些標簽進行細化,以進一步提高其空間分辨率。

STEGO的整個損失函數如下:

實驗結果

每個驗證圖像的大小為320×320像素,使用均交并比「mIoU」作為評測指標。

左圖表示在Cityscapes數據集上標簽圖片與STEGO語義分割結果對比,右圖表示在CocoStuff 數據集上預測標簽和真實標簽的混淆矩陣。

在CocoStuff數據集上,無監督語義分割任務對比結果顯示,STEGO明顯優于之前的方法。

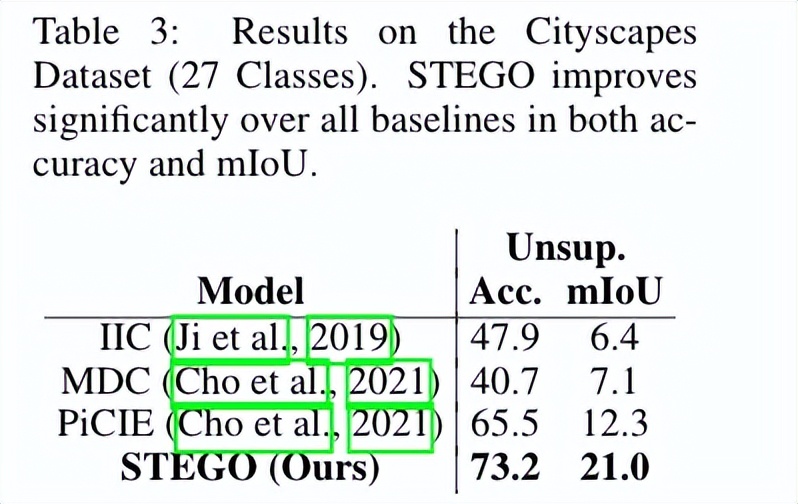

在Cityscapes(27個類別)的預測結果顯示。STEGO在accuracy和mIoU的所有基線上都有顯著提高。

實驗結果表明STEGO在CocoStuff(+14mIoU)和Cityscapes(+9mIoU)數據集上的精細語義分割任務上都取得了良好的表現。

盡管有了改進,STEGO仍然面臨某些挑戰:

比如,在CocoStuff數據集中,香蕉和雞翅是「食品」,而玉米糝和意大利面是「食材」。但是這兩樣東西在STEGO眼里并沒有什么區別。

甚至,如果你把一個香蕉放在了電話聽筒上,這個聽筒都可能會被標注為「食品」。

作者介紹

論文二作Zhoutong Zhang現在是MIT的在讀博士生,本科就讀于清華大學電子工程專業,師從劉燁斌教授。

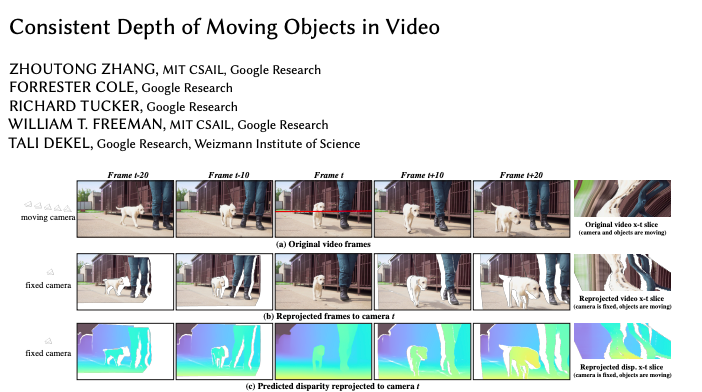

此前,曾在2021年以一作身份在SIGGRAPH上發表論文「Consistent Depth of Moving Objects in Video」。

? ?