基于跨模態(tài)元遷移,美圖&大連理工的參考視頻目標(biāo)分割方法只需單階段

引言

參考視頻目標(biāo)分割(Referring VOS, RVOS)是一個新興起的任務(wù),它旨在根據(jù)參考文本,從一段視頻序列中分割出文本所指述的對象。與半監(jiān)督視頻目標(biāo)分割相比,RVOS 只依賴抽象的語言描述而不是像素級的參考掩膜,為人機交互提供了一種更方便的選擇,因此受到了廣泛關(guān)注。

論文鏈接:https://www.aaai.org/AAAI22Papers/AAAI-1100.LiD.pdf

該研究的主要目的是為解決現(xiàn)有 RVOS 任務(wù)中所面臨的兩大挑戰(zhàn):

- 如何將文本信息、圖片信息進(jìn)行跨模態(tài)融合,從而既保持兩種模態(tài)間的尺度一致性,又能充分地將文本所提供的有用特征參考充分融入到圖片特征中;

- 如何拋棄現(xiàn)有方法的二階段策略(即先在圖片級別逐幀得到粗略的結(jié)果,再利用該結(jié)果作為參考,經(jīng)過增強時序信息的結(jié)構(gòu)細(xì)化得到最終預(yù)測),將整個 RVOS 任務(wù)統(tǒng)一進(jìn)單階段的框架中。

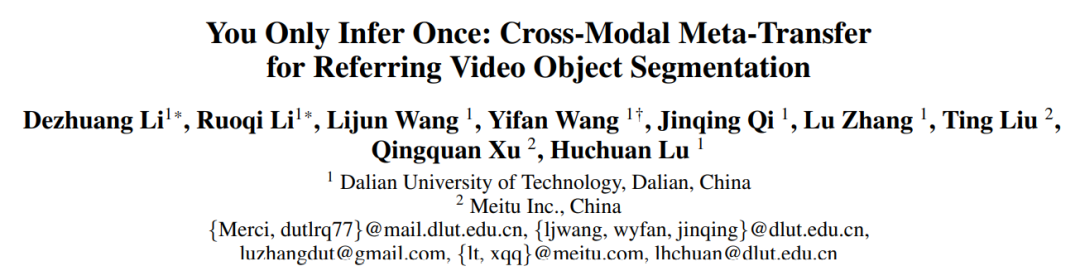

對此,該研究提出了一種跨模態(tài)元遷移的端到端 RVOS 框架 ——YOFO,其主要的貢獻(xiàn)和創(chuàng)新點為:

- 只需單階段推理,即可實現(xiàn)利用參考文本信息直接得到視頻目標(biāo)的分割結(jié)果,在兩個主流的數(shù)據(jù)集 ——Ref-DAVIS2017 和 Ref-Youtube-VOS 上獲得的效果超越了目前所有二階段方法;

- 提出了一個元遷移(Meta-Transfer)模塊來增強時序信息,從而實現(xiàn)了更聚焦于目標(biāo)的特征學(xué)習(xí);

- 提出了一個多尺度跨模態(tài)特征挖掘(Multi-Scale Cross-Modal Feature Mining)模塊,能夠充分融合語言、圖片中的有用特征。

實現(xiàn)策略

YOFO 框架主要流程如下:輸入圖片和文本先分別經(jīng)過圖片編碼器和語言編碼器提取特征,隨后在多尺度跨模態(tài)特征挖掘模塊進(jìn)行融合。融合后的雙模態(tài)特征在包含了記憶庫的元遷移模塊中進(jìn)行簡化,排除掉語言特征中的冗余信息,同時能保存時序信息來增強時間相關(guān)性,最后通過一個解碼器得到分割結(jié)果。

圖 1:YOFO 框架主要流程。

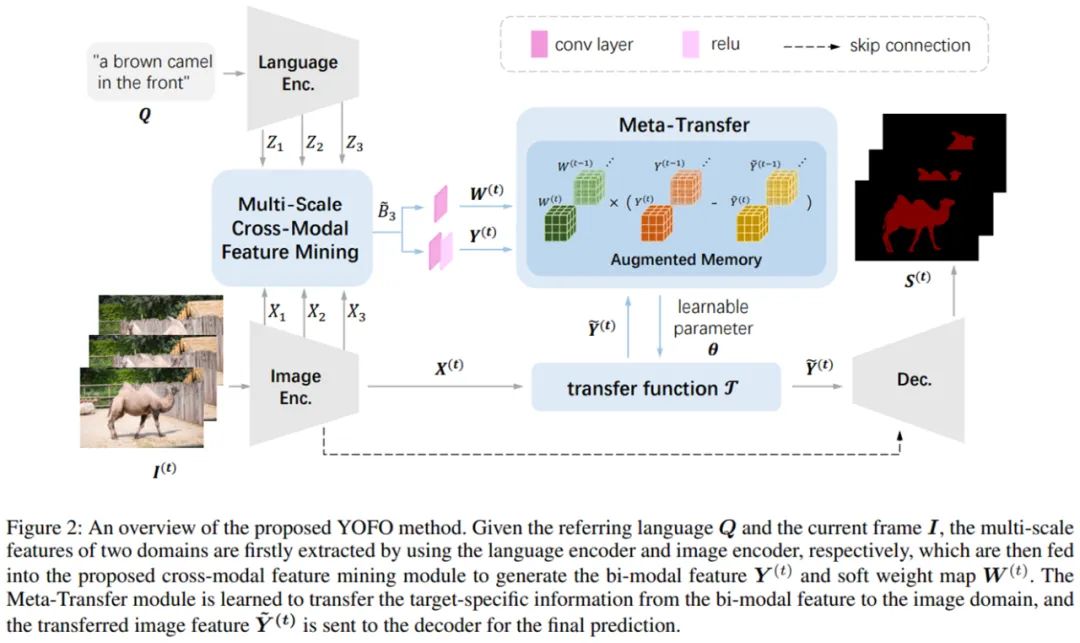

多尺度跨模態(tài)特征挖掘模塊:該模塊通過逐級融合不同尺度的兩個模態(tài)特征,能夠保持圖像特征所傳達(dá)的尺度信息與語言特征間的一致性,更重要的是保證了語言信息不會在融合過程中被多尺度圖像信息所淡化淹沒。

圖 2:多尺度跨模態(tài)特征挖掘模塊。

元遷移模塊:采用了一種 learning-to-learn 策略,過程可以簡單地描述為以下的映射函數(shù)。其中遷移函數(shù) 是一個卷積,則

是一個卷積,則 是它的卷積核參數(shù):

是它的卷積核參數(shù):

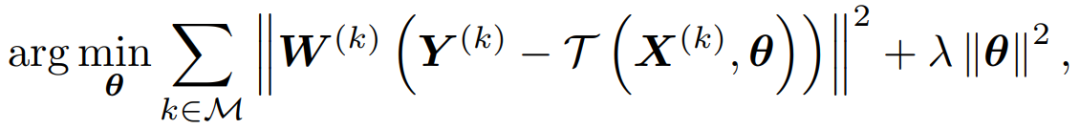

優(yōu)化的過程可以表達(dá)為以下目標(biāo)函數(shù):

其中,M 代表能夠儲存歷史信息的記憶庫,W 代表不同位置的權(quán)重,能夠?qū)μ卣髦胁煌奈恢觅x予不同的關(guān)注度,Y 代表儲存在記憶庫中的每個視頻幀的雙模態(tài)特征。該優(yōu)化過程盡可能地使元遷移函數(shù)具有重構(gòu)雙模態(tài)特征的能力,同時也使得整個框架能夠進(jìn)行端到端的訓(xùn)練。

訓(xùn)練和測試:訓(xùn)練時所使用的損失函數(shù)是 lovasz loss,訓(xùn)練集為兩個視頻數(shù)據(jù)集 Ref-DAVIS2017、Ref-Youtube-VOS,并通過靜態(tài)數(shù)據(jù)集 Ref-COCO 進(jìn)行隨機仿射變換模擬視頻數(shù)據(jù)作為輔助訓(xùn)練。元遷移的過程在訓(xùn)練和預(yù)測時都要進(jìn)行,整個網(wǎng)絡(luò)在 1080ti 上的運行速度達(dá)到了 10FPS。

實驗結(jié)果

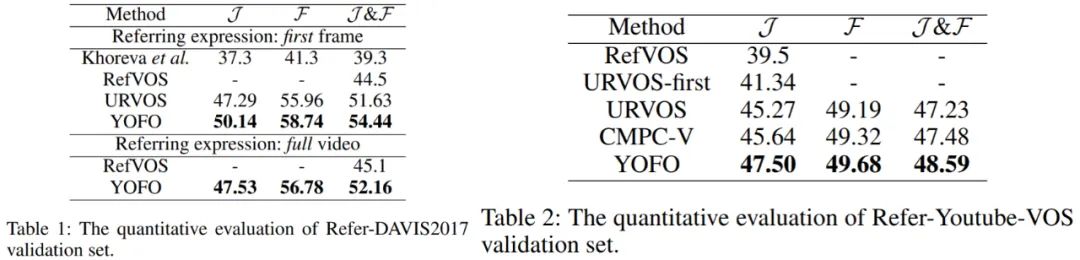

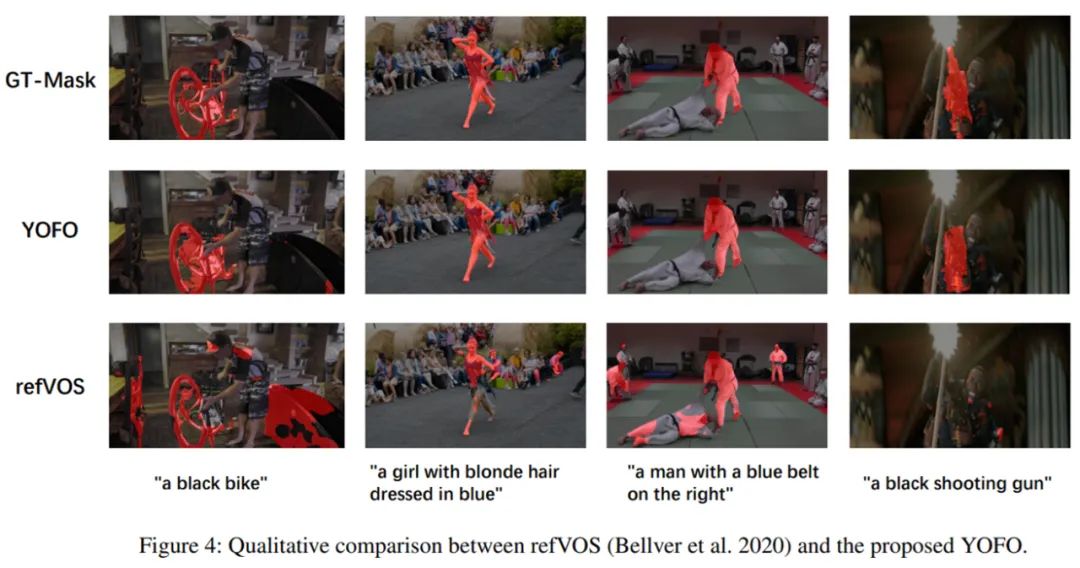

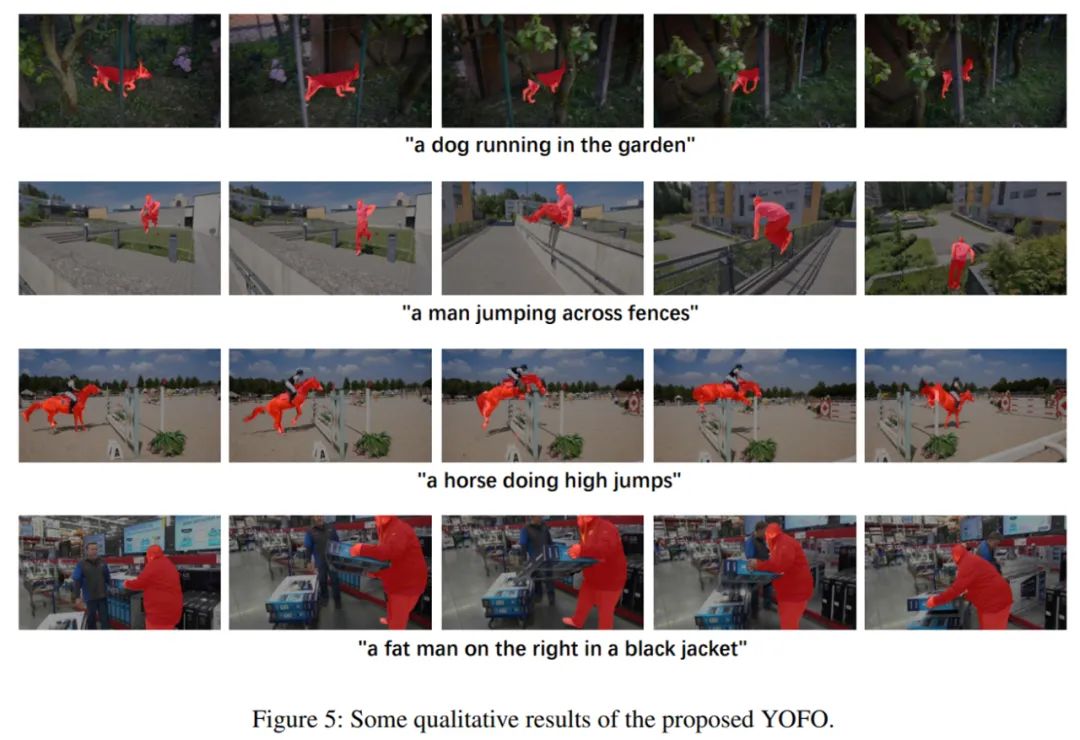

研究采用的方法在兩個主流 RVOS 數(shù)據(jù)集(Ref-DAVIS2017 和 Ref-Youtube-VOS)上均取得了優(yōu)異的效果,量化指標(biāo)及部分可視化效果圖如下:

圖 3:在兩個主流數(shù)據(jù)集上的量化指標(biāo)。

圖 4:在 VOS 數(shù)據(jù)集上的可視化效果。

圖 5:YOFO 的其他可視化效果展示。

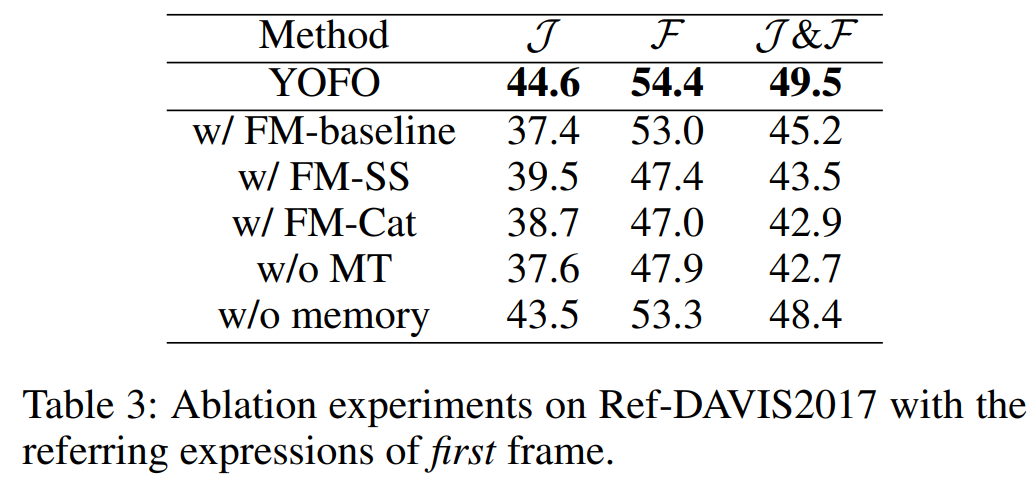

研究還通過一系列的消融實驗以說明特征挖掘模塊(FM)以及元遷移模塊(MT)的有效性。

圖 6:特征挖掘模塊(FM)以及元遷移模塊(MT)的有效性。

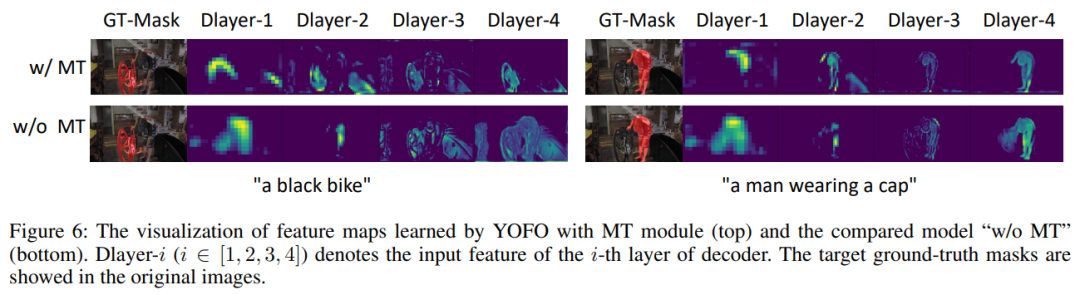

此外,研究分別對使用了 MT 模塊和不使用 MT 模塊的解碼器輸出特征進(jìn)行了可視化,可以明顯地看出 MT 模塊能夠正確地捕捉到語言所描述的內(nèi)容且對干擾噪聲進(jìn)行過濾。

圖 7:使用 MT 模塊前后的解碼器輸出特征對比。關(guān)于研究團隊

本論文由美圖影像研究院(MT Lab)和大連理工大學(xué)盧湖川團隊的研究者們共同提出。美圖影像研究院(MT Lab)是美圖公司致力于計算機視覺、機器學(xué)習(xí)、增強現(xiàn)實、云計算等領(lǐng)域的算法研究、工程開發(fā)和產(chǎn)品化落地的團隊,為美圖現(xiàn)有和未來的產(chǎn)品提供核心算法支持,并通過前沿技術(shù)推動美圖產(chǎn)品發(fā)展,被稱為「美圖技術(shù)中樞」,曾先后多次參與 CVPR、ICCV、ECCV 等計算機視覺國際頂級會議,并斬獲冠亞軍十余項。