聲音在我們的日常生活中無處不在,是不可或缺的一部分,在元宇宙世界中亦如此。元宇宙的場景要想實現全方位的沉浸感,需要各種聲音技術的不斷升級和發展。在51CTO近日舉辦的“??AISummit 全球人工智能技術大會?”上,Rokid算法負責人王文兵發表了《AR下的“聲”臨“奇”境》主題演講,介紹了Rokid自研6DoF空間聲場的概念、主要技術模塊、技術難點、與AR結合的發展趨勢以及開發技術的初衷,詮釋了空間聲場技術在元宇宙世界中的重要體現。

現將演講內容整理如下:

什么是6dof空間聲場?

談及這個問題時,可以先拋開技術的限制,想象一下AR上的聲音應該以何種形態去呈現。其實我們現在用的TV、手機等大部分都是像stereo這種的雙聲道,家庭影院已經用上了multi-channel,電影院等專業場景還有空間布局上的喇叭。

在AR上它究竟應該如何去呈現呢?我們可以試想一個畫面,比如現在很流行的在線會議或在線教育,如果在元宇宙世界里看到右邊的數字人一直在說話,但這個聲音從你的左邊出來,這個時候是不是感覺很奇怪?

另外我們可以想象一下AR游戲,在以前這種2D的視覺里,聲音跟著視覺的焦點去移動就可以,但是在3D場景的360度的范圍下,人的雙眼是無法抓住整個視覺焦點的,而聲音是具備全局焦點的。這也是為什么在很多游戲里,人會跟著聲音去切換視角。因此可以看到AR上聲音所需具備的一些特性:需要滿足人對聲音的高靈敏度感覺、聲音的全局性焦點作用、以及聲音的真實感要求等。

接下來從三個維度介紹一下聲音形態的發展之路。

第一,空間表達維度。整個聲音的表達維度從mono/stereo到5.1/7.1/9.1/...這種平面下的多聲道、再到5.1.x/7.1.x這種空間下的多聲道等,喇叭越來越多,擺放位置也從平面上升到空間了;

第二,編碼方式維度。從最開始的channel-based(也就是基于通道的編碼,每個通道上會有各種各樣的聲音,比如我們平時常見的左右聲道的表達方式),到object-based(也就是針對發生的對象進行編碼),包括大家在電影院觀看到的Dolby Atmos片源,比如當某個炮彈打下來的時候,那個炮彈的對象是專門編碼的,metadata中記錄了其運動的軌跡,然后根據對應的喇叭位置進行播放的;但我們最終的目標還是希望達到完全基于場景下的效果,類似于HOA這樣的全景聲方式,不只是炮彈,一花一草一樹葉的掉落我們都希望它是具備空間感。

第三,XR體驗維度。以前虛擬的聲音和真實世界是割裂的,如今在XR里,尤其是AR方面,我們一直在做的事就是虛擬與現實的融合。

人之所以能夠對聲音有如此細力度的區分,是因為雙耳模式,專業上來說是ITD和ILD,也就是雙耳的時間差和音強差。這兩種差別會幫助我們快速定位物體發聲的方位。

那么如何讓3D聲音普及?如何突破場地局限性?如何降低用戶消費成本?如何能夠讓每個人都享受科技?Rokid 自研的6dof空間聲場將助力解決這些難題。

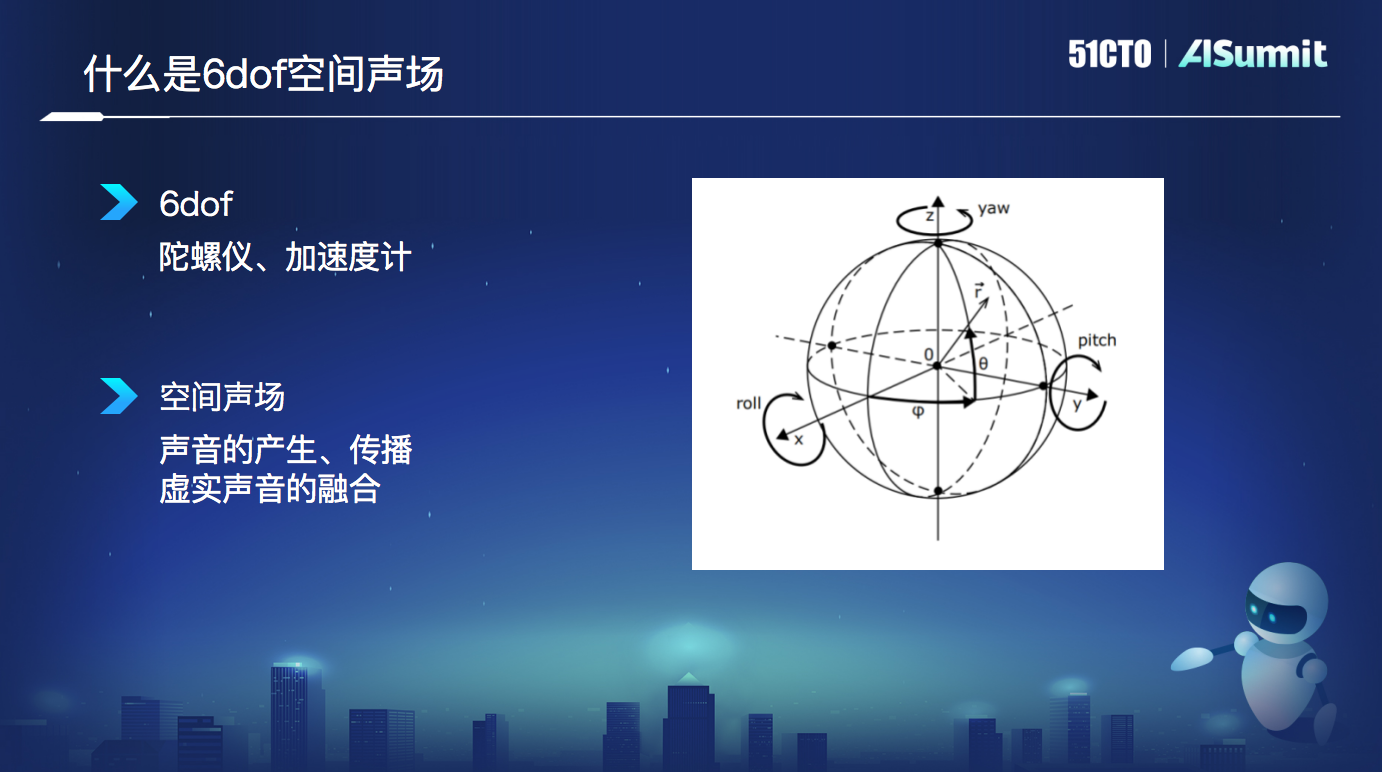

6dof空間聲場從名字上可以分為兩部分:6dof和空間聲場。6dof主要表達六自由度,由陀螺儀提供繞XYZ三個方向的旋轉,由加速度計提供XYZ三個方向的加速度。

6dof空間聲場涉及聲音的產生、傳播、渲染、編解碼以及整個過程中虛實聲音融合和交互的過程。

6dof空間聲場的主要技術

6dof空間聲場的主要技術模塊包含HRTFs、聲場渲染以及音效。HRTFs是聲源從自由場到耳膜的沖擊函數,其是在模擬一個消音室的環境下,全方位的聲音傳到人耳的過程。聲場渲染可以給予人聽聲辨位的能力,可以虛實融合,完美處理真實物體對虛擬聲源的影響。音效是在私密性設計的開放式喇叭以減弱聲音泄露、保障音量的同時,進行聲音品質的豐富。

架構圖最上面的SDK,對外提供了空間模塊,即空間引擎出口以及語音引擎出口。可以對空間信息進行獲取和建模,有助于數字世界和物理世界的融合。

此外,我們在Room Effect上也做了一些修改。其整體框架與經典的網絡結構大同小異,首先是構建網絡,然后生成理論下的無損的網絡,之后在這個理論的基礎上做各種衰減、損耗的相關設置,包括吸收、遮擋、反射等。其實我們本身的目的不是為了做各種音效,我們只是結合著產品的使用場景,比如影院或者音樂,提供音效以讓用戶達到良好的視聽體驗,這些都可以在下一代AR眼鏡Rokid Max上體驗到。

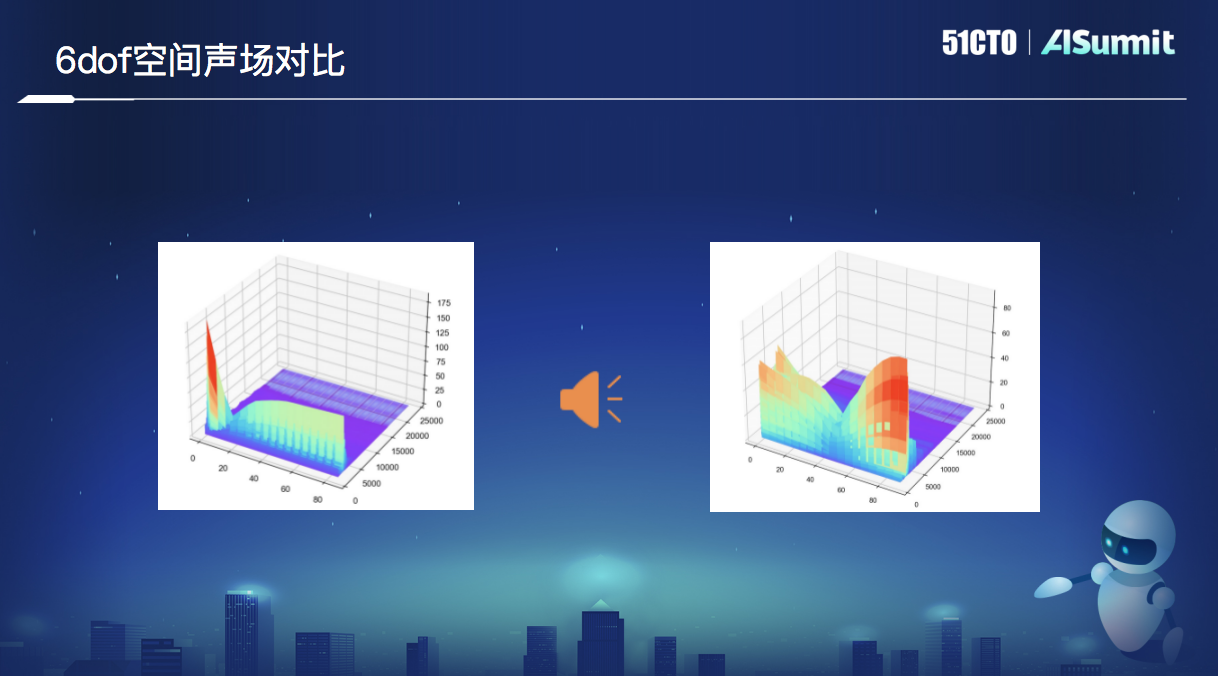

6dof空間聲場對比。左邊是一個第三方SDK的效果,當從0度到90度旋轉時,每個頻率的變化是不平滑的,而且最開始下降的很厲害,后面的變化非常小。右邊的Rokid所做的6dof空間聲場,不同的頻率段跟著你的方位變換的時候有明顯的變化,圖中為不同角度、不同頻率段、不同幅值的表現。

6dof空間聲場的發展趨勢

隨著元宇宙時代的來臨,AR、VR技術的興起,空間聲場的發展也迎來了新的機遇。

空間聲場的發展趨勢主要體現在三個方面:

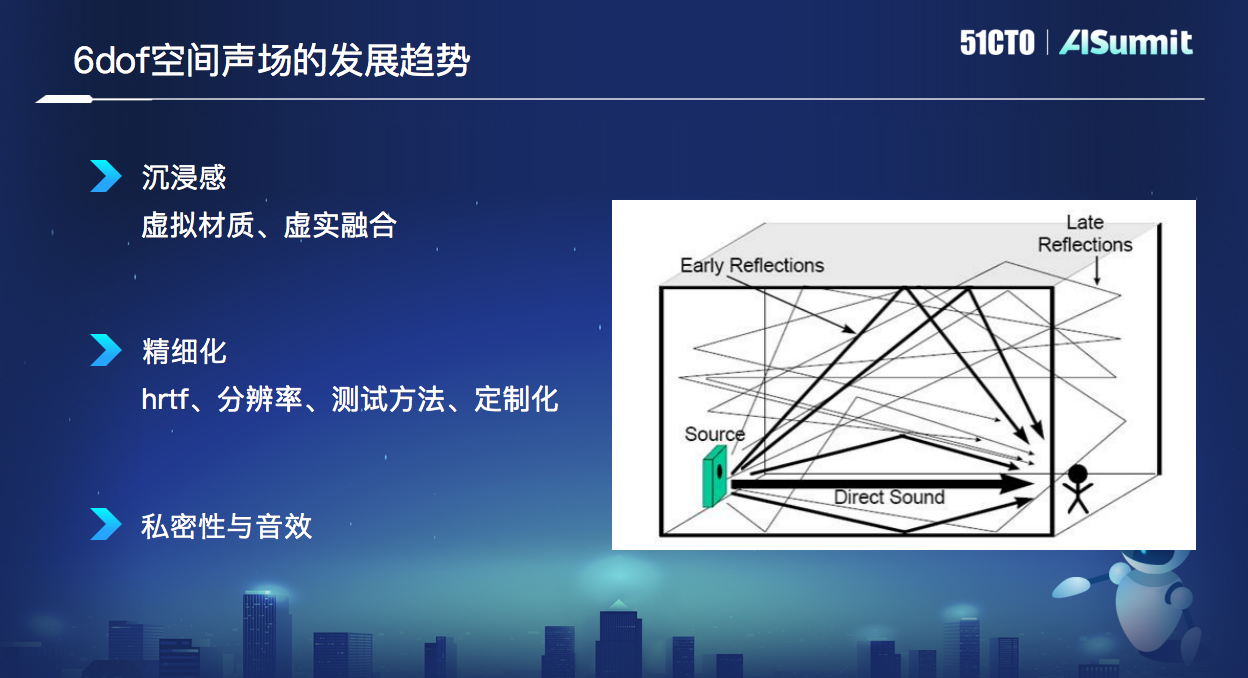

一是沉浸感,人們可以根據真實的世界進行反饋,更好地進行虛實融合與交互,真正實現沉浸式體驗。所有虛擬世界中的聲音不應該放飛自我,不受真實世界中任何物體的影響,因為這樣會讓人覺得它本身還是割裂的。除了融合還要進行交互,比如在虛擬世界中可以通過語音、手勢等不同方式去和AR終端上增強的聲音進行交互,去選擇暫停、播放、或切換不同層次、不同視角的窗口、或自己感興趣的聲音等等。

二是精細化,在HRTF、分辨率、測試方法、定制化等不同方面進行精細化的探索與實踐。精細化比較難的是頭傳,因為頭傳本身的生成手段就比較費時費力,需要對整個球面空間上不同距離下的每個點進行播放,然后再耳道進行采樣。當前也有些學者在研究如何用更少的采樣點生成這種相同的精細化程度,以及如何通過插值或其他技術手段實現更高的精確度;同時,從更長遠的角度來看,精細化的一個極限是私定制的實現。

三是私密性與音效,體驗不同頻段的聲音帶來的聽覺盛宴。不同諧波或不同頻段給我們帶來的感覺是不一樣的。比如,嚴重的混響是會影響人類的聽感,而適宜的混響是會帶來音質上的豐富聽感;尤其是早期的混響,很多時候會被用于音色的判斷,低于3K的混響和橫向反射會有助于形成更好的空間感和深度感,而高頻的分量會幫助我們實現環繞感。

探索空間聲場的初衷

Rokid為何會做空間聲場?主要有三個方面的原因:

一,沉浸感。我們一直在追求數字世界與物理世界的融合,比如玩游戲時的那種生動、在線會議或在線教育時的那種真實。

二,虛實交互。我們認為未來在這世界會是一種虛實的融合,在融合的基礎上可以去做很多交互,包括空間感知的過程、主觀行為的交互等。空間感知是指對于世界中比如物體的大小、空間的大小、材質等方面,這種感知之后則形成對虛擬聲音的影響;主觀行為的交互是人為地干預、選擇、與數字世界中的聲音做溝通。

三,極致品質。AR Glass與手機、平板、TV等產品是有所區別的。當你用手機時出現斷網或者卡頓的情況是能夠忍受的,但是對戴在眼睛上的AR Glass的實時性的要求卻是非常高的。如何才能做到這種實時性的高要求?這涉及到算法、工程、系統、硬件以及應用等整體的優化。

這些是我們一直所追求的使命,Rokid希望通過AR Glass產品將這些能力直接推廣并普及到大眾;與此同時也希望將這些技術作為我們Yoda OS里的基本能力釋放,從而通過廣大開發者們的使用,間接的惠及到用戶,賦能到各行各業。

現大會演講回放及PPT已上線,進入官網查看精彩內容(?https://aisummit.51cto.com/?)