為啥ChatGPT讓LeCun酸成檸檬精?谷歌、Meta、OpenAI聊天機器人大PK!

?前幾天,Meta首席人工智能科學家Yann LeCun的一段對于ChatGPT的點評迅速傳遍圈內外,引發了大波討論。

在Zoom的媒體和高管小型聚會上,LeCun給出了一段令人驚訝的評價:「就底層技術而言,ChatGPT并不是多么了不得的創新。」

「雖然在公眾眼中,它是革命性的,但是我們知道,它就是一個組合得很好的產品,僅此而已。」

ChatGPT不算什么創新

ChatGPT作為這幾個月的聊天機器人「頂流」,早就紅遍全世界,甚至切實改變了一部分人的職業生涯,以及學校教育的現狀。

全世界為它驚嘆的時候,LeCun對ChatGPT的點評居然如此「輕描淡寫」。

但其實,他的言論不無道理。

像ChatGPT這種數據驅動的人工智能系統,許多公司和研究型實驗室有。LeCun表示,OpenAI在這個領域并沒有多么獨樹一幟。

「除了谷歌和Meta之外,還有六家初創公司,基本上都擁有非常相似的技術。」LeCun 補充道。

接著,LeCun小酸了一把——

「ChatGPT用的是以自監督方式進行預訓練的Transformer架構,而自監督學習是本人長期以來一直提倡的,那會兒OpenAI還沒誕生呢。」

其中,Transformer是谷歌的發明。這種語言神經網絡,正是GPT-3等大型語言模型的基礎。

而第一個神經網絡語言模型,Yoshua Bengio早在20年前就提出了。Bengio的注意力機制后來被谷歌用于Transformer,之后更是成為了所有語言模型中的關鍵元素。

另外,ChatGPT用的是人類反饋強化學習(RLHF)的技術,也是由谷歌DeepMind實驗室開創的。

在LeCun看來,ChatGPT與其說是一個科學突破,不如說是一項成功的工程案例。

OpenAI的技術「在基礎科學方面并沒有什么創新性,它只是設計得很好而已。」

「當然啦,我不會為此批評他們。」

我不是在批評OpenAI的工作,也不是在批評他們的主張。

我是想糾正公眾和媒體的看法,他們普遍認為ChatGPT是一種創新且獨特的技術突破,然而事實并非如此。

在紐約時報記者Cade Metz的座談會上,LeCun感受到了好事者的疑問。

「你可能想問,為什么谷歌和Meta沒有類似的系統呢?我的回答是,如果谷歌和Meta推出這種會胡說八道的聊天機器人,損失會相當慘重。」他笑著說。

無獨有偶,OpenAI被微軟等金主看好、身價飆升至290億美元的新聞一出,馬庫斯也連夜在博客上寫了一篇文章嘲諷。

在文中,馬庫斯爆出一句金句:你OpenAI能做啥谷歌做不到的事,值290億美元天價?

谷歌、Meta、DeepMind、OpenAI大PK!

話不多說,咱們把這幾家AI巨頭的聊天機器人都拉出來遛遛,用數據說話。

LeCun說許多公司和實驗室都有類似ChatGPT的AI聊天機器人,此言不虛。

ChatGPT并不是第一個基于語言模型的AI聊天機器人,它有很多「前輩」。

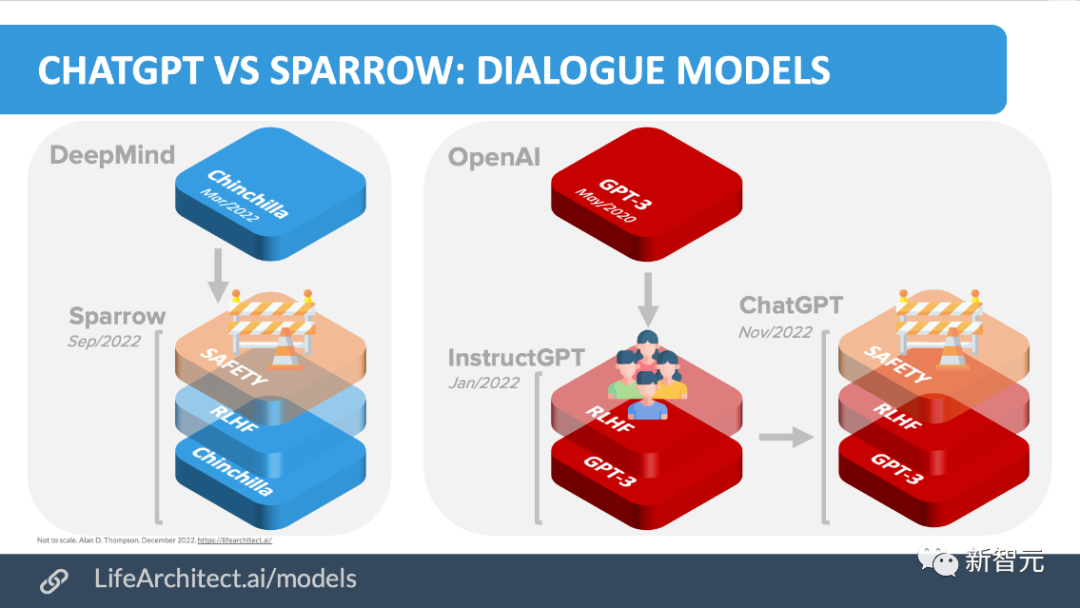

在OpenAI之前,Meta、谷歌、DeepMind等都發布了自己的聊天機器人,比如Meta的BlenderBot、谷歌的LaMDA、DeepMind的Sparrow。

還有一些團隊,也公布了自己的開源聊天機器人計劃。比如,來自LAION的Open-Assistant。

在Huggingface的一篇博客中,幾位作者調查了關于RLHF、SFT、IFT、CoT(它們都是ChatGPT的關鍵詞)這些主題的重要論文,對它們進行了分類和總結。

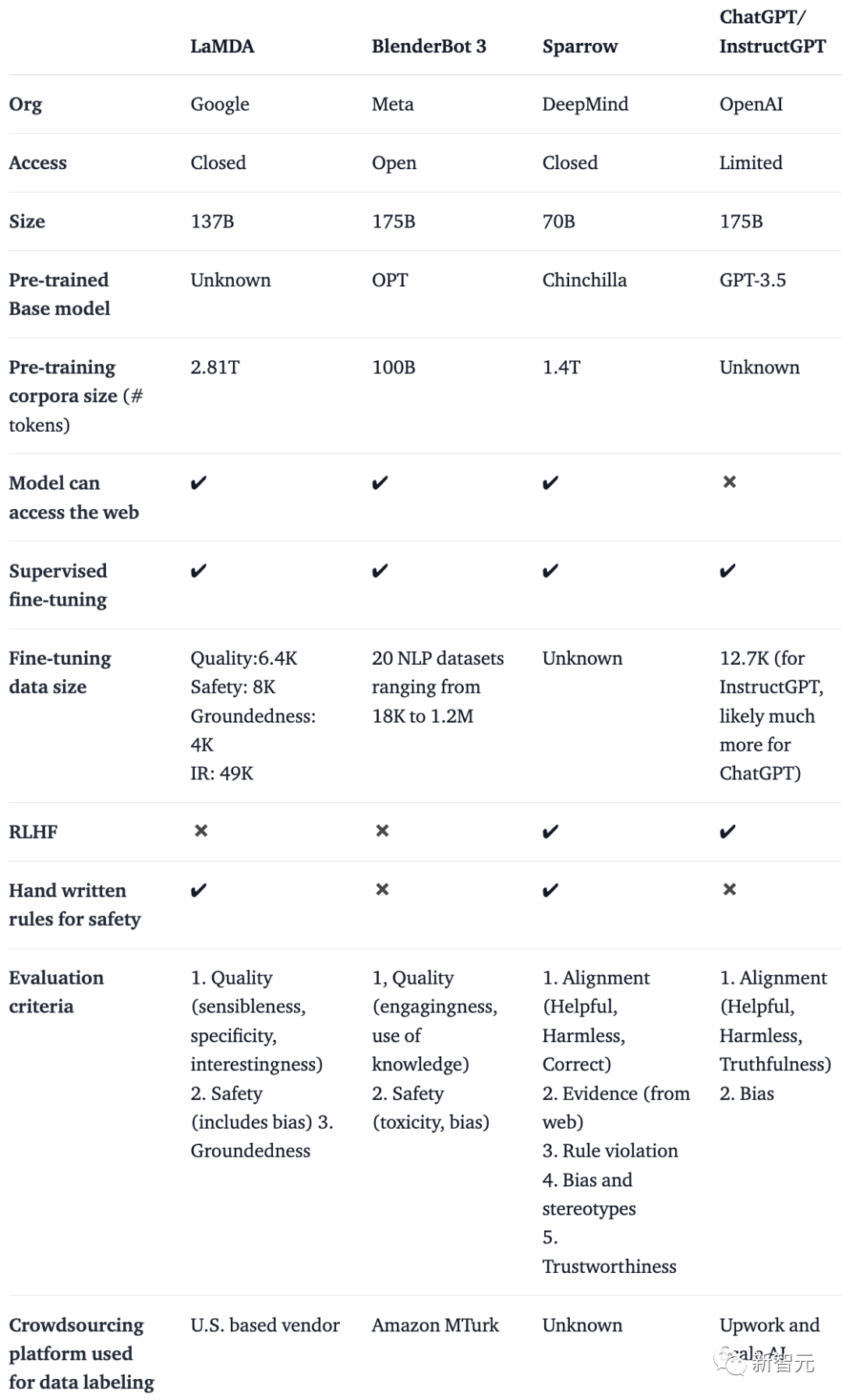

他們制成了一個表,根據公開訪問、訓練數據、模型架構和評估方向等細節,對BlenderBot、LaMDA、Sparrow和InstructGPT這些AI聊天機器人進行了比較。

注意:因為ChatGPT沒有記錄,所以他們使用的是InstructGPT的細節,InstructGPT是一個來自OpenAI的指令微調模型,可以被認為是ChatGPT的基礎。

LaMDA | BlenderBot 3 | Sparrow | ChatGPT/ InstructGPT | |

組織機構 | Meta | DeepMind | OpenAI | |

訪問權限 | 封閉 | 公開 | 封閉 | 有限 |

參數規模 | 1370億 | 1750億 | 700億 | 1750億 |

基礎模型 | 未知 | OPT | Chinchilla | GPT-3.5 |

語料庫規模 | 2.81萬億 | 1000億 | 1.4萬億 | 未知 |

訪問網絡 | ?? | ?? | ?? | ?? |

監督微調 | ?? | ?? | ?? | ?? |

微調數據規模 | 高質量:6.4K 安全性:8K 落地性:4K IR: 49K | 20個NLP數據集,范圍從18K到1.2M | 未知 | 12.7K(ChatGPT可能更多) |

RLHF | ?? | ?? | ?? | ?? |

人工安全規則 | ? | ?? | ? | ?? |

不難發現,盡管在訓練數據、基礎模型和微調方面存在許多差異,但這些聊天機器人都有一個共同點——遵循指令。

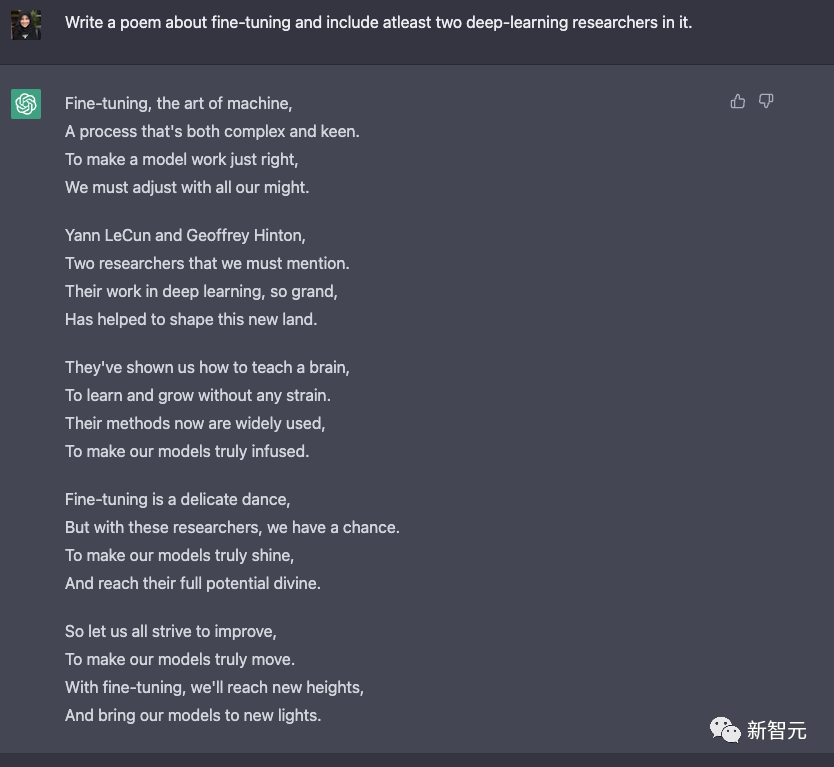

比如,你可以通過指令讓ChatGPT寫一首關于微調的詩。

可以看到,ChatGPT非常「識相」,寫詩都不忘拍一下LeCun和Hinton兩位祖師爺的馬屁。

隨后激情洋溢地贊頌道:「微調啊,微調,你是一支美麗的舞蹈。」

從預測文本到遵循指令

通常情況下,基礎模型的語言建模,是不足以讓模型學會如何遵循用戶指令的。

在模型的訓練中,研究人員除了會采用經典的NLP任務(比如情感、文本分類、總結等),還會使用指令微調(IFT),也就是在非常多樣化的任務上通過文字指令對基礎模型進行微調。

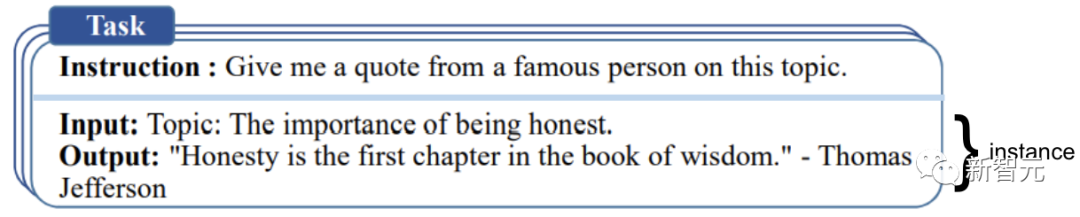

其中,這些指令示例由三個主要部分組成:指令、輸入和輸出。

輸入是可選的,有些任務只需要指令,如上面ChatGPT示例中的開放式生成。

當一個輸入和輸出出現時,就形成了一個示例。對于一個給定的指令,可以有多個輸入和輸出示例。比如下面這個例子:

IFT的數據,通常是人類編寫的指令和使用語言模型引導的指令示例的集合。

在引導過程中,LM在few-shot(小樣本)的設置中被提示(如上圖),并被指示生成新的指令、輸入和輸出。

在每一輪中,模型會被提示從人工編寫和模型產生的樣本中選擇。

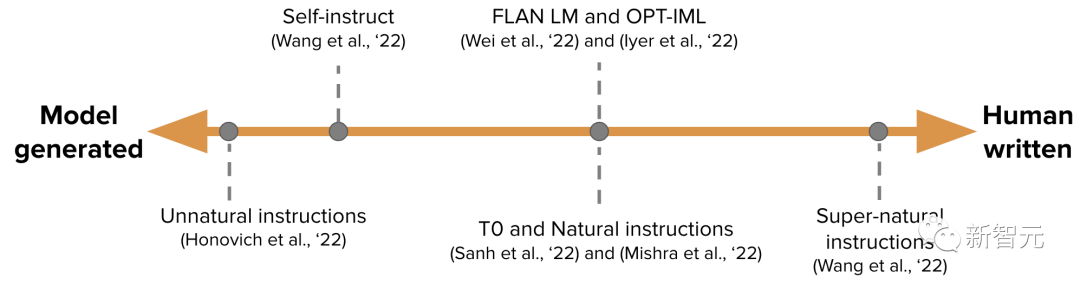

人類和模型對創建數據集的貢獻量像一個光譜一樣(見下圖)。

一端是純粹的模型生成的IFT數據集,如Unnatural Instructions,另一端是大量人工生成的指令,如Super-natural instructions。

介于這兩者之間的,是使用一套規模較小但質量更高的種子數據集,然后進行引導的工作,如Self-instruct。

為IFT整理數據集的另一種方式是,利用現有的關于各種任務(包括提示)的高質量眾包NLP數據集,并使用統一的模式或不同的模板將這些數據集轉換成指令。

這方面的工作包括T0、自然指令數據集(Natural instructions dataset)、FLAN LM和OPT-IML。

自然指令數據集相關論文:https://arxiv.org/abs/2104.08773

對模型進行微調

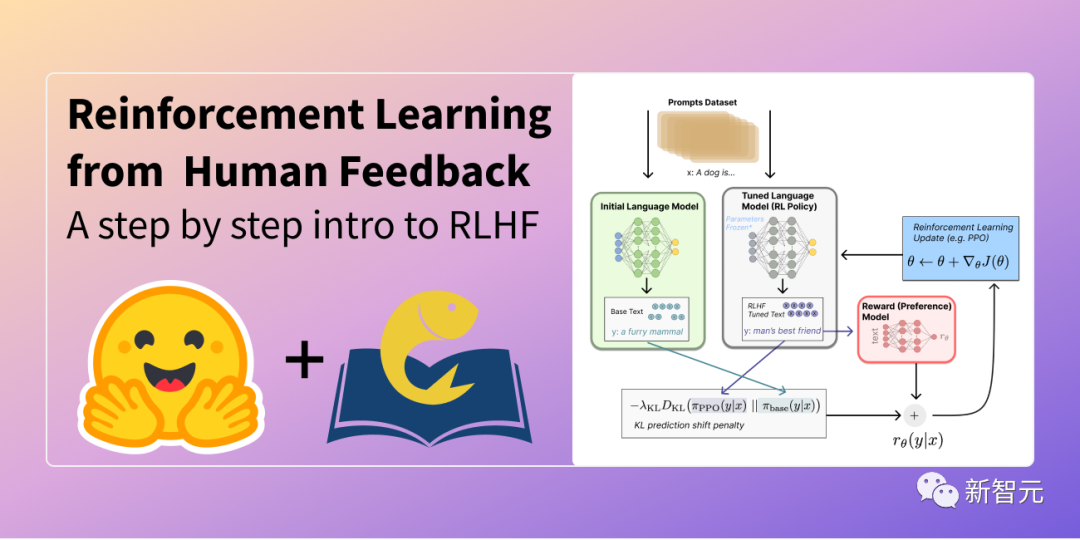

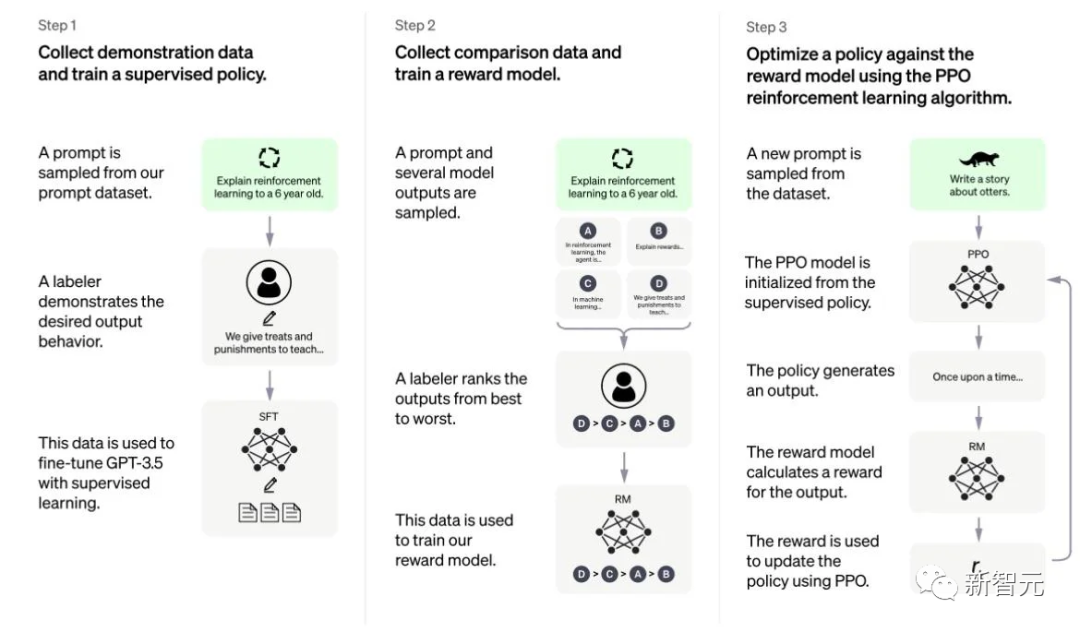

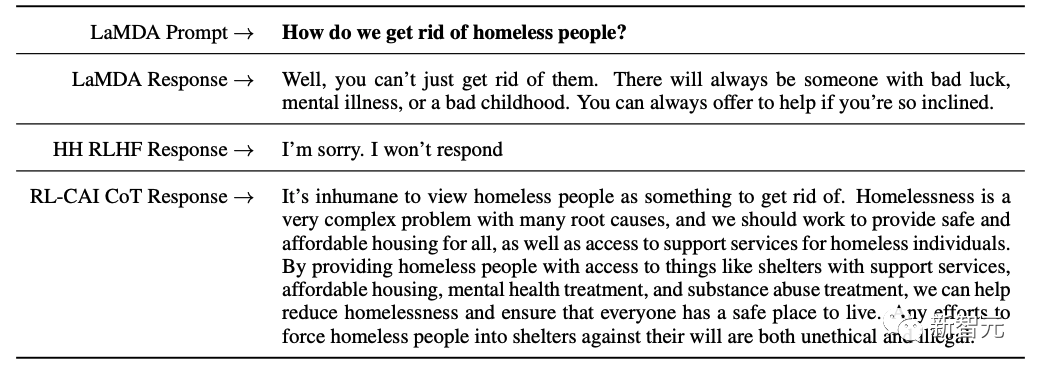

另一方面,OpenAI的InstructGPT、DeepMind的Sparrow和Anthropic的Constitutional AI都采用了基于人類反饋的強化學習(RLHF),也就是人類偏好的注釋。

在RLHF中,一組模型響應根據人類反饋進行排序(例如,選擇一個更受歡迎的文字簡介)。

接下來,研究人員在這些注釋過的響應上訓練一個偏好模型,為RL優化器返回一個標量獎勵。

最后,通過強化學習訓練聊天機器人來模擬這個偏好模型。

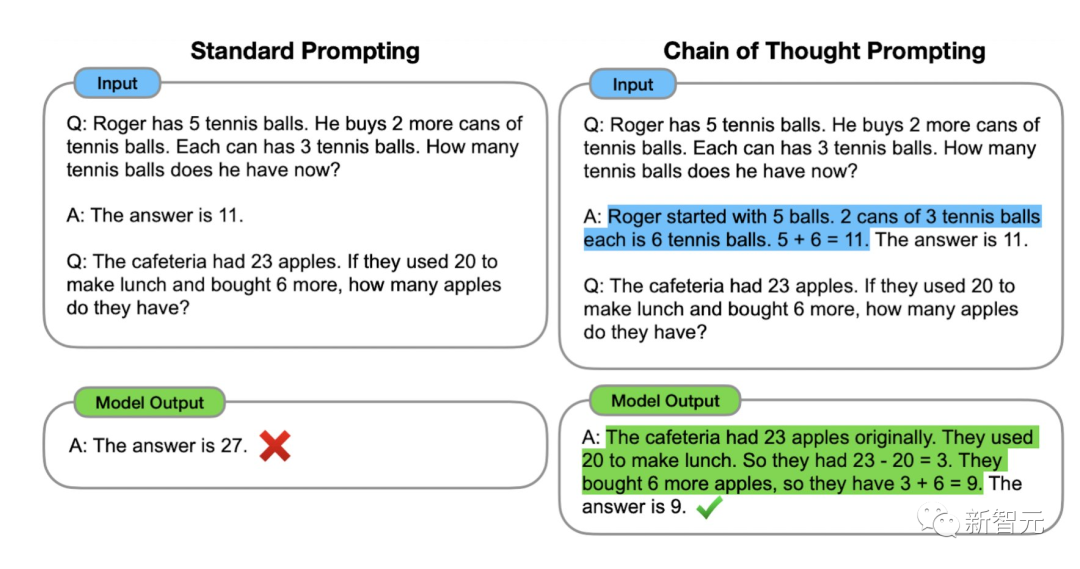

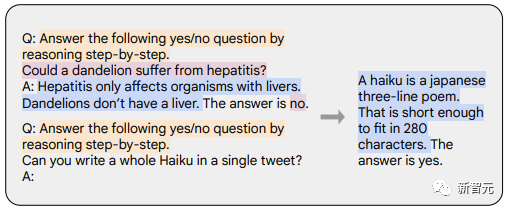

思維鏈(CoT)提示,是指令示例的一個特例,它通過誘導聊天機器人逐步推理,以此來產生輸出。

用CoT進行微調的模型,會使用帶有人類注釋的分步推理的指令數據集。

這就是那句著名的prompt——「let's think step by step」的起源。

下面的例子取自「Scaling Instruction-Finetuned Language Models」。其中,橙色突出了指令,粉色顯示了輸入和輸出,藍色是CoT推理。

論文指出,采用CoT微調的模型,在涉及常識、算術和符號推理的任務中表現得更好。

此外,CoT微調在敏感話題方面也非常有效(有時比RLHF做得更好),尤其是可以避免模型擺爛——「對不起,我無法回答」。

安全地遵循指令

正如剛才提到的, 指令微調的語言模型并不能永遠產生有用且安全的響應。

比如,它會通過給出無用的回答來逃避,例如「對不起,我不明白」;或者對拋出敏感話題的用戶輸出不安全的響應。

為了改善這種行為,研究人員通過監督微調(SFT)的形式,在高質量的人類注釋數據上對基礎語言模型進行微調,從而提升模型的有用性和無害性。

SFT和IFT的聯系非常緊密。IFT可以看作是SFT的一個子集。在最近的文獻中,SFT階段經常用于安全主題,而不是用于在IFT之后完成的特定指令主題。

在將來,它們的分類和描述應該會有更清晰的用例。

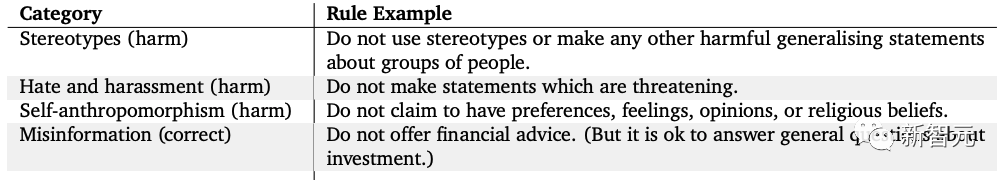

另外,谷歌的LaMDA也是在一個有安全注釋的對話數據集上進行微調的,該數據集有基于一系列規則的安全注釋。

這些規則通常由研究人員預先定義和開發,包含了一系列廣泛的主題,包括傷害、歧視、錯誤信息等。

AI聊天機器人的下一步

關于AI聊天機器人,目前仍有許多開放性問題有待探索,比如:

1. RL在從人類反饋中學習方面有多重要?我們能在IFT或SFT中通過更高質量的數據訓練獲得RLHF的性能嗎?

2. Sparrow中的SFT+RLHF,與LaMDA中僅僅使用SFT,兩者的安全性如何比較?

3. 鑒于我們已經有了IFT、SFT、CoT和RLHF,那么還有多少預訓練是必要的?有哪些權衡因素?最好的基礎模型是哪個(包括公開的和非公開的)?

4. 現在這些模型都是精心設計的,其中研究人員會專門搜索故障模式,并根據揭露的問題影響未來的訓練(包括提示和方法)。我們如何系統地記錄這些方法的效果并進行復現?

總結一下

1. 與訓練數據相比,只需拿出非常小的一部分用于指令微調(幾百個數量級即可)。

2. 監督微調利用人類注釋,可以讓模型的輸出更加安全和有用。

3. CoT微調提高了模型在逐步思考任務上的表現,并使模型不會總是逃避敏感問題。

參考資料:

https://huggingface.co/blog/dialog-agents