火爆的GPT-4來了!

3月14日,人工智能公司OpenAI發布了ChatGPT(GPT-3.5階段)的升級版GPT-4,讓原本已經略顯沉寂的ChatGPT話題再次迎來了“爆炸式熱議”,毫無懸念地沖上了社交平臺熱搜。“AI 終將取代人類”、“GPP-4考試能力強國90%的人類”等話題受到越來越多的用戶關注。

和之前的ChatGPT相比,此次GPT-4的升級堪稱“重磅級”:采用了“超大多模態模型”,回答準確率上大幅提升;輸出文本擴寫能力增強,處理上限增加至2.5W個單詞;在純文本輸入基礎上增加了圖像識別;創造力大幅提升,能夠處理更細微的指令......

和ChatGPT相比,GPT-4是如此之優秀,帶來的可怕結果是:在用戶的瘋狂訂購下,OpenAI付款系統宕機了。

扔掉Chat之后,GPT-4更強大了

如果說基于GPT-3.5模型的ChatGPT還是個在及格線徘徊的”差生“,那么GPT-4的實力則有望踏入”尖子生“行列,不僅更加智能,也更加難以被“欺騙”。

扔掉Chat的前綴后,GPT-4能力發生了明顯的變化。簡單來說,隨著OpenAI在深度學習方向上的不斷擴展,GPT-4朝著“更像人”的方向邁出了一大步,它甚至參加了美國律師資格考試 Uniform Bar Exam、法學院入學考試 LSAT等,成績排在前20%;還有用戶在 YouTube上進行直播用GPT-4寫文章、寫代碼、報稅、寫詩、講笑話……

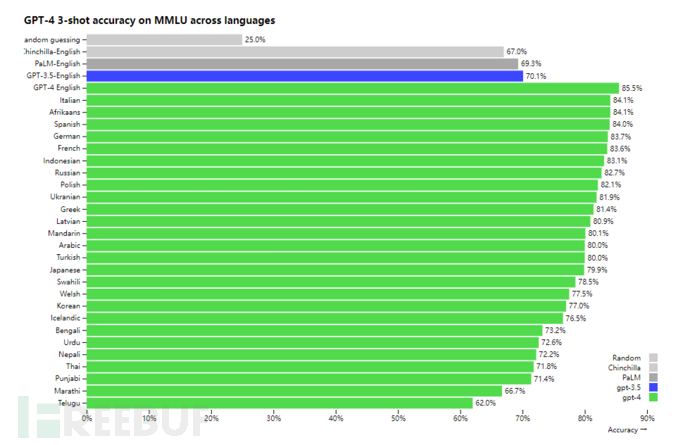

通過對26種語言進行測試,GPT-4在24種語言方面的表現均優于GPT-3.5等其他大語言模型,包括拉脫維亞語、威爾士語和斯瓦希里語等低資源語言,其中對中文識別的準確性達到了80.1%(下圖)。

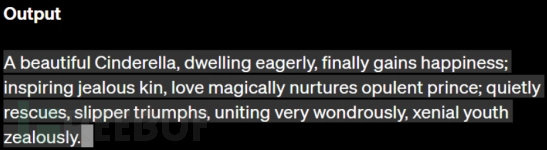

OpenAI演示了一段用GPT-4用26個單詞寫作的《灰姑娘》故事梗概,其中這26個單詞的首字母正好對應26個字母從A到Z的正確排序,足以證明GPT-4在詞匯量及語言創作方面能力的強大。

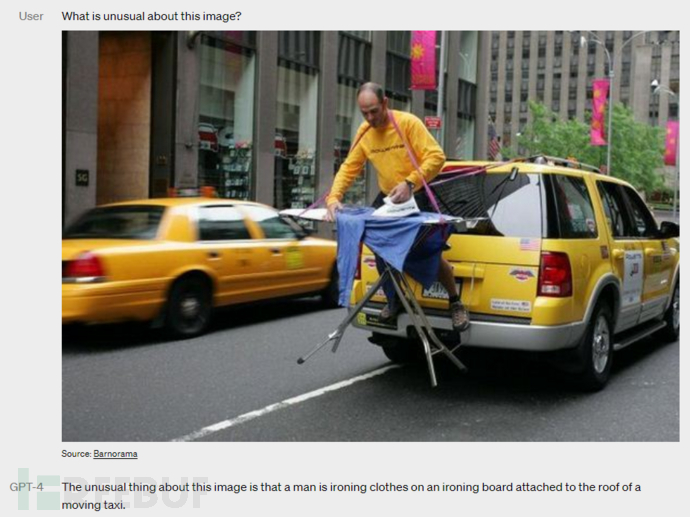

但最大的更新之處,在于GPT-4在圖片識別方面的支持,能夠在讀懂圖片內容的基礎上,給出有邏輯的回答。比如當用戶問下圖有何特別之處,GPT-4能夠直接描述出是”一名男子正在行駛中的出租車車頂上的熨衣板上熨燙衣服“。

在另一個例子中,GPT-4能夠按照用戶要求,在”讀懂“論文的基礎上給出摘要,并能對其中的某個試驗過程進行精簡的描述。

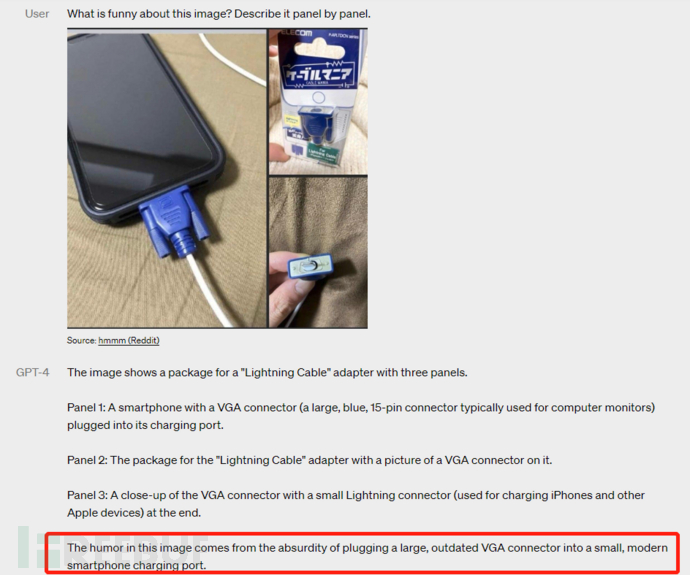

此外,GPT-4還能在一定程度上讀懂網絡上流行的搞笑”梗圖“,比如能夠描述出下圖的搞笑之處在于”將過時的大型 VGA 連接器插入小型現代智能手機充電端口的荒謬做法“。

GPT-4將會成為黑客手中的利劍?

首先我們必須意識到一個問題,越來越智能的GPT-4會不會帶來更加可怕的安全風險,或者成為網絡犯罪組織手中的“利劍”?

在ChatGPT版本,FreeBuf曾深入探討其在網絡犯罪方面被利用的情況,以及可能給網絡空間帶來的安全風險。

一是其本身的風險。

例如安全專家在ChatGPT生成的內容中發現了與公司內部機密十分相似的文本,原因可能是亞馬遜員工在使用ChatGPT生成代碼和文本時輸入了公司內部數據信息。那么,在GPT-4中,這樣的安全隱患將會仍舊存在,各大巨頭依舊會對GPT進行防守。

在網安政策方面,GPT-4同樣面臨踩紅線的危險。例如是否違反了GDPR的“最小數據”原則,是否滿足“被遺忘權”或“刪除權”,對于公共數據的使用是否合規,對于學術型、知識產權型信息的收集適合符合當前的法律、法規。

目前,我國《網絡安全法》《數據保護法》《個人信息保護法》對于數據的采集、使用都有細致的規定,僅從現有的情況來看,GPT-4顯然無法全部滿足這些要求。而且未來全球的法律體系將朝著“數據保護”的方向進一步細化,那時GPT將面臨更加嚴峻的合規壓力。

其次是使用GPT-4編輯代碼可能存在更多隱蔽的漏洞。

在ChatGPT-3.5階段,已經有企業和開發人員嘗試利用它來寫代碼和漏洞排查。在卡巴斯基的一項實驗中,分析師發現ChatGPT 可用于為未運行端點檢測和響應 (EDR) 系統、檢測代碼混淆或逆向工程代碼二進制文件的公司收集取證信息。

而更智能的GPT-4也被很多人給予厚望,當越來越多的開發人員使用GPT-4來編寫代碼,其中隱藏的漏洞將會成為更加可怕的定時炸彈,一旦被攻擊者利用,將會給整個網絡安全空間帶來難以言表的災難,尤其是在供應鏈安全領域需要提高警惕。

最后,如何防止GPT-4被黑客利用,從而給網絡安全防御帶來新的壓力。

一個十分明顯的事實是,從ChatGPT 階段開始,GPT 被用于黑產、網絡犯罪、黑客攻擊等領域的案例越來越多,未來甚至有可能成為常態。

例如Cybernews的研究人員曾發現,ChatGPT可以被黑客用于尋找網站的安全漏洞,在其幫助下,研究人員對一個普通網站進行了滲透測試,并在45分鐘內結合ChatGPT提供的建議和代碼更改示例完成了破解。

ChatGPT已經具備這樣的能力,更何況更加智能的GPT-4?短時間想要利用GPT-4對網絡安全體系產生實質性的強化似乎難以實現,但是被用于網絡犯罪卻已是近在眉睫,類似的安全風險該如何處理已經成為當下必須要思考的問題。

當然,在安全方面OpenAI也在持續努力。例如他們聘請了50 多位來自人工智能對接風險、網絡安全、生物風險、信任和安全以及國際安全等領域的專家對模型進行對抗性測試,訓練各種高風險場景,從而為緩解措施和模型的改進提供依據。例如通過搜集額外專業數據,以提高GPT-4拒絕有關如何合成危險化學品請求的能力。

但僅依靠這些,很明顯無法滿足安全的訴求,這也意味著我們需要從多方面入手來增強,以GPT-4為代表的人工智能在安全方面的能力,包括制定政策法規、以技術手段遏制作惡的風險等。

寫在最后

無論如何,科技的進步對于人類的發展有著不可估量的作用,但與此同時我們更需要對風險有清晰的認識。換言之,我們以積極的態度擁抱GPT-4,但是我們更要做好應對風險的準備。

正如二戰某領袖所說的那樣:我們改變不了別人的想法,既然他們要備戰,我們也要備戰。對于GPT-4也是如此,我們無法改變他人用它來“作惡”,但我們可以決定如何用它來“為善”。

AI這把劍,握在網安的手里,同樣異常鋒利。

我們做好準備!