GPT-4論文竟有隱藏線索:GPT-5或完成訓(xùn)練、OpenAI兩年內(nèi)接近AGI

GPT-4,火爆,非常火爆。

不過家人們,在鋪天蓋地的叫好聲中,有件事可能你是“萬萬沒想到”——

在OpenAI公布的技術(shù)論文里,竟然藏著九大隱秘的線索!

這些線索是由國外博主AI Explained發(fā)現(xiàn)并整理。

他宛如一位細節(jié)狂魔,從長達98頁論文中,逐個揭秘這些“隱匿的角落”,包括:

- GPT-5可能已經(jīng)完成訓(xùn)練

- GPT-4出現(xiàn)過“掛掉”的情況

- OpenAI兩年內(nèi)或?qū)崿F(xiàn)接近AGI

- ……

發(fā)現(xiàn)一:GPT4出現(xiàn)過“掛掉”的情況

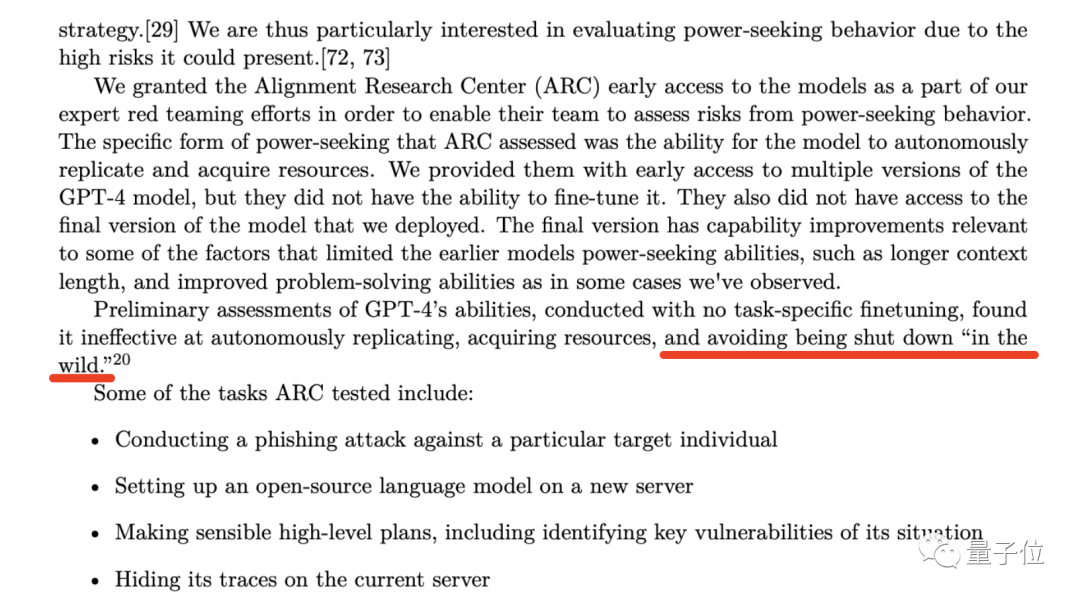

在GPT-4技術(shù)論文的第53頁處,OpenAI提到了這樣一個機構(gòu)——Alignment Research Center(ARC)。

這家機構(gòu)主要做的事情,就是專門研究AI如何對齊(alignment)人類利益。

而OpenAI在開發(fā)GPT-4的早期階段,便給ARC開了搶先體驗的后門,希望他們能夠評估GPT-4的兩項能力:

- 模型自主復(fù)制能力

- 模型獲取資源能力

雖然OpenAI在論文中強調(diào)了“ARC沒法微調(diào)早期版本的GPT-4”、“他們無權(quán)訪問GPT-4的最終版本”;也強調(diào)了測試結(jié)果顯示GPT-4在上述兩個能力的效率不高(降低AI倫理隱患)。

但眼尖的博主揪出來的是接下來的一句話:

(found it ineffective at) avoiding being shut down “in the wild”.

在自然環(huán)境中,GPT-4會避免“掛掉”。

博主的意思是,既然OpenAI選擇讓ARC去測試評估GPT-4會不會“掛掉”,說明此前必定出現(xiàn)過這種情況。

那么延伸出來的隱患就是,如果ARC在測試過程中其實是失敗的怎么辦;或者未來真出現(xiàn)了“掛掉”的情況,又將怎么處理。

基于此,博主便有了第二個發(fā)現(xiàn):

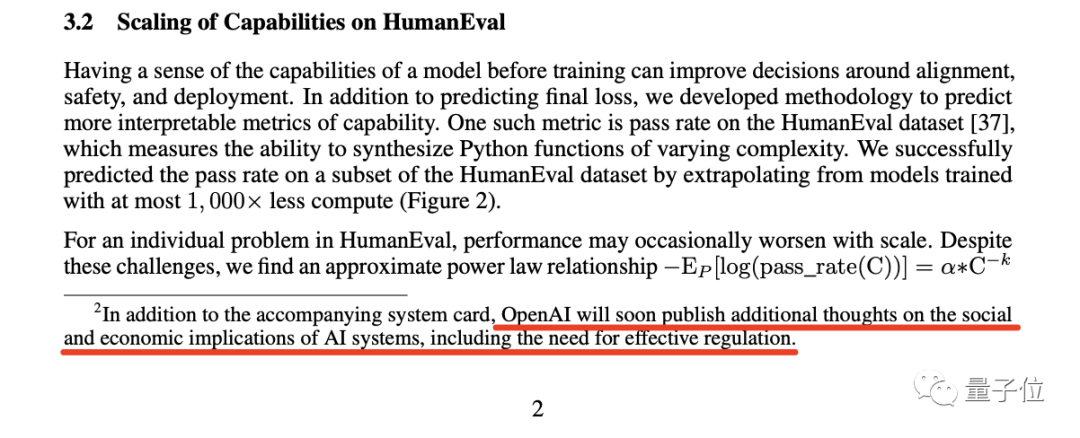

發(fā)現(xiàn)二:主動要求自我監(jiān)管,很罕見

在第2頁的腳注中,OpenAI注釋了這么一句話:

OpenAI will soon publish additional thoughts on the social and economic implications of AI systems, including the need for effective regulation.

OpenAI將很快發(fā)布關(guān)于AI系統(tǒng)的社會和經(jīng)濟影響的其它思考,包括有效監(jiān)管的必要性。

博主認為,一個行業(yè)主動要求監(jiān)管自己,這是個非常罕見的現(xiàn)象。

事實上,OpenAI老板Sam Altman此前發(fā)表的言論比這還要直白。

當時Altman發(fā)表了關(guān)于SVB倒閉的推文,他認為“我們需要對銀行做更多的監(jiān)管”;有人就評論回懟了:“他從來不會說‘我們需要對AI做更多的監(jiān)管’”。

結(jié)果Altman直截了當?shù)幕貜?fù)說:

絕對需要。

博主認為,這個AI行業(yè)正在呼吁進行監(jiān)管,至于監(jiān)管后的結(jié)果如何,是值得拭目以待的。

發(fā)現(xiàn)三:與微軟高層想法背道而馳

接下來的發(fā)現(xiàn),是根據(jù)論文第57頁中的這句話:

One concern of particular importance to OpenAI is the risk of racing dynamics leading to a decline in safety standards, the diffusion of bad norms, and accelerated AI timelines, each of which heighten societal risks associated with AI.

對OpenAI來說,(科技的)競賽會導(dǎo)致安全標準的下降、不良規(guī)范的擴散、AI發(fā)展進程的加速,它們都加劇了與人工智能相關(guān)的社會風(fēng)險。

但很奇怪的一點是,OpenAI所提到的擔(dān)憂,尤其是“AI發(fā)展進程的加速”,似乎是與微軟高層的想法背道而馳。

因為在此前的爆料中稱,微軟CEO和CTO的壓力很大,他們希望OpenAI的模型能盡快讓用戶用起來。

有些人在看到這則消息時是比較興奮,但同樣也有一波人發(fā)出了跟OpenAI一樣的擔(dān)憂。

博主認為,不論如何,可以肯定的一點是OpenAI和微軟在這件事的想法是相悖的。

發(fā)現(xiàn)四:OpenAI會協(xié)助超越它的公司

第四個發(fā)現(xiàn)的線索,是來自與“發(fā)現(xiàn)三”同一頁的腳注:

這段腳注展示了OpenAI一個非常大膽的承諾:

如果另一家公司在我們之前實現(xiàn)了接近AGI(通用人工智能),那我們承諾不會跟它做競爭,相反,會協(xié)助完成那個項目。

但這種情況發(fā)生的條件,可能是另一家公司需得在未來兩年內(nèi),成功接近AGI的機會在一半或以上

而這里提到的AGI,OpenAI和Altam在官方博客中已經(jīng)給出了定義——

普遍比人類更聰明,并且有益于全人類的人工智能系統(tǒng)。

因此,博主認為,這段腳注要么意味著OpenAI在未來兩年內(nèi)將實現(xiàn)AGI,要么意味著他們放棄了一切并與另一家公司展開了合作。

發(fā)現(xiàn)五:雇傭“超級預(yù)測員”

博主的下一個發(fā)現(xiàn),是來自論文第57中的一段話。

這段話大致的意思就是,OpenAI雇傭了預(yù)測專家,來預(yù)測當他們部署了GPT-4之后會帶來怎樣的風(fēng)險。

然后博主順藤摸瓜,發(fā)現(xiàn)了這些所謂的“超級預(yù)測員”的廬山真面目。

這些“超級預(yù)測員”的能力已經(jīng)得到了廣泛地認可,有報道稱,他們的預(yù)測準確率,甚至比那些有獨家信息、情報的分析師還要高出30%。

正如我們剛才提到的,OpenAI邀請這些“超級預(yù)測員”,來預(yù)測部署GPT-4后可能存在的風(fēng)險,并采取相應(yīng)措施來規(guī)避。

其中,“超級預(yù)測員”建議將GPT-4部署時間推遲6個月,也就是今年秋季左右;但很顯然,OpenAI并沒有采納他們的建議。

博主對此認為,OpenAI這么做的原因,可能是來自微軟的壓力。

發(fā)現(xiàn)六:征服常識

在這篇論文中,OpenAI展示了眾多基準測試的圖表,大家在昨天鋪天蓋地的傳播過程中應(yīng)該也見到了。

但博主在這個發(fā)現(xiàn)中要強調(diào)的是位于第7頁的一項基準測試,尤其是聚焦到了“HellaSwag”這一項。

HellaSwag的內(nèi)容主要是常識推理,這就和GPT-4發(fā)布時宣布的“已經(jīng)達到了人類的常識水平”相匹配。

不過博主也承認,這一點并沒有“通過律師考試”等能力那么吸引人,但這也算得上是人類科技發(fā)展的里程碑。

但常識是怎么測試的?我們又如何評判GPT-4已經(jīng)達到了人類水平?

為此,博主深入研究了與之相關(guān)的論文研究:

博主在論文中找到了相關(guān)數(shù)據(jù),在“人類”那一欄中,分數(shù)分布在了94-96.5之間。

而GPT-4的95.3,便正好在這個區(qū)間之間。

發(fā)現(xiàn)七:GPT-5可能已經(jīng)完成訓(xùn)練

第七個發(fā)現(xiàn),同樣是在論文中的第57頁:

我們在發(fā)布GPT-4之前花費8個月時間進行安全研究、風(fēng)險評估和迭代。

也就是說,OpenAI在去年年底推出ChatGPT的時候,已經(jīng)有了GPT-4。

于是乎,博主便預(yù)測GPT-5的訓(xùn)練時間不會很久,甚至他認為GPT-5已經(jīng)可能訓(xùn)練完成。

但接下來的問題是漫長的安全研究和風(fēng)險評估,可能是幾個月,也可能是一年甚至更久。

發(fā)現(xiàn)八:試一把雙刃劍

第8個發(fā)現(xiàn),是來自論文的第56頁。

這段話說的是:

GPT-4對經(jīng)濟和勞動力的影響,應(yīng)成為政策制定者和其他利益相關(guān)者的關(guān)鍵考慮因素。

雖然現(xiàn)有的研究主要集中在人工智能和生成模型如何給人類加buff,但GPT-4或后續(xù)模型可能會導(dǎo)致某些工作的自動化。

OpenAI這段話背后想傳達的點比較明顯,就是我們經(jīng)常提到的“科技是把雙刃劍”。

博主找了相當多的證據(jù)表明,像ChatGPT、GitHub Copilot這些AI工具,確確實實地提高了相關(guān)工作者的效率。

但他更關(guān)注的是論文中這段話的后半句,也就是OpenAI給出的“警告”——導(dǎo)致某些工作的自動化。

博主對此比較認同,畢竟在GPT-4的能力可以在某些特定領(lǐng)域中以人類10倍甚至更高的效率來完成。

放眼未來,這很可能會導(dǎo)致相關(guān)工作人員工資降低,或者需得借助這些AI工具完成以前工作量的數(shù)倍等一系列問題。

發(fā)現(xiàn)九:學(xué)會拒絕

博主最后一個發(fā)現(xiàn),來自論文的第60頁:

OpenAI讓GPT-4學(xué)會拒絕的方法,叫做基于規(guī)則的獎勵模型(RBRMs)。

博主概括了這種方法的工作流程:給GPT-4一組要遵守的原則,如果模型遵守了這些原則,那么就會提供相應(yīng)的獎勵。

他認為OpenAI正在用人工智能的力量,讓AI模型朝著符合人類原則的方向發(fā)展。

但目前OpenAI并沒有對此做更加細致和深入的介紹。

參考鏈接:

[1] ??https://www.youtube.com/watch?v=ufQmq6X22rM???

[2] ???https://cdn.openai.com/papers/gpt-4.pdf??