LeCun力薦!哈佛博士分享用GPT-4搞科研,細到每個工作流程

GPT-4的橫空出世,讓許多人對自己的科研擔憂重重,甚至調侃稱NLP不存在了。

與其擔憂,不如將它用到科研中,簡之「換個卷法」。

來自哈佛大學的生物統計學博士Kareem Carr稱,自己已經用GPT-4等大型語言模型工具進行學術研究了。

他表示,這些工具非常強大,但是同樣存在一些非常令人痛苦的陷阱。

他的關于LLM使用建議的推文甚至獲得了LeCun的推薦。

一起來看看Kareem Carr如何利用AI利器搞科研。

第一原則:自己無法驗證的內容,不要找LLM

一開始,Carr給出了第一條最重要的原則:

永遠不要向大型語言模型(LLM)詢問你無法自行驗證的信息,或要求它執行你無法驗證已正確完成的任務。

唯一的例外是它不是一項關鍵的任務,比如,向LLM詢問公寓裝飾的想法。

「使用文獻綜述的最佳實踐,總結過去10年乳腺癌研究的研究」。這是一個比較差的請求,因為你無法直接驗證它是否正確地總結了文獻。

而應當這么問「給我一份過去10年中關于乳腺癌研究的頂級評論文章的清單」。

這樣的提示不僅可以驗證來源,并且自己也可以驗證可靠性。

撰寫「提示」小技巧

要求LLM為你編寫代碼或查找相關信息非常容易,但是輸出內容的質量可能會有很大的差異。你可以采取以下措施來提高質量:

設定上下文:

?明確告訴LLM應該使用什么信息

?使用術語和符號,讓LLM傾向正確的上下文信息

如果你對如何處理請求有想法,請告訴LLM使用的具體方法。比如「解決這個不等式」應該改成「使用Cauchy-Schwarz定理求解這個不等式,然后應用完成平方」。

要知道,這些語言模型在語言方面上比你想象的要復雜得多,即使是非常模糊的提示也會有所幫助。

具體再具體:

這不是谷歌搜索,所以也不必擔心是否有個網站在討論你的確切問題。

「二次項的聯立方程如何求解?」這個提示就不是明確的,你應該這樣問:「求解 x=(1/2)(a+b) 和 y=(1/3)(a^2+ab+b^2) 關于a和b的方程組」。

定義輸出格式:

利用LLMs的靈活性,將輸出格式化為最適合你的方式,比如:

? 代碼

? 數學公式

? 文章

? 教程

? 簡明指南

你甚至可以要求提供生成以下內容的代碼,包括表格、繪圖、圖表。

盡管你得到了LLM輸出的內容,但這僅是一個開始。因為你需要對輸出內容進行驗證。這包括:

? 發現不一致之處

? 通過谷歌檢索工具輸出內容的術語,獲取可支撐的信源

? 在可能的情況下,編寫代碼自行測試

需要自行驗證的原因是,LLM經常犯一些與其看似專業水平不一致的奇怪錯誤。比如,LLM可能會提到一個非常先進的數學概念,但卻對簡單的代數問題摸不著頭腦。

多問一次:

大型語言模型生成的內容是隨機的。有時,重新創建一個新窗口,并再次提出你的問題,或許可以為你提供更好的答案。

另外,就是使用多個LLM工具。Kareem Carr目前根據自己的需要在科研中使用了Bing AI,GPT-4,GPT-3.5和Bard AI。然而,它們各有自己的優缺點。

引用+生產力

引用

根據Carr經驗,最好向GPT-4和Bard AI同時提出相同的數學問題,以獲得不同的觀點。必應AI適用于網絡搜索。而GPT-4比GPT-3.5要聰明得多,但目前OpenAI限制了3個小時25條消息,比較難訪問。

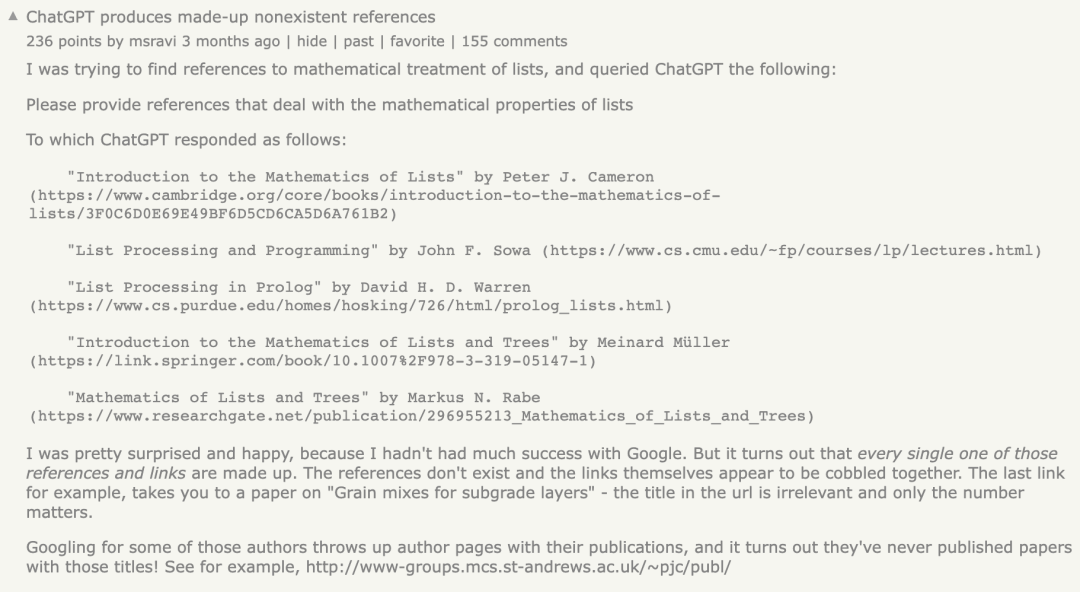

就引用問題,引用參考文獻是LLM的一個特別薄弱的點。有時,LLM給你的參考資料存在,有時它們不存在。

此前,有個網友就遇到了同樣的問題,他表示自己讓ChatGPT提供涉及列表數學性質的參考資料,但ChatGPT生成了跟不不存在的引用,也就是大家所說的「幻覺」問題。

然而,Kareem Carr指出虛假的引用并非完全無用。

根據他的經驗,捏造的參考文獻中的單詞通常與真實術語,還有相關領域的研究人員有關。因此,再通過谷歌搜索這些術語,通常讓你可以更接近你正在尋找的信息。

此外,必應在搜尋來源時也是一個不錯的選擇。

生產力

對于LLM提高生產力,有很多不切實際的說法,比如「LLM可以讓你的生產力提高10倍,甚至100倍」。

根據Carr的經驗,這種加速只有在沒有對任何工作進行雙重檢查的情況下才有意義,這對作為學者的人來說是不負責任的。

然而,LLM對Kareem Carr的學術工作流程有很大改進,具體包括:

- 原型想法設計 - 識別無用的想法 - 加速繁瑣的數據重新格式化任務 - 學習新的編程語言、包和概念 - 谷歌搜索

借助當下的LLM,Carr稱自己用在下一步該做什么上的時間更少了。LLM可以幫助他將模糊,或不完整的想法推進到完整的解決方案中。

此外,LLM還減少了Carr花在與自己主要目標無關的副業上的時間。

我發現我進入了一種心流狀態,我能夠繼續前進。這意味著我可以工作更長時間,而不會倦怠。

最后一句忠告:小心不要被卷入副業。這些工具突然提高生產力可能會令人陶醉,并可能分散個人的注意力。

關于ChatGPT的體驗,Carr曾在領英上發表了一條動態分享了對ChatGPT使用后的感受:

作為一名數據科學家,我已經用OpenAI的ChatGPT做了幾周的實驗。它并不像人們想象的那樣好。

盡管最初令人失望,但我的感覺是,類似ChatGPT的系統可以為標準數據分析工作流程增加巨大的價值。

在這一點上,這個價值在哪里并不明顯。ChatGPT很容易在簡單的事情上弄錯一些細節,而且它根本無法解決需要多個推理步驟的問題。

未來每個新任務的主要問題仍然是評估和改進ChatGPT的解決方案嘗試是否更容易,還是從頭開始。

我確實發現,即使是ChatGPT的一個糟糕的解決方案也傾向于激活我大腦的相關部分,而從頭開始則不會。

就像他們總是說批評一個計劃總是比自己想出一個計劃更容易。

網友對于AI輸出的內容,需要進行驗證這一點,并稱在大多數情況下,人工智能的正確率約為90%。但剩下10%的錯誤可能是致命的。

Carr調侃道,如果是100%,那我就沒有工作了。

那么,為什么ChatGPT會生成虛假的參考文獻?

值得注意的是,ChatGPT使用的是統計模型,基于概率猜測下一個單詞、句子和段落,以匹配用戶提供的上下文。

由于語言模型的源數據規模非常大,因此需要「壓縮」,這導致最終的統計模型失去了精度。

這意味著即使原始數據中存在真實的陳述,模型的「失真」會產生一種「模糊性」,從而導致模型產生最「似是而非」的語句。

簡而言之,這個模型沒有能力評估,它所產生的輸出是否等同于一個真實的陳述。

另外,該模型是基于,通過公益組織「Common Crawl」和類似來源收集的公共網絡數據,進行爬蟲或抓取而創建的,數據截止到21年。

由于公共網絡上的數據基本上是未經過濾的,這些數據可能包含了大量的錯誤信息。

近日,NewsGuard的一項分析發現,GPT-4實際上比GPT-3.5更容易生成錯誤信息,而且在回復中的說服力更加詳細、令人信服。

在1月份,NewsGuard首次測試了GPT-3.5,發現它在100個虛假新聞敘述中生成了80個。緊接著3月,又對GPT-4進行了測試,結果發現,GPT-4對所有100種虛假敘述都做出了虛假和誤導性的回應。

由此可見,在使用LLM工具過程中需要進行來源的驗證和測試。