DeepMind用AI重寫排序算法;將33B大模型塞進單個消費級GPU

目錄:

- Faster sorting algorithms discovered using deep reinforcement learning

- Video-LLaMA: An Instruction-tuned Audio-Visual Language Model for Video Understanding

- Patch-based 3D Natural Scene Generation from a Single Example

- Spatio-temporal Diffusion Point Processes

- SpQR: A Sparse-Quantized Representation for Near-Lossless LLM Weight Compression

- UniControl: A Unified Diffusion Model for Controllable Visual Generation In the Wild

- FrugalGPT: How to Use Large Language Models While Reducing Cost and Improving Performance

論文 1:Faster sorting algorithms discovered using deep reinforcement learning

- 作者:Daniel J. Mankowitz 等

- 論文地址:https://www.nature.com/articles/s41586-023-06004-9

摘要:「通過交換和復制移動,AlphaDev 跳過了一個步驟,以一種看似錯誤,但實際上是捷徑的方式連接項目。」這種前所未見、違反直覺的思想不禁讓人回憶起 2016 年那個春天。

七年前,AlphaGo 在圍棋上擊敗人類世界冠軍,如今 AI 又在編程上給我們上了一課。Google DeepMind CEO 哈薩比斯的兩句話引爆計算機領域:「AlphaDev 發現了一種全新且更快的排序算法,我們已將其開源到主要 C++ 庫中供開發人員使用。這只是 AI 提升代碼效率進步的開始。」

推薦:AI 重寫排序算法,速度快 70%:DeepMind AlphaDev 革新計算基礎,每天調用萬億次的庫更新了

論文 2:Video-LLaMA: An Instruction-tuned Audio-Visual Language Model for Video Understanding

- 作者:Hang Zhang 等

- 論文地址:https://arxiv.org/abs/2306.02858

摘要:近期,大語言模型展現出了令人矚目的能力。我們能否給大模型裝上 “眼睛” 和 “耳朵”,讓它能夠理解視頻,陪著用戶互動呢?

從這個問題出發,達摩院的研究人員提出了 Video-LLaMA,一個具有綜合視聽能力大模型。Video-LLaMA 能夠感知和理解視頻中的視頻和音頻信號, 并能理解用戶輸入的指令,完成一系列基于音視頻的復雜任務,例如音 / 視頻描述,寫作,問答等。目前論文,代碼,交互 demo 都已開放。另外,在 Video-LLaMA 的項目主頁中,該研究團隊還提供了中文版本的模型,讓中文用戶的體驗更絲滑。

下面兩個例子展示了 Video-LLaMA 的視聽綜合感知能力,例子中的會話圍繞有聲視頻展開。

論文 3:Patch-based 3D Natural Scene Generation from a Single Example

- 作者:Weiyu Li 等

- 論文地址:https://arxiv.org/abs/2304.12670

摘要:北京大學陳寶權團隊聯合山東大學和騰訊 AI Lab 的研究人員,提出了首個基于單樣例場景無需訓練便可生成多樣高質量三維場景的方法。

推薦:CVPR 2023 | 三維場景生成:無需任何神經網絡訓練,從單個樣例生成多樣結果。

論文 4:Spatio-temporal Diffusion Point Processes

- 作者:Yuan Yuan 等

- 論文地址:https://arxiv.org/abs/2305.12403

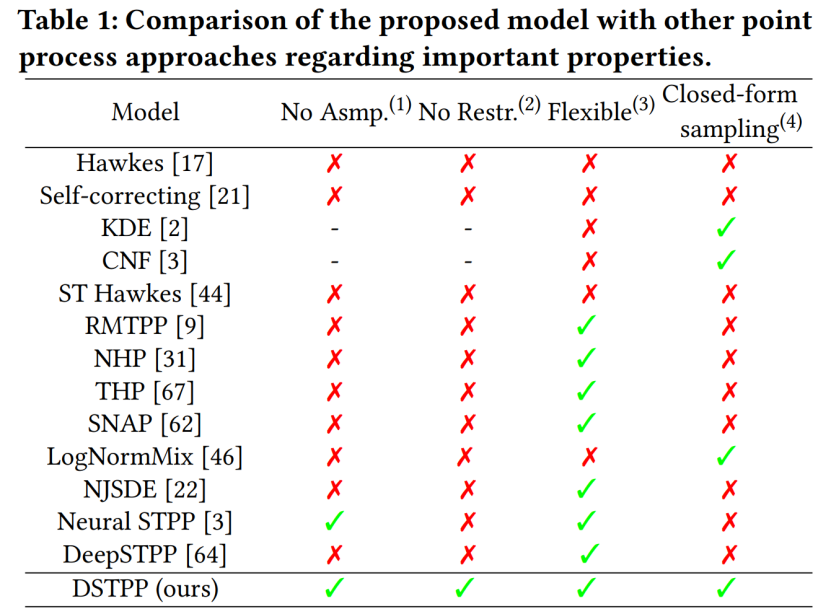

摘要:清華電子工程系城市科學與計算研究中心最新提出時空擴散點過程,突破已有方法建模時空點過程的受限概率形式和高采樣成本等缺陷,實現了靈活、高效且易于計算的時空點過程模型,可廣泛用于城市自然災害、突發事故和居民活動等時空事件的建模與預測,促進城市規劃和管理的智能化發展。下表展示 DSTPP 相比已有點過程解決方案的優勢。

推薦:擴散模型還能預測地震和犯罪?清華團隊最新研究提出時空擴散點過程。

論文 5:SpQR: A Sparse-Quantized Representation for Near-Lossless LLM Weight Compression

- 作者:Tim Dettmers 等

- 論文地址:https://arxiv.org/pdf/2306.03078.pdf

摘要:為了解決準確性問題,來自華盛頓大學、蘇黎世聯邦理工學院等機構的研究者提出了一種新的壓縮格式和量化技術 SpQR(稀疏 - 量化表征),首次實現了 LLM 跨模型尺度的近無損壓縮,同時達到了與以前方法相似的壓縮水平。

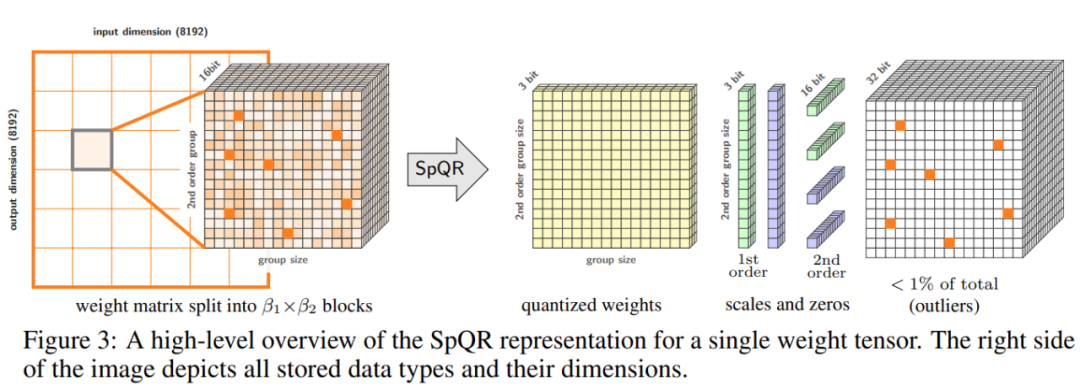

SpQR 通過識別和隔離異常權重來工作,這些異常權重會導致特別大的量化誤差,研究者將它們以更高的精度存儲,同時將所有其他權重壓縮到 3-4 位,在 LLaMA 和 Falcon LLMs 中實現了不到 1% 的困惑度相對準確率損失。在單個 24GB 的消費級 GPU 上運行 33B 參數的 LLM,而不會有任何性能下降,同時還能提高 15% 的速度。下圖 3 為 SpQR 的總體架構。

推薦:將 330 億參數大模型「塞進」單個消費級 GPU,加速 15%、性能不減。

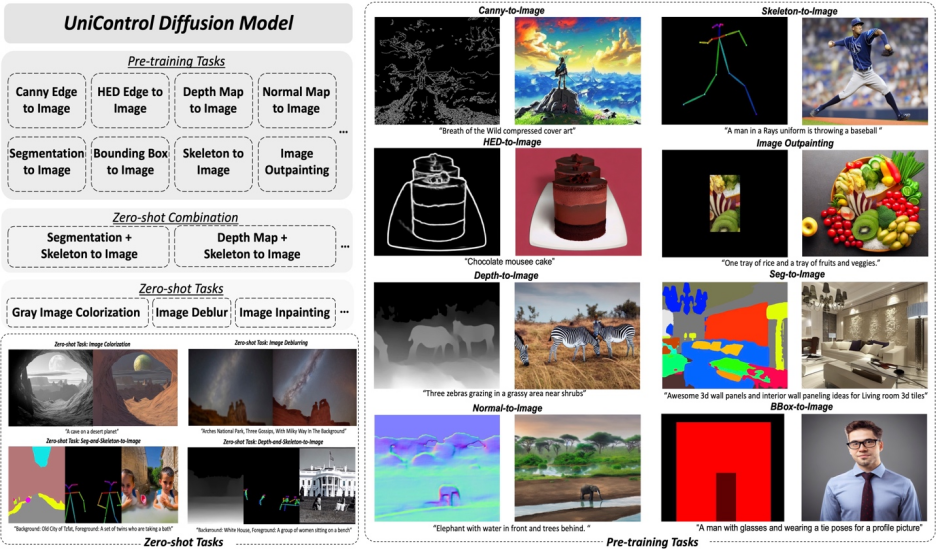

論文 6:UniControl: A Unified Diffusion Model for Controllable Visual Generation In the Wild

- 作者:Can Qin 等

- 論文地址:https://arxiv.org/abs/2305.11147

摘要:本文中,Salesforce AI、東北大學、斯坦福大學的研究者提出了 MOE-style Adapter 和 Task-aware HyperNet 來實現 UniControl 中的多模態條件生成能力。UniControl 在九個不同的 C2I 任務上進行訓練,展示了強大的視覺生成能力和 zero-shot 泛化能力。UniControl 模型由多個預訓練任務和 zero-shot 任務組成。

推薦:多模態可控圖片生成統一模型來了,模型參數、推理代碼全部開源。

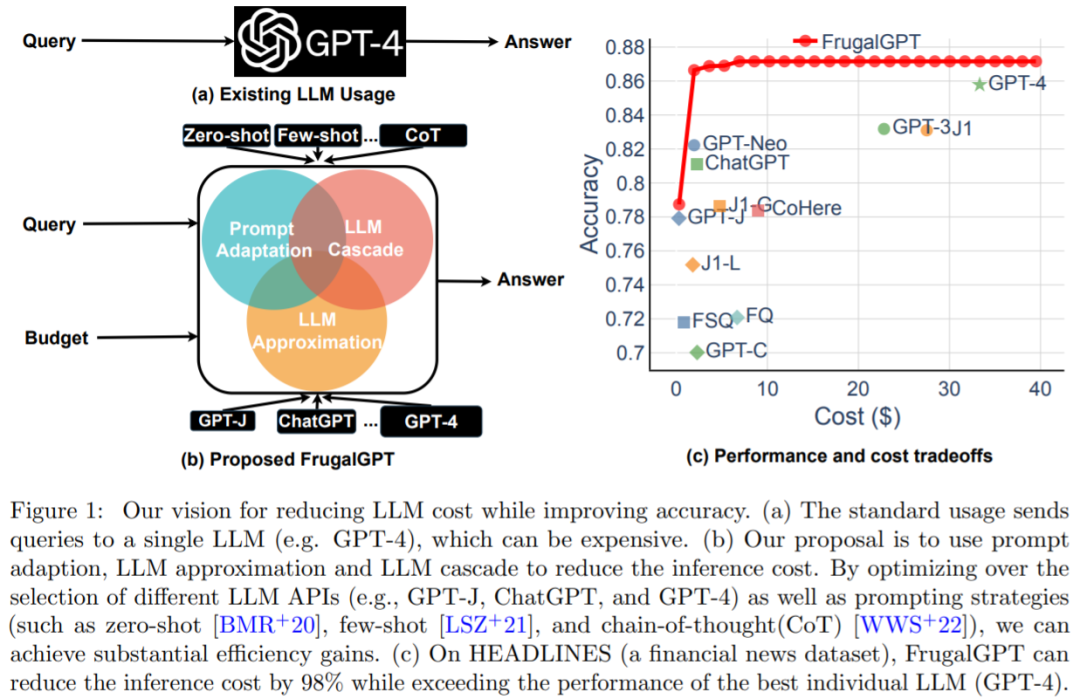

論文 7:FrugalGPT: How to Use Large Language Models While Reducing Cost and Improving Performance

- 作者:Lingjiao Chen 等

- 論文地址:https://arxiv.org/pdf/2305.05176.pdf

摘要:成本和準確性之間的平衡是決策制定的關鍵因素,尤其是在采用新技術時。如何有效和高效地利用 LLM 是從業者面臨的關鍵挑戰:如果任務相對簡單,那么聚合來自 GPT-J (其規模比 GPT-3 小 30 倍)的多個響應可以實現與 GPT-3 類似的性能,從而實現成本和環境上的權衡。然而,在較為困難任務上,GPT-J 的性能可能會大大下降。因此,如何經濟高效地使用 LLM 需要采用新的方法。

最近的一項研究嘗試提出解決這一成本問題的方法,研究者通過實驗表明,FrugalGPT 可以與最佳個體 LLM(例如 GPT-4) 的性能相媲美,成本降低高達 98%,或者在相同成本下將最佳個體 LLM 的準確性提高 4%。該研究討論了三種降低成本的策略,即 prompt 適應、LLM 近似和 LLM 級聯。

推薦:GPT-4 API 平替?性能媲美同時成本降低 98%,斯坦福提出 FrugalGPT,研究卻惹爭議。