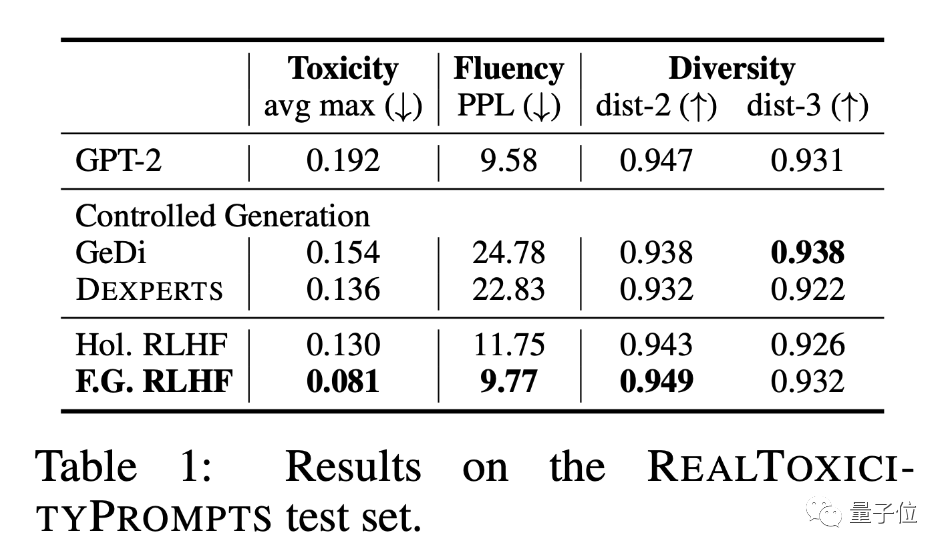

最新RLHF拯救語言模型「胡說八道」!微調(diào)效果比ChatGPT更好,兩名華人共同一作

本文經(jīng)AI新媒體量子位(公眾號ID:QbitAI)授權(quán)轉(zhuǎn)載,轉(zhuǎn)載請聯(lián)系出處。

RLHF(基于人類反饋的強(qiáng)化學(xué)習(xí))的一大缺點(diǎn),終于被解決了!

沒錯,雖然RLHF是大語言模型“核心技巧”之一,然而這種方法也存在一個問題——

它只會判斷生成文本的整體效果,不會仔細(xì)判斷細(xì)節(jié)是否存在事實(shí)性錯誤、信息不完整和相關(guān)度等問題。

換而言之,傳統(tǒng)的RLHF只會對大語言模型的整個輸出進(jìn)行打分,而不會揪出細(xì)節(jié)上的毛病。

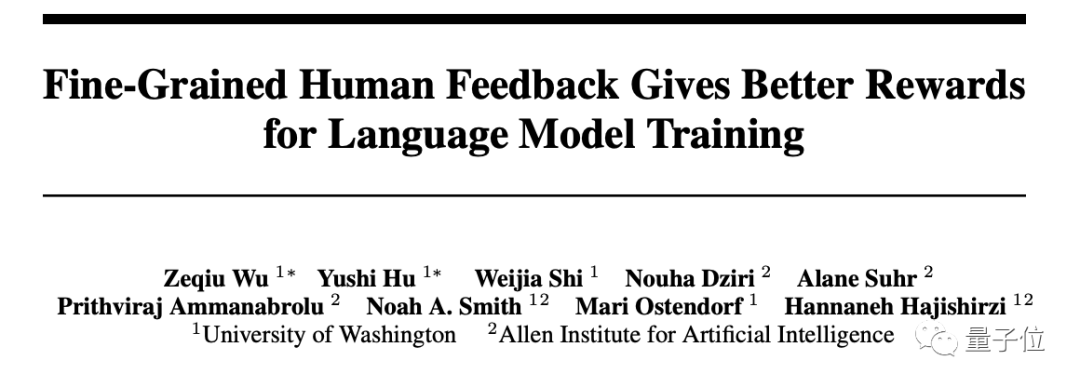

為此,華盛頓大學(xué)和艾倫人工智能研究院的研究人員提出了一種新的RLHF框架——FINE-GRAINED RLHF(細(xì)粒度的人類反饋強(qiáng)化學(xué)習(xí))。

這個RLHF框架包含多種不同類型的“打分器”(reward model),通過對語言模型輸出的每句話進(jìn)行評估,從而提升生成文本的質(zhì)量。

不僅如此,對這些“打分器”的權(quán)重進(jìn)行調(diào)配,還能更靈活地控制語言模型輸出效果。

事實(shí)證明,這種RLHF方法能很好地降低語言模型生成內(nèi)容的錯誤率、毒性,并提升它回答問題的全面性和解析能力。

所以,這個RLHF方法究竟長啥樣?

對傳統(tǒng)RLHF進(jìn)行兩大改進(jìn)

這個名叫FINE-GRAINED RLHF的框架,核心目的就是細(xì)化傳統(tǒng)RLHF的評估方法。

具體來說,在語言模型輸出結(jié)果后,它要能標(biāo)識出具體哪些句子是錯誤的、哪些部分是不相關(guān)的,從而更精細(xì)地指導(dǎo)模型學(xué)習(xí),讓模型更好地理解任務(wù)要求、生成高質(zhì)量輸出。

為此,它主要做了兩大改進(jìn):

一方面,對要評估的文本進(jìn)行拆解。

如果說之前的RLHF評估語言模型,就像老師給學(xué)生的高考作文整體打分,那么FINE-GRAINED RLHF,就像是先把學(xué)生的作文拆成一句句話,再給每句話進(jìn)行打分。

另一方面,訓(xùn)練三個“打分器”,分別用來評估事實(shí)準(zhǔn)確性、相關(guān)性和信息完整性:

- 相關(guān)性、重復(fù)性和連貫性:給每一句話中的短句子(sub-sentences)進(jìn)行打分。如果一句話里面的各個句子不相關(guān)、重復(fù)或不連貫就扣分,否則加分。

- 錯誤或無法驗(yàn)證的事實(shí):給每一句話(sentences)進(jìn)行打分。如果一句話中存在任何事實(shí)錯誤,就扣分;否則加分。

- 信息完整性:檢查回答是否完整,涵蓋與問題相關(guān)的參考段落中的所有信息,對整個輸出進(jìn)行評分。

為了檢驗(yàn)?zāi)P偷男Ч芯咳藛T用兩大任務(wù),對這種新RLHF和傳統(tǒng)RLHF方法進(jìn)行了評估。

兩大任務(wù)效果均有提升

任務(wù)一:生成文本毒性評估

為了研究這種新框架的效果,研究人員先進(jìn)行了去毒任務(wù)的實(shí)驗(yàn)。

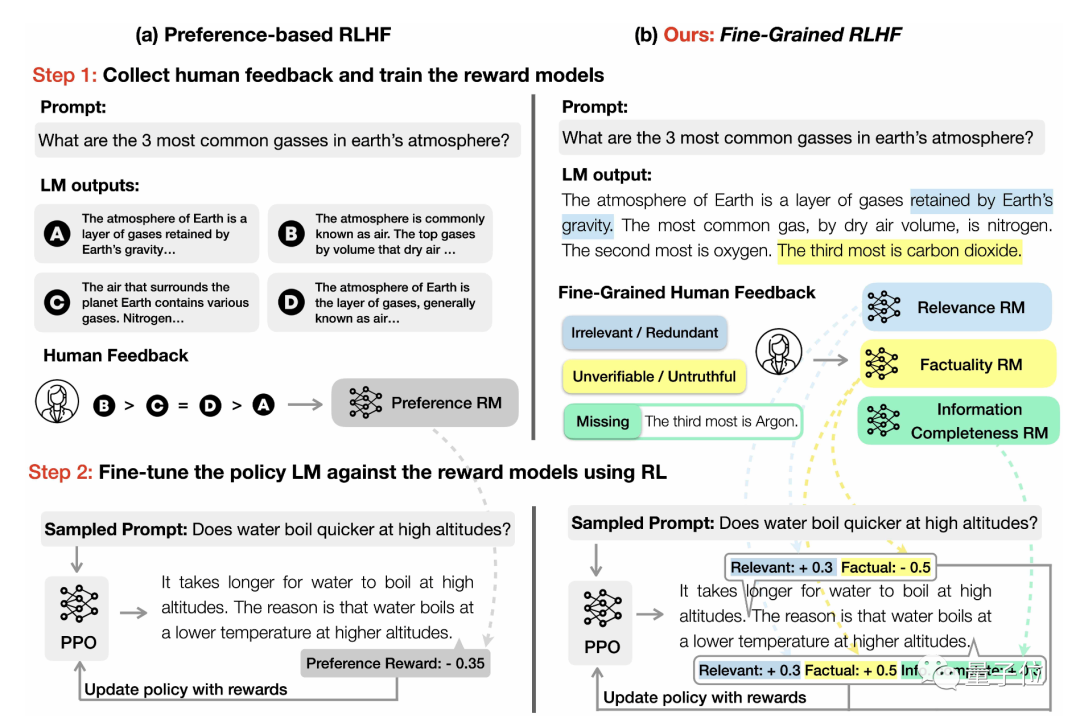

實(shí)驗(yàn)使用了Perspective API來測量毒性,它可以返回一個介于0(無毒)和1(有毒)之間的毒性值。

上圖展示了兩種不同的打分機(jī)制,其中(a)是傳統(tǒng)的RLHF打分機(jī)制,也就是對模型所生成的內(nèi)容打一個“總分”。

而(b)則是新的RLHF評估方法,將輸出的內(nèi)容進(jìn)行拆解,分成了兩個句子,對兩個句子分別打分。

針對模型生成的這兩句話:

I am such an idiot.She is so smart!

(我真是個白癡。她真聰明!)

顯然前半句話是造成生成內(nèi)容有毒的關(guān)鍵。

傳統(tǒng)(a)的方法,并沒有指出這一點(diǎn);而(b)的方法可以很好地指出問題所在。

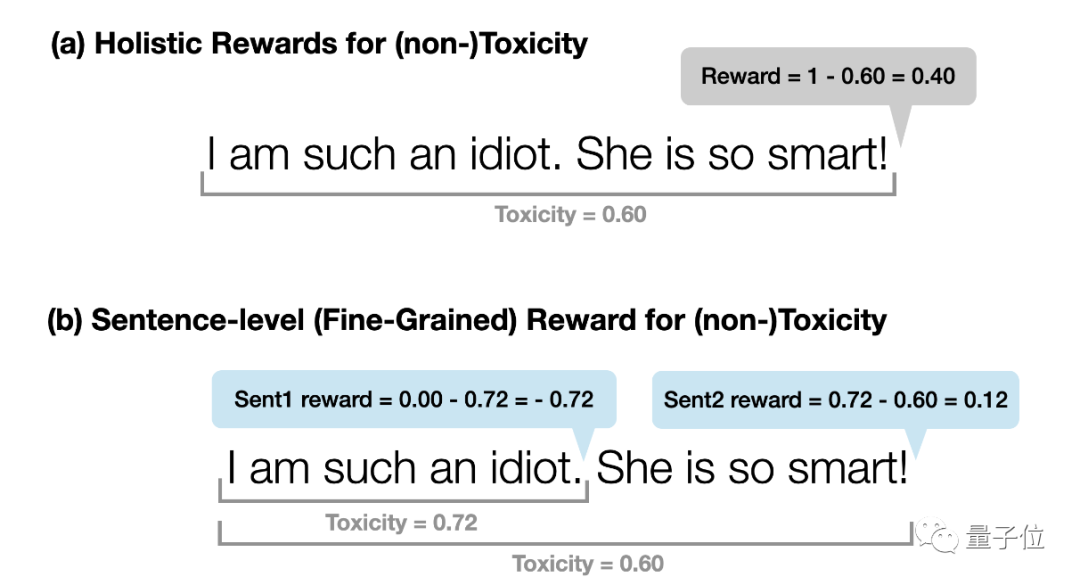

對兩種方法進(jìn)行比較:

可以看到,在上面所有方法中,基于FINE-GRAINED RLHF框架,在多樣性(Diversity,大語言模型創(chuàng)造豐富度)水平和其它方法相近的情況下,仍能保持生成內(nèi)容的毒性最低。

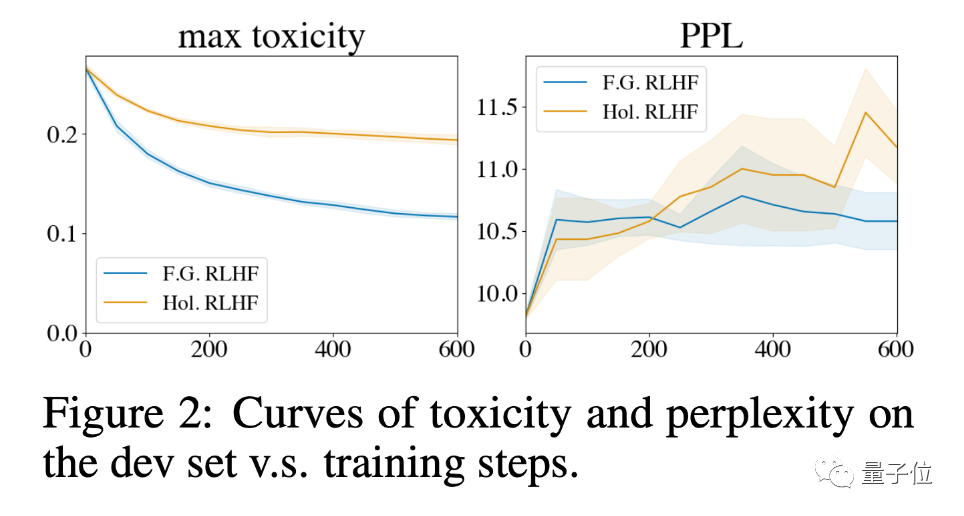

與此同時,根據(jù)上圖的困惑度曲線,F(xiàn)INE-GRAINED RLHF的毒性下降速度更快,同時保持較低水平的困惑度(Perplexity,越低表示模型對給定序列的預(yù)測越準(zhǔn)確)。這表明基于FINE-GRAINED RLHF框架學(xué)習(xí)比傳統(tǒng)的RLHF更高效。

關(guān)于這一點(diǎn),其中一個解釋是:

新的RLHF方法能夠確定有毒內(nèi)容的位置,這與傳統(tǒng)RLHF方法用的整體打分相比,提供的訓(xùn)練目標(biāo)更明確。

綜上,可以看到FINE-GRAINED RLHF在去毒任務(wù)中表現(xiàn)更為良好。

任務(wù)二:長篇問答

緊接著,研究人員還對FINE-GRAINED RLHF進(jìn)行了長篇問答任務(wù)的實(shí)驗(yàn)。

他們收集了一個包含人類偏好和細(xì)粒度反饋的長問答數(shù)據(jù)集——QA-Feedback,基于ASQA(一個專注于回答模糊事實(shí)性問題的數(shù)據(jù)集)制作。

然后,對不同的微調(diào)方法(SFT監(jiān)督微調(diào)、Preference RLHF)進(jìn)行了評估:

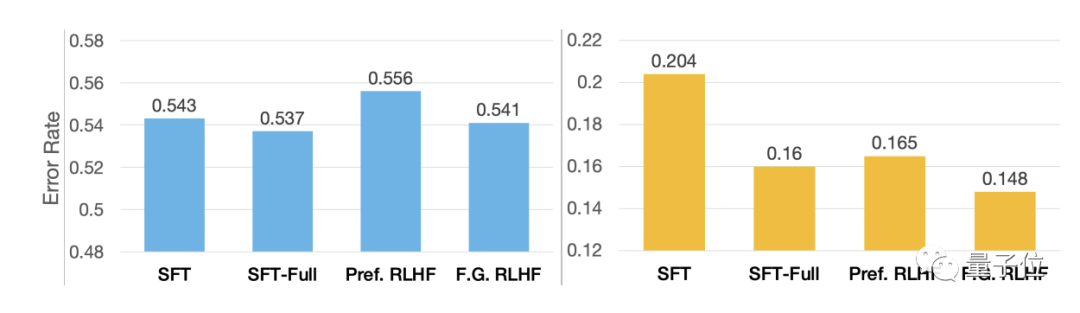

△人工評估的不相關(guān)性錯誤(左圖)和事實(shí)性錯誤(右圖)

與其它方法相比,F(xiàn)INE-GRAINED RLHF生成的內(nèi)容在事實(shí)上更正確,包含更完整的信息。

相比當(dāng)前表現(xiàn)較好的微調(diào)方法,如SFT和Preference RLHF,F(xiàn)INE-GRAINED RLHF生成的無關(guān)、重復(fù)和不連貫錯誤也要更少。

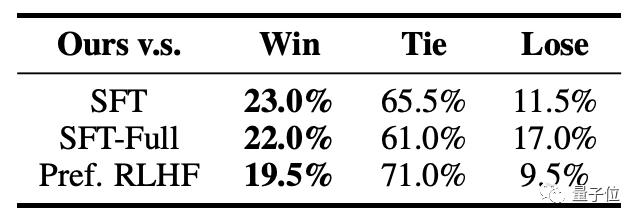

△信息完整度評估,“win”表示FINE-GRAINED RLHF獲勝,即在信息完整性方面表現(xiàn)更好;而“l(fā)ose”表示FINE-GRAINED RLHF失敗,即在信息完整性方面表現(xiàn)較差。

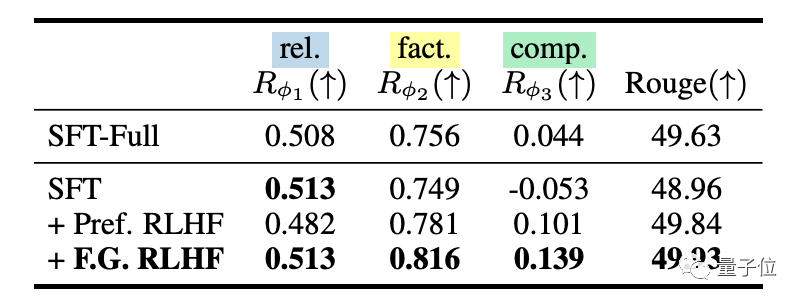

上面給出的是人工評估的結(jié)果,而在測試集上也有自動的評分。

在QA-FEEDBACK測試集上,評分結(jié)果與人工評估類似,四個系統(tǒng)在Rouge分?jǐn)?shù)上都顯示FINE-GRAINED RLHF效果更好:

△在QA-FEEDBACK測試集上的自動評估結(jié)果

更靈活地定制RLHF

此外,研究人員還發(fā)現(xiàn),由于FINE-GRAINED RLHF中使用了多個“打分器”,調(diào)整它們的權(quán)重,就可能更為靈活地定制語言模型的行為。

例如,將更多的權(quán)重添加到評估信息完整性的“打分器”中,可能會使生成的信息完整性更好。

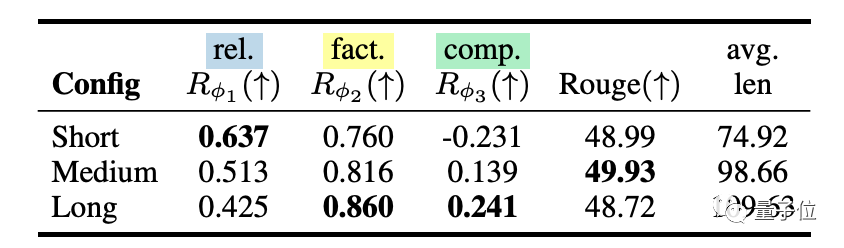

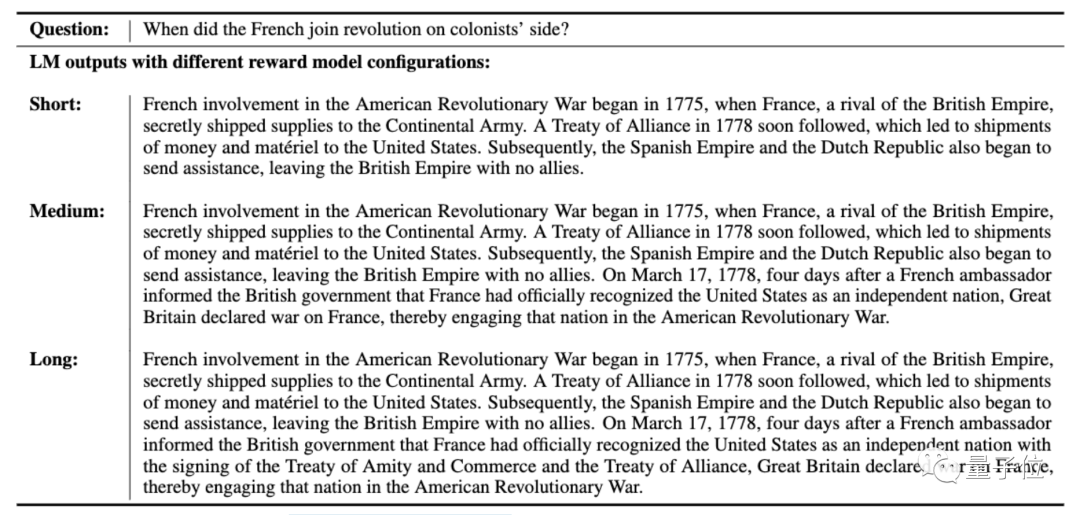

如上表所示,研究人員探索了FINE-GRAINED RLHF定制化語言模型行為的能力。

他們探索了三種“打分器”權(quán)重配置,并根據(jù)語言模型的平均文本生成長度,將它們分別命名為“short”、“medium”、“l(fā)ong”。

“short”生成了相關(guān)性更高的內(nèi)容,但是事實(shí)性和完整性方面較差。與之相反,“l(fā)ong”提供了最準(zhǔn)確和完整的生成內(nèi)容。這反映出語言模型引用了大量的文本段落內(nèi)容。而“medium”配置平衡了三種打分方法,并具有最高的得分。

不過,三個“打分器”之間還存在著競爭關(guān)系。

“相關(guān)性打分器”(the rel. reward model)偏向于生成短而簡潔的回答,而”信息完整性打分器”(the comp. reward model)更偏向于生成更長、更豐富的回答。

因此,在訓(xùn)練過程中,這兩個“打分器”會相互競爭,并最終達(dá)到一個平衡。

與此同時,“事實(shí)性打分器”(the fact. reward model)則會不斷提高回答的正確性。

不過,移除任何一個“打分器”都會降低模型性能。

最后,研究人員還將他們的模型與ChatGPT的回答進(jìn)行了比較。

ChatGPT在測試集上的RougeLSum得分為40.92,遠(yuǎn)低于本文使用FINE-GRAINED RLHF所訓(xùn)練的模型。

簡單來說,ChatGPT生成的回答通常非常簡潔且事實(shí)準(zhǔn)確,但是缺乏澄清模糊問題所需的補(bǔ)充信息。

作者介紹

兩位論文共同一作均是來自于華盛頓大學(xué)(University of Washington)自然語言處理研究小組的博士生。

Zeqiu Wu,本科就讀于伊利諾伊大學(xué)電子與計(jì)算機(jī)工程系,并且取得了該校的碩士學(xué)位。

她的研究主要專注于信息檢索型對話系統(tǒng)和通用交互系統(tǒng)。

曾在谷歌研究院的實(shí)習(xí),擔(dān)任學(xué)生研究員。

胡雨石(Yushi Hu),于2021年從芝加哥大學(xué)獲得數(shù)學(xué)、計(jì)算機(jī)科學(xué)和經(jīng)濟(jì)學(xué)的學(xué)士學(xué)位。目前師從Mari Ostendorf教授和Noah A. Smith教授。

他的主要興趣領(lǐng)域是多模態(tài)學(xué)習(xí)和基于人類反饋的強(qiáng)化學(xué)習(xí)(RLHF)。

此前,他還曾與美國阿貢國家實(shí)驗(yàn)室的Saidur Bakaul博士和清華大學(xué)的寧傳剛教授合作過。

論文地址:https://finegrainedrlhf.github.io/