徹底拋棄Transformer,八金剛之一再創(chuàng)業(yè)!聯(lián)手前谷歌Brain大佬創(chuàng)建自然啟發(fā)智能模型

今天,Transformer八位作者之一Llion Jones,聯(lián)手前谷歌大腦科學(xué)家、Stability AI研究主管David Ha官宣成立新公司——Sakana AI。

這家總部位于東京的初創(chuàng)公司,將要探索一種基于自然啟發(fā)智能的新型基礎(chǔ)模型。

官網(wǎng)地址:https://sakana.ai/

Sakana這一名字,來(lái)源于日語(yǔ)さかな,即為「魚」。

他們的理念是,「讓一群魚聚集在一起,從簡(jiǎn)單的規(guī)則中形成一個(gè)連貫的實(shí)體」。

更進(jìn)一步,便是進(jìn)化和集體智慧。

目前來(lái)說(shuō),Sakana AI仍處于非常早期的階段:沒有構(gòu)建AI模型,沒有辦公室,也并未透露融資的情況。

不過,無(wú)論是公司理念,還是創(chuàng)業(yè)地點(diǎn)的選擇,這家初創(chuàng)公司都透露出一絲另辟蹊徑的意味。

拋棄Transformer,專注新模型

現(xiàn)在各家巨頭的大語(yǔ)言模型都已經(jīng)進(jìn)化到超強(qiáng)了,為什么兩位創(chuàng)始人還是要做自己的大模型?顯然,他們有自己獨(dú)特的想法。

在Johnes和Ha看來(lái),當(dāng)前大語(yǔ)言模型的局限性在于,它們被設(shè)計(jì)成了脆弱、不可改變的結(jié)構(gòu),比如橋梁或建筑物。

相比之下,在自然系統(tǒng)中,是集體智慧在發(fā)揮作用。這個(gè)系統(tǒng)對(duì)周圍世界的變化非常敏感,會(huì)適應(yīng)環(huán)境,并成為環(huán)境的一部分。

他們希望的正是使用這些進(jìn)化計(jì)算原理構(gòu)建AI模型,來(lái)解決系統(tǒng)的成本和安全性的問題。

David Ha稱,他們?cè)谠陂_發(fā)一種新型的人工智能模型,可以讓機(jī)器學(xué)習(xí)工程師維護(hù)和監(jiān)控的工作時(shí)間大幅降低。

Sakana AI實(shí)驗(yàn)室并沒有依賴于Jones對(duì)Transformer的突破性研究。

人盡皆知,Transformer是OpenAI等科技公司使用的一種機(jī)器學(xué)習(xí)模型,已經(jīng)在生成式AI上取得了巨大的效果。

對(duì)于Sakana AI,正如名字所示,聯(lián)合創(chuàng)始人希望創(chuàng)建一種基于「自然啟發(fā)智能」的新型基礎(chǔ)模型。

「自然啟發(fā)的智能」可能聽起來(lái)像是60年代斯托納電影中的內(nèi)容,但這一概念在人工智能研究中有著悠久的歷史。

Jones表示,這個(gè)想法是創(chuàng)造能夠?qū)W習(xí)和搜索解決方案的軟件,而不是必須一步一步地設(shè)計(jì)的軟件。

像ChatGPT這樣的人工智能模型容易越獄。為了防止這種打擊,開發(fā)?員必須手動(dòng)更新模型。

Llion Jones和David Ha設(shè)想讓他們的模型適應(yīng)環(huán)境。

比如,Ha之前研究了「permutation-invariant神經(jīng)網(wǎng)絡(luò)」,即能夠在困難情況下執(zhí)行任務(wù)的人工智能模型。當(dāng)部分視覺輸入丟失或混亂時(shí),仍舊能在模擬中駕駛汽車。

根據(jù)個(gè)人介紹,自然啟發(fā)的智能一直是Ha職業(yè)生涯中的一個(gè)主題。

除了在permutation-invariant神經(jīng)網(wǎng)絡(luò)方面的工作,他還嘗試研究了世界模型,從周圍環(huán)境中收集數(shù)據(jù),建立?個(gè)類似于人類的環(huán)境心理模型。

踏入競(jìng)爭(zhēng)激烈的戰(zhàn)場(chǎng)

因此,Sakana AI將構(gòu)建自己的生成式AI模型,用于生成文本、圖像、代碼及其他軟件。

這個(gè)賽道上競(jìng)爭(zhēng)激烈之程度毋庸置疑,包括谷歌、微軟這類巨頭,以及OpenAI、Cohere、Character.ai和Anthropic等初創(chuàng)企業(yè)。

不過,這個(gè)領(lǐng)域資金也非常充足。

微軟今年在OpenAI上投資了100億美元,Cohere和Character.ai在過去幾個(gè)月中也成功獲得融資,估值分別達(dá)到了20億美元和10億美元。

為什么選擇日本

不過,Sakana AI的總部設(shè)在日本,這個(gè)創(chuàng)業(yè)地點(diǎn)的選擇多少有些不同尋常。

創(chuàng)始人解釋說(shuō),自己已在日本工作多年,之所以選擇東京作為公司總部,部分原因也是因?yàn)闃?gòu)建生成式AI軟件的市場(chǎng)競(jìng)爭(zhēng)太激烈了,尤其是在北美。

而東京擁有高質(zhì)量的技術(shù)基礎(chǔ)設(shè)施和受過良好教育的勞動(dòng)力,這為AI公司的發(fā)展提供了得天獨(dú)厚的條件。

「最重要的是,建立一個(gè)在非西方社會(huì)文化中表現(xiàn)良好的模型,圍繞它訓(xùn)練數(shù)據(jù),這將成為下一次技術(shù)突破的催化劑。」

另外,谷歌和其他公司的人工智能研究人員,最近將注意力集中在將現(xiàn)有技術(shù)進(jìn)行商業(yè)化,這意味著更多前沿研究的空間越來(lái)越小。

但為研究而研究是兩位聯(lián)合創(chuàng)始人在Sakana堅(jiān)持的原則,也是他們決定將公司總部設(shè)在東京的原因之一。

兩位創(chuàng)始人

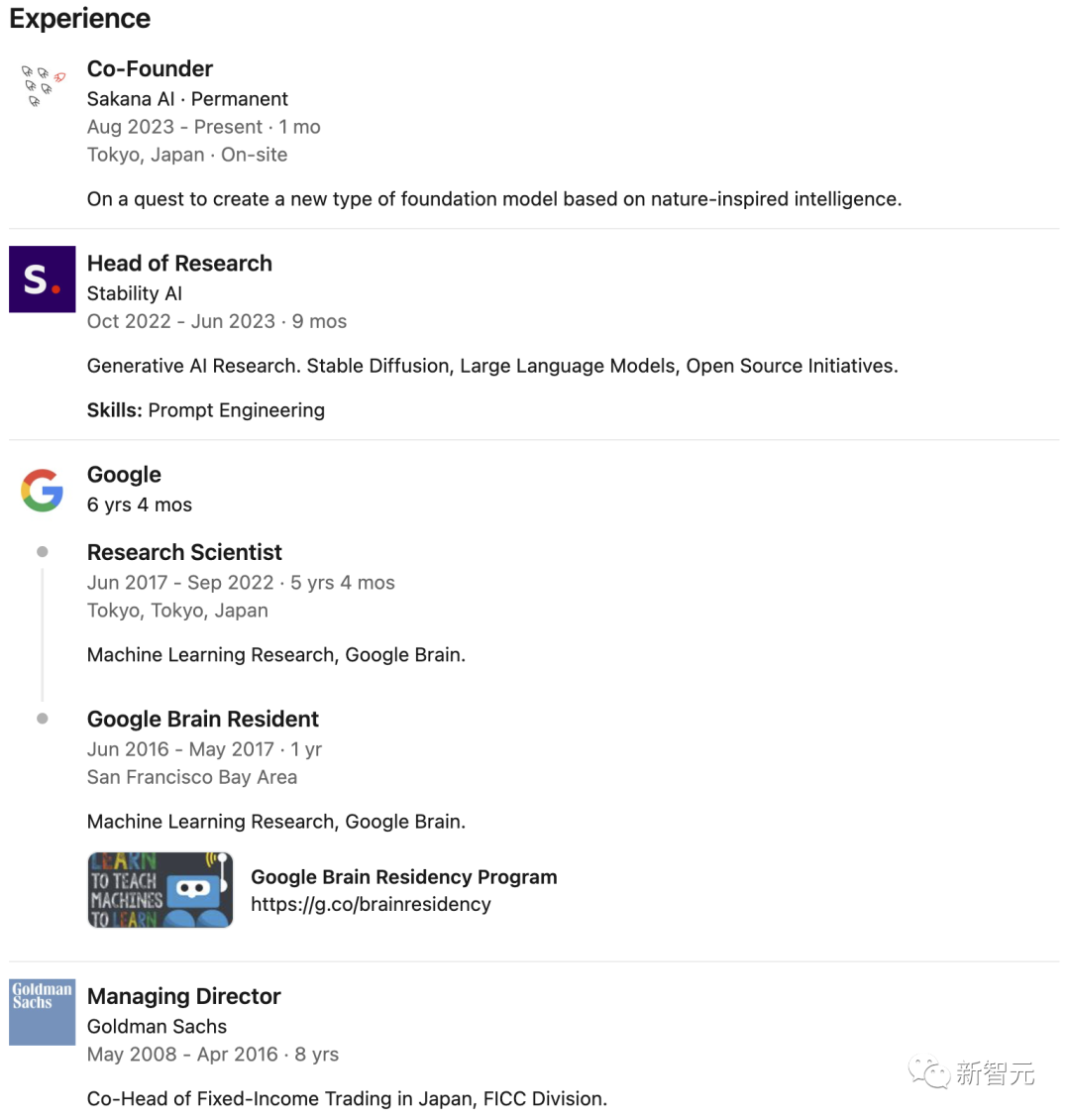

David Ha

David Ha將擔(dān)任Sakana AI的CEO。

2016年,David Ha加入谷歌大腦負(fù)責(zé)機(jī)器學(xué)習(xí)領(lǐng)域的工作。

度過漫長(zhǎng)的6年零4個(gè)月之后,他于2022年10月加入Stability AI擔(dān)任研究主管。

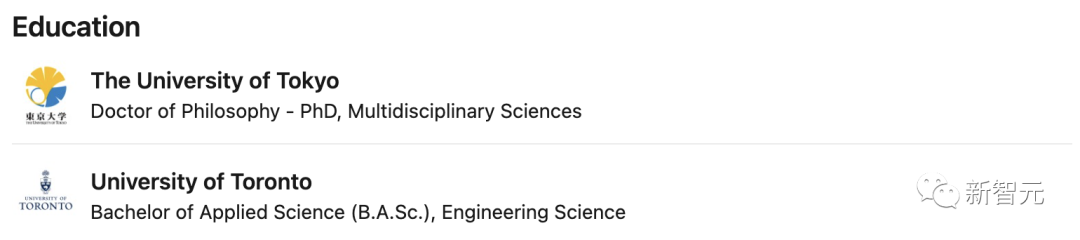

在此之前,他獲得了東京大學(xué)的博士學(xué)位,以及多倫多大學(xué)的學(xué)士學(xué)位。

有趣的是,今年6月從Stability AI離職之后,David Ha本人還曾發(fā)推吐槽表示「終于有時(shí)間睡個(gè)好覺了」。

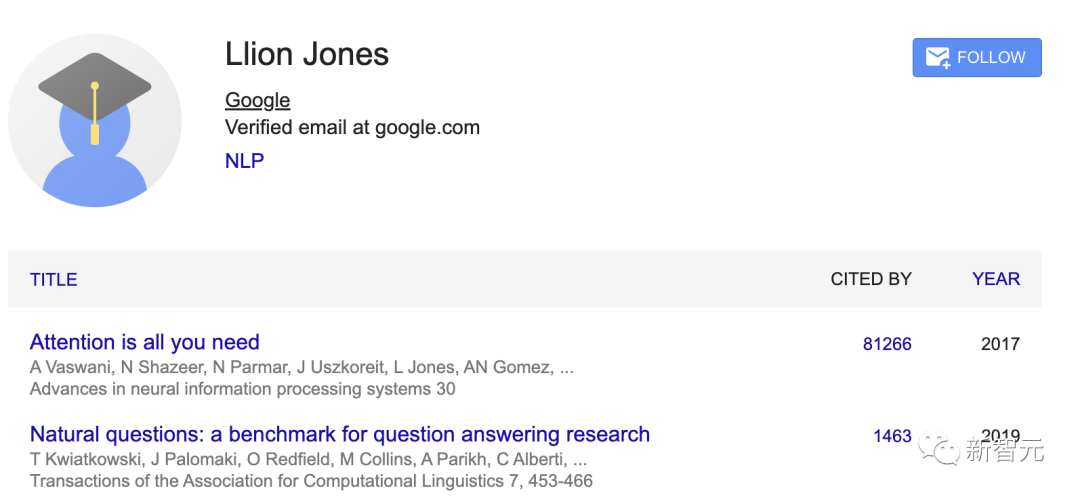

Llion Jones

Llion Jones將擔(dān)任CTO。

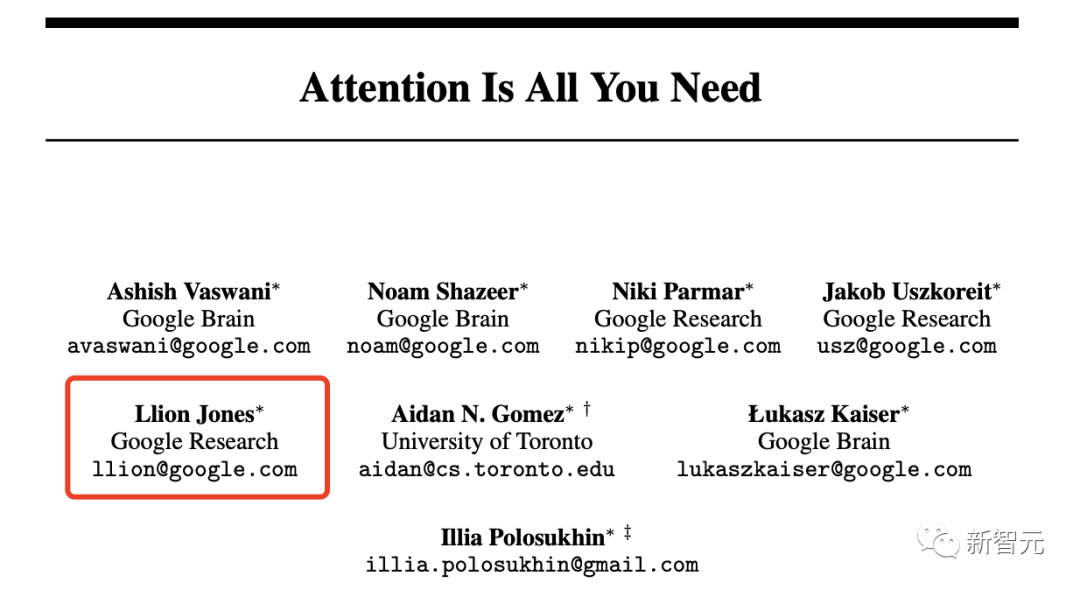

他最出名的代表作,那便是2017年和谷歌團(tuán)隊(duì)發(fā)表的「Attention Is All You Need」。

Llion Jones是這八位作者中,最后一位離開谷歌的人。他的離去,標(biāo)志著Transformer「變形金剛大解體」。

上個(gè)月,彭博最先爆料稱Transformer僅剩的一位作者Llion Jones宣布7月底要離職谷歌自創(chuàng)業(yè)。

當(dāng)時(shí),還未透露具體創(chuàng)業(yè)信息。不過,恰恰David Ha也轉(zhuǎn)發(fā)了這一消息。

Jones表示:

離開谷歌并不是一個(gè)容易的決定,我與他們度過了非常精彩的十年,但是現(xiàn)在是嘗試一些不同的事情的時(shí)候了。鑒于人工智能領(lǐng)域的勢(shì)頭和進(jìn)展,現(xiàn)在是構(gòu)建新事物的好時(shí)機(jī)。

Llion Jones于2015年6月加入了谷歌,至今已經(jīng)任職8年。此前他曾就職于YouTube、Delcam。

他曾在伯明翰大學(xué)取得了和計(jì)算機(jī)專業(yè)的學(xué)士和碩士學(xué)位。

到目前為止,Jones的谷歌學(xué)術(shù)主頁(yè)中, 引用最高的一篇文章當(dāng)屬17年橫空出世的「Attention Is All You Need」,引用數(shù)81266。