Transformer八子全部叛逃谷歌!最后一位共同作者月底離職創業

Transformer八子全都叛逃了谷歌。

爆料稱,當年參與谷歌Transformer驚世之作的最后一位共同作者Llion Jones,月底將離職谷歌自行創業。

圖片

圖片

前谷歌大腦、前Stability AI高管David Ha也轉發了這一消息。

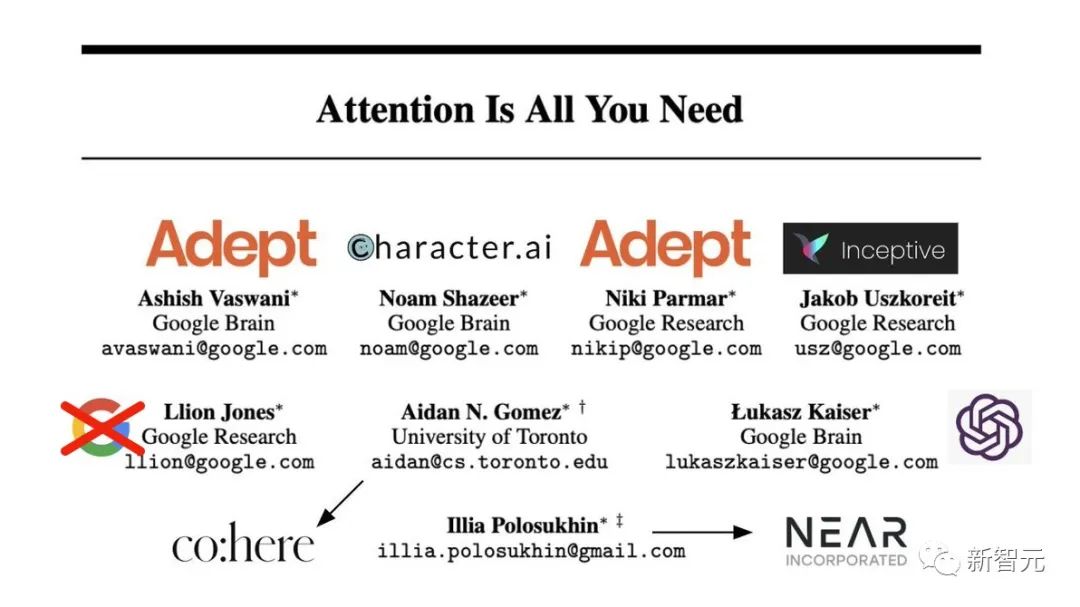

2017年6月,「Attention Is All You Need」一聲炸雷,大名鼎鼎的Transformer橫空出世。

然而,6年過去了,曾聯手打造最強架構的「變形金剛們」紛紛離開谷歌,有的加入了OpenAI等初創公司,有的則白手起家去創業。

如今,其中已經確定Transformer七子現在都在哪家公司,唯獨Llion Jones一直還留在谷歌。

圖片

圖片

而現在,Llion Jones的離去,標志著Transformer「變形金剛大解體」。

任職8年,Transformer被引最高

作為Transformer架構奠基架構合著者之一,Llion Jones向彭博確認,將于本月晚些時候離開谷歌日本,并計劃在休假后創辦一家公司。

圖片

圖片

Jones在給彭博社的一封消息中寫道:

離開谷歌并不是一個容易的決定,我與他們度過了非常精彩的十年,但是現在是嘗試一些不同的事情的時候了。鑒于人工智能領域的勢頭和進展,現在是構建新事物的好時機。

谷歌的一位發言人沒有立即回應置評請求。

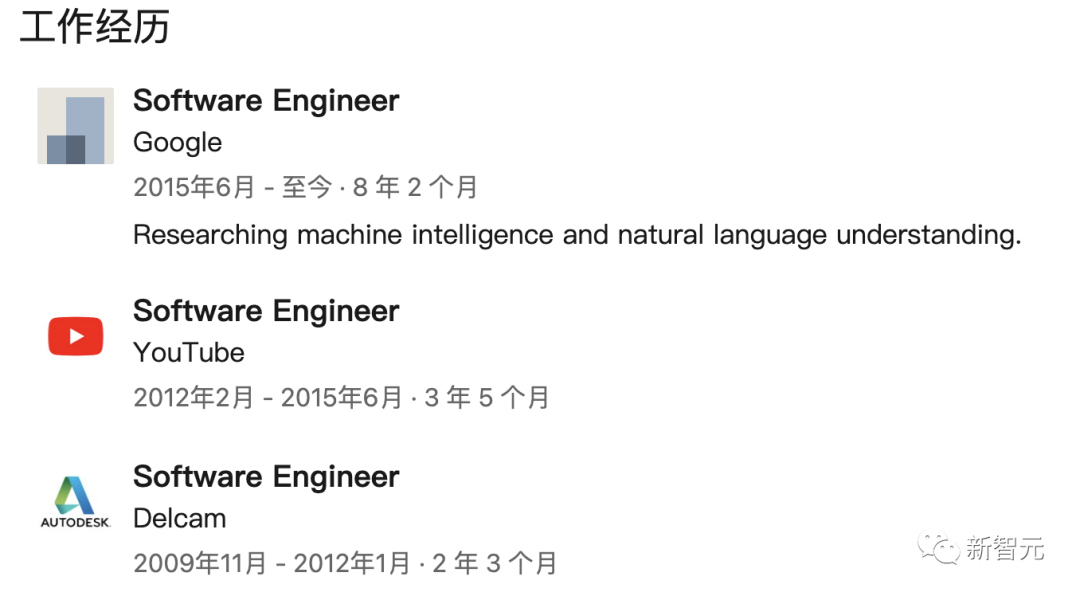

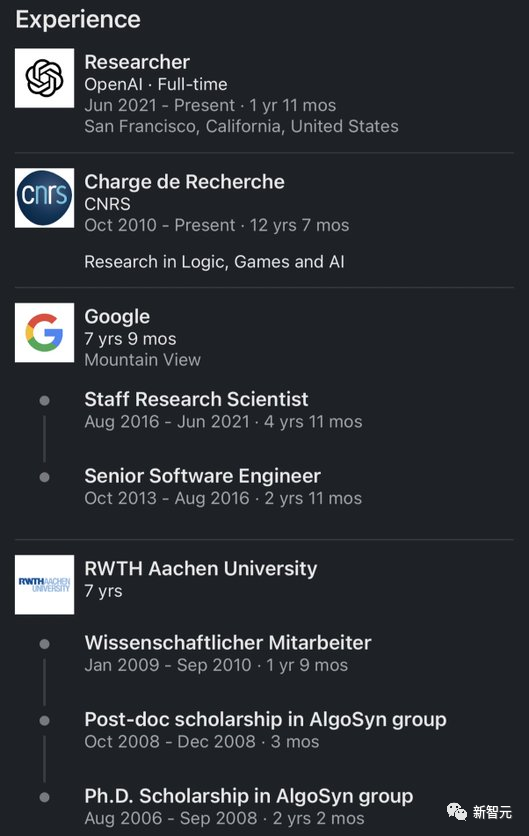

根據個人領英主頁,Llion Jones于2015年6月加入了谷歌,至今已經任職8年。此前他曾就職于YouTube、Delcam。

圖片

圖片

他曾在伯明翰大學取得了和計算機專業的學士和碩士學位。

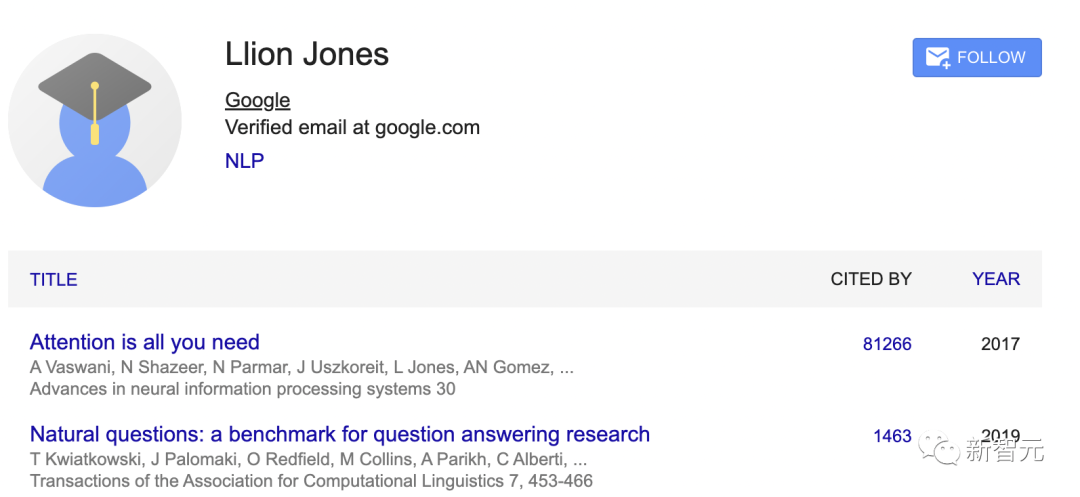

到目前為止,Jones的谷歌學術主頁中, 引用最高的一篇文章當屬17年橫空出世的「Attention Is All You Need」,引用數81266。

圖片

圖片

Transformer現在是大型語言模型的關鍵組成部分,而這種技術是OpenAI的ChatGPT等流行人工智能產品的基礎。

在過去的幾年中,該論文的作者們已經創辦了一些知名的初創企業,包括為企業客戶提供LLM的Cohere,以及允許用戶創建模仿名人和歷史人物的聊天機器人的Character.AI。

隨著Jones的離開,意味著所有八位作者都已經離開了谷歌。

新硅谷「八叛徒」

那么,其他七子現又身處何處呢?

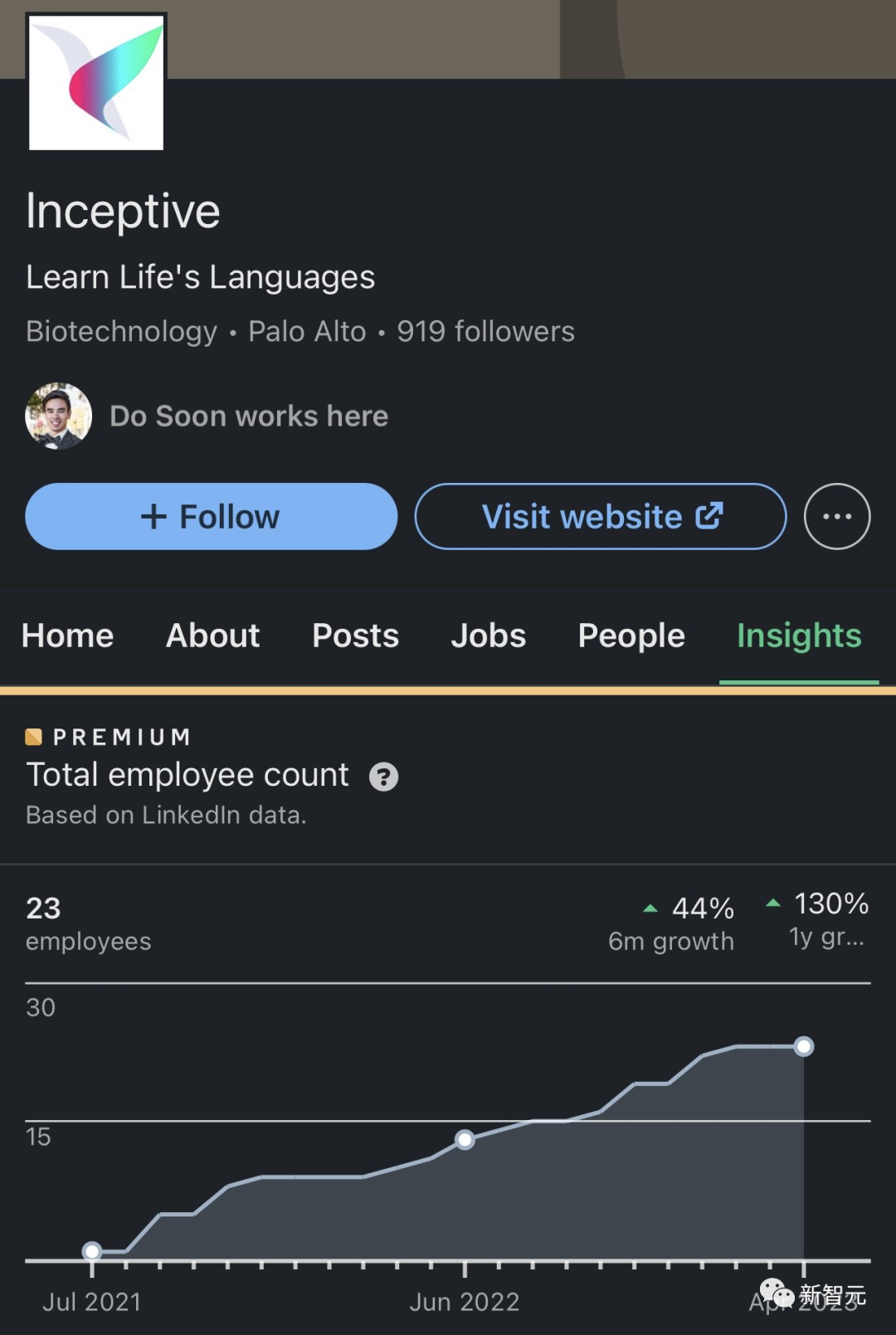

Jakob Uszkoreit被公認是Transformer架構的主要貢獻者。

他在2021年中離開了谷歌,并共同創立了Inceptive Labs,致力于使用神經網絡設計mRNA。

到目前為止,他們已經籌集了2000萬美元,并且團隊規模也超過了20人。

圖片

圖片

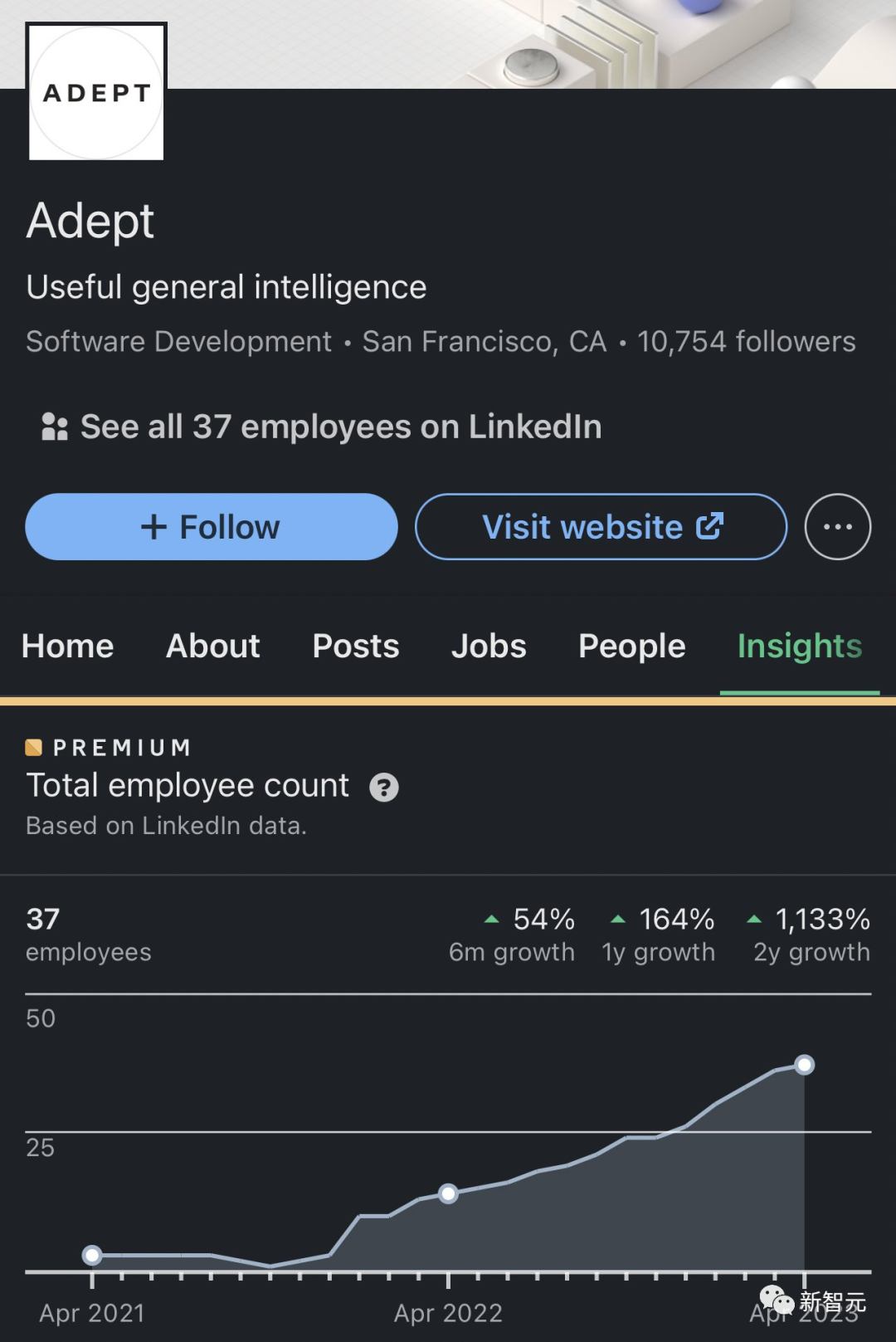

Ashish Vaswani在2021年底離開谷歌,創立了AdeptAILabs。

可以說,AdeptAILabs正處在高速發展的階段。

目前,公司不僅已經籌集了4.15億美元,而且也估值超過了10億美元。

此外,團隊規模也剛剛超過了40人。

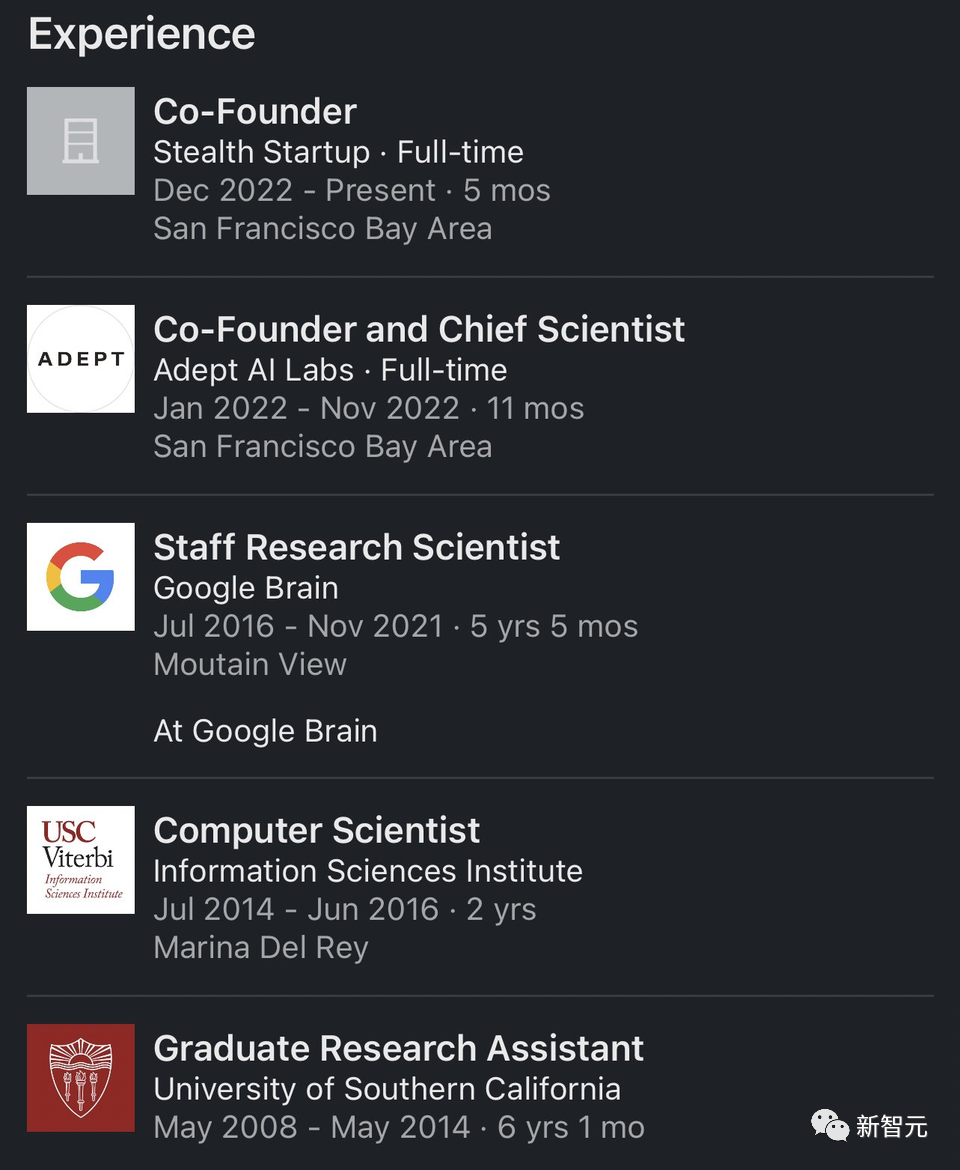

然而,Ashish卻在幾個月前離開了Adept。

在Transformers論文中,Niki Parmar是唯一的女性作者。

她在2021年底離開谷歌,并和剛剛提到的Ashish Vaswani一起,創立了AdeptAILabs。

不過,Niki在幾個月前也離開了Adept。

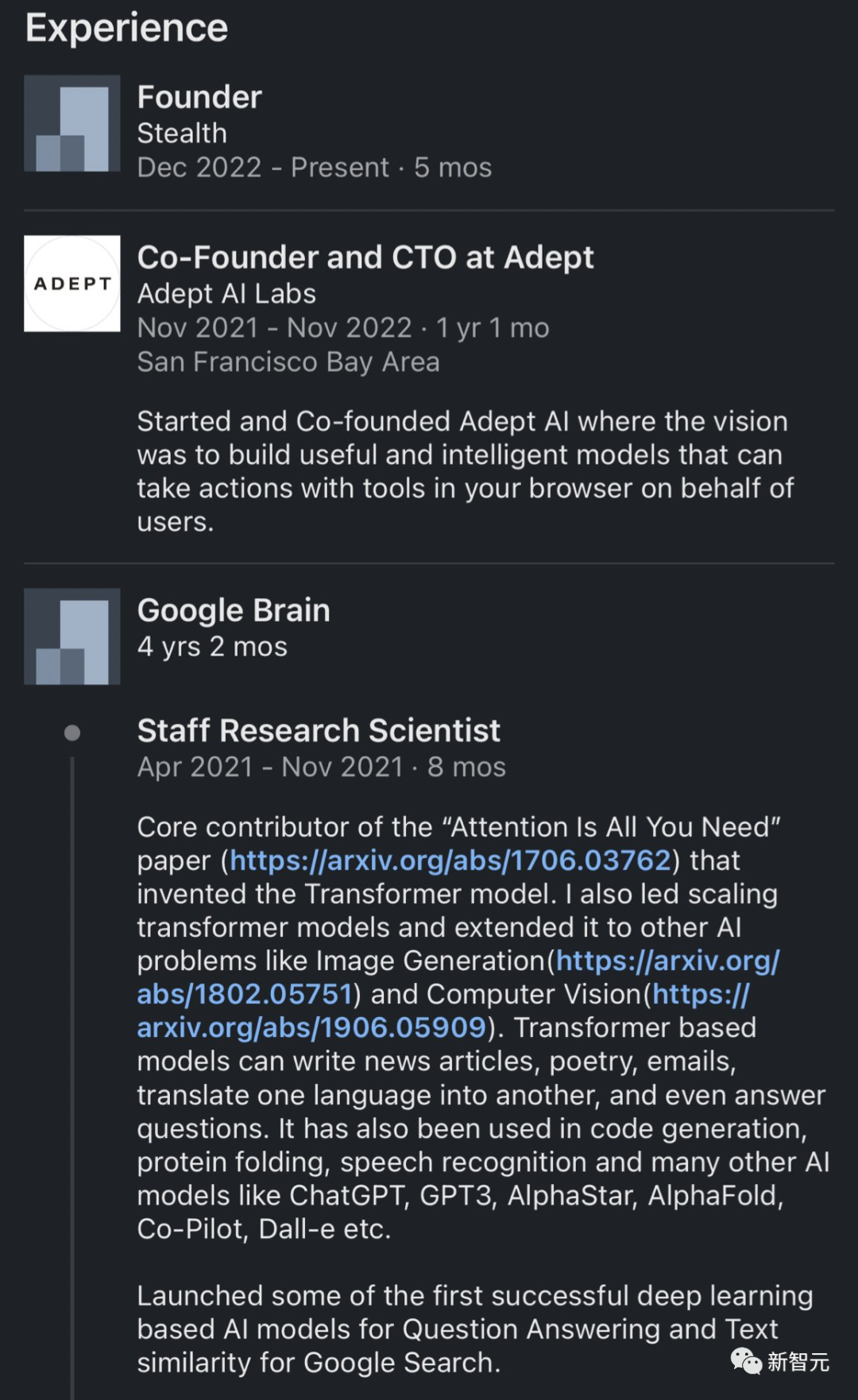

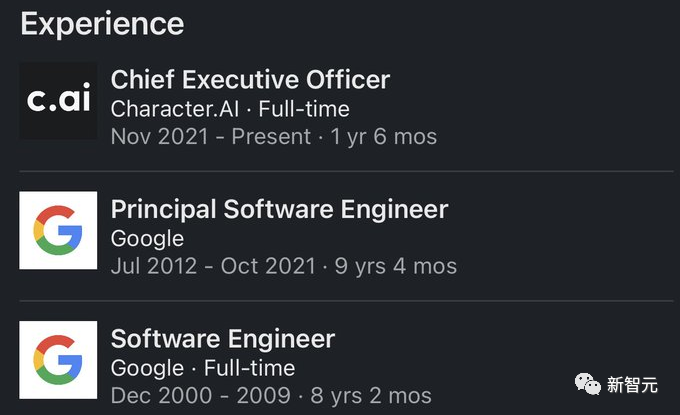

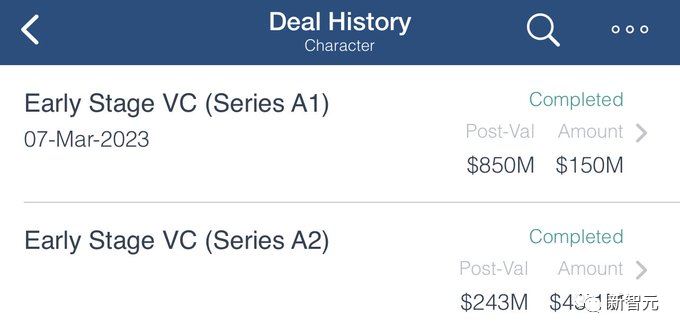

Noam Shazeer在Google工作了20年后,于2021年底離開了Google。

隨后,他便立刻與自己的朋友Dan Abitbol一起,創立了Character AI。

雖然公司只有大約20名員工,但效率卻相當之高。

目前,他們已經籌集了近2億美元,并即將躋身獨角獸的行列。

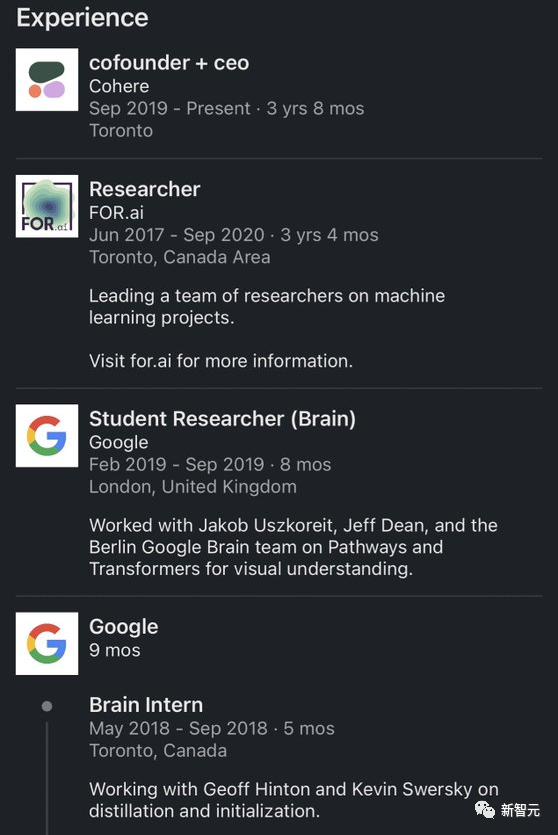

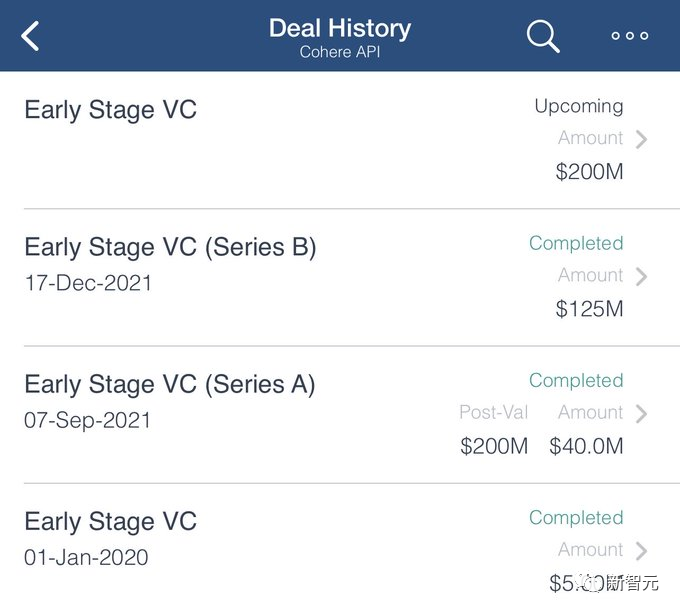

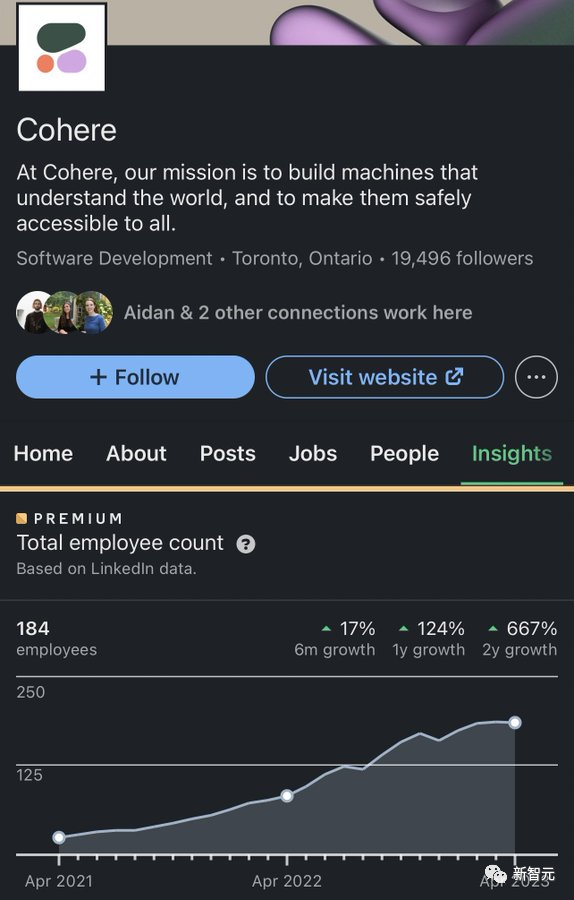

Aidan Gomez在2019年9月離開了Google Brain,創立了CohereAI。

經過3年的穩定發展后,公司依然正在擴大規模——Cohere的員工數量最近超過了180名。

與此同時,公司籌集到的資金也即將突破4億美元大關。

Lukasz Kaiser是TensorFlow的共同作者人之一,他在2021年中離開了谷歌,加入了OpenAI。

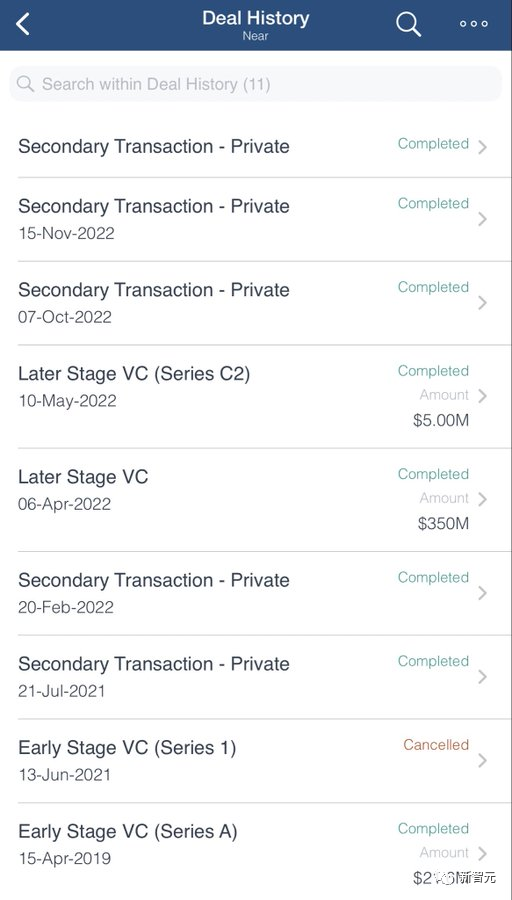

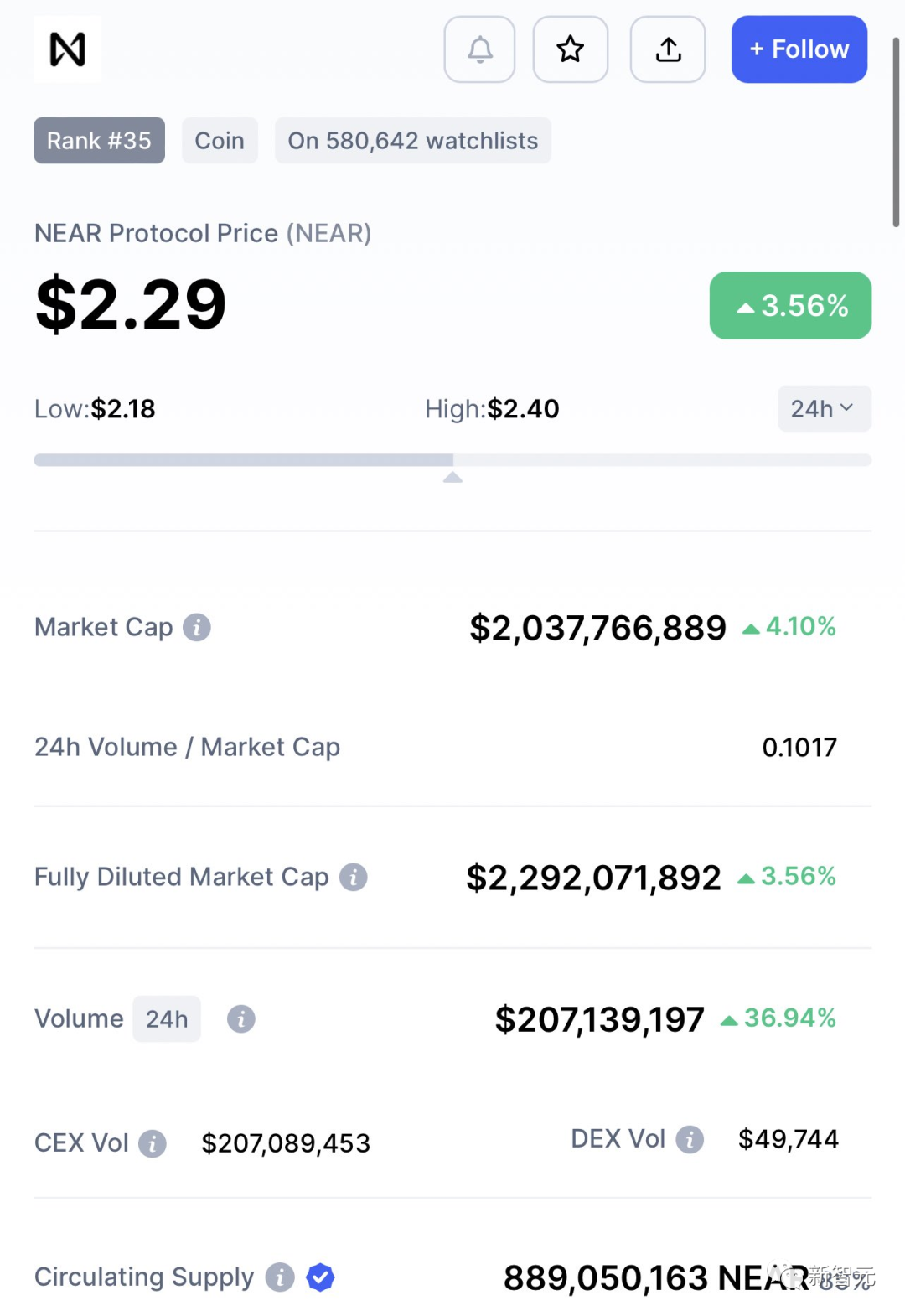

Illia Polosukhin在2017年2月離開了谷歌,于2017年6月創立了NEAR Protocol。

目前,NEAR估值約為20億美元。

與此同時,公司已經籌集了約3.75億美元,并進行了大量的二次融資。

你只需要注意力!

Transformer誕生之前,AI圈的人在自然語言處理中大都采用基于RNN(循環神經網絡)的編碼器-解碼器(Encoder-Decoder)結構來完成序列翻譯。

然而,RNN及其衍生的網絡最致命的缺點就是慢。關鍵問題就在于前后隱藏狀態的依賴性,無法實現并行。

Transformer的現世可謂是如日中天,讓許多研究人員開啟了追星之旅。

2017年,8位谷歌研究人員發表了Attention is All You Need。可以說,這篇論文是NLP領域的顛覆者。

論文地址:https://arxiv.org/pdf/1706.03762.pdf

它完全摒棄了遞歸結構,依賴注意力機制,挖掘輸入和輸出之間的關系,進而實現了并行計算。

甚至,有人發問「有了Transformer框架后是不是RNN完全可以廢棄了?」

圖片

圖片

JimFan所稱Transformer當初的設計是為了解決翻譯問題,毋庸置疑。

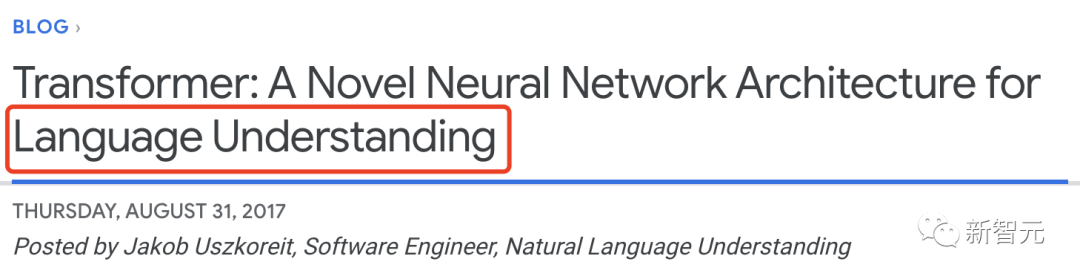

谷歌當年發的博客,便闡述了Transformer是一種語言理解的新型神經網絡架構。

圖片

圖片

https://ai.googleblog.com/2017/08/transformer-novel-neural-network.html

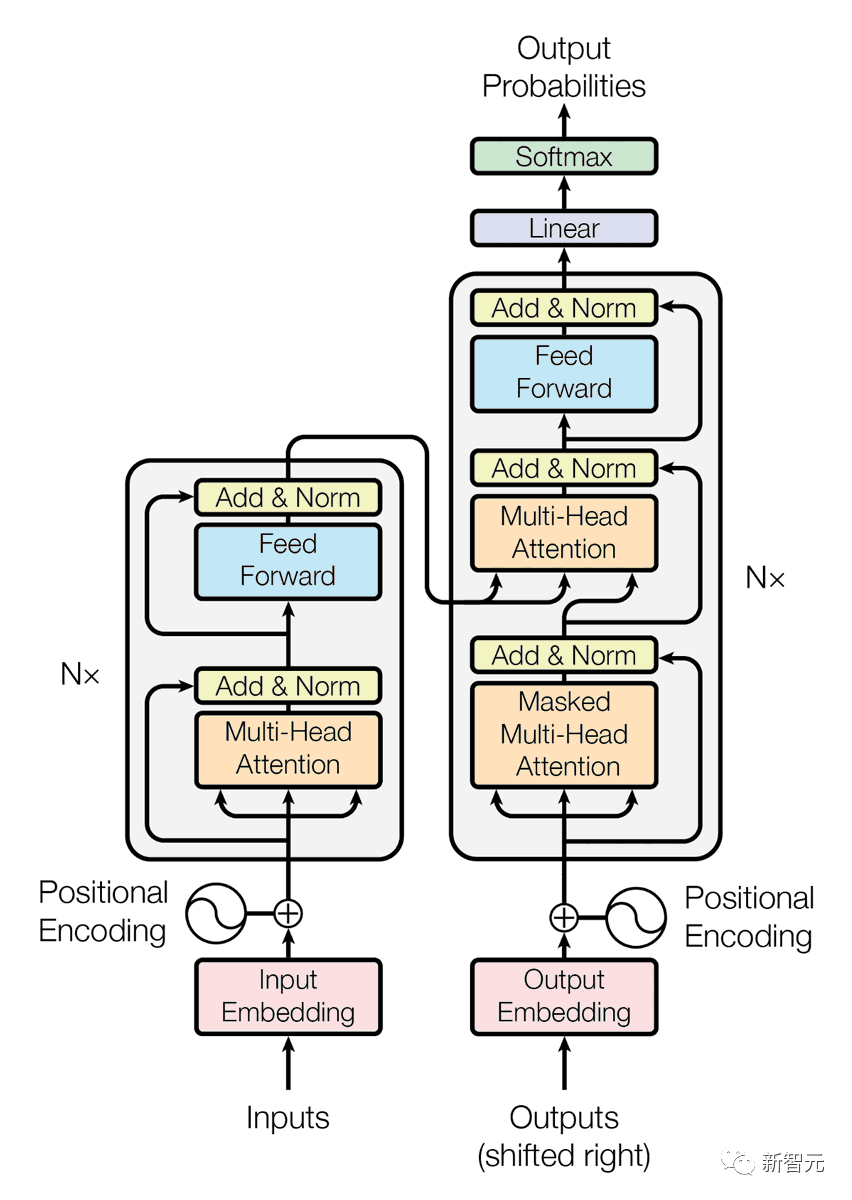

具體來講,Transformer由四部分組成:輸入、編碼器、解碼器,以及輸出。

輸入字符首先通過Embedding轉為向量,并加入位置編碼(Positional Encoding)來添加位置信息。

然后,通過使用多頭自注意力和前饋神經網絡的「編碼器」和「解碼器」來提取特征,最后輸出結果。

如下圖所示,谷歌給出了Transformer如何用在機器翻譯中的例子。

機器翻譯的神經網絡通常包含一個編碼器,在讀取完句子后生成一個表征。空心圓代表著Transformer為每個單詞生成的初始表征。

然后,利用自注意力,從所有其他的詞中聚合信息,在整個上下文中為每個詞產生一個新表征,由實心圓表示。

接著,將這個步驟對所有單詞并行重復多次,依次生成新的表征。

圖片

圖片

同樣,解碼器的過程與之類似,但每次從左到右生成一個詞。它不僅關注其他先前生成的單詞,還關注編碼器生成的最終表征。

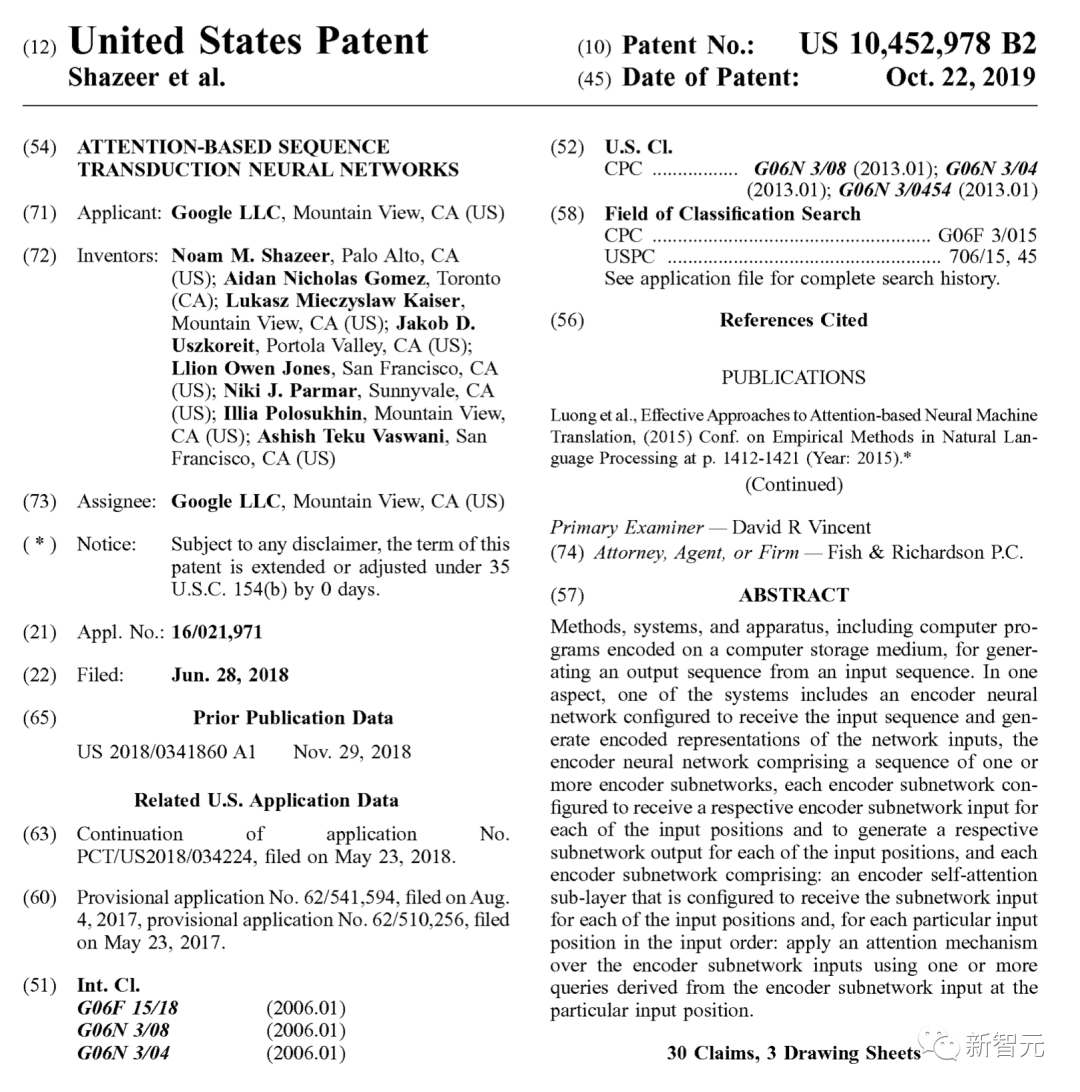

2019年,谷歌還專門為其申請了專利。

圖片

圖片

自此,在自然語言處理中,Transformer逆襲之路頗有王者之風。

歸宗溯源,現在各類層出不窮的GPT(Generative Pre-trained Transformer),都起源于這篇17年的論文。

然而,Transformer燃爆的不僅是NLP學術圈。

萬能Transformer:從NLP跨到CV

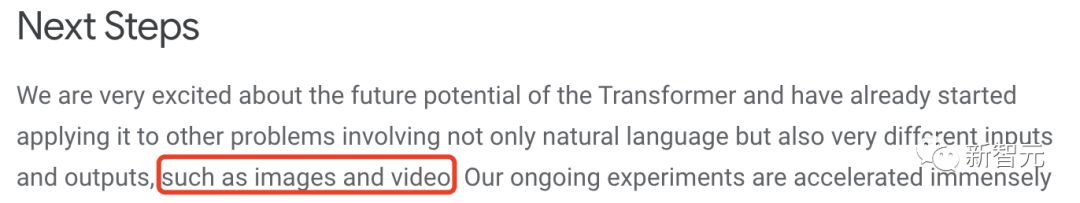

2017年的谷歌博客中,研究人員曾對Transformer未來應用潛力進行了暢享:

不僅涉及自然語言,還涉及非常不同的輸入和輸出,如圖像和視頻。

圖片

圖片

沒錯,在NLP領域掀起巨浪后,Transformer又來「踢館」計算機視覺領域。甚至,當時許多人狂呼Transformer又攻下一城。

自2012年以來,CNN已經成為視覺任務的首選架構。

隨著越來越高效的結構出現,使用Transformer來完成CV任務成為了一個新的研究方向,能夠降低結構的復雜性,探索可擴展性和訓練效率。

2020年10月,谷歌提出的Vision Transformer (ViT),不用卷積神經網絡(CNN),可以直接用Transformer對圖像進行分類。

圖片

圖片

值得一提的是,ViT性能表現出色,在計算資源減少4倍的情況下,超過最先進的CNN。

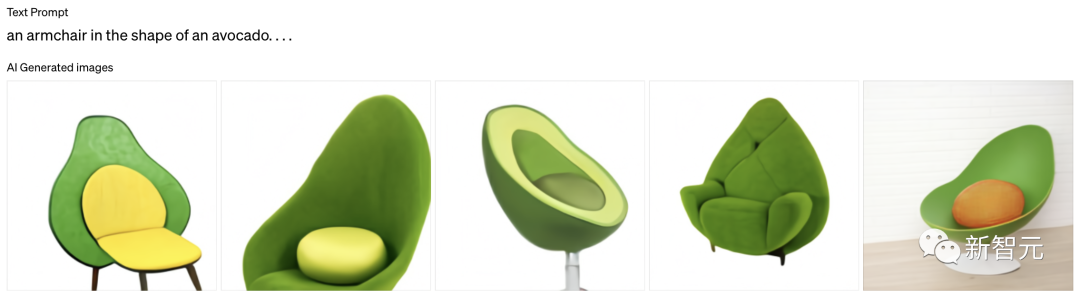

緊接著,2021年,OpenAI連仍兩顆炸彈,發布了基于Transformer打造的DALL-E,還有CLIP。

圖片

圖片

這兩個模型借助Transformer實現了很好的效果。DALL-E能夠根據文字輸出穩定的圖像。而CLIP能夠實現圖像與文本的分類。

再到后來的DALL-E進化版DALL-E 2,還有Stable Diffusion,同樣基于Transformer架構,再次顛覆了AI繪畫。

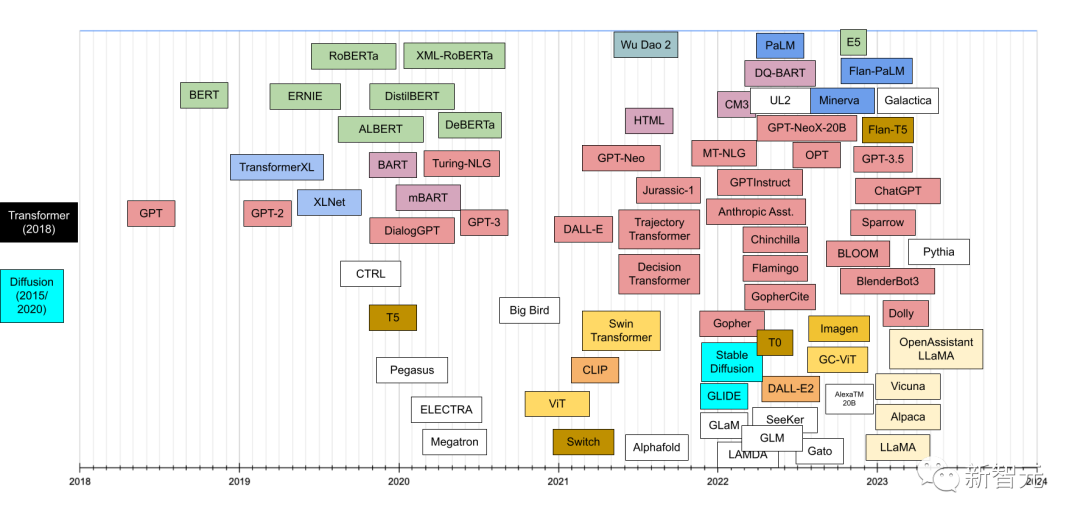

以下,便是基于Transformer誕生的模型的整條時間線。

圖片

圖片

由此可見,Transformer是有多么地能打。