虛擬歌手背后看不見的手 AI已掌控未來音樂?

19世紀以前,當人們聚集在一起時,總是會用即時的最原始的歌聲和樂器,講述生活的故事,傳遞情感和思想。那時的音樂,是流動的,也是瞬間的。

1857年之后,錄音的出現,讓人們擁有了隨時隨地欣賞優秀的音樂作品的條件,在這種形式下,音樂開始變成設定好的故事,聽眾成了被動的接受者。

斗轉星移。

時間來到2023,人工智能正在改變音樂的形態——通過便捷的操作,普通大眾可以輕松生產出音樂作品。從“play guitar”到“play AI”,音樂創作正變得觸手可及。

資深分析師Mark Mulligan觀察音樂產業數十載,不久前,他在博客中寫道:“音樂產業來到了一個臨界點,AI將會改變音樂的未來,如今瓶中的精靈已經飛向了廣闊的天空。”

合成的“歌唱歷史”

作為歌迷的你可能不會想到,今年最火的音樂中,有一首竟然是孫燕姿演唱的“發如雪”。或者準確的說,是AI孫燕姿。

突然走紅的另類“發如雪”,掀起了一陣網絡創作熱潮,帶動AI歌手概念出圈,也讓更多人感受到人工智能在音樂領域的巨大潛力。

不過,說到AI歌手,很多人第一反應應該是當紅虛擬歌姬——初音未來、洛天依。在歌迷感慨于這些無論是聲音和容貌都接近完美的AI歌手時,絕大多數人可能并不知道,單純用計算機合成音樂這件事,早在上世紀五十年代就已經出現了。根據不完全統計,歌聲合成的歷史沿革已經跨越了70年。

1951年 | 程序員Christopher Strachey使用艾倫·圖靈的大型計算機制作了歷史上第一首電腦合成的音樂。 |

1961年 | 計算機音樂大師Max Mathews與科學家John Kelly等人使用IBM 704計算機完成了第一首由電腦模擬人聲演唱的歌曲《Daisy Bell》。 |

1982年 | 為了統一標準,并建立起一種連接電子樂器和計算機的規則,國際樂器制造者協會的十幾家廠商制定了通用合成器接口方案,更名為“音樂設備數字接口(MIDI)”。 |

2004年 | 日本雅馬哈株式會社(YAMAHA)授權ZERO-G發售了VOCALOID首個聲庫。 |

2007年 | VOCALOID 2發布,日本CRYPTON FUTURE MEDIA公司依托該技術發布了初音未來。初音未來首次開啟了聲庫+虛擬形象的軟件銷售模式,其意外爆火也激活了以UGC為核心的VOCALOID創作文化。 |

2009年 | 名古屋工業大學開發的Sinsy(Singing Voice Synthesis System)語音合成系統發布,使用了隱馬爾科夫模型(HMM),可調教性別參數、顫音強度及變調等參數。 |

2012年 | 上海禾念公布洛天依等角色,并宣布第一款中文歌聲庫將以洛天依開發。 |

2013年 | CeVIO Creative Studio發布,基于HTS引擎(語音)/Sinsy引擎(歌唱)制作,輸入音符、文字后既能唱歌,還能模擬人聲說話。 |

2018年 | 華侃如發售Synthesizer V editor,結合人工神經網絡和采樣拼接合成的混合算法,使用底層語音模型(LLSM)技術實現了高還原度下對聲色的靈活修改。 |

2019年 | 時域科技推出了ACE虛擬歌姬,最開始是一款音游。 |

2020年 | ? Synthesizer V Studio發布,12月Synthesizer V AI發布,使用基于深度神經網絡的歌聲合成技術,生成的歌聲宛如人類歌手。 ? X Studio發布,由小冰公司開發,軟件為音樂創作者提供具有不同音色和唱腔的虛擬歌手,它們能迅速讀懂樂譜并演唱出來。 |

2021年 | ? ACE開始支持AI歌聲合成,并完成數百萬美元Pre-A輪融資。 ? CeVIO AI發行,繼承了前身CeVIO Creative Studio結合歌聲合成與語音合成的特征,并采用了深度神經網絡等AI技術。 ? 浙江大學發布了關于diffsinger的論文。diffsinger因其開源免費和高音質的特點迅速吸引了一批忠實用戶。 |

2022年 | ? VoiSona首個正式版發布,VoiSona是CeVIO AI的“姊妹版”,由同一家公司開發,分開運營。 ? ACE發布電腦端ACE Studio預覽視頻,并開啟內測申請。 ? ACE官宣為“洛天依ACE AI”聲庫提供技術支持,同年為言和、樂正綾提供AI聲庫。 |

2023年 | ? 小冰與網易云音樂合作發布了新編輯器“網易云音樂·X Studio”,提供了13名虛擬歌手。 ? ACE Studio在直播問答中稱新的歌聲合成模型和代碼重構正在穩步推進中,商業化時機根據工作進度而定。 |

在歌聲合成漫長而隱秘的“進化”中,AI歌手的出現可謂劃時代的產品,而要透析這段成長歷史,有兩個關鍵的信息點是必須了解的:

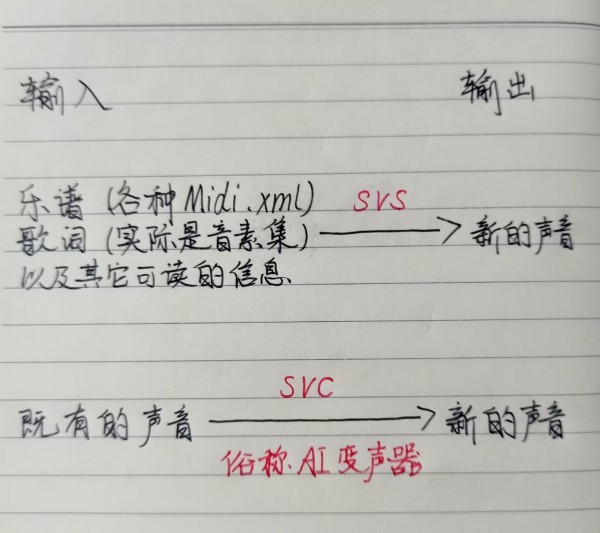

第一,AI歌手涉及的技術主要有兩大類:歌聲合成(Singing Voice Synthesis,SVS)和歌聲轉換(Singing Voice Conversion,SVC),而主要的發展是在歌聲合成即SVS上。第二,總的來說,歌聲合成可以分為拼接合成和AI合成兩大方向,從發展過程看,是由前者逐漸向后者演進。

被公眾熟知的明星虛擬歌姬——初音未來和洛天依,在技術上使用的正是拼接合成的方式,并在最初采用的是VOCALOID引擎(軟件)。這類拼接合成引擎依靠手動調校,可調節的參數和調節的精準度,會直接影響創作效果——完全手動調校對于新手來說入門難,制作需要花費更多精力。

UP主你ADC我輔助表示,由于拼接合成是通過對不同發音的錄入、編排和拼接來合成歌聲,具備音域寬、編輯自由度高的優點,但連貫度會有所欠缺,“畢竟本質上就是一段段的音頻素材”。

從拼接合成到AI合成的轉變過程,可以說是一種技術的革新。與傳統的拼接合成不同,AI合成是使用人工智能技術深度學習人聲樣本的唱法、發音、聲線、風格等,推測出本人怎么唱進而模仿。

2009年,名古屋工業大學開發的Sinsy就使用了隱馬爾科夫模型,而后CeVIO在Sinsy基礎上開發出輸入音符、文字就能唱歌說話的功能——這是最早使用非拼接方式的歌聲合成引擎。到了SynthesizerV發布時,技術上已經開始介入人工神經網絡(模仿人類大腦活動的機器深度學習模式),也就是說其在拼接合成的基礎上結合了人工智能技術,融合了兩者的優勢。

微軟小冰X studio也是早期AI引擎之一,免費使用但目前落后于其他引擎。相比之下,ACE作為完全的后起之秀,性能效果與Synthesizer V同屬第一梯隊,去年5月,洛天依也宣布與ACE合作推出了ACE引擎聲庫,早期ACE還提供了音樂創作社區。

AI合成引擎通過人工智能計算自動合成的聲音,往往不需要大改就能使用(也可以直接在計算結果的基礎上修改參數)——這一方面降低了制作成本;另一方面生成的聲音非常自然、流暢、擬真,操作門檻低。

不過UP主@HarryKamski介紹說,AI合成的缺點是音域會受限,而且因為合成方式非顯性,會有“自己的想法”,很多時候不能完全遵照調校師的想法。

“AI孫燕姿”背后的歌聲轉換

就在SVS歌聲合成在商業領域大行其道的同時,各種音樂社區內,隱匿生長的開源幼苗也在茁壯成長。并因幾個月前突然在網絡爆火的“AI孫燕姿”,將SVC(歌聲轉換)猛地推向了主流的道路。

“AI孫燕姿”與商用廣泛的SVS技術路線不同,采用的是歌聲轉換即SVC技術。兩者的技術原理和用戶生態都是不同的,談及兩者的區別時,UP主電漿果茶畫了一張圖。

UP主電漿果茶解釋說,不管用SVS AI還是SVC生成音頻,首先都需要采集聲音做一個AI模型,采集的聲音質量越高,模型輸出的音質也就越高。有了模型之后,SVS只需要輸入文本和音符就能生成一個新的音頻,沒有其他干擾的話,這個音頻的音質是不會變的。SVC模型生成內容則需要先輸入一個既有音頻,如果你往一個很好的模型輸入一個糟糕的音頻,那么輸出來的音頻也是糟糕的。

也就是說,“AI孫燕姿”這類AI歌手,本質可以理解為AI加持的歌聲變聲器,它是將源音頻的音色、聲線替換為目標歌手的,保留原來的歌詞、唱法、音調等,因此最后的呈現效果,很大程度上取決于源音頻的演唱水平。

相較SVS技術,SVC出現的時間并不久。早期日本發布過一款語音合成軟件Voiceroid,可以將輸入的文本轉換成語音朗讀,當時主要應用于一些游戲解說、美食教程、伴讀等。但對于實時需求來說,輸入文字并不方便,于是后來就出現了AI變聲器,比如,“塞壬VOICE”——這些當時本質上還是商業的閉源軟件。可以說,直到以VITS(語音合成模型)為基礎的這類開源、免費軟件出現,SVC才真正在社區中興起。

至于大火的“AI孫燕姿”誕生經歷,這里要提到一個人,國內歌聲合成愛好者Rcell,他基于VITS、SoftVC等項目開發了AI語音轉換軟件so-vits-svc,“AI孫燕姿”等AI歌手正是基于此制作的。由于so-vits-svc開源免費,可以在本地訓練,也因此被大家廣泛的使用——so-vits-svc之外,SVC軟件還有RVC、DiffSVC等。

除了“AI孫燕姿”的發如雪,SVC技術的興起給個人的音樂興趣帶來了更多的可能性。

今年3月,UP主你ADC我輔助在B站上傳了一首已故歌手本兮“演唱”的《反方向的鐘》,勾起無數90后的回憶殺,網友們紛紛在視頻下感慨追憶,留言7000多條。

UP主你ADC我輔助表示,“現在很多網友用SVC來訓練各種人物的聲庫,比如動漫角色、主播、明星,甚至身邊的親朋好友,只要你想,任何人的聲音都可以被訓練,并不限于明星。由于SVC聲庫訓練起來不算復雜,在二創中非常受歡迎。”

也正是如此,“AI孫燕姿”爆火后,“AI王菲”、“AI周杰倫”、“AI陳奕迅”紛紛上線,有人追求歌曲的適配,有人紀念去世歌手,也有人劍走偏鋒,讓郭德綱唱起了熱血日漫OP。

每一次有新的人工智能技術出來,都會引起一番AI取代人的問題的討論。有人認為,AI歌手的本質其實更像鋼琴吉他一樣,是一種樂器,無論是將其打造成虛擬偶像,還是生產力工具,它都不能脫離于人而存在。當然那些演唱能力很差的歌手,或許該有一些危機感。

AI歌手的商業版圖

不管AI歌手的本質是什么,任何一種新產品能否生存的核心都不僅是技術,更在于能否建立完善的商業模式。

商業模式上,SVS打造的歌手主要是和IP產業、偶像產業結合,比如廣告代言、賣周邊、直播、開演唱會、發行歌曲等。但虛擬偶像產業主要靠粉絲經濟,圈子小眾,想吃肉的多,可想而知這門生意并不好做。

最火的初音未來和洛天依都屬于最早吃到螃蟹的,一個是第一個在世界范圍爆火;另一個則是第一個打開中國市場的,因此吸引了大量粉絲。不過,與表面的火爆背后,AI歌手的成功其實鳳毛麟角,即使在二次元文化最盛行的日本,真正大獲成功的大概也只有以初音未來為代表的那幾個。

除了偶像化的商業模式,另一個營收方向是聲庫銷售。UP主你ADC我輔助表示,官方發布的SVS聲庫絕大多數都是經過配音員本人授權的,像SV AI、CeVIO AI等軟件的AI聲庫,多采用買斷制,以一個價格購買后就能終身使用其AI合成服務。

此外,電漿果茶表示,現在相關公司也在嘗試拓寬市場邊界,比如跟生產力工具結合。上個月,日本AI社宣布將與Unity合作推出A.I.VOICE語音合成聲庫,和基于A.I.VOICE技術的Unity擴展編輯器,讓用戶可以在Unity上直接合成語音內容,無需在多個軟件切換。

相比之下,SVC的商業路徑更窄,雖然也有商業化軟件,但在已經有很多開源免費SVC的情況下,如何突出商業SVC的優勢,是一個主要問題。同時由于制作門檻低,SVC頻道更加混亂,充斥大量低質量作品,也引起了一些圈內用戶的不滿。另一方面由于音頻的采集未經過版權方同意,SVC的AI歌手對原歌手以及詞曲者都可能構成侵權。

“灰色地帶”的陰影

版權爭議是AI歌手面臨的一個主要現實問題。

對于歌手本人和唱片公司來說,面對不間斷輸出的海量自制歌曲,進行授權或起訴索賠并不可行,最優的解決方案或許是將重點放在輸入側——讓AI工具從預先授權的數據集中學習。這樣唱片公司和出版商也有機會從中拓展營收,音樂版權也可能迎來一個新的商業模式。

這樣的新商業模式并非空中樓閣。

根據近期報道,谷歌和環球音樂正在就授權AI使用藝人的聲音和音樂來創作歌曲進行談判。知情人士稱,雙方的討論是圍繞AI技術在音樂版權方面達成合作伙伴關系,希望開發一種工具,讓廣大粉絲可以合法地創作AI歌曲,向版權方付費,歌手們可以自由選擇是否加入。目前磋商還處于早期階段,暫時不會推出產品。此外據透露,華納音樂也在與谷歌談判中。

版權之外,聲音合成還存在其他法律隱患。

聲音具有強烈的人身屬性,更是歌手賴以生存的根本。“聲音保護”也被寫入《民法典》,根據《民法典》第1023條相關規定:“對姓名等的許可使用,參照適用肖像許可使用的有關規定。對自然人聲音的保護,參照適用肖像權保護的有關規定。”那么未經本人允許,通過SVC技術偽造聲音,無疑是對其人身權益的損害。

UP主痕繼痕跡表示,“技術也可能會被用于不好的用途,比如某流量演員自身臺詞功底很弱,通過換聲把配音轉變成自己的,或者以后某歌手的歌都不是自己唱的,而是別人唱完變聲成自己的。”此外還可能偽造虛假的錄音、言論,進行詐騙或者造謠誹謗他人——今年已有多起使用AI合成語音電詐的案例曝光。

法律和商業模式都是AI歌手發展過程中要過的關,但這并不影響其成為人工智能技術的一次重大應用。AI歌手正在不斷拓展音樂創作的邊界,為音樂文化注入無限的可能性。