Meta推出像素級動作追蹤模型,簡易版在線可玩

本文經AI新媒體量子位(公眾號ID:QbitAI)授權轉載,轉載請聯系出處。

視頻動作跟蹤,已經精確到了每個像素!

Meta最新推出的視頻跟蹤工具CoTracker,發布沒多久就在GitHub上斬獲了1.4k星標。

從官方發布的幾個DEMO來看,效果還是很震撼的。

一場馬術比賽中,馬匹在騎手的操縱下優雅地跨過障礙,畫出了優美的弧線。

還有一架帆船乘風破浪,仿佛捉住了風的影子。

另一邊,一位跳傘運動員從空中劃過,留下了一道絢麗的彩虹……

對這個新“玩具”,有網友評論說,它不僅能改變物體追蹤技術,也將在體育(動作)分析、野生動物追蹤,甚至電影后期領域掀起一場新的革命。

我們也第一時間上手試玩了一下線上的簡易版本,下面就一起來看看吧。

精準記錄像素軌跡

首先有請四川知名網紅、熊貓界的當紅炸子雞“果賴”隆重登場。

只見花花六親不認的步伐被CoTracker整個記錄了下來,真的是太可愛了。

不過要論戲劇性的話,可能還得是我們的“西直門三太子”萌蘭。

看完了可愛的胖達,接下來就要進入整活環節了,來點名場面!

這個就不用再多介紹了吧(確信)。

除了上面的這位老朋友,還有王境澤吃炒飯的鏡頭。

只見他手上誠實的動作在CoTracker面前暴露無遺。

而在地球的另一邊,馬斯克正在直播用FSD開著特斯拉去找小扎,準備進行一番親切友好的交流。

CoTracker的效果就展示到這里了,朋友們如果想看其他效果可以自己玩玩看。

傳送門:https://huggingface.co/spaces/facebook/cotracker

不過,在線DEMO是個簡易版本,還不支持自定義跟蹤位置,只能根據輸入的跟蹤數量等距分配。

但是如果自己部署、用代碼操縱的話,就可以設置任意跟蹤點了。

說到這我們正好來看一下CoTracker該怎么部署。

首先是Colab版本,我們剛剛說到的自定義跟蹤點也在Colab當中。

傳送門:https://colab.research.google.com/github/facebookresearch/co-tracker/blob/master/notebooks/demo.ipynb

Colab的過程不必過多介紹,進入之后運行筆記中的代碼就可以了。

而如果想自己動手的話,最簡單的方式是從torch.hub中直接調用已完成預訓練的版本。

pip install einops timm tqdmimport torch

import timm

import einops

import tqdm

cotracker = torch.hub.load("facebookresearch/co-tracker", "cotracker_w8")如果要對模型進行評估或訓練,那么使用GitHub Repo更為合適。

首先要安裝一下程序和相關依賴:

git clone https://github.com/facebookresearch/co-tracker

cd co-tracker

pip install -e .

pip install opencv-python einops timm matplotlib moviepy flow_vis然后下載模型:

mkdir checkpoints

cd checkpoints

wget https://dl.fbaipublicfiles.com/cotracker/cotracker_stride_4_wind_8.pth

wget https://dl.fbaipublicfiles.com/cotracker/cotracker_stride_4_wind_12.pth

wget https://dl.fbaipublicfiles.com/cotracker/cotracker_stride_8_wind_16.pth

cd ..有關評估和訓練的方式,可以到GitHub項目頁來查看,鏈接放在了文末。

那么,CoTracker又是怎么實現像素級追蹤的呢?

評分超過DINOv2

雖然都是追蹤,但CoTracker和物體追蹤模型有很大區別。

CoTracker并沒有基于語義理解對視頻中物體進行分割的過程,而是把重點放在了像素點上。

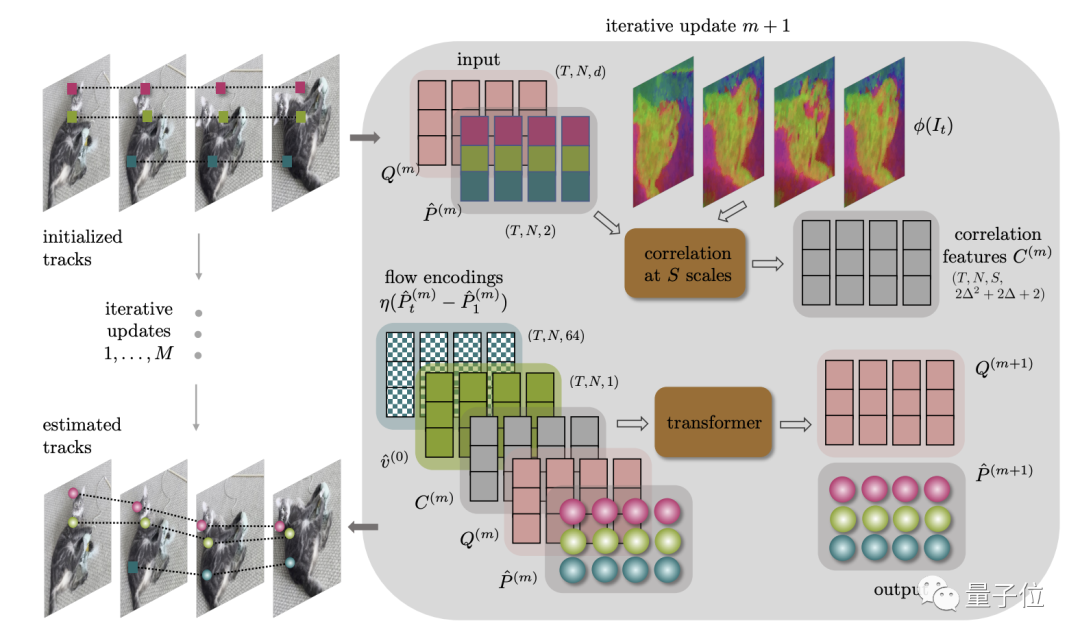

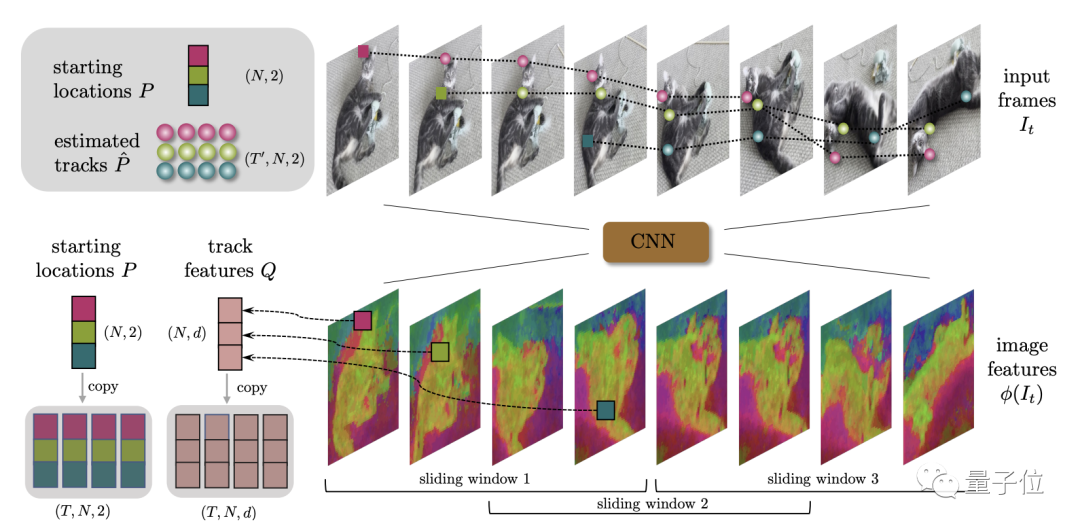

底層方面,CoTracker采用了Transformer架構。

Transformer編碼了視頻中點的跟蹤信息,并迭代更新點的位置。

推理上,CoTracker還采用了一種窗口機制,在時間軸上劃分出滑動窗口。

CoTracker使用上個窗口的輸出對后面的窗口進行初始化,并在每個窗口上運行多次Transformer迭代。

這樣就使得CoTracker能夠對更長的視頻進行像素級跟蹤。

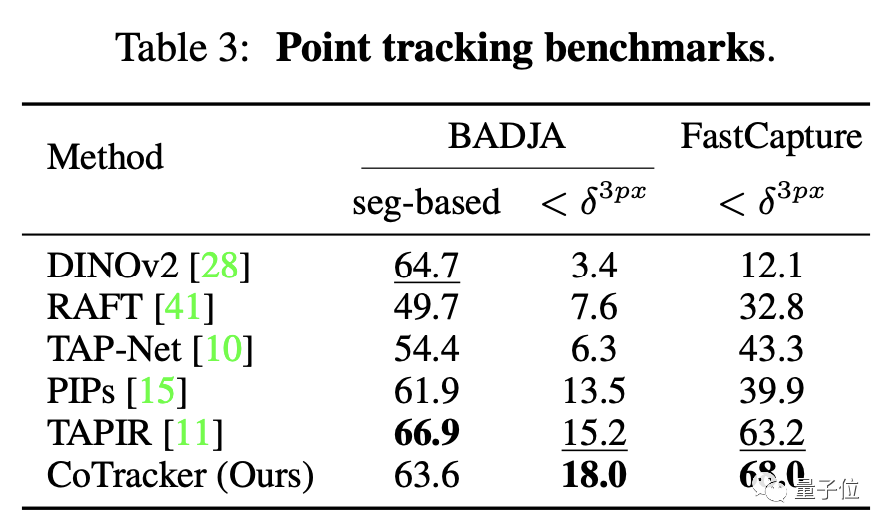

總之,經過一番訓練之后,CoTracker取得了一份不俗的成績單。

在FastCapture數據集測試上,CoTracker的成績在一眾模型中脫穎而出,其中也包括Meta自家的DINOv2。

總之,喜歡的話,就趕緊體驗一下試試吧!

論文地址:https://arxiv.org/pdf/2307.07635.pdfGitHub項目頁:

https://github.com/facebookresearch/co-tracker