在視覺提示中加入「標記」,微軟等讓GPT-4V看的更準、分的更細

最近一段時間,我們見證了大型語言模型(LLM)的顯著進步。特別是,生成式預訓練 Transformer 或 GPT 的發布引領了業界和學術界的多項突破。自 GPT-4 發布以來,大型多模態模型 (LMM) 引起了研究界越來越多的興趣,許多工作致力于構建多模態 GPT-4。

近日,GPT-4V (ision) 由于出色的多模態感知和推理能力得到了大家格外的關注。然而,盡管 GPT-4V 具有前所未有的視覺語言理解能力,但其細粒度 visual grounding(輸入是圖片和對應的物體描述,輸出是描述物體的 box)能力相對較弱,或者尚未發揮出來。

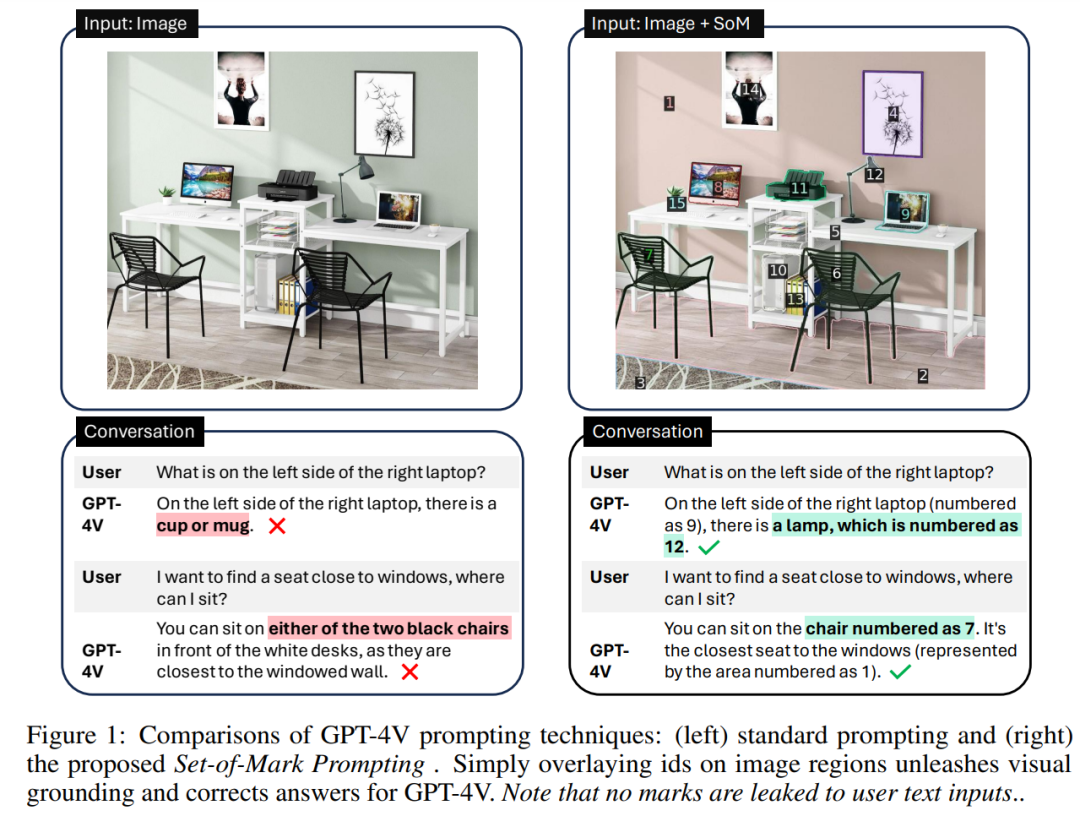

舉例來說,當用戶詢問下圖中「放置在右邊筆記本電腦的左邊是什么物體?」GPT-4V 給出了馬克杯這個錯誤的答案。當用戶接著詢問,「想找一個靠窗的座位,我可以坐在哪里?」GPT-4V 同樣回答不正確。

在意識到上述問題后,來自微軟、香港科技大學等機構的研究者提出了一種新的視覺 prompt 方法 Set-of-Mark(SoM),來解決 GPT-4V 在細粒度視覺任務上的問題。

- 論文地址:https://arxiv.org/pdf/2310.11441.pdf

- 論文主頁:https://som-gpt4v.github.io/

如圖 1(右)所示,SoM 采用交互式分割模型(例如 SAM)將圖像劃分為不同粒度級別的區域,并在這些區域上添加一組標記(mark),例如字母數字、掩碼(mask)、框(box)。使用添加標記的圖像作為輸入,以解決上述問題。

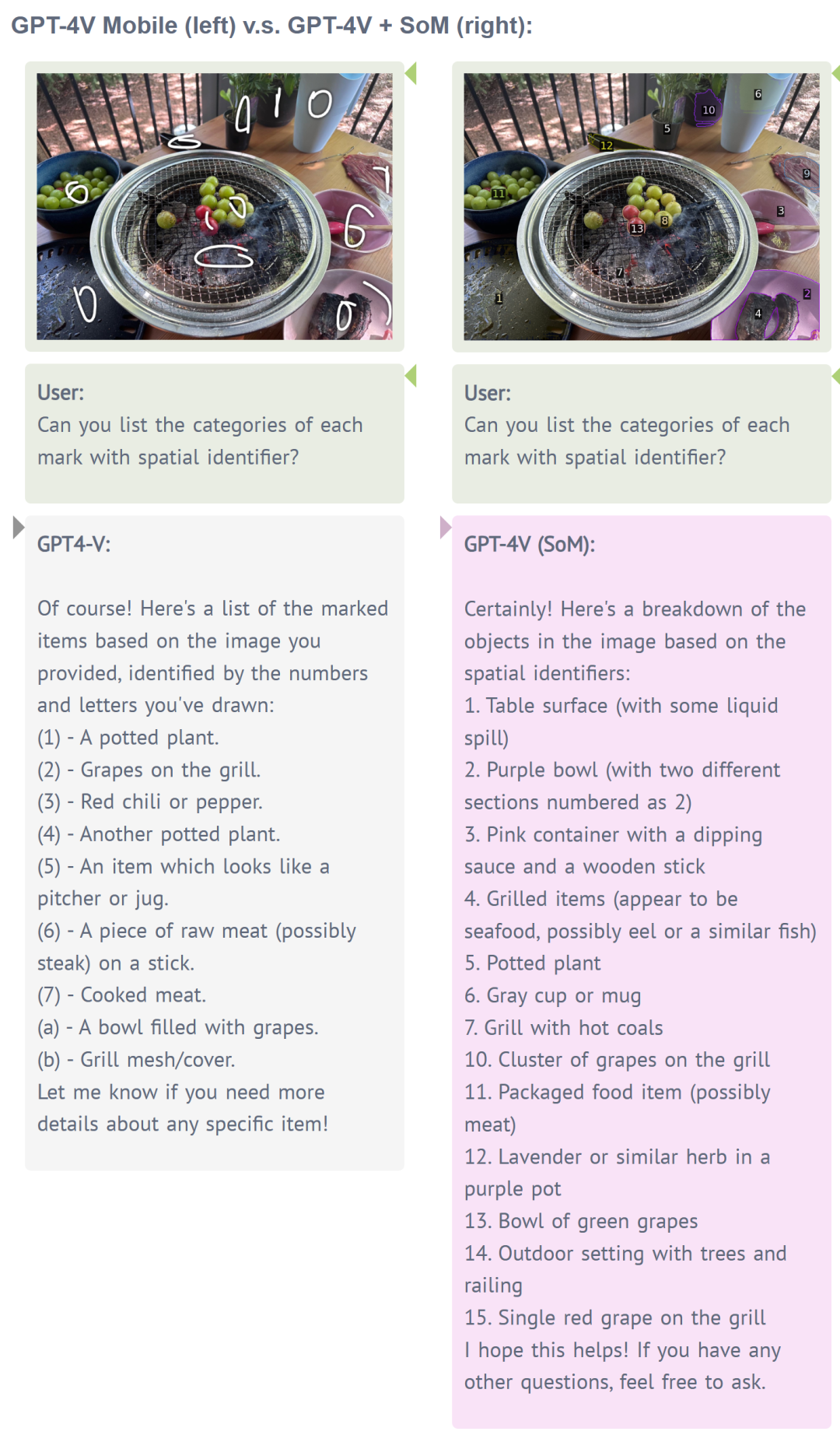

我們先來看下效果,左為 GPT-4V,右為 GPT-4V+SoM,很明顯后者分類更細致、準確。

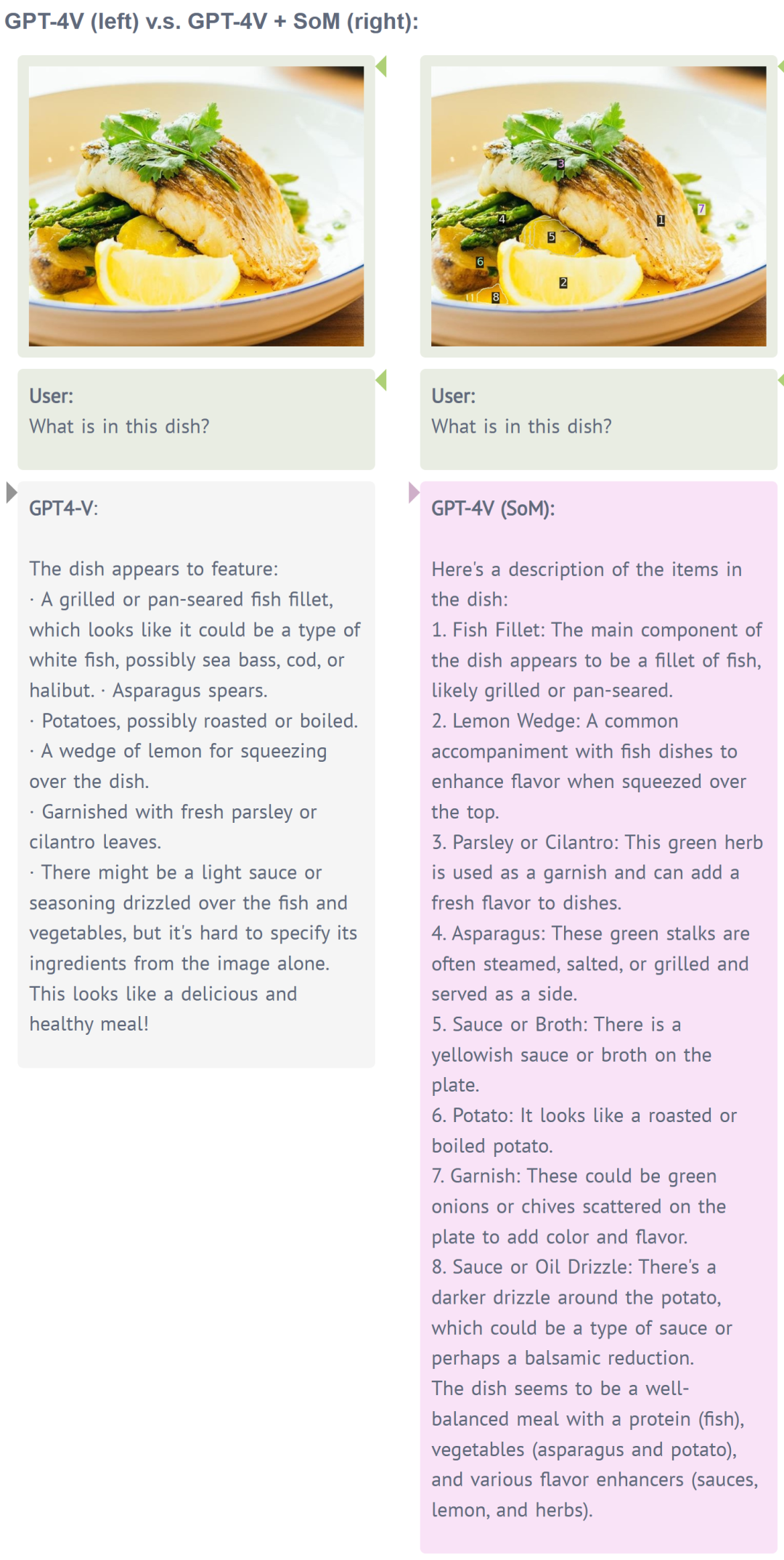

下圖示例依然如此,GPT-4V+SoM 效果更明顯。

此外,對于這項研究,有人問道:「SoM 是手動(人工輸入)還是自動的?」

論文一作 Jianwei Yang 表示,SoM 是自動或半自動的。他們編譯了很多自己構建自己的分割工具,比如 SEEM、Semantic-SAM 和 SAM,用來幫助用戶自動為圖像分割區域。同時用戶也可以自己選擇區域。

用于視覺的 SoM prompt

使用 SoM prompt GPT-4V 的獨特優點是它可以產生文本之外的輸出。由于每個標記都與掩碼表征的圖像區域特定關聯,因此可以追溯文本輸出中任何提到的標記的掩碼。

生成成對文本和掩碼的能力使 SoM 能夠 prompt GPT-4V 來生成視覺關聯的文本,更重要的是支持各種細粒度視覺任務,這對普通的 GPT-4V 模型來說是一個挑戰。

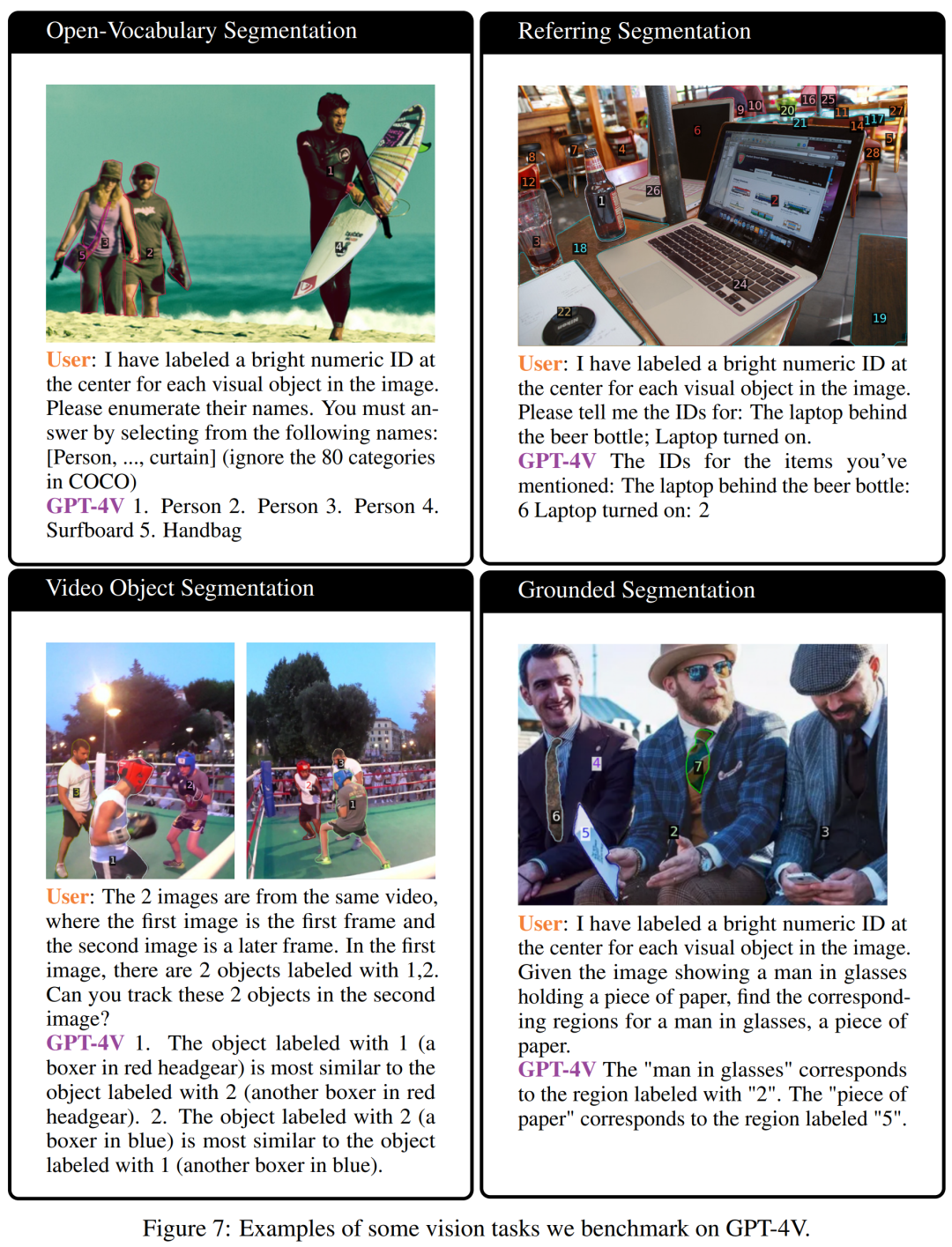

通過簡單的 prompt 工程,SoM 可以讓 GPT-4V 廣泛地用于多種視覺任務,例如:

- 開放詞匯圖像分割:該研究要求 GPT-4V 詳盡地給出所有標記區域的類別以及從預定池中選擇的類別。

- 參考分割:給定一個參考表達式,GPT-4V 的任務是從圖像分區工具箱生成的候選區域中選擇最匹配的區域。

- 短語關聯(Phrase Grounding):與參考分割略有不同,短語關聯使用由多個名詞短語組成的完整句子。該研究要求 GPT-4V 為所有標記的短語分配相應的區域。

- 視頻對象分割:以兩個圖像作為輸入。第一個圖像是查詢圖像,其中包含第二個圖像中需要識別的一些對象。鑒于 GPT-4V 支持多個圖像作為輸入,因此 SoM 也可以應用于視頻中跨幀的關聯視覺對象。

實驗及結果

研究者使用「分而治之」(divide-and-conquer)的策略來運行實驗和評估。對于每個實例,他們使用新的聊天窗口,這樣一來,評估期間就不會出現上下文泄露了。

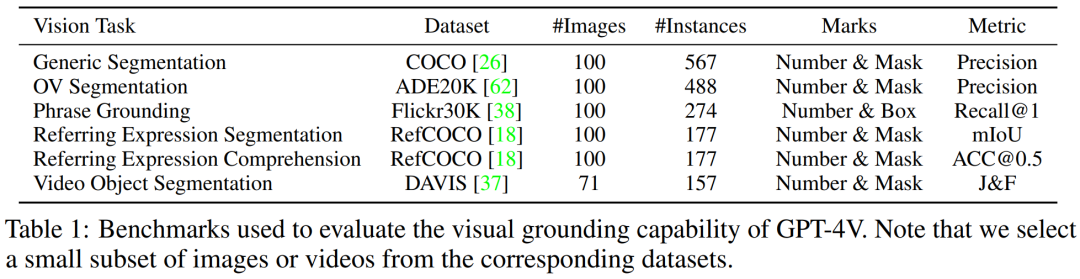

具體來講,研究者從每個數據集中選擇了小規模的驗證數據子集。對于數據集中的每個圖像,他們在使用圖像分割工具箱提取的區域上覆蓋了一組標記。同時基于具體的任務,研究者利用不同的分割工具來提出區域。

下表 1 列出了每個任務的設置細節。

研究者將其方法與以下模型進行比較:

- 預測坐標的 GPT-4V 基線模型

- SOTA 專用模型

- 開源 LMM

定量結果

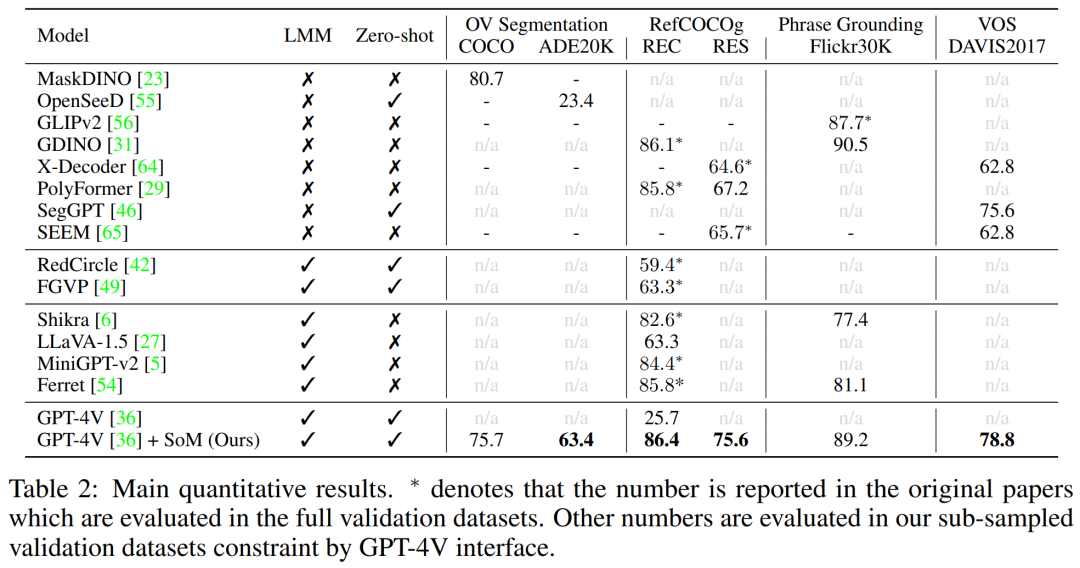

詳細的實驗結果如下表 2 所示。

首先是圖像分割任務。研究者將 GPT-4V + SoM 與 COCO Panoptic 分割數據集上的強大分割模型 MaskDINO、ADE20K Panoptic 分割數據集上的模型 OpenSeeD 進行了比較。

結果顯示,GPT-4V + SoM 的零樣本性能接近微調后的 MaskDINO,并大幅優于 OpenSeeD。GPT-4V 在 COCO 和 ADE20K 上的相似性能表現出其對廣泛視覺和語義域任務的強大泛化能力。

然后是參考(referrring)任務,研究者評估了 RefCOCOg 數據集上的模型 RES 和 REC。他們使用 MaskDINO 來提出掩碼,并在圖像上覆蓋上掩碼和數字。同時使用 mIoU 作為評估指標,并與 SOTA 專用模型 PolyFormer 和 SEEM 進行比較。

結果顯示,GPT-4V+SoM 擊敗了 Grounding DINO、Polyformer 等專用模型以及 Shikra、LLaVA-1.5、MiniGPT-v2 和 Ferret 等最近的開源 LMM。

接著是 Flickr30K 上的短語關聯任務,研究者使用 Grounding DINO 為每個圖像生成框建議。GPT-4V+SoM 實現了比 GLIPv2 和 Grounding DINO 更強的零樣本性能。

最后研究者在 DAVIS2017 數據集上評估了視頻分割任務。GPT-4V+SoM 實現了優于其他專用視覺模型的最佳追蹤性能(78.8 J&F)。

消融研究

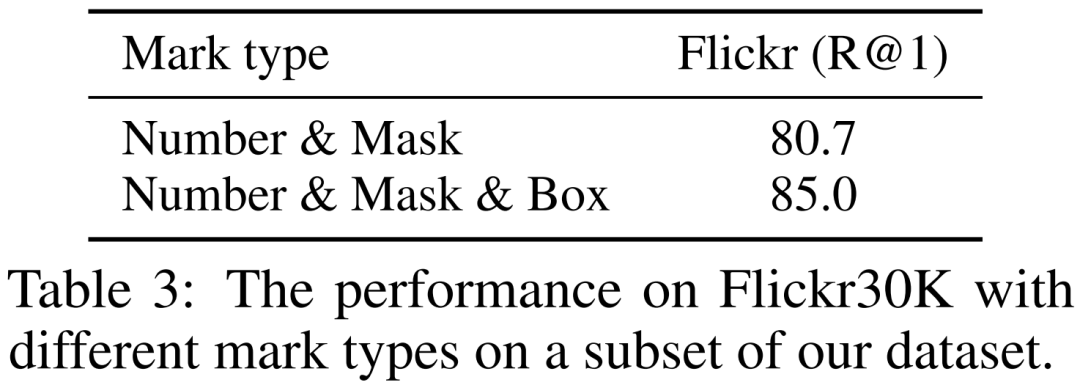

研究者探討了標記類型如何影響 Flickr30k 數據集上短語關聯任務的最終性能,并比較了兩種類型的標記。第一種是數字和掩碼,第二種是數字、掩碼和框。

結果如下表 3 所示,添加額外的框可以顯著提升性能。

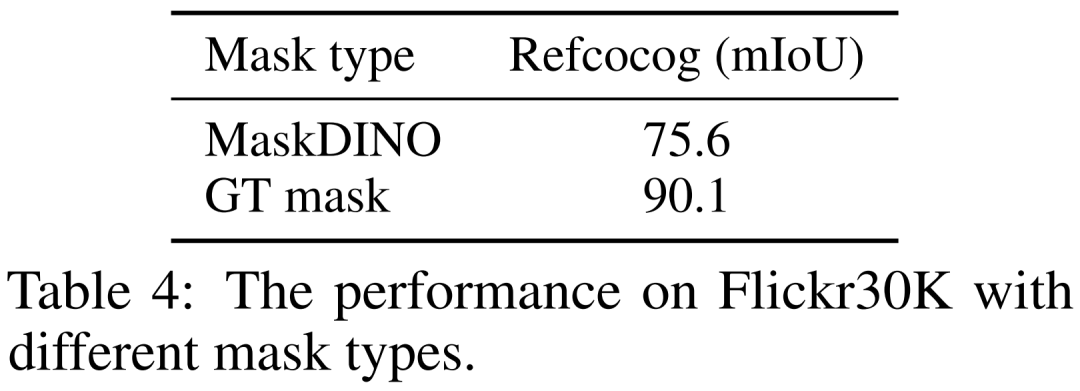

此外研究者探究了當生成帶有真值注釋的標記時,GPT-4V 如何表現。他們選擇在 RefCOCOg 驗證集中用真值掩碼替換預測到的分割掩碼。這意味著 GPT-4V 只需要從注釋短語區域選擇一個即可。如預期一樣,參考分割的性能可以得到進一步提升,尤其是當分割模型有一些缺失的區域。

結果如下表 4 所示,在 SoM 中使用真值掩碼可以將 RefCOCOg 上的性能提升 14.5%(mIoU)。

更多技術細節和實驗結果參閱原論文。