解說(shuō)梅西球賽、英雄聯(lián)盟,OpenAI GPT-4視覺(jué)API被開發(fā)者玩出新花樣

文章開始,我們先來(lái)看一段球賽解說(shuō)視頻:

是不是感覺(jué)聽起來(lái)不太對(duì)勁?

你的感覺(jué)沒(méi)錯(cuò),因?yàn)檫@段解說(shuō)是用 AI 生成的,這個(gè)大喊「梅西!梅西!」的聲音居然來(lái)自 AI。

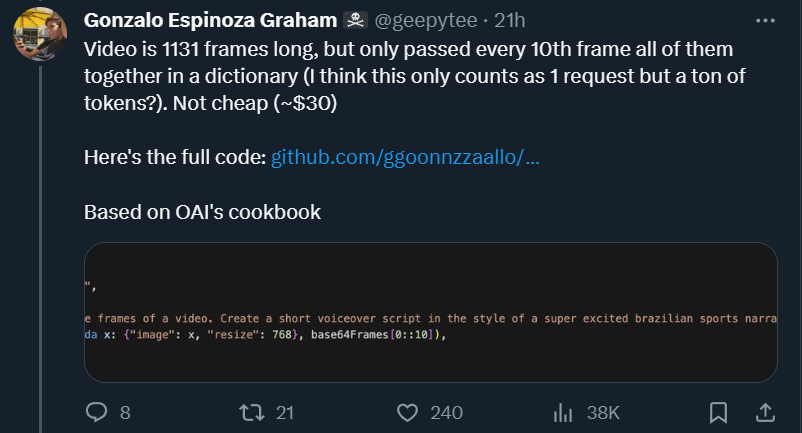

這是 X 平臺(tái)(原推特)博主 @Gonzalo Espinoza Graham 發(fā)布的一段視頻。他表示,在制作過(guò)程中,他主要用到了 GPT-4V 和 TTS 兩項(xiàng)技術(shù)。

GPT-4V 是 OpenAI 前段時(shí)間發(fā)布的一個(gè)多模態(tài)大模型,既能像原版的 ChatGPT 一樣通過(guò)文字聊天,也能讀懂用戶在聊天中給到的圖像。更令人興奮的是,在昨天的開發(fā)者大會(huì)上,OpenAI 宣布,他們已經(jīng)開放了視覺(jué)能力相關(guān)的 API——gpt-4-vision-preview。通過(guò)這個(gè) API,開發(fā)者可以用 OpenAI 最新的 GPT-4 Turbo(視覺(jué)版)來(lái)開發(fā)新應(yīng)用。

對(duì)于這個(gè)期待已久的 API,開發(fā)者們都躍躍欲試。因此,API 剛開放一天,就有不少開發(fā)者曬出了試用結(jié)果,這個(gè)球賽解說(shuō)就是其中之一。

博主表示,為了制作這個(gè)解說(shuō)視頻,他將原視頻的幀分批傳給 gpt-4-vision-preview,然后通過(guò)一些簡(jiǎn)單的提示(prompt)要求模型生成一段旁白,最后把得到的結(jié)果用 TTS(文本轉(zhuǎn)語(yǔ)音技術(shù))轉(zhuǎn)成音頻,就可以得到視頻中展示的效果。如果稍加編輯,理論上還能得到更好的結(jié)果。按照 OpenAI 目前的定價(jià),制作這個(gè)視頻大約要花 30 美元,作者直呼「不便宜」。

相關(guān)代碼:https://github.com/ggoonnzzaallo/llm_experiments/blob/main/narrator.ipynb

除了球賽,還有開發(fā)者曬出了自己用 OpenAI 視覺(jué) API 解說(shuō)《英雄聯(lián)盟》的 demo,這個(gè) demo 用到的是 LNG 與 T1 的一場(chǎng)比賽視頻,引起了全網(wǎng) 50 多萬(wàn)網(wǎng)友的圍觀。

解說(shuō)效果是這樣的:

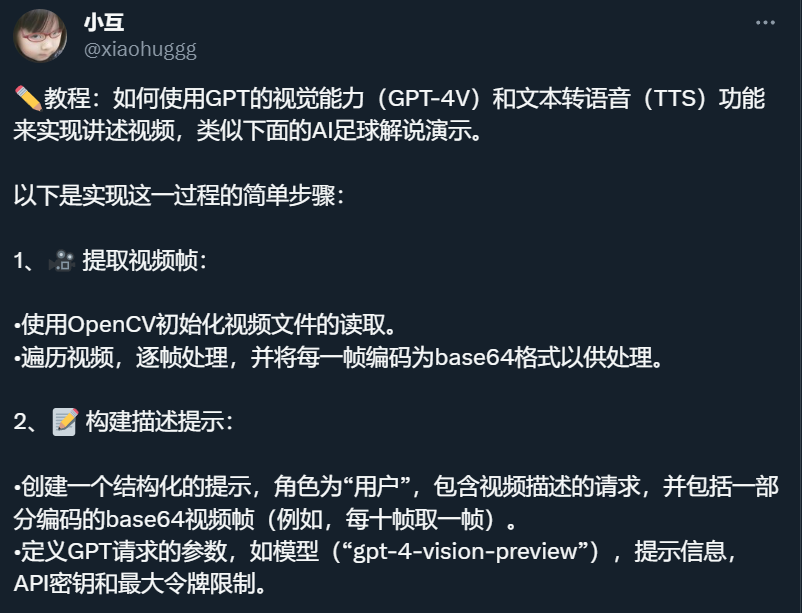

不過(guò),這類視頻具體要怎么做呢?好在,除了這些成品效果,部分開發(fā)者還曬出了自己總結(jié)的教程,以及每個(gè)步驟中涉及的具體工具。

從 X 平臺(tái)用戶 @小互曬出的內(nèi)容來(lái)開,整個(gè)實(shí)現(xiàn)過(guò)程可以分為 7 步:

- 提取視頻幀;

- 構(gòu)建描述提示;

- 發(fā)送 GPT 請(qǐng)求;

- 制作語(yǔ)音解說(shuō)提示;

- 生成語(yǔ)音解說(shuō)腳本;

- 將腳本轉(zhuǎn)換為音頻;

- 將音頻與視頻結(jié)合。

具體內(nèi)容請(qǐng)參見以下教程:

不過(guò),有人在評(píng)論區(qū)提出疑問(wèn):解說(shuō)的這些比賽都是以前的,實(shí)時(shí)的比賽能解說(shuō)嗎?

能否解說(shuō)實(shí)時(shí)的比賽我們現(xiàn)在還看不出來(lái),不過(guò),確實(shí)有開發(fā)者曬出了用 OpenAI 視覺(jué) API 實(shí)時(shí)解讀攝像頭內(nèi)容的 demo:

項(xiàng)目鏈接:https://github.com/bdekraker/WebcamGPT-Vision

做了類似實(shí)驗(yàn)的開發(fā)者評(píng)價(jià)說(shuō),OpenAI 視覺(jué) API 的識(shí)別速度很快、準(zhǔn)確性也很高。

甚至有人直接把它當(dāng)實(shí)時(shí)繪圖工具來(lái)用,把手里的草圖實(shí)時(shí)轉(zhuǎn)換為此前調(diào)用專業(yè)繪圖工具才能繪制的圖表:

不過(guò),這個(gè)實(shí)時(shí)效果的實(shí)驗(yàn)會(huì)受到 OpenAI 設(shè)置的速率限制。

可以說(shuō),OpenAI 正通過(guò) GPT-4V 以及剛剛開放的視覺(jué) API 讓全世界看到多模態(tài)的力量,以上效果只是冰山一角。

其實(shí),無(wú)論是在現(xiàn)實(shí)生活中,還是在研究領(lǐng)域,一個(gè)能讀懂圖像、視頻的 AI 都有廣泛的用途。

在生活中,它能用于構(gòu)建更加智能的機(jī)器人,讓機(jī)器人實(shí)時(shí)分析眼前的情景,隨機(jī)應(yīng)變,這也是當(dāng)前大火的具身智能所研究的問(wèn)題。

國(guó)內(nèi)創(chuàng)業(yè)公司開發(fā)的具身智能機(jī)器人(參見《獨(dú)家 | 達(dá)摩院后的下一站:陳俊波推出具身智能大模型,要給所有機(jī)器人做一顆腦袋》)

此外,它還能用于改善視障群體的生活質(zhì)量,幫助他們解讀視頻畫面和生活場(chǎng)景。其實(shí),在字節(jié)跳動(dòng)去年舉辦的一個(gè)幫助視障群體的公益比賽中,我們就能看到不少類似的創(chuàng)意,只是當(dāng)時(shí)多模態(tài)技術(shù)還不夠成熟(參見《穿顏色成對(duì)的襪子,追最新的劇:這群 coder 正幫視障者移走身上的大山》)。

在微軟最近的一篇論文中,研究者也展示了他們?cè)谶@方面取得的進(jìn)展,比如用 GPT-4V 解讀《憨豆先生》劇情。

這種優(yōu)秀的視頻解讀能力能夠幫助研究人員更好地理解視頻,從而把廣泛存在的視頻轉(zhuǎn)化為新的訓(xùn)練數(shù)據(jù),訓(xùn)練出更聰明的 AI,形成一個(gè)閉環(huán)。

看來(lái),一個(gè)更智能的世界正在加速到來(lái)。