Python數據分析從入門到進階:分類算法

數據分析是處理和解釋數據以發現有用信息和洞察的過程。其中,分類算法是數據分析領域的一個重要組成部分,它用于將數據分為不同的類別或組。

本文將介紹分類算法的基本概念和進階技巧,以及如何在Python中應用這些算法,包括示例代碼和實際案例。

一、分類算法入門

1、什么是分類算法?

分類算法是一種監督學習方法,用于將數據分為不同的類別或組。它是數據分析中的重要工具,可用于解決各種問題,如垃圾郵件檢測、疾病診斷、圖像識別等。分類算法的目標是從已知類別的訓練數據中學習規律,然后將這些規律應用于新數據的分類。

2、常見的分類算法

在數據分析中,有許多不同的分類算法可供選擇,每個算法都有其特點和適用場景。

以下是一些常見的分類算法:

- 決策樹(Decision Trees):基于樹狀結構的模型,通過對數據的特征進行逐步劃分來進行分類。

- 隨機森林(Random Forest):是一種集成學習方法,通過多個決策樹的組合來提高分類的準確性。

- 支持向量機(Support Vector Machine,SVM):一種二分類模型,通過構建超平面來實現數據分類。

- K最近鄰算法(K-Nearest Neighbors,KNN):基于距離的分類方法,通過比較數據點與其最近鄰居的距離來進行分類。

- 樸素貝葉斯(Naive Bayes):基于貝葉斯定理的分類方法,通過計算概率來進行分類。

- 神經網絡(Neural Networks):通過模擬人腦神經元之間的連接來進行分類,是深度學習的基礎。

3、數據準備

在應用分類算法之前,需要進行數據準備工作。包括數據收集、數據清洗、特征工程等步驟。數據準備是數據分析的關鍵部分,直接影響到分類算法的性能和準確性。

二、Python中的分類算法應用

在Python中,有多個庫和工具可用于實現分類算法。

使用Python和Scikit-Learn庫來應用分類算法。

使用Scikit-Learn進行分類

Scikit-Learn是Python中一個強大的機器學習庫,提供了許多分類算法的實現。以下是一個簡單的示例,演示了如何使用Scikit-Learn來構建和訓練一個分類模型:

from sklearn.model_selection import train_test_split

from sklearn.ensemble import RandomForestClassifier

from sklearn.metrics import accuracy_score

# 準備數據集

# 這里使用了一個虛擬的數據集作為示例

data = [[1, 2, 3], [4, 5, 6], [7, 8, 9]]

labels = [0, 1, 0]

# 劃分數據集為訓練集和測試集

X_train, X_test, y_train, y_test = train_test_split(data, labels, test_size=0.2, random_state=42)

# 構建隨機森林分類器

clf = RandomForestClassifier()

# 訓練分類器

clf.fit(X_train, y_train)

# 進行預測

y_pred = clf.predict(X_test)

# 計算準確率

accuracy = accuracy_score(y_test, y_pred)

print(f"模型準確率:{accuracy}")在上面的示例中,我們首先準備了一個虛擬的數據集,然后將數據集劃分為訓練集和測試集。接下來,我們構建了一個隨機森林分類器,并使用訓練集進行模型訓練。最后,我們使用測試集進行預測,并計算模型的準確率。

三、分類算法進階

1、特征工程

特征工程是數據分析和機器學習中的關鍵環節,對分類算法的性能有著重要的影響。特征工程的目標是從原始數據中提取有意義的、對分類任務有幫助的特征。下面將討論特征工程的一些關鍵概念和技巧。

(1)特征選擇

特征選擇是從原始特征中選擇最重要和最相關的特征,以提高模型的性能和減少維度。在進行特征選擇時,可以考慮使用以下方法:

- 方差閾值選擇:通過計算特征的方差來選擇低方差的特征。低方差的特征通常對分類任務的貢獻有限。

- 相關性選擇:使用相關性分析來選擇與目標變量相關性高的特征。這可以通過計算Pearson相關系數或其他相關性指標來實現。

- 遞歸特征消除(RFE):RFE是一種迭代方法,從所有特征開始,反復訓練模型并剔除對模型性能貢獻較小的特征,直到達到期望的特征數量。

(2)特征縮放

特征縮放是將不同特征的值縮放到相同的尺度,以確保模型對所有特征都具有相等的權重。常見的特征縮放方法包括:

- 標準化:將特征縮放為均值為0、方差為1的標準正態分布。

- 歸一化:將特征縮放到一個特定的范圍,通常是[0, 1]。

- 正則化:通過將特征向量轉化為單位向量來進行特征縮放。

特征縮放可以提高模型的穩定性和收斂速度,特別是對于使用梯度下降等優化算法的模型。

(3)特征提取

特征提取是從原始數據中創建新的特征,以提供更多信息或減少數據的維度。常見的特征提取方法包括:

- 主成分分析(PCA):通過線性變換將數據投影到新的坐標系,以最大程度地保留數據的方差。

- 獨立成分分析(ICA):尋找數據中的獨立信號源。

- 特征哈希:使用哈希函數將原始特征映射到低維度的特征空間。

特征提取可以幫助減少數據的維度,減少過擬合風險,并提取更有信息量的特征。

示例:特征工程在Python中的應用

以下是一個簡單的示例,演示了如何在Python中進行特征工程。我們將使用Scikit-Learn庫來執行特征選擇和特征縮放。

from sklearn.datasets import load_iris

from sklearn.feature_selection import SelectKBest

from sklearn.feature_selection import chi2

from sklearn.preprocessing import StandardScaler

# 加載Iris數據集作為示例

iris = load_iris()

X, y = iris.data, iris.target

# 特征選擇:選擇最重要的2個特征

selector = SelectKBest(chi2, k=2)

X_new = selector.fit_transform(X, y)

# 特征縮放:標準化特征

scaler = StandardScaler()

X_scaled = scaler.fit_transform(X)

print("原始特征矩陣的形狀:", X.shape)

print("選擇最重要的2個特征后的形狀:", X_new.shape)

print("標準化特征后的形狀:", X_scaled.shape)在上面的示例中,我們首先加載了Iris數據集作為示例數據。然后,我們使用SelectKBest來選擇最重要的2個特征,并使用StandardScaler來標準化特征。這是特征工程的一個簡單示例,但在實際項目中,特征工程可能會更加復雜和細致。

2、超參數調優

超參數調優是提高分類算法性能的關鍵步驟之一。超參數是在模型訓練之前設置的參數,它們不是從數據中學習得到的,而是需要手動調整的。通過合理的超參數調優,可以提高模型的性能和泛化能力。以下是一些常見的超參數和調優方法:

(1)學習率

學習率是梯度下降算法中的一個重要超參數,它決定了每次迭代中模型參數的更新幅度。學習率太小會導致收斂速度過慢,學習率太大可能導致無法收斂或者發散。通常,可以使用網格搜索或隨機搜索來尋找最佳的學習率值。

(2)樹的深度

對于決策樹和隨機森林等算法,樹的深度是一個重要的超參數。樹太深可能導致過擬合,樹太淺可能導致欠擬合。可以通過交叉驗證來確定最佳的樹深度。

(3)K值

對于K最近鄰算法(KNN),K值是一個重要的超參數,它決定了每個數據點的最近鄰數量。選擇合適的K值可以影響分類模型的性能。通常,可以通過交叉驗證來選擇最佳的K值。

(4)正則化參數

正則化參數用于控制模型的復雜性,例如L1正則化和L2正則化。不同的正則化參數值可以影響模型的穩定性和泛化能力。可以通過交叉驗證來選擇最佳的正則化參數。

(5)特征數量

在特征工程中,特征數量也是一個需要調優的超參數。選擇不同數量的特征可以影響模型的性能。可以使用特征選擇方法來確定最佳的特征數量。

(6)模型選擇

有時,超參數調優甚至可以包括選擇不同的分類算法。不同的算法對不同類型的數據和問題可能更有效。可以使用交叉驗證來比較不同算法的性能。

示例:超參數調優

以下是一個示例,演示了如何在Python中使用Scikit-Learn進行超參數調優。我們將使用網格搜索來尋找最佳的K最近鄰算法的K值。

from sklearn.datasets import load_iris

from sklearn.model_selection import GridSearchCV

from sklearn.neighbors import KNeighborsClassifier

# 加載Iris數據集作為示例

iris = load_iris()

X, y = iris.data, iris.target

# 定義K最近鄰分類器

knn = KNeighborsClassifier()

# 定義超參數搜索范圍

param_grid = {'n_neighbors': [3, 5, 7, 9]}

# 使用網格搜索進行超參數調優

grid_search = GridSearchCV(knn, param_grid, cv=5)

grid_search.fit(X, y)

# 輸出最佳K值和交叉驗證得分

best_k = grid_search.best_params_['n_neighbors']

best_score = grid_search.best_score_

print(f"最佳K值:{best_k}")

print(f"最佳交叉驗證得分:{best_score}")在上面的示例中,我們首先加載了Iris數據集作為示例數據。然后,我們定義了K最近鄰分類器,并指定了K值的搜索范圍。接下來,我們使用網格搜索(GridSearchCV)來尋找最佳的K值,并輸出最佳K值和交叉驗證得分。

3、模型評估

模型評估是在使用分類算法時至關重要的環節,它幫助我們了解模型的性能和效果。不同的分類問題可能需要不同的評估指標,以下是一些常見的模型評估指標和如何使用它們來評估分類算法的性能:

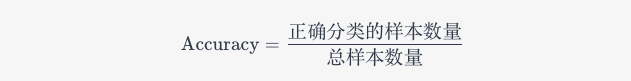

(1)準確率(Accuracy)

準確率是最常見的評估指標之一,它表示模型正確分類的樣本數量與總樣本數量的比例。計算方式如下:

準確率適用于平衡的分類問題,但在不平衡的問題中可能會誤導。例如,在垃圾郵件過濾中,大多數郵件都是非垃圾郵件,如果模型將所有郵件都預測為非垃圾郵件,準確率可能很高,但模型實際上是無效的。

(2)精確度(Precision)

精確度是指被模型正確分類為正類別的樣本數量與所有被模型分類為正類別的樣本數量的比例。計算方式如下:

精確度適用于關注準確性的問題,例如醫學診斷。高精確度表示模型的正類別預測幾乎都是正確的,但可能漏掉了一些正類別樣本。

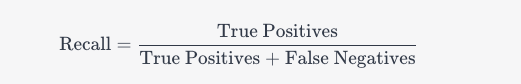

(3)召回率(Recall)

召回率是指被模型正確分類為正類別的樣本數量與所有實際正類別的樣本數量的比例。計算方式如下:

召回率適用于關注查全率的問題,例如安全檢測。高召回率表示模型能夠捕獲大多數正類別樣本,但可能會有一些誤報。

(4)F1分數

F1分數是精確度和召回率的調和平均值,它綜合考慮了精確度和召回率,用于平衡精確性和查全率。計算方式如下:

F1分數適用于需要平衡精確性和查全率的問題。它將精確度和召回率結合起來,用于評估分類模型的整體性能。

(5)ROC曲線和AUC

ROC曲線(Receiver Operating Characteristic Curve)是用于評估二元分類模型性能的一種方法。ROC曲線以假正類率(False Positive Rate)和真正類率(True Positive Rate)為坐標,展示了不同閾值下的模型性能。AUC(Area Under the Curve)是ROC曲線下的面積,用于度量分類模型的性能。AUC的取值范圍在0到1之間,值越接近1表示模型性能越好。

示例:模型評估

以下是一個示例,演示如何使用Scikit-Learn來評估分類模型的性能。我們將加載一個二元分類問題的數據集,并使用準確率、精確度、召回率和F1分數來評估模型。

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

from sklearn.linear_model import LogisticRegression

from sklearn.metrics import accuracy_score, precision_score, recall_score, f1_score

# 加載Iris數據集作為示例

iris = load_iris()

X, y = iris.data, iris.target

# 將問題轉化為二元分類問題

y_binary = (y == 0).astype(int)

# 劃分數據集為訓練集和測試集

X_train, X_test, y_train, y_test = train_test_split(X, y_binary, test_size=0.2, random_state=42)

# 創建Logistic回歸模型

model = LogisticRegression()

# 訓練模型

model.fit(X_train, y_train)

# 進行預測

y_pred = model.predict(X_test)

# 計算評估指標

accuracy = accuracy_score(y_test, y_pred)

precision = precision_score(y_test, y_pred)

recall = recall_score(y_test, y_pred)

f1 = f1_score(y_test, y_pred)

print(f"準確率:{accuracy}")

print(f"精確度:{precision}")

print(f"召回率:{recall}")

print(f"F1分數:{f1}")在上面的示例中,我們首先加載了Iris數據集,并將其轉化為二元分類問題。然后,我們使用Logistic回歸模型進行訓練,并計算了準確率、精確度、召回率和F1分數來評估模型的性能。

4、案例研究

最后,讓我們來看一個實際的案例研究,演示了如何應用分類算法。假設我們有一個醫學數據集,其中包含患者的生物特征和疾病狀態。我們的任務是使用分類算法來預測患者是否患有某種疾病。

# 導入必要的庫

import numpy as np

from sklearn.model_selection import train_test_split

from sklearn.ensemble import RandomForestClassifier

from sklearn.metrics import accuracy_score

# 準備醫學數據集

data, labels = prepare_medical_dataset()

# 劃分數據集為訓練集和測試集

X_train, X_test, y_train, y_test = train_test_split(data, labels, test_size=0.2, random_state=42)

# 構建隨機森林分類器

clf = RandomForestClassifier()

# 訓練分類器

clf.fit(X_train, y_train)

# 進行預測

y_pred = clf.predict(X_test)

# 計算準確率

accuracy = accuracy_score(y_test, y_pred)

print(f"模型準確率:{accuracy}")在這個案例中,我們首先準備了醫學數據集,然后使用Scikit-Learn構建了一個隨機森林分類器。最后,我們使用測試集進行預測,并計算了模型的準確率。

總結

分類算法是數據分析的重要組成部分,它可以用于解決各種問題。本文介紹了分類算法的基本概念、Python中的應用以及進階技巧。

通過學習和實踐,可以更好地掌握分類算法,提高數據分析的能力和水平。