全世界機器人共用一個大腦,谷歌DeepMind已經(jīng)完成了第一步

過去一年,生成式人工智能發(fā)展的核心關鍵詞,就是「大」。

人們逐漸接受了強化學習先驅 Rich Sutton 充分利用算力「大力出奇跡」的思潮,龐大的數(shù)據(jù)量是 AI 模型展現(xiàn)出驚人智慧的核心原因。數(shù)據(jù)規(guī)模越大、質(zhì)量越高、標注越細,模型就能了解到更全面的世界知識,從而擬合出更加智能的結果。

那么,為什么人工智能的進展還沒有轉化成科幻片中那種全能管家機器人呢?能清理桌子、疊衣服、做早餐的機器人在哪里?

一個重要的原因是機器人領域很難「大力出奇跡」,生成式 AI 的文字或圖片訓練數(shù)據(jù)在網(wǎng)絡上就能輕松獲取,而機器人的訓練數(shù)據(jù)通常是由研究人員在實驗室里根據(jù)具體的任務一個一個地創(chuàng)建的。這個過程往往漫長而又乏味。

如果沒有大量數(shù)據(jù)的支撐,機器人將無法脫離實驗室,無法獨立執(zhí)行做早餐等任務。令人驚艷的機器人研究成果,往往也只是某一個實驗室研發(fā)出來的某一款機器人在執(zhí)行某幾項任務,對于其他實驗室的機器人研究,可參考性有限。

特斯拉機器人 Optimus 在遠程操控下疊衣服。

如果有一個匯集了許多機器人經(jīng)驗的「課本」,新機器人可以從中一次性學習,讓機器人共享訓練數(shù)據(jù)。這種做法是否能突破手動讓機器人執(zhí)行新任務帶來的時間與精力限制?

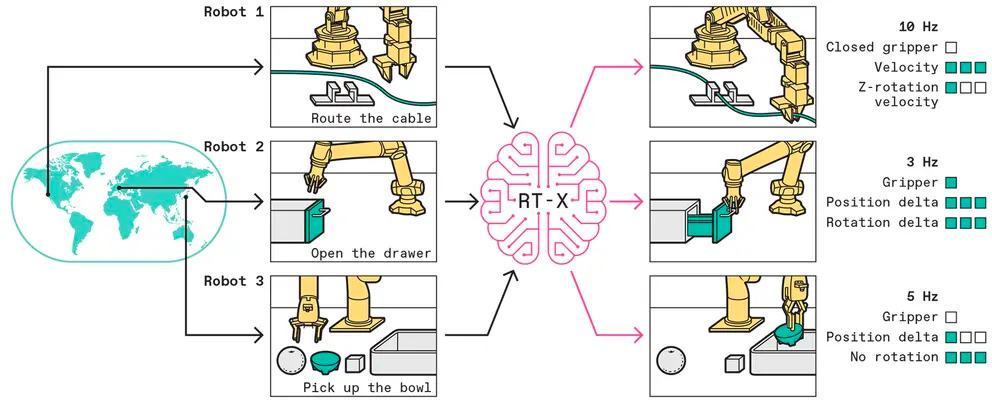

為了得到問題的答案,由谷歌 Deepmind 發(fā)起,來自北美、歐洲、亞洲的 34 個機器人實驗室共同啟動了 RT-X 項目。RT-X 項目的目標是匯集數(shù)據(jù)、資源和代碼,讓通用機器人走進現(xiàn)實。該項目的主要參與者加州大學伯克利分校的 Sergey Levine 教授和 Google DeepMind 的資深科學家 Karol Hausman 聯(lián)合撰寫了「THE GLOBAL PROJECT TO MAKE A GENERAL ROBOTIC BRAIN(打造通用機器人大腦的全球合作項目)」一文,總結了 RT-X 項目取得的進展。

RT-X 項目至今都做了哪些努力,讓我們一起來看看。

造通用機器人,要從哪方面下手?

人類擁有強大的學習能力。我們的大腦在經(jīng)過一點練習后,就可以指揮四肢行動,比如拿起工具、騎自行車或上車這種動作。換句話說,也就是我們的軀體發(fā)生了一些變化,但大腦能夠理解。RT-X 的目標是讓機器人也擁有這種「思維方式」:使單個深度神經(jīng)網(wǎng)絡能夠控制許多不同類型的機器人。這種能力稱為「交叉體現(xiàn)」。

然而「交叉體現(xiàn)」的問題在于,經(jīng)過機器人數(shù)據(jù)訓練的深度神經(jīng)網(wǎng)絡能否「駕馭」各種各樣的機器人。一旦這些外觀、物理特性和能力截然不同的機器人能被單個神經(jīng)網(wǎng)絡「大一統(tǒng)」,那么將釋放出大型數(shù)據(jù)集對機器人學習的潛力。

RT-X 項目發(fā)布的 Open X-Embodiment 數(shù)據(jù)集規(guī)模龐大,目前它含有 22 種機器人的近 100 萬次試驗數(shù)據(jù),其中包括市場上常用的機器臂。像拾取和放置物體、組裝以及電纜布線這種專項任務的數(shù)據(jù)也都包含在其中,共有約 500 種不同的操作和數(shù)千種與其他物體的互動數(shù)據(jù)。Open X-Embodiment 是目前最大的真實機器人動作開源數(shù)據(jù)集。

一個驚喜的發(fā)現(xiàn)是,大模型從大型數(shù)據(jù)集學習的思路也適用于機器人領域。使用相對簡單的機器學習方法,利用與當前 LLM(如 ChatGPT)相同的模型,研究者能夠根據(jù) Open X-Embodiment 數(shù)據(jù)集訓練普遍的機器人控制算法。就像一個人可以通過大腦學習開車或騎自行車一樣,在 Open X-Embodiment 數(shù)據(jù)集上訓練的模型可以簡單地通過機器人自帶的攝像頭識別模型所控制的機器人類型。例如攝像頭識別出的是 UR10 工業(yè)臂,模型將發(fā)送適合 UR10 的命令。如果識別出的是低成本的 WidowX hobbyiest 機械臂,模型也會相應地調(diào)整指令。

谷歌基于 Open X-Embodiment 數(shù)據(jù)集訓練出來了 RT-X 模型。為了測試「機器人大模型」的能力,參與 RT-X 項目的五個實驗室分別對其進行了測試。他們將 RT-X 的訓練結果與各自獨立開發(fā)的最佳控制系統(tǒng)進行了比較。每個實驗室的測試項目都涉及其機器人原本的研究任務,如拾取和移動物體、開門和通過夾子布線等。值得注意的是,統(tǒng)一的「大模型」超越了各個實驗室的最佳方法,使機器人完成任務的平均成功率提高了約 50%。

更驚人的發(fā)現(xiàn)是,如下列動圖所示,RT-X 模型可以運用其他機器人的經(jīng)驗來提高不同環(huán)境中正在被訓練的機器人的魯棒性。

在同一個實驗室中,即使機器人在執(zhí)行相同的任務,環(huán)境稍微不同,它也有可能無法成功完成同一動作。怪不得馬斯克要強調(diào)在換了衣服、盒子和桌子和之后,特斯拉 Optimus 在未來肯定能學會疊衣服呢。

因此,能夠借鑒其他機器人在其他情況下的經(jīng)驗有助 RT-X 模型控制的機器人應對變化和特殊情況。

搭建可以自主推理的機器人

受到以上成果的鼓舞,谷歌 DeepMind 的研究團隊繼續(xù)研究了如何如何將這些數(shù)據(jù)整合到一個具有更加深入的推理能力的系統(tǒng)中。僅從機器人數(shù)據(jù)中很難學習到復雜的語義推理。如「在罐子和橘子之間移動蘋果」這個復雜任務,需要機器人理解圖像中物體之間的語義關系、基本常識還有其他與物理能力不直接相關的符號知識等等。

為了解決復雜語義推理的問題,研究人員決定加入另一個龐大的數(shù)據(jù)源:全網(wǎng)的圖像和文本數(shù)據(jù)。他們使用了一個現(xiàn)有的大型視覺語言模型,該模型已經(jīng)精通許多需要理解自然語言和圖像之間聯(lián)系的任務。它是一個類似 ChatGPT 或 Bard 這樣公開可用的模型。這個模型可以根據(jù)圖片輸入做出回答,能夠解決視覺問答、字幕以及其他開放式視覺理解任務之類的問題。

研究團隊發(fā)現(xiàn),經(jīng)過訓練,生成式 AI 模型也能輸出機器人動作以響應機器人命令(如「把香蕉放在盤子上」),機器人繼而根據(jù)命令執(zhí)行動作。基于這些發(fā)現(xiàn),谷歌 DeepMind 研究團隊將這種方法應用到 Open X-Embodiment 數(shù)據(jù)集中。

為了評估從互聯(lián)網(wǎng)獲取的智能和來自全世界的機器人數(shù)據(jù)的結合情況,谷歌 DeepMind 用他們的移動機械臂對 RT-X 模型進行了測試。研究人員對它進行了最嚴格的通用化基準測試。這要求機器人掌握識別物體、成功操縱物體、根據(jù)復雜的文本命令、整合文本和圖像信息、進行邏輯推理等能力。這種能力正是人類成為通才的原因之一。

研究人員進行了兩組評估。他們使用了一個不涉及谷歌的機器人、不包括多機器人數(shù)據(jù)的模型作為基準。事實上,由于 Open X-Embodiment 數(shù)據(jù)集中有超過 10 萬次演示來自谷歌 DeepMind 的機器人,數(shù)據(jù)集中其他機器人數(shù)據(jù)是否起效,這個問題的答案仍然未知。因此,他們又嘗試了基于 Open X-Embodiment 整體數(shù)據(jù)的評估。

對谷歌機器臂而言,「將蘋果移到易拉罐和橘子之間」是最難的評估任務之一。這是一項涉及空間關系推理的任務。在「將一個物體放在寫著解為 2+3 的紙上」這項任務中,它還需要解數(shù)學題。這些挑戰(zhàn)旨在測試 RT-X 模型賦予機器臂的推理以及得出結論的能力。

在這種情況下,機器臂推理能力(例如推理出 「之間 」和 「上面 」的含義)來自于視覺語言模型訓練中的全網(wǎng)數(shù)據(jù),而將推理輸出應用于機器人行為的能力(即使機器臂向正確方向移動的命令)來自 RT-X 對機器人數(shù)據(jù)的訓練。下面的視頻展示了一個評估實例,研究團隊要求機器人執(zhí)行一項未包含在訓練數(shù)據(jù)中的任務。

即使沒有經(jīng)過專門訓練,谷歌的機器臂也能夠遵循指令「在罐子和橘子之間移動蘋果」。這種能力是由 RT-X 實現(xiàn)的,這是邁向通用機器人大腦的第一步。

雖然這些任務對人類來說可能不值一提,但對通用機器人來說卻是一大難題。如果沒有具體的機器人演示數(shù)據(jù)清楚地說明「之間」、「附近」和「上面」是什么意思,即使共享了機器人的訓練數(shù)據(jù),基于此的系統(tǒng)也無法弄清楚這些命令的含義。

通過整合視覺語言模型中的全網(wǎng)知識,RT-X 的完整系統(tǒng)為機器人研究解決了很多問題。研究團隊發(fā)現(xiàn)共享機器人數(shù)據(jù)的加入使谷歌機器人的泛化能力提高了三倍。這表明,Open X-Embodiment 數(shù)據(jù)集不僅有助于機器人獲得各種物理技能,還有助于更好地讓與物理動作與視覺語言模型中的語義和符號知識聯(lián)系起來。這些聯(lián)系使得機器人具備了一定的常識。有朝一日,機器人能夠基于這些方法理解「給我拿早餐」這種復雜和微妙的命令,并為你端上一份熱乎乎的早飯。

RT-X 項目的下一步

RT-X 項目展示了機器人社區(qū)凝心聚力之后取得的巨大進展。得益于跨地區(qū)、跨機構的努力,谷歌 DeepMind 匯集了多樣化的機器人數(shù)據(jù)集,進行了全面的多機器人評估。此前,這對于任何單一機構都是不可能做到的事。RT-X 的發(fā)起者希望能有更多的研究人員入這項合作,分享他們的數(shù)據(jù)。他們還將開發(fā)工具、模型和基礎設施來支持具身智能研究。

就像大型語言模型已經(jīng)掌握了廣泛的基于語言的任務一樣,RT-X 項目目前的進展已經(jīng)提供了一種大型具身機器人模型改變機器人領域的可能性。在未來,谷歌 DeepMind 將會使用相同的基礎模型作為許多現(xiàn)實中的機器人做任務的基礎。也許有一天,只通過微調(diào),甚至只向預訓練的基礎模型輸入提示,機器人就能獲得新技能。你可以像使用 ChatGPT 一樣,無需告訴機器人如何使用裱花袋或要寫什么字體,機器人就能在一個蛋糕上做「生日快樂」的裱花。

隨著越來越多的實驗室參與 RT-X 項目,谷歌 DeepMind 希望進一步推進單個神經(jīng)網(wǎng)絡控制多臺機器人的可能。未來他們可能將添加生成的各種模擬數(shù)據(jù),加入更多種類的機器人(例如有不同數(shù)量的手臂或手指的機器人),引入不同的傳感器套件(如深度相機和觸覺傳感器),結合操縱和運動行為等。

也許在未來,通用化的機器人大腦可以驅動任何機器人,全球所有機器人都可以從共享的數(shù)據(jù)中受益。