Sora爆紅視頻幕后:被騙了,用了成噸的后期才有這效果

今年 2 月份,OpenAI 發布了人工智能文生視頻大模型 Sora,并放出了第一批視頻片段,掀起了 AI 生成視頻浪潮。目前,Sora 仍未進行公測,只有一些視覺藝術家、設計師、電影制作人等獲得了 Sora 的訪問權限。他們發布了一些 Sora 生成的視頻短片,其連貫、逼真的生成效果令人驚艷。

最近,被譽為「朋克搖滾皮克斯」的加拿大多媒體制作公司 Shy Kids 發布了一段借助 Sora 制作的視頻短片《Air Head》,在社交媒體上迅速引起廣泛關注。

據悉,這部制作精美的短片主要由 3 個人完成,花費不到 2 周的時間。其中,Sidney Leeder 擔任制片人,Walter Woodman 擔任編劇和導演,而 Patrick Cederberg 負責后期制作。

本周,知名視覺特效總監 Mike Seymour 采訪了 Patrick Cederberg,就《Air Head》制作過程、技術難點等信息展開了提問,并在 fxguide 上發布一篇文章介紹了 Sora 在視頻實際制作過程中發揮的作用和存在的問題。

Patrick Cederberg

其中,Patrick 表示:「Sora 是一款非常強大的工具,我們已經在思考如何把它融入現有電影制作流程中,但目前 Sora 仍處于測試階段,在影片制作過程中也會『翻車』。例如,氣球的顏色在每次生成中都會改變、鏡頭中會出現一些瑕疵等等,要想獲得最佳表現效果,仍需大量后期制作。」

AI 生成視頻并非僅僅是圖像生成器的進階版。更準確地說,它們可能是我們向通用人工智能(AGI) 邁出的重要一步。但正如 Sora 開發團隊本周接受采訪時所說的,當前的 AI 視頻模型仍處于早期階段。

OpenAI 研究科學家,Sora 項目領導者 Tim Brooks 表示:我覺得現在 Sora 位置,就像是視覺模型新范式的 GPT-1 階段。

《Air Head》是如何完成的?機器之心對 Mike Seymour 的文章進行了不改變原意的編譯、整理,以下是該文章原文:

用戶界面(UI)

Sora 的用戶界面允許用戶輸入一段文本 prompt,然后 ChatGPT 將其轉換為一個更長的字符串,再觸發視頻片段的生成。目前,沒有其他輸入方式 —— 還沒有實現多模態輸入。這一點很重要,因為盡管 Sora 因其生成結果中的對象一致性而受到稱贊,但目前還沒有任何方法來幫助匹配兩個鏡頭(即兩次生成)的內容。即使第二次運行相同的 prompt,生成結果也會不同。

Patrick 介紹說:「我們盡可能做到的是在我們的 prompt 中給出超級詳細的描述,例如解釋角色的服裝、氣球的類型。這是我們獲得一致性的方法。從一個鏡頭到另一個鏡頭 / 一次生成到下一次生成,還沒有完全控制一致性的方法。」

單個視頻片段的確可以展現 Sora 令人驚嘆的技術,但使用這些片段取決于你對隱式或顯式鏡頭生成的理解。

假設你要求 Sora 在廚房里進行一個長鏡頭跟蹤拍攝,桌子上有一個香蕉。在這種情況下,它將依賴其對「香蕉屬性」的隱式理解來生成一個展示香蕉的視頻。通過訓練,Sora 已經學習了一些香蕉屬性:比如「黃色」、「彎曲」、「有深色的末端」等等。沒有香蕉的實際記錄圖像。沒有「香蕉數據庫」,而是有一個更小的、壓縮的、隱藏的「潛在空間」,描述了香蕉是什么,每次運行都會展示對潛在空間的一種新解釋。你的 prompt 依賴于對香蕉屬性的隱式理解。

制作角色

為了制作《Air Head》,團隊根據大致的劇本生成了多個視頻片段,但是沒有明確的方式來確保黃色氣球頭在每個鏡頭中都保持相同。有時,當 prompt 要一個黃色氣球時,生成結果甚至可能不是黃色的。有時,氣球上可能嵌入了一張臉,或者似乎在氣球的正面畫了一張臉。由于現實生活中許多氣球都有繩子,因此生成結果中稱為 Sonny 的氣球人經常會在衣服前襟處有一根繩子。這是因為 Sora 隱式地將繩子與氣球聯系起來,因此在后期制作中這些需要被移除。

分辨率

《Air Head》只使用了 Sora 生成的鏡頭,但其中很多鏡頭都經過了調色、處理和穩定化,所有鏡頭都被提高了分辨率。團隊處理的這些片段最初是以較低分辨率生成的,然后使用 Sora 或 OpenAI 之外的 AI 工具進行超分。

「你可以采用 720p 的分辨率,我相信已經有 1080p 了,但它需要一段時間來渲染。為了速度,《Air Head》的所有鏡頭都是以 480p 制作的,然后使用 Topaz 來提高分辨率」,Patrick 介紹道。

在關鍵幀方面,Patrick 解釋道:「在實際生成中,不同動作的發生有一點時間控制,但并不精確,甚至有點像是碰運氣 —— 目前還不確定 Sora 是否真的能完成這一點。」不過,Shy Kids 使用的是最早版本的模型,Sora 仍在不斷開發中。

除了選擇分辨率,Sora 還允許用戶選擇長寬比,比如肖像模式或風景模式(或正方形)。這在從 Sonny 的牛仔褲向上搖攝到他的氣球頭的鏡頭中非常有用。遺憾的是,Sora 無法原生渲染這樣的移動,總是希望鏡頭的主要焦點 —— 氣球頭出現在鏡頭中。因此,團隊以肖像模式渲染了這個鏡頭,然后通過后期的裁剪手動創建了向上搖攝的效果。

攝像機方向

對于許多生成式 AI 工具來說,訓練數據附帶的元數據是寶貴的信息來源,比如攝像機元數據。例如,如果在靜態照片上進行訓練,攝像機元數據將提供鏡頭尺寸、光圈值以及其他許多對模型訓練至關重要的信息。

在電影鏡頭中,「跟蹤」、「平搖」、「豎搖」、「推進」等概念都不是元數據所能捕捉的術語或概念。

描述鏡頭對影片制作來說非常重要,Patrick 指出:「最初 Sora 中并沒有這個功能。不同的人描述電影鏡頭的方法也不同。OpenAI 的研究人員在藝術家使用這個工具之前,并沒有真正像電影制作人那樣思考。」

Shy Kids 知道他們使用的是 Sora 早期版本,但「初始版本的 Sora 在攝像機角度方面有點隨機。」Sora 是否真的能理解 prompt 還不得而知,OpenAI 的研究人員只是專注于視覺生成,或許不考慮故事講述者將如何使用它。

「Sora 正在改進,生成控制還沒有完全到位。輸入一個『攝像機搖攝』,我認為十次中有六次會得到想要的結果」,Patrick 說道。

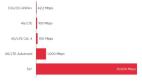

這不是一個個例問題,幾乎所有 AI 視頻生成公司都面臨著同樣的問題,Runway AI 可能是在提供描述攝像機運動方面最先進的,但 Runway 渲染片段的質量和長度都不如 Sora。

渲染時間

視頻片段可以以不同長度的時間段進行渲染,如 3 秒、5 秒、10 秒、20 秒,最長可達一分鐘。渲染時間取決于一天中的時間段(例如早、中、晚)以及云服務的需求量。

Patrick 介紹:「一般來說,每次渲染大約需要 10 到 20 分鐘。根據我的經驗,我選擇的渲染時長對渲染時間的影響很小。如果渲染時長是 3 到 20 秒,渲染時間往往不會在 10 到 20 分鐘的范圍內變化太大。」

雖然所有畫面都是 Sora 生成的,但《Air Head》仍然需要大量后期工作。例如,有時會有一張臉在氣球人 Sonny 上,就好像是用記號筆畫上去的,這些瑕疵將在后期工作中被移除。

原始素材 vs 最終成品 ——300:1

Shy Kids 的方法是像制作紀錄片一樣進行后期制作和編輯,即有很多鏡頭,你需要從這些素材中編織出一個故事,而不是嚴格按照劇本拍攝。雖然這部短片有一個劇本,但團隊需要靈活適應。

「這就像是得到一大堆鏡頭,然后嘗試以一種有趣的方式剪輯到旁白中」,Patrick 介紹道。

對于最終出現在影片中的 90 秒鏡頭,Patrick 估計他們生成了「數百個 10 到 20 秒的片段」。他補充說:「我猜原始素材和最終成品的比例大概是 300:1。」

奇怪的「慢動作」

《Air Head》的許多片段生成時就好像是以慢動作拍攝的,盡管這并沒有在 prompt 中被要求。這種情況發生的原因尚不清楚,但許多片段因此需要重新調整時間,以使其看起來像是實時拍攝的。這似乎與訓練數據有關。

值得一提的是,Shy Kids 在他們的 prompt 中使用了「35 mm film(35 毫米膠片)」這個關鍵詞,并發現這在一定程度上給了他們所追求的一致性。

版權問題

OpenAI 試圖尊重版權,不允許生成可能侵犯版權或侵犯肖像權的內容。例如,如果用戶的 prompt 類似于「35 毫米膠片,在一個未來主義的太空船中,一個男人拿著光劍向前走」,Sora 將不允許生成該片段,因為它太接近《星球大戰》了。

Patrick 回憶說,當他們最初只是想測試 Sora 時:「我不假思索地輸入了『阿羅諾夫斯基類型的鏡頭』,然后就被告知不能這樣做。」Sora 出于版權問題會拒絕這類 prompt。

值得注意的是,Sora 生成的視頻都是沒有聲音的,《Air Head》中主角 Sonny 的聲音是 Patrick 本人的聲音。

Shy Kids 團隊表示已經開始為《Air Head》制作一部精彩的、人物有自我意識的、或許帶點諷刺意味的續集。但對于電影制作等實際項目來說,Sora 可能還需要一段時間才能達到創作者所需的精確度。