AIGC全新綜述!多模態(tài)引導(dǎo)的基于文生圖大模型的圖像編輯綜述

本文經(jīng)自動(dòng)駕駛之心公眾號(hào)授權(quán)轉(zhuǎn)載,轉(zhuǎn)載請(qǐng)聯(lián)系出處。

前言:

提出解決一般性編輯任務(wù)的統(tǒng)一框架!近期,復(fù)旦大學(xué)FVL實(shí)驗(yàn)室和南洋理工大學(xué)的研究人員對(duì)于多模態(tài)引導(dǎo)的基于文生圖大模型的圖像編輯算法進(jìn)行了總結(jié)和回顧。綜述涵蓋300多篇相關(guān)研究,調(diào)研的最新模型截止至今年6月!該綜述拓展了關(guān)于控制條件(自然語(yǔ)言,圖像,用戶接口)和編輯任務(wù)的討論 (物體/屬性操作、空間變換、inpainting、風(fēng)格轉(zhuǎn)換、圖像翻譯,主體/屬性客制化),以從更新穎和更一般性的角度全面的探討編輯方法。此外,該綜述提出的統(tǒng)一框架將編輯過(guò)程表示為不同算法族的組合,并通過(guò)全面的定性和定量實(shí)驗(yàn)來(lái)說(shuō)明各種組合的特性以及適應(yīng)場(chǎng)景。該框架提供了友好的設(shè)計(jì)空間以滿足用戶不同的需求,并為研究者們提供了一定的參考以開(kāi)發(fā)新的算法。

摘要:

圖像編輯旨在根據(jù)用戶的特定需求編輯給定的合成或真實(shí)圖像。作為人工智能生成內(nèi)容(AIGC)領(lǐng)域中一個(gè)有前景且具有挑戰(zhàn)性的領(lǐng)域,圖像編輯得到了廣泛研究。近期,大規(guī)模文生圖(T2I)擴(kuò)散模型驅(qū)動(dòng)了圖像編輯技術(shù)的發(fā)展。這些模型根據(jù)文本提示生成圖像,展示了驚人的生成能力,已成為圖像編輯的常用工具。基于T2I的圖像編輯方法顯著提升了編輯性能,為用戶提供了使用多模態(tài)條件引導(dǎo)進(jìn)行內(nèi)容修改的接口。我們對(duì)基于T2I擴(kuò)散模型的多模態(tài)引導(dǎo)下的圖像編輯技術(shù)進(jìn)行了全面回顧。首先,我們從更一般性的角度定義了圖像編輯任務(wù)的范圍,并詳細(xì)描述了各種控制信號(hào)和編輯場(chǎng)景。然后,我們提出了一個(gè)統(tǒng)一框架來(lái)形式化編輯過(guò)程,將其表示為兩個(gè)算法族的組合。這個(gè)框架為用戶提供了一個(gè)設(shè)計(jì)空間,以實(shí)現(xiàn)特定目標(biāo)。接著,我們對(duì)該框架內(nèi)的每個(gè)組件進(jìn)行了深入分析,研究了不同組合的特性和適用場(chǎng)景。由于基于訓(xùn)練的方法直接學(xué)習(xí)將源圖像映射到目標(biāo)圖像,我們對(duì)這些方法進(jìn)行了單獨(dú)討論,并介紹了不同場(chǎng)景下源圖像的注入方案。此外,我們也回顧了2D技術(shù)在視頻編輯中的應(yīng)用,重點(diǎn)介紹了解決幀間不一致性的問(wèn)題。最后,我們也討論了該領(lǐng)域的開(kāi)放性挑戰(zhàn),并提出了潛在的未來(lái)研究方向。

論文和開(kāi)源倉(cāng)庫(kù)的地址:

論文題目:A Survey of Multimodal-Guided Image Editing with Text-to-Image Diffusion Models

發(fā)表單位:復(fù)旦大學(xué)FVL實(shí)驗(yàn)室,南洋理工大學(xué)

論文地址:https://arxiv.org/abs/2406.14555

項(xiàng)目地址:https://github.com/xinchengshuai/Awesome-Image-Editing

1.研究動(dòng)機(jī)

1.1,在現(xiàn)實(shí)生活中,人們對(duì)于可控的、高質(zhì)量的智能化圖像編輯工具的需求日益增加,因此有必要系統(tǒng)地總結(jié)與對(duì)比下這個(gè)方向的方法與技術(shù)特點(diǎn)。

1.2,當(dāng)前的編輯算法與相關(guān)的綜述都將編輯場(chǎng)景局限于保留圖像中的大部分與編輯無(wú)關(guān)的低級(jí)語(yǔ)義信息,為此要必要擴(kuò)展編輯任務(wù)的范圍,從更具有一般性的視角討論編輯任務(wù)。

1.3,由于需求和場(chǎng)景具有多樣性,有必要將編輯過(guò)程形式化為一個(gè)統(tǒng)一框架,并為用戶提供一個(gè)設(shè)計(jì)空間來(lái)適應(yīng)不同的編輯目標(biāo)。

2.這篇綜述的特色,以及與當(dāng)前的編輯綜述有什么區(qū)別?

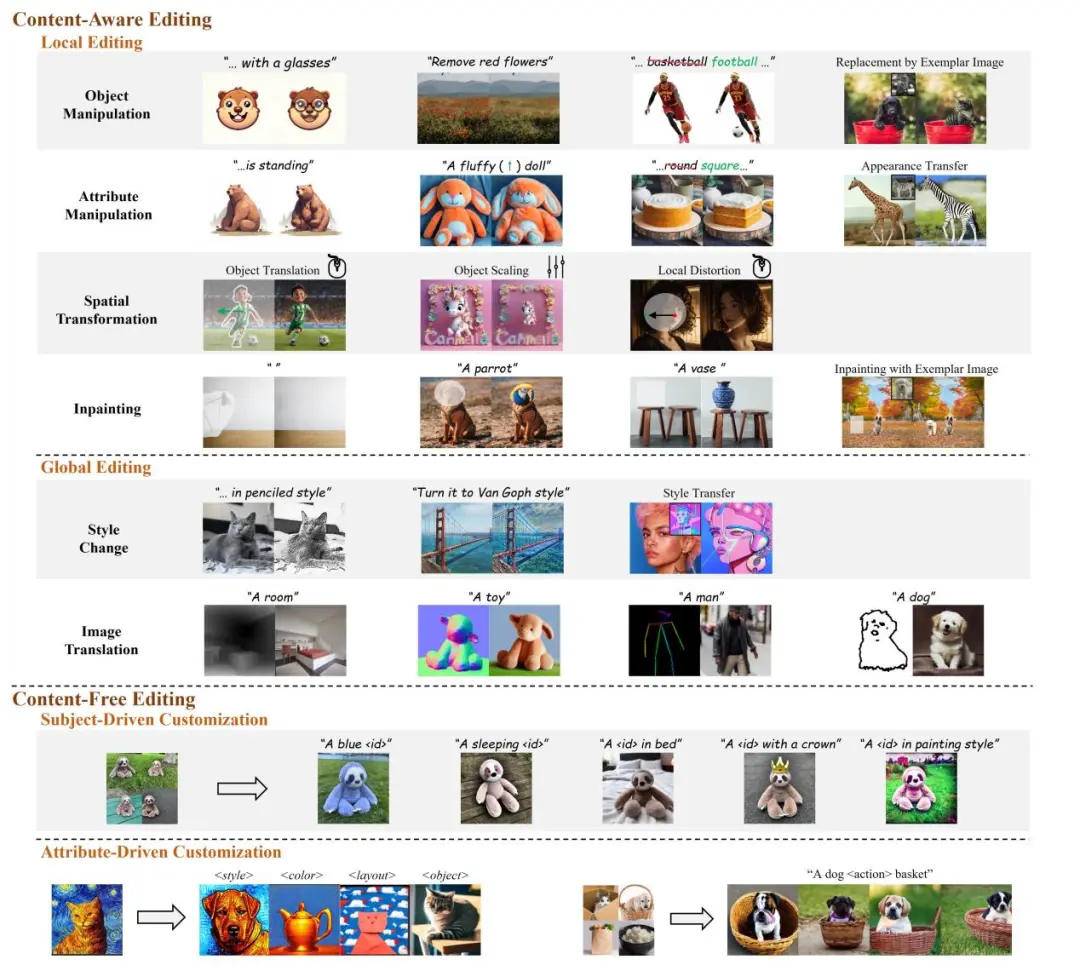

2.1 關(guān)于編輯任務(wù)的定義與討論范圍。相比于現(xiàn)有的算法以及前人的編輯綜述,本文對(duì)于圖像編輯任務(wù)的定義更加廣泛。具體的,本文將編輯任務(wù)分為content-aware 和content-free場(chǎng)景組。其中content-aware組內(nèi)的場(chǎng)景為之前的文獻(xiàn)所討論的主要任務(wù),它們的共性是保留圖像中的一些低級(jí)語(yǔ)義特征,如編輯無(wú)關(guān)區(qū)域的像素內(nèi)容,或圖像結(jié)構(gòu)。此外,我們開(kāi)創(chuàng)性地將客制化任務(wù)(customization)納入到content-free場(chǎng)景組中,將這一類保留高級(jí)語(yǔ)義(如主體身份信息,或者其他細(xì)粒度屬性)的任務(wù)作為對(duì)常規(guī)的編輯場(chǎng)景的補(bǔ)充。

圖1. Survey討論的各種編輯場(chǎng)景

2.2 一般性編輯算法的統(tǒng)一框架。由于編輯場(chǎng)景的多樣性,現(xiàn)有的算法無(wú)法很好的解決所有的需求。因我們將現(xiàn)有的編輯過(guò)程形式化為一個(gè)統(tǒng)一的框架,將其表示為兩個(gè)算法族的組合。此外我們也通過(guò)定性和定量實(shí)驗(yàn)分析了不同組合的特性與適應(yīng)場(chǎng)景,為用戶提供了一個(gè)良好的設(shè)計(jì)空間以適應(yīng)不同的編輯目標(biāo)。同時(shí),該框架也為研究者們提供了一個(gè)較好的參考,以設(shè)計(jì)出性能更優(yōu)的算法。

2.3 討論的全面性。我們調(diào)研了300多篇的相關(guān)論文,系統(tǒng)且全面地闡述了各種模態(tài)的控制信號(hào)在不同場(chǎng)景下的應(yīng)用。對(duì)于基于訓(xùn)練的編輯方法,本文也提供了在各種場(chǎng)景下源圖像注入到T2I模型的策略。此外,我們也探討了圖像編輯技術(shù)在視頻領(lǐng)域的應(yīng)用,使得讀者能夠快速的理解不同領(lǐng)域間編輯算法的聯(lián)系。

3.一般性編輯算法的統(tǒng)一框架:

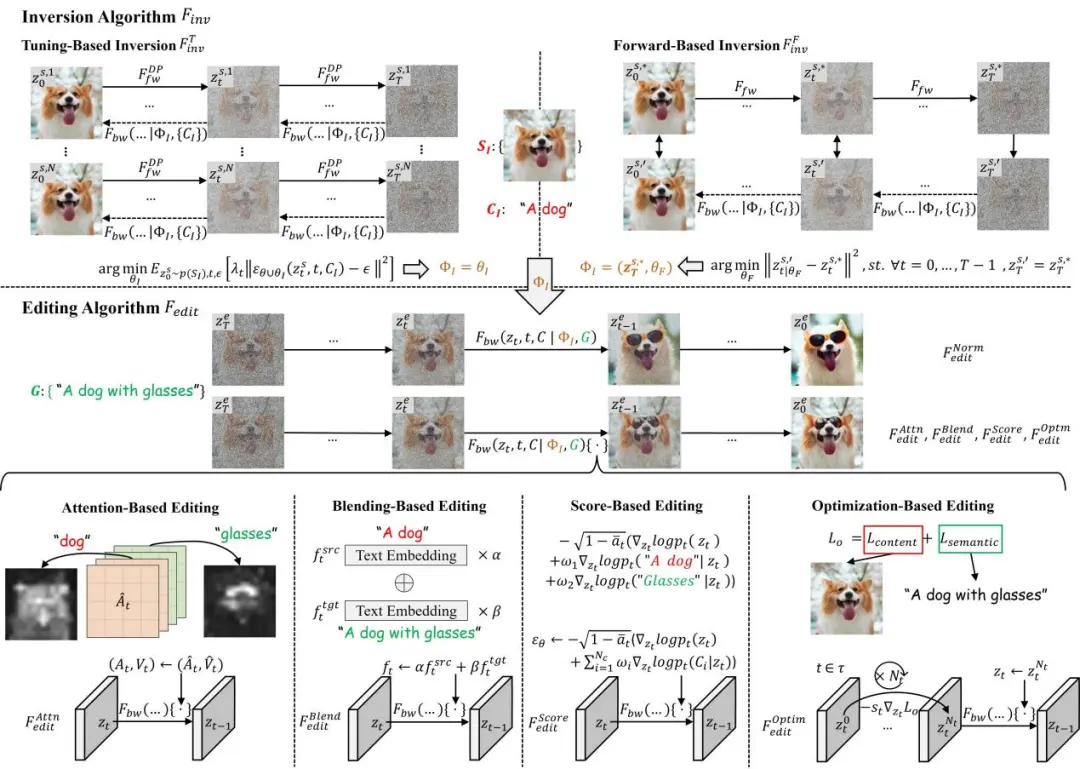

圖2. 一般性編輯算法的統(tǒng)一框架

框架包含了兩個(gè)算法族Inversion算法 和Editing 算法

和Editing 算法 。

。

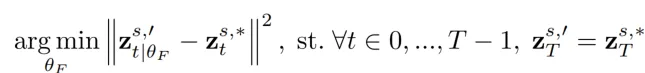

3.1 Inversion算法。Inversion 算法 將源圖像集合

將源圖像集合 編碼到特定的特征或參數(shù)空間,得到對(duì)應(yīng)的表征

編碼到特定的特征或參數(shù)空間,得到對(duì)應(yīng)的表征 (inversion clue),并用對(duì)應(yīng)的源文本描述

(inversion clue),并用對(duì)應(yīng)的源文本描述 作為源圖像的標(biāo)識(shí)符。包括tuning-based

作為源圖像的標(biāo)識(shí)符。包括tuning-based 和forward-based

和forward-based 兩種類型的inversion算法。其可以被形式化為:

兩種類型的inversion算法。其可以被形式化為:

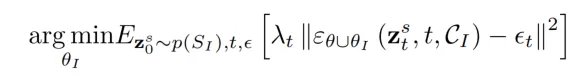

Tuning-based inversion 通過(guò)原有的diffusion訓(xùn)練過(guò)程將源圖像集合植入到擴(kuò)散模型的生成分布中。形式化過(guò)程為:

通過(guò)原有的diffusion訓(xùn)練過(guò)程將源圖像集合植入到擴(kuò)散模型的生成分布中。形式化過(guò)程為:

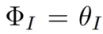

其中 為引入的可學(xué)習(xí)的參數(shù),且

為引入的可學(xué)習(xí)的參數(shù),且 。

。

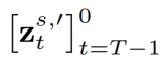

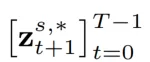

Forward-based inversion 用于在擴(kuò)散模型的反向過(guò)程中(

用于在擴(kuò)散模型的反向過(guò)程中( )還原某一條前向路徑中的噪聲(

)還原某一條前向路徑中的噪聲( )。形式化過(guò)程為:

)。形式化過(guò)程為:

其中 為方法中引入的參數(shù),用于最小化

為方法中引入的參數(shù),用于最小化 。在這種方法中,

。在這種方法中, 。

。

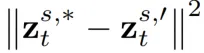

3.2.Editing 算法。Editing算法 根據(jù)

根據(jù) 和多模態(tài)引導(dǎo)集合

和多模態(tài)引導(dǎo)集合 來(lái)生成最終的編輯結(jié)果

來(lái)生成最終的編輯結(jié)果 。包含attention-based

。包含attention-based ,blending-based

,blending-based ,score-based

,score-based 以及optimization-based

以及optimization-based 的editing算法。其可以被形式化為:

的editing算法。其可以被形式化為:

特別地,對(duì)于每一步的反向過(guò)程, 進(jìn)行了如下操作:

進(jìn)行了如下操作:

其中 中的操作表示編輯算法對(duì)于擴(kuò)散模型采樣過(guò)程

中的操作表示編輯算法對(duì)于擴(kuò)散模型采樣過(guò)程 的干預(yù),用于保證編輯后的圖像

的干預(yù),用于保證編輯后的圖像 與源圖像集合

與源圖像集合 的一致性,并反應(yīng)出

的一致性,并反應(yīng)出 中引導(dǎo)條件所指明的視覺(jué)變換。

中引導(dǎo)條件所指明的視覺(jué)變換。

特別地,我們將無(wú)干預(yù)的編輯過(guò)程過(guò)程視作為普通版本的編輯算法 。其形式化為:

。其形式化為:

Attention-based editing 的形式化過(guò)程:

的形式化過(guò)程:

Blending-based editing 的形式化過(guò)程:

的形式化過(guò)程:

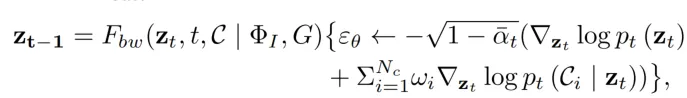

Score-based editing 的形式化過(guò)程:

的形式化過(guò)程:

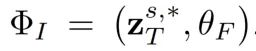

Optimization-based editing 的形式化過(guò)程:

的形式化過(guò)程:

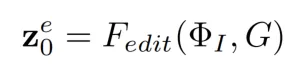

3.3 Training-Based 的編輯方法。與training-free的方法不同的是,training-based算法通過(guò)在任務(wù)特定的數(shù)據(jù)集中直接學(xué)習(xí)源圖像集合到編輯圖像的映射。這一類算法可以看作是tuning-based inversion的擴(kuò)展,即通過(guò)額外引入的參數(shù)將源圖像編碼到生成分布中。在這類算法中,最重要的是如何將源圖像注入到T2I模型中,以下是針對(duì)不同編輯場(chǎng)景的注入方案。

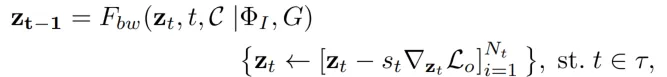

Content-aware 任務(wù)的注入方案:

圖3. Content-aware 任務(wù)的注入方案

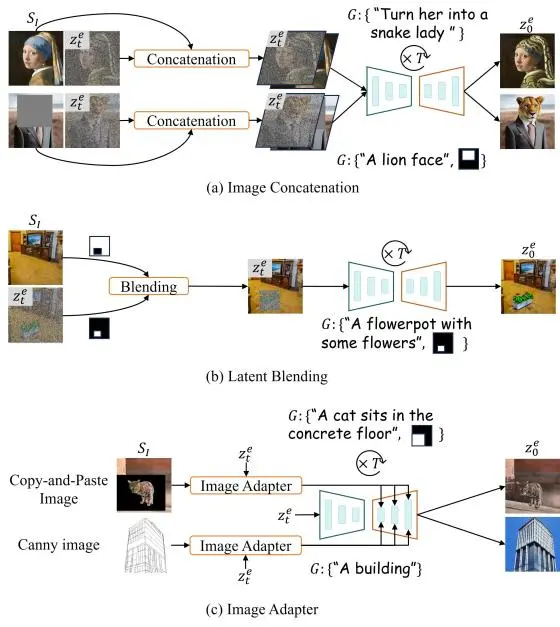

Content-free 任務(wù)的注入方案:

圖3. Content-free 任務(wù)的注入方案

4. 統(tǒng)一框架在多模態(tài)編輯任務(wù)中的應(yīng)用

本文通過(guò)定性實(shí)驗(yàn)說(shuō)明了各個(gè)組合在多模態(tài)編輯任務(wù)中的應(yīng)用:

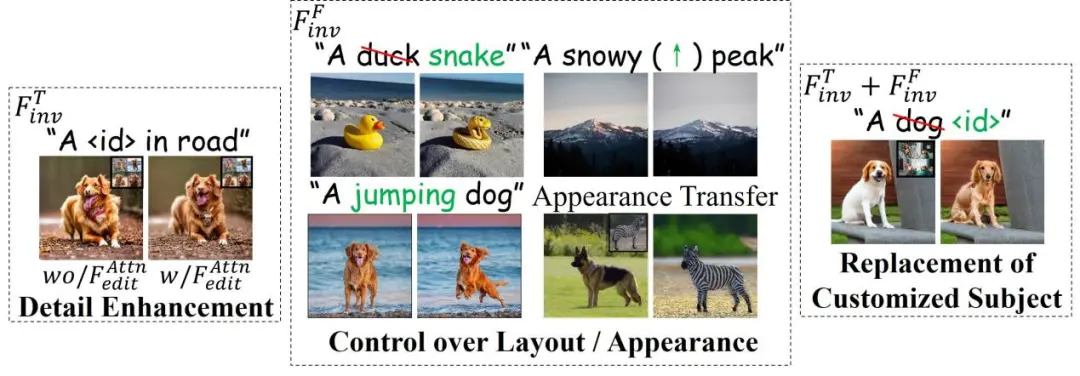

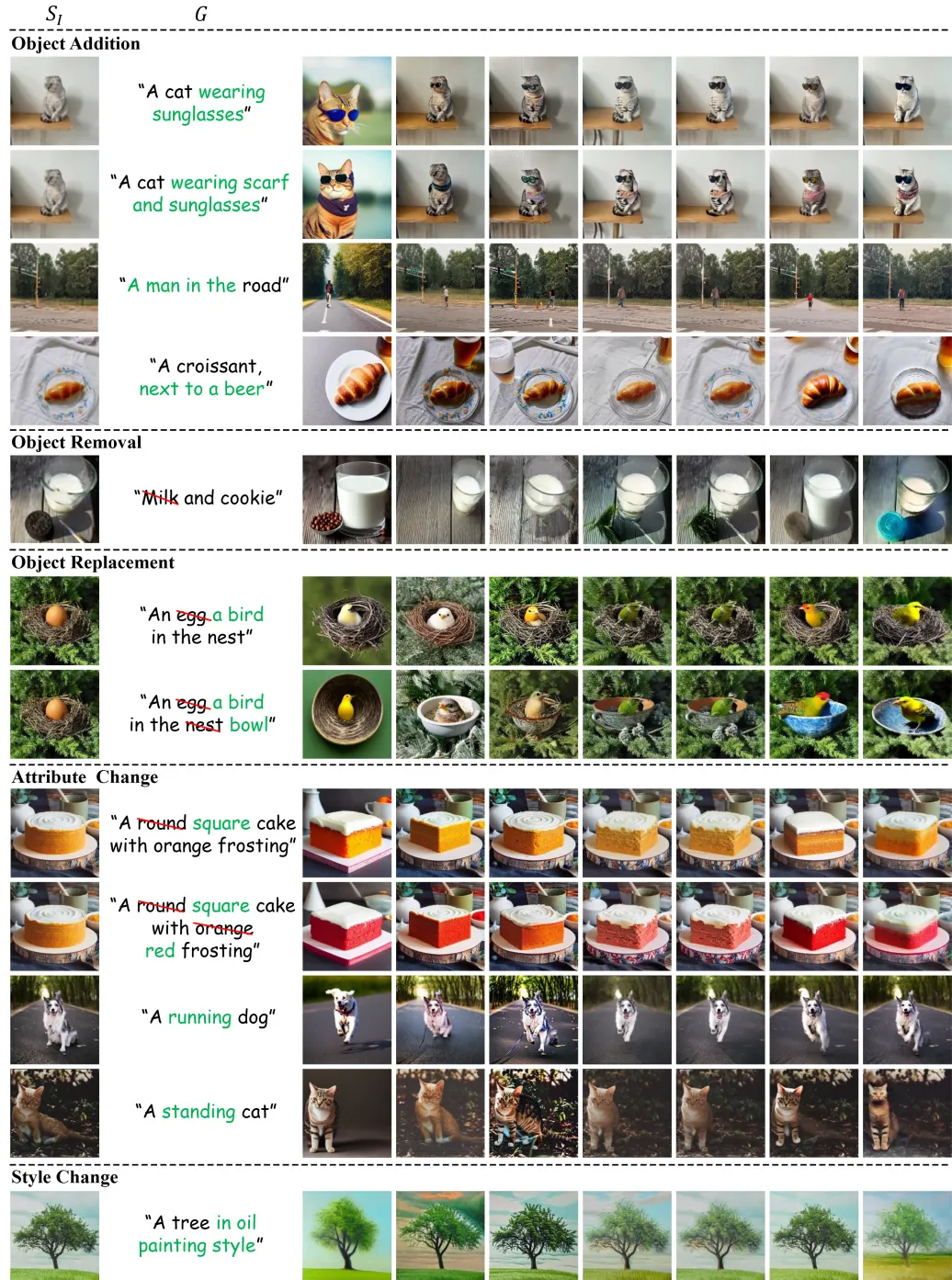

圖4. 關(guān)于attention-based editing 的算法組合的應(yīng)用

的算法組合的應(yīng)用

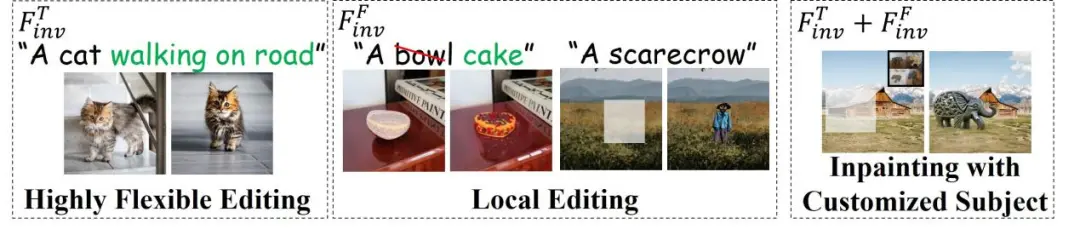

圖5. 關(guān)于blending-based editing 的算法組合的應(yīng)用

的算法組合的應(yīng)用

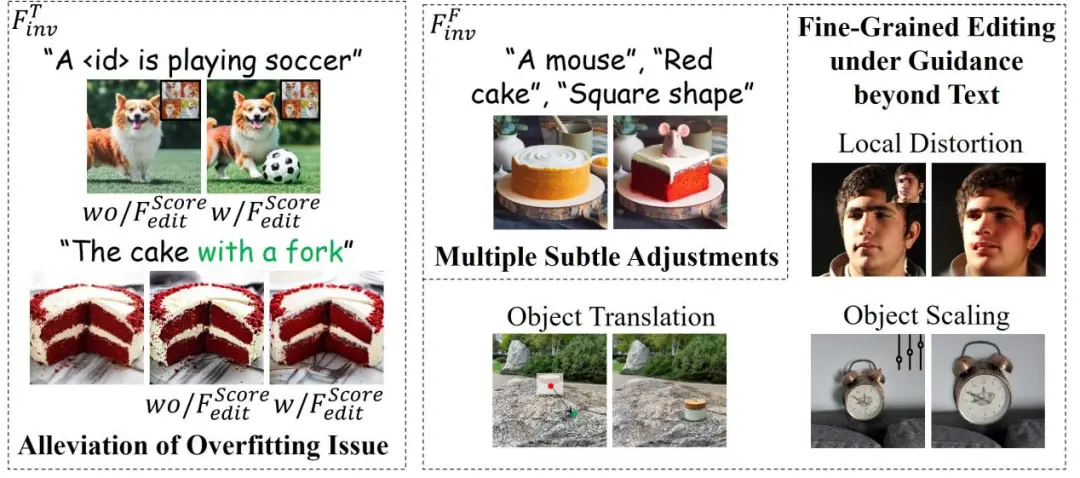

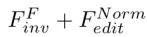

圖6. 關(guān)于score-based editing 的算法組合的應(yīng)用

的算法組合的應(yīng)用

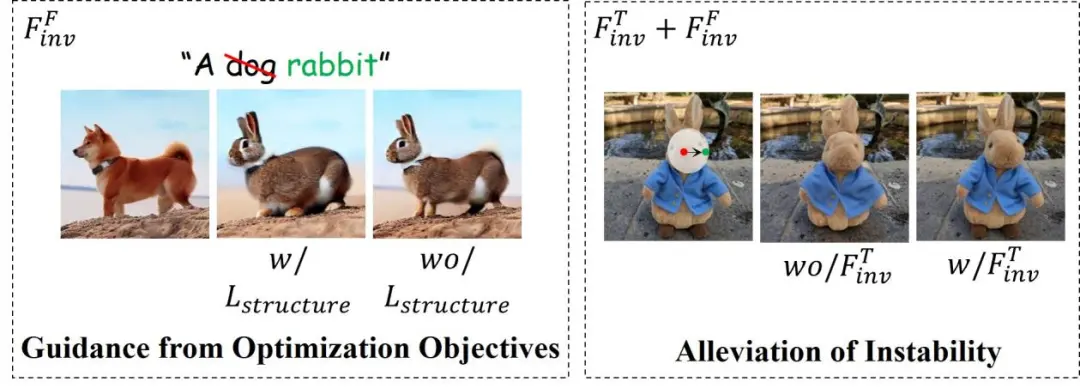

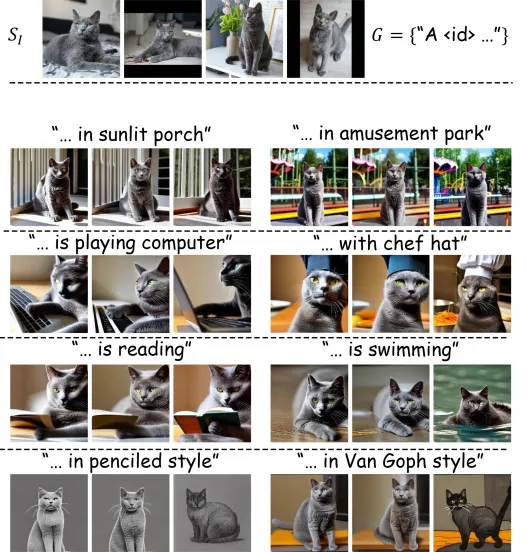

圖7. 關(guān)于optimization-based editing 的算法組合的應(yīng)用

的算法組合的應(yīng)用

具體的分析請(qǐng)查閱原始論文。

5.不同組合在文本引導(dǎo)的編輯場(chǎng)景下的比較

對(duì)于常見(jiàn)的文本引導(dǎo)的編輯任務(wù),本文通過(guò)設(shè)計(jì)了多個(gè)具有挑戰(zhàn)性的定性實(shí)驗(yàn),以說(shuō)明不同組合所適合的編輯場(chǎng)景。此外,本文也相應(yīng)地收集了高質(zhì)量和具有一定難度的數(shù)據(jù)集,以定量地說(shuō)明各種組合中的先進(jìn)算法在不同場(chǎng)景下的性能。

對(duì)于 content-aware任務(wù),我們主要考慮對(duì)象操作(增/刪/替換),屬性改變,風(fēng)格遷移。特別地,我們考慮了具有挑戰(zhàn)性的實(shí)驗(yàn)設(shè)置:1.多目標(biāo)編輯。2.對(duì)于圖像的語(yǔ)義布局影響較大的用例。我們也收集了這些復(fù)雜場(chǎng)景的高質(zhì)量圖片,并對(duì)不同組合中的先進(jìn)算法進(jìn)行全面的定量地比較。

圖8.Content-aware任務(wù)中各個(gè)組合的定性比較,從左至右分別是

關(guān)于結(jié)果的分析以及更多的實(shí)驗(yàn)結(jié)果請(qǐng)查閱原始論文。

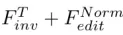

對(duì)于 content-free任務(wù),我們主要考慮基于主體驅(qū)動(dòng)的(subject-driven)客制化任務(wù)。并考慮了多種場(chǎng)景,如更換背景,與物體的交互,行為的改變,以及風(fēng)格的改變。我們也定義了大量的文本引導(dǎo)模板,對(duì)以各個(gè)方法的整體性能進(jìn)行定量分析。

圖9. Content-free任務(wù)中各個(gè)組合的定性比較,從左至右分別是

關(guān)于結(jié)果的分析以及更多的實(shí)驗(yàn)結(jié)果請(qǐng)查閱原始論文。

6.未來(lái)可以進(jìn)行的方向:

此外本文也給出了一些未來(lái)的可能一些研究方向分析。這里給出content-aware 任務(wù)和content-free 任務(wù)的挑戰(zhàn)作為例子。

6.1. Content-aware 任務(wù)的挑戰(zhàn)。對(duì)于content-aware 編輯任務(wù)的挑戰(zhàn),現(xiàn)有方法無(wú)法同時(shí)處理多種編輯場(chǎng)景和控制信號(hào)。這一限制迫使應(yīng)用在不同任務(wù)之間切換合適的后端算法。此外,一些高級(jí)方法在易用性方面不友好。某些方法需要用戶調(diào)整關(guān)鍵參數(shù)以獲得最佳結(jié)果,而其他方法則需要繁瑣的輸入,例如源和目標(biāo)提示,或輔助掩碼。

6.2,Content-free 任務(wù)的挑戰(zhàn)。對(duì)于content-free 編輯任務(wù),現(xiàn)有方法在測(cè)試時(shí)調(diào)優(yōu)過(guò)程冗長(zhǎng)且存在過(guò)擬合問(wèn)題 。一些研究旨在通過(guò)優(yōu)化少量參數(shù)或從頭開(kāi)始訓(xùn)練模型來(lái)緩解這一問(wèn)題。然而,它們常常會(huì)丟失個(gè)性化主體的細(xì)節(jié),或表現(xiàn)出較差的泛化能力。此外,當(dāng)前方法在從少量圖像中提取抽象概念方面也有所不足,它們無(wú)法完全將所需概念與其他視覺(jué)元素分離開(kāi)來(lái)。

更多的研究方向內(nèi)容可以查閱原始論文。