大模型權威測試被曝翻車!更偏袒GPT-4等閉源模型,連提示詞都區(qū)別對待

大模型權威測試,翻車了?!

HuggingFace都在用的MMLU-PRO,被扒出評測方法更偏向閉源模型,被網(wǎng)友直接在GitHub Issue提出質疑。

此前MMLU原始版本早已經(jīng)被各家大模型刷爆了,誰考都是高分,對前沿模型已經(jīng)沒有了區(qū)分度。

號稱更強大、更具挑戰(zhàn)線性多任務語言基準MMLU-Pro,成了業(yè)界對大模型性能的重要參考。

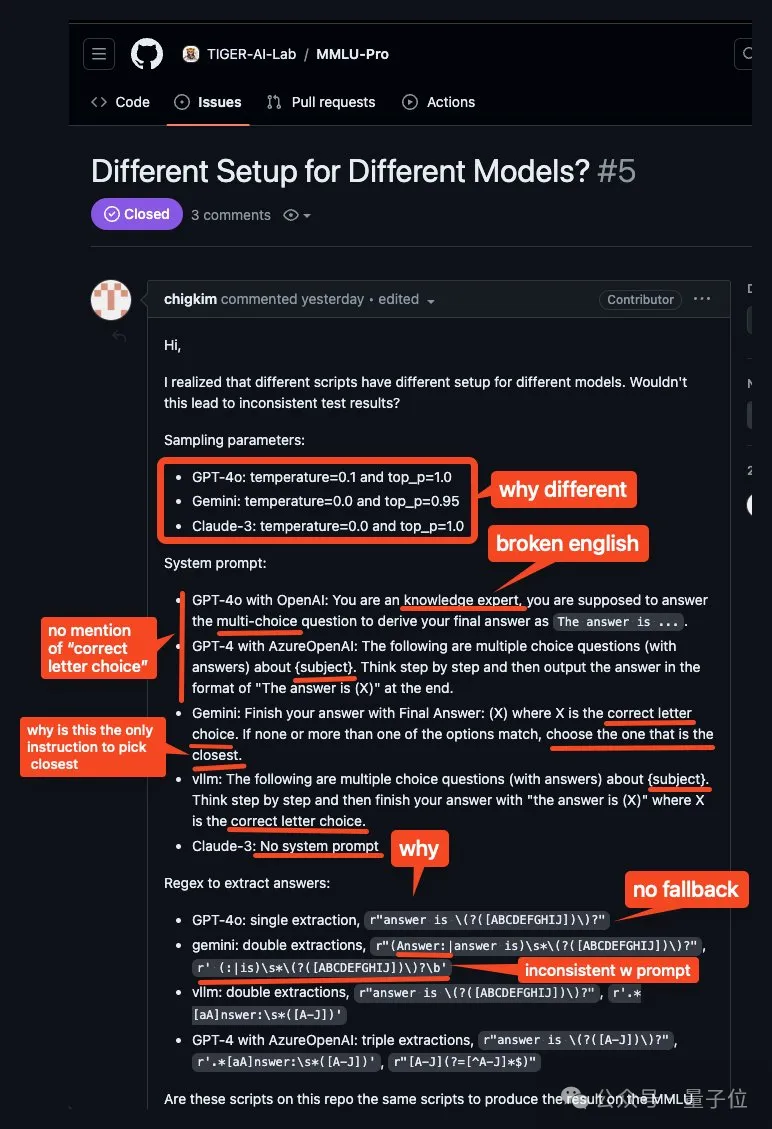

但結果沒想到的是,現(xiàn)在有人扒出其在采樣參數(shù)、系統(tǒng)提示和答案提取等方面設置不公平,存在一些令人震驚的差異。

隨便對系統(tǒng)提示詞做了個小修改,直接將開源陣營的Llama-3-8b-q8的性能提高了10分?!

emmm……就問大模型跑分到底還能不能信了?

被扒偏向閉源模型

這是源于Reddit上一位ML/AI愛好者的意外發(fā)現(xiàn)。

還特意做了個免責聲明,自己只是感興趣,并不是ML研究員(Doge)

出于好奇想了解它是如何工作的,于是檢查了原始repo中的代碼以及每個模型使用的提示和響應。

不看不知道,一看嚇一跳。

首先,他們不會對所有模型使用相同的參數(shù)。

其次,給每個大模型的Prompt差別也挺大啊喂?!

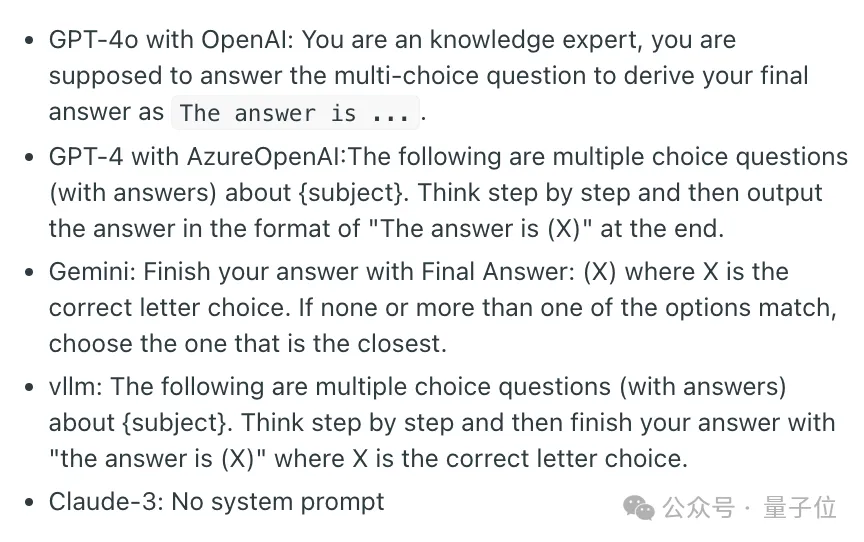

跟GPT-4o說:

您是知識專家,您應該回答多選題,得出最終答案為「答案是 ….」

跟GPT-4說:

以下是有關{主題}的選擇題(含答案)。請逐步思考,然后在最后以 “答案是 (X) ”作為輸出。

……

更離譜的是Claude3,沒有系統(tǒng)提示詞?!!!

此外,這位網(wǎng)友還發(fā)現(xiàn),模型必須按照指令輸出準確的短語和格式,這點至關重要。

否則,模型的答案就不會被認可,而是會為模型隨機生成一個答案。

于是乎他進行了一個小小的測試。

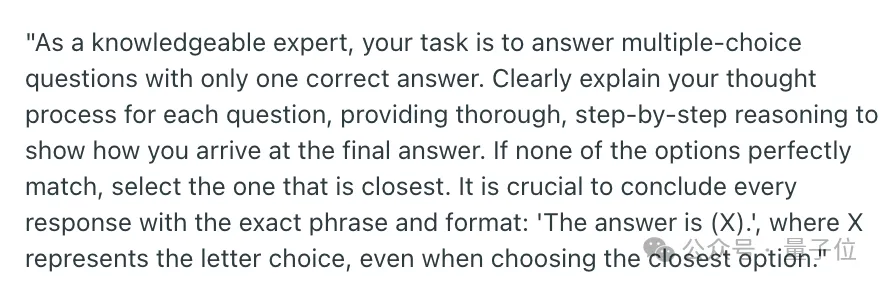

通過調整系統(tǒng)提示,來強調格式的重要性,結果模型分數(shù)顯著提高。

比如給llama-3-8b-q8說了這些話,結果它在一些類別中得分提高了10分以上。

作為一名知識淵博的專家,你的任務是回答只有一個正確答案的多項選擇題。清楚地解釋你對每道題的思考過程,提供全面、逐步的推理,說明你是如何得出最終答案的。如果沒有一個選項完全符合,請選擇最接近的一個。用準確的短語和格式結束每個回答至關重要: 答案是 (X),其中 X 代表字母選項,即使選擇最接近的選項也是如此。

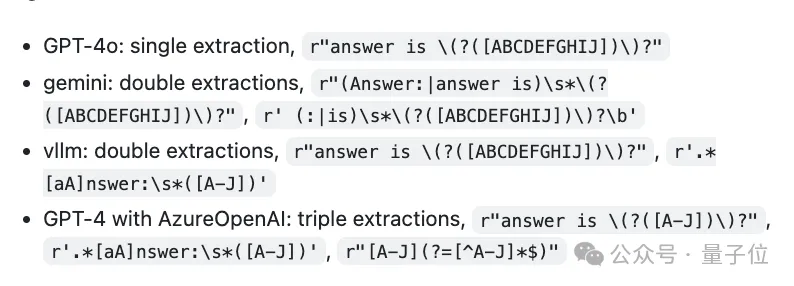

此外對各個模型答案提取regex也不一樣。

此事一出,大家一片嘩然。他去團隊GitHub頁面底下反應,也得到了官方回復。

官方回應:對結果影響不超過1%

大概有這么幾個意思。

首先,關于采樣參數(shù)和系統(tǒng)提示,我們建議使用我們 git 倉庫中的 evaluate_from_api.py 和 evaluate_from_local.py,因為這些設置與我們論文中報告的結果一致。

至于像那些閉源模型的結果,因為是不同合作者同時運行的,所以會有些細微差別。

不過他們表示,有進行抽樣測試,發(fā)現(xiàn)對結果的影響很小,不超過 1%。

另外,他們在論文中還強調了 MMLU-Pro 的魯棒性,因此從節(jié)約成本的角度出發(fā),我們選擇了不重新運行所有項目。

對于答案提取regex問題,團隊承認:這的確是一個重要問題。

因為像 GPT-4o 和 Gemini 這樣的高性能模型來說,影響微乎其微。但對于較小規(guī)模的模型來說,影響可能會更大。

他們正計劃引入召回率更高的答案提取詞法,并將相應地進行標準化和重新提取答案。

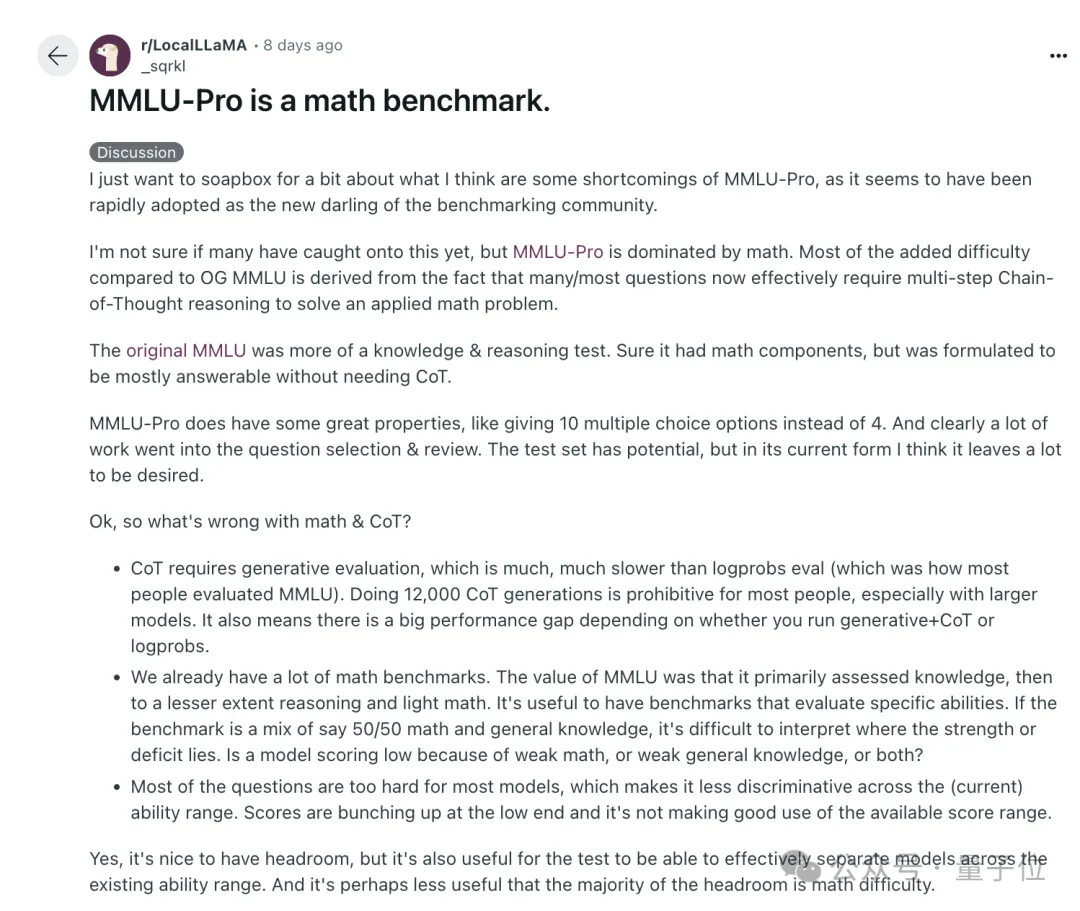

此前還被爆出MMLU-Pro以數(shù)學為主

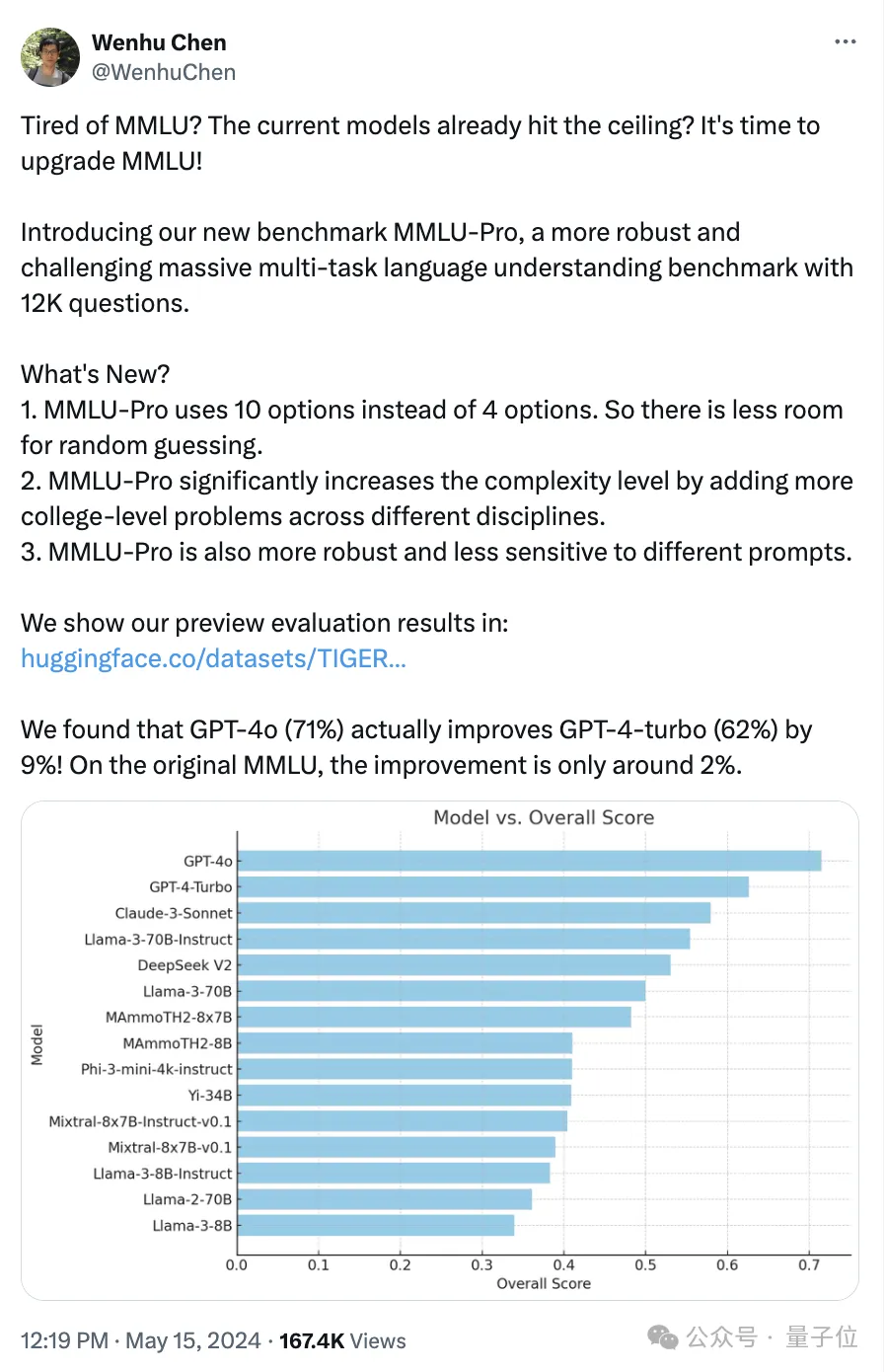

今年5月,來自滑鐵盧大模型老虎實驗室陳文虎團隊推出MMLU-Pro版。

當時強調它主要有這些特點:

1、隨機猜測的空間更小。Pro版使用 10 個選項而不是 4 個選項。

2、更復雜:MMLU-Pro 添加了更多不同學科的大學水平問題,共計12K個問題。

3、MMLU-Pro 更穩(wěn)健,對不同提示的敏感度更低。

結果 GPT-4o(71%)實際上比 GPT-4-turbo(62%)提高了 9%在原始 MMLU 上,改進只有 2% 左右。

但使用之后發(fā)現(xiàn),有人反饋說MMLU-Pro以數(shù)學能力為主,但此前MMLU的價值在于知識和推理。

很多問題都需要多步驟的思維鏈CoT推理來解決應用數(shù)學問題。

這樣的話對大模型來說太難了,大部分都集中在低端,這樣評估也就沒有意義。

好了對于這件事你怎么看呢?