理想汽車最新!DiVE:擴散模型+Vit的高保真、時間一致的視頻生成

本文經自動駕駛之心公眾號授權轉載,轉載請聯系出處。

原標題:DiVE: DiT-based Video Generation with Enhanced Control

論文鏈接:https://arxiv.org/pdf/2409.01595

項目鏈接:https://liautoad.github.io/DIVE/

代碼鏈接:https://github.com/LiAutoAD/DIVE

作者單位:哈爾濱工業大學(深圳) 理想汽車 清華大學 Westlake University 新加坡國立大學

論文思路:

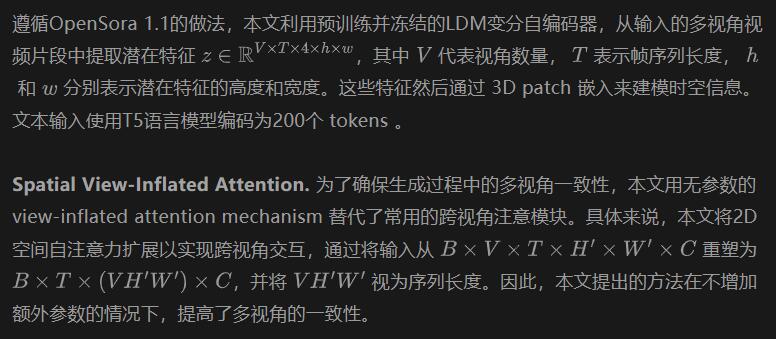

在自動駕駛場景中生成高保真、時間一致性的視頻面臨著顯著的挑戰,例如在極端情況(corner cases)下的問題操作(problematic maneuvers)。盡管最近提出了一些視頻生成工作來解決上述問題,例如基于 Diffusion Transformers(DiT)的模型,但仍然缺乏專門探索多視角視頻生成潛力的研究。值得注意的是,本文提出了首個基于DiT的框架,專門設計用于生成與給定鳥瞰圖布局控制精確匹配的時間和多視角一致性視頻。具體而言,所提出的框架利用無參數的 spatial view-inflated attention 來保證跨視角一致性,其中集成了 joint cross-attention modules 和ControlNet-Transformer 以進一步提高控制的精度。為了展示本文的優勢,本文在nuScenes數據集上進行了廣泛的定性比較,特別是在一些最具挑戰性的極端情況下。總的來說,本文提出的方法在困難條件下生成長時間、可控且高度一致性視頻方面被證明是有效的。

論文設計:

鳥瞰視角(Bird’s-Eye-View, BEV)感知在自動駕駛中引起了極大的關注,突顯了其在3D目標檢測等任務中的巨大潛力。最近的方法如StreamPETR 利用多視角視頻進行訓練,強調了廣泛且良好標注的數據集的必要性。然而,在各種條件下收集和標注此類數據具有挑戰性且成本高昂。為了解決上述挑戰,生成模型的最新進展表明,合成數據可以有效地提高目標檢測和語義分割等各種任務的性能。

由于時序數據在視頻中的參與在相關感知任務中起著至關重要的作用,本文的重點轉向生成高質量的真實感視頻。實現現實世界的逼真度需要高視覺質量、跨視角和時間一致性以及精確的可控性。值得注意的是,最近方法的潛力受到限制,原因包括低分辨率、固定縱橫比以及物體形狀和顏色的不一致性。受Sora在生成高質量、時間一致性視頻任務中成功表現的啟發,本文在工作中采用 Diffusion Transformer (DiT) 進行可控的多視角視頻生成。

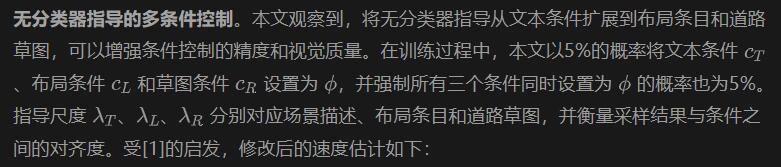

本文提出的框架是首批在駕駛場景中使用 DiT 進行視頻生成的工作之一,通過整合 BEV 布局和場景文本,實現了精確的內容控制。基于OpenSora架構,本文的方法嵌入了 joint cross-attention modules ,以管理來自鳥瞰視角的場景文本和實例布局。擴展ControlNet-Transformer方法以適應道路草圖,本文通過無參數的 spatial view-inflated attention 確保多視角一致性。為了支持多分辨率生成、更快的推理以及不同的視頻長度,本文采用了OpenSora的訓練策略,并引入了一種新穎的無分類器指導技術,以增強控制和視頻質量。

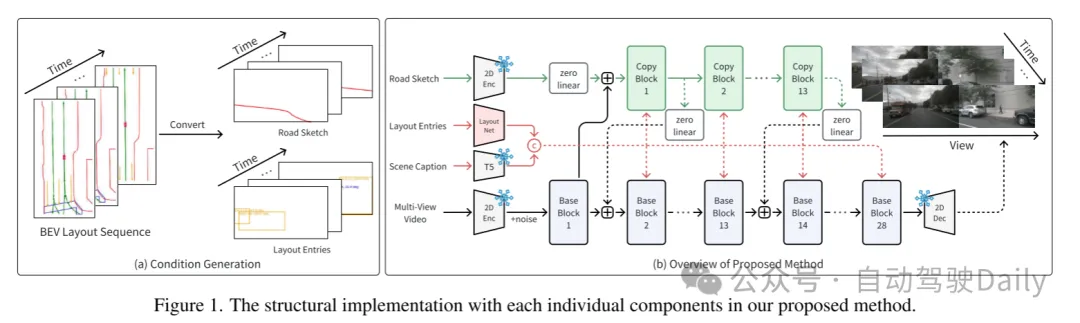

圖1. 本文提出的方法中每個獨立組件的結構實現。

圖1. 本文提出的方法中每個獨立組件的結構實現。

本文的模型總體架構如圖1所示。采用OpenSora 1.1提出的參數模型作為基線模型。為了實現對前景和背景信息的精確控制,本文將通過投影從3D幾何數據中提取的布局條目和道路草圖整合到布局條件視頻生成過程中。本文提出的新模塊和訓練策略將在接下來的部分中分別介紹。

多條件時空DiT

Caption-Layout Joint Cross-Atttention. 按照MagicDrive的方法,本文使用交叉注意力機制來整合場景描述(scene captions)和布局條目(layout entries)。布局條目(即實例的詳細信息,如2D坐標、朝向和ID)經過傅里葉編碼后合并為一個統一的嵌入。實例標題則使用預訓練的CLIP模型進行編碼。這些嵌入被連接并通過一個多層感知器(MLP)處理,生成最終的布局嵌入,該嵌入與場景描述嵌入一起作為交叉注意力機制的條件。

ControlNet-Transformer。深入細節,本文引入了ControlNet-Transformer,以確保對道路草圖控制的精確性,靈感來自PixArt-δ。實際上,一個預訓練的變分自編碼器(VAE)從道路草圖中提取潛在特征,這些特征然后通過 3D patch embedder 處理,以確保與本文主網絡的一致性。為了參數化本文提到的設計,本文將13個重復塊(duplicated block)與DiT架構的前13個基礎塊集成。每個重復塊結合了道路草圖特征和基礎塊輸出,使用空間自注意力來減少計算開銷。

訓練

可變分辨率和幀長度。遵循OpenSora的做法,本文采用了Bucket策略,以確保每個批次中的視頻具有一致的分辨率和幀長度。

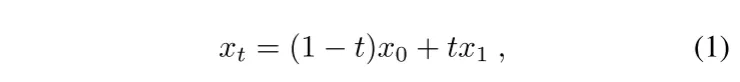

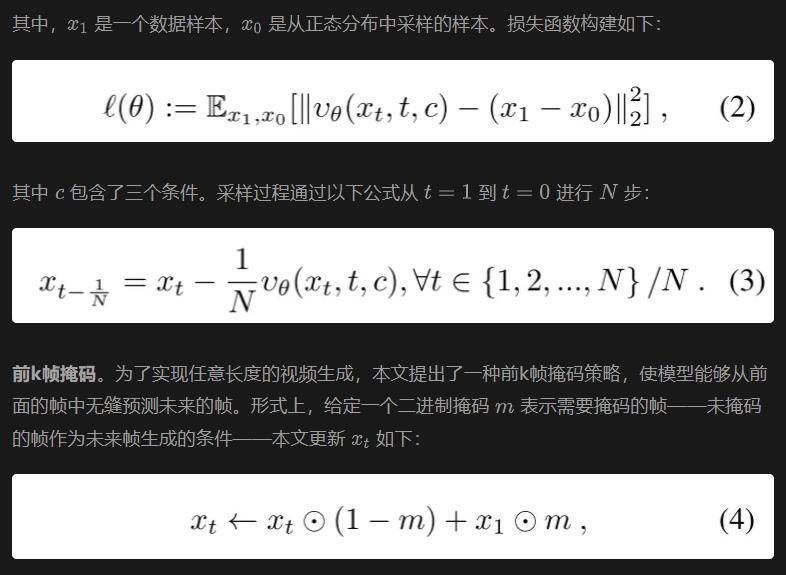

Rectified Flow。受OpenSora 1.2的啟發,本文在后期訓練階段用校正流替代了IDDPM,以提高穩定性并減少推理步驟。校正流是一種基于 ODE 的生成模型,其定義了數據和正態分布之間的前向過程如下:

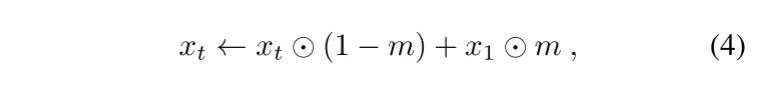

損失僅在未掩碼的幀上計算。在推理過程中,視頻以自回歸方式生成,前一個片段的最后k幀作為下一個片段的條件。

實驗結果:

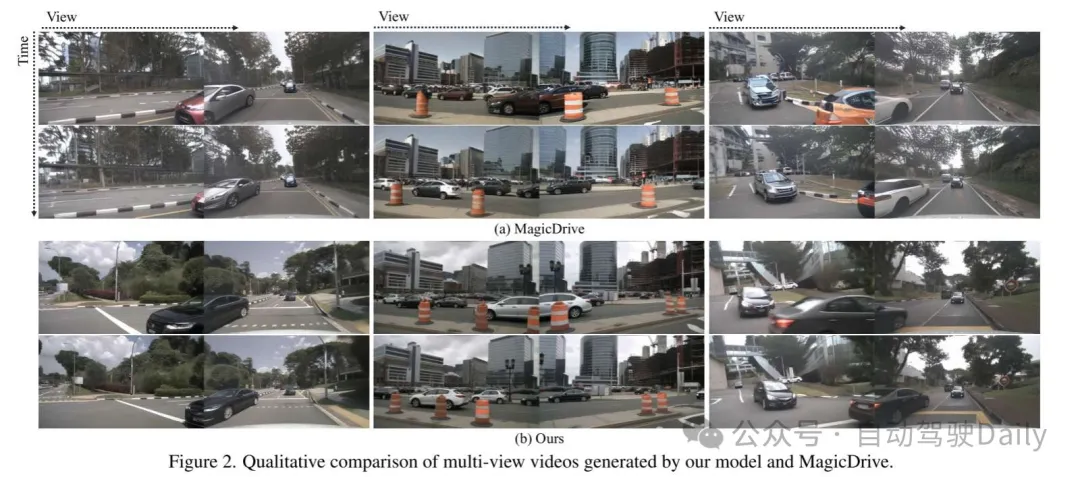

圖2. 本文的模型與MagicDrive生成的多視角視頻的定性比較。

圖2. 本文的模型與MagicDrive生成的多視角視頻的定性比較。

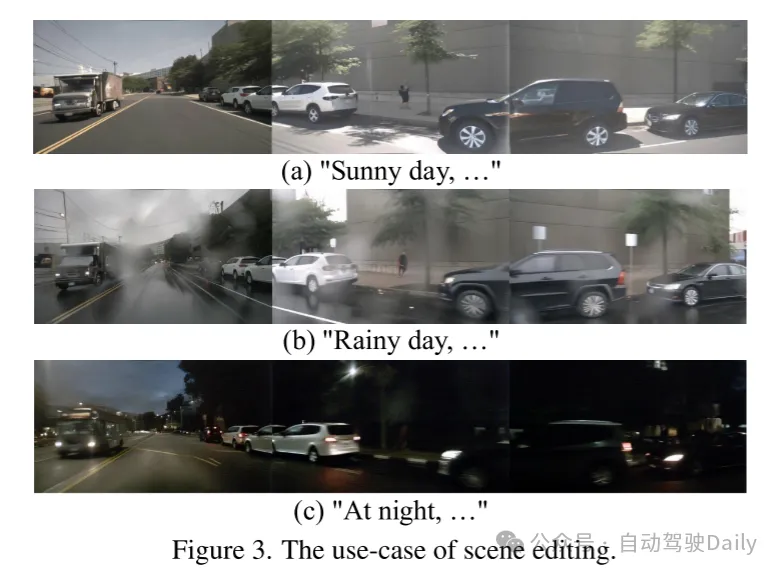

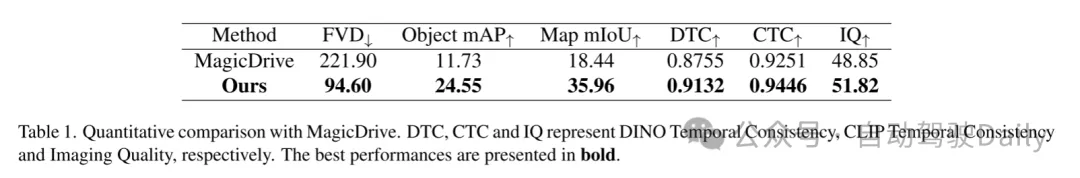

圖3. 場景編輯的使用案例。 表1. 與MagicDrive的定量比較。DTC、CTC和IQ分別代表DINO時間一致性、CLIP時間一致性和圖像質量。最佳表現以粗體顯示。

表1. 與MagicDrive的定量比較。DTC、CTC和IQ分別代表DINO時間一致性、CLIP時間一致性和圖像質量。最佳表現以粗體顯示。

總結:

本文提出了首個針對駕駛場景的基于DiT的可控多視角視頻生成模型。通過整合 ControlNet-Transformer 和 joint cross-attention ,實現對 BEV 布局的精確控制。Spatial view-inflated attention 結合全面的訓練和推理策略,確保了高質量和一致性的視頻生成。與MagicDrive的比較和各種可視化進一步展示了該模型在生成視頻中的卓越控制和一致性。