多模態對齊在小紅書推薦的研究及應用

在 CIKM 2024 上,小紅書中臺算法團隊提出了一種創新的聯合訓練框架 AlignRec,用于對齊多模態表征學習模型和個性化推薦模型。本文指出,由于多模態模型與推薦模型在訓練過程中存在步調不一致問題,導致聯合訓練被推薦信號主導,從而丟失大量多模態信息。AlignRec 通過分階段對齊的方式,設計了三種針對性的優化損失函數,使得聯合訓練能夠同時兼顧多模態信息和推薦信息。實驗結果表明,AlignRec 在多個數據集上的性能超過了現有的 SOTA(state-of-the-art)模型。此外,AlignRec 還提供了在當前廣泛使用的公開數據集亞馬遜上的預處理特征,這些特征的效果顯著優于現有的開源特征。

01背景

最近多模態是個非常熱門的話題,尤其是在大模型以及 AIGC 領域,多模態基建和技術是走向未來商業化的奠基石。在過去的多模態大模型研究方向上,模態的“對齊”已經被驗證非常重要,分布的不一致損害不同模態的理解,我們此次要討論的核心問題是多模態在推薦中的對齊問題;

在具體介紹論文工作之前,我們先來介紹下我們過去在推薦和電商中的實踐工作:

推薦實踐

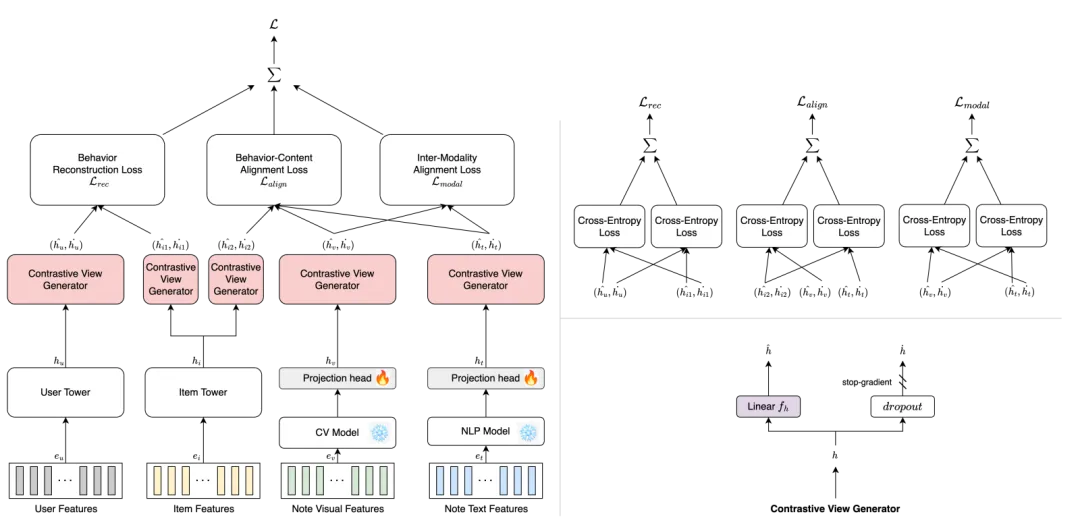

上述方法是我們對 BM3論文進行改進 上線的方案,該方案實際上做的是通過損失函數來實現“對齊”工作。我們的對模型的期望也是保留個性化的同時,能夠對齊行為和多模態的空間,進一步增加長尾的個性化分發能力。先說效果:

該模型實驗在推薦發現頁取得時長、曝光、點擊等核心指標收益,除此之外,在長尾分發上,0 粉作者筆記點擊和曝光獲得大幅增長,整個召回路增加了全局可分發筆記數 6%,分發筆記集中在 1k-5k 的筆記曝光集合;同時,我們的方法也被復用在了電商場景,分發長尾同時,獲得 DGMV 等核心指標收益。

很顯然,從上述可以看出,“對齊”的效果立竿見影,在業界應用上我們已經取得實質性進展,但本質上這樣的設計方案依然并沒有完全解決多模態推薦問題,因為我們的多模態模型和推薦模型是相對割裂的,等同于直接拿表征來使用,這樣的設計打通了應用范式,卻無法判斷多模態模型本身能力對效果的上限,對于選擇合適多模態表征存在一定的難度。但如果我們引入文本/圖等 Encoder(Transformer)等進行聯合訓練,會引入如下的問題:

- 在大規模的數據下,分布式訓練引入圖文 Encoder 會造成資源和性能問題,尤其是注重高時效性的 Streaming Data;

- 訓練步調不一致,往往多模態模型需要大量數據甚至多個 Epoch 才能收斂,但推薦模型通常采取單輪訓練,這也導致多模態模型訓練不充分;

所以我們設計聯合訓練模型,通過設計分階段對齊的方式和中間指標評估,解決上述聯合訓練問題,并且引入了三種針對性的優化損失函數,使得聯合訓練能夠同時兼顧多模態信息和推薦信息,解決聯合訓練中的“對齊”問題,提升效果上限。

下面我們從相關工作,核心挑戰,模型設計介紹整體工作。

02相關工作

我們在這里通過 (a), (b), (c) 描述了在過往的學術界目前多模態推薦方向的相關工作,總結主要的發展路徑:

- 圖(a),直接利用,比如把 embedding,多模態特征作為信號輸入網絡;

- 圖(b),利用圖等方式聚合,希望能得到更豐富的多模態信息表達,這本質上也是增加多模態側信息的召回率;

- 圖(c),聯合優化,把模態損失和行為損失共同優化,但這忽略了本身筆記側的多模態學習。

在工業界,現階段推薦系統主要還是依賴于 ID 特征的學習, 大多數多模態推薦把多模態信息作為 sideinfo 去輔助 ID 特征的學習。但是, 多模態之間以及 ID 模型與多模態之間都存在著語義鴻溝, 直接使用甚至可能適得其反。

核心挑戰

為了貼合業界實際,設計一款有效的多模態與推薦聯合訓練模型會遇到如下的挑戰:

- 挑戰1: 如何對齊多模態表征。包括內容模態之間(如圖文)的對齊,以及內容模態與 ID 模態之間的對齊;

- 挑戰2: 如何平衡好內容模態和 ID 模態之間的學習速度問題。內容模態可能需要超大規模的數據和時間去訓練, 而 ID 模態的學習更新可能只需要幾個 epoch。

- 挑戰3: 如何評估多模態特征對推薦系統的影響。引入不合適的多模態信息可能需要更多的精力去做糾正, 甚至可能影響推薦系統的性能。

03設計方案

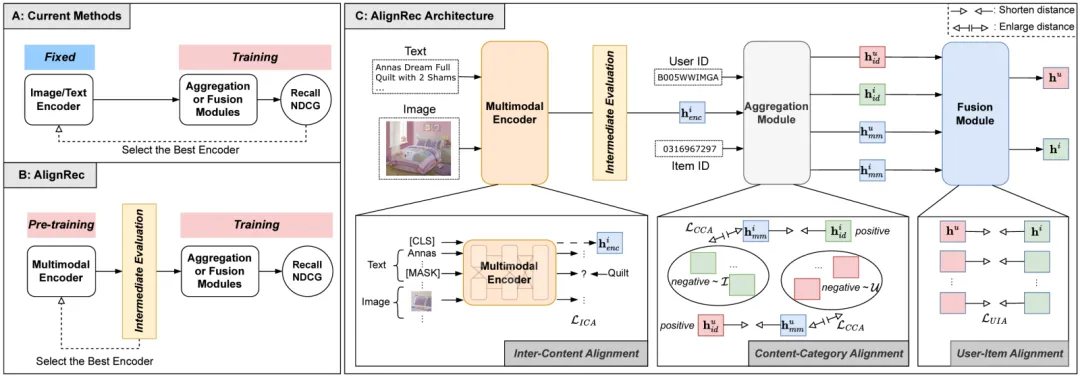

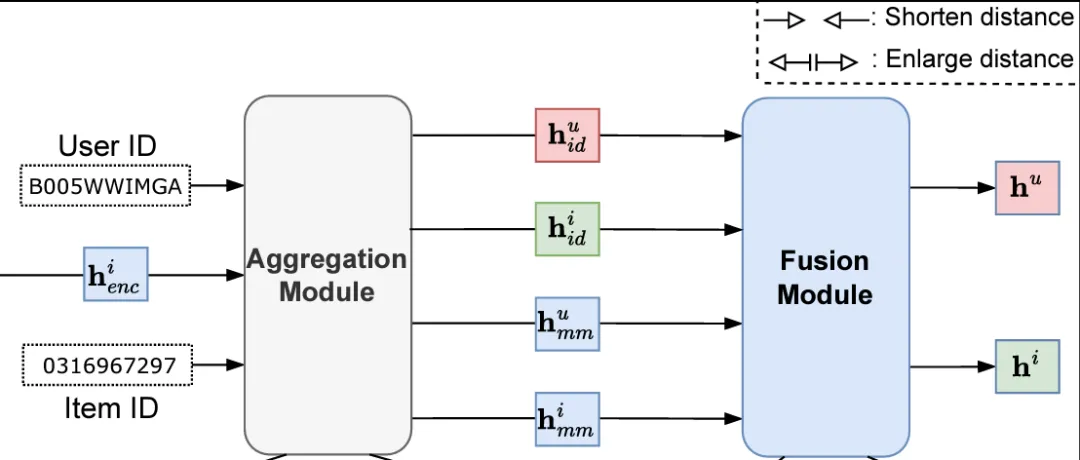

我們所提出的方法命名為 AlignRec,整體框架如下圖所示, 主要包含3個模塊: Multimodal Encoder Module, Aggregation Module, 以及 Fusion Module, 下面分別進行介紹。

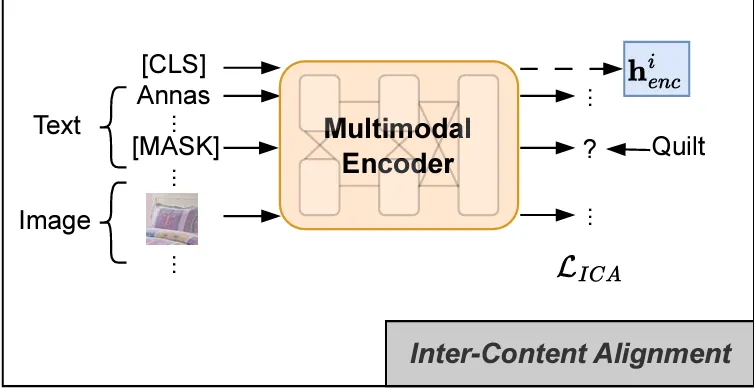

Multimodal Encoder Module

??????????是一個預訓練的模塊, 它以物品的多個內容模態為輸入,實現物品側視覺模態 和文本模態

的對齊, 最后統一輸出多模態表征

:

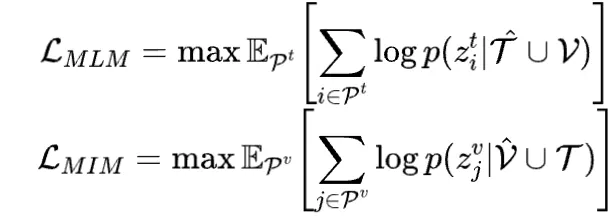

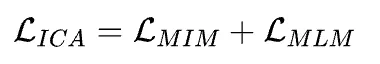

具體地, 我們使用 BEiT3 作為骨干網絡, 通過 mask-then-predict 策略進行訓練, 包括 mask-image-modeling (MIM) 和 mask-language-modeling (MLM), 分別 mask 掉一定比例的圖/文 token, 再嘗試訓練恢復還原出正確的 token, 這兩個任務分別對應著不同的 Loss

再將兩者的 Loss 進行相加得到預訓練階段的 Loss

在應用時, 取 CLS token 作為物品側統一的多模態表征。

對于 Open DataSource 我們并不會加入顯式的行為信息,確保多模態模型的能力和合理性,但在業界實際使用時,我們通常會加入協同信號;

Aggregation Module

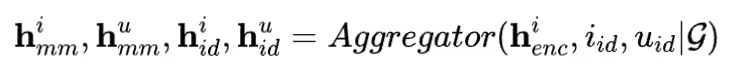

這個模塊以 ID 模態和前面統一的內容模態為輸入,構建異構圖,基于 GCN(作者使用 LightGCN)做多層聚合,從而輸出 User 和 Item 的 ID 模態,User 的多模態表征,Item 的多模態表征。

流程上總計分為三個步驟:

- User 側和 Item 側的 ID 模態,通過圖聚合的方式,得到 User 和 Item 的表征,分別表示為

和

;

- 物品側的多模態表征,內容模態表征經過一個 MLP 進行映射,再做 Element-wise 乘積與 ID Embed 進行融合, 得到融合了內容先驗知識的內容表征,之后基于統一的內容模態表征, 構造物品側的相似矩陣,每個物品取與它最相似的 10 個 Item 做聚合, 得到物品側的多模態表征輸出,表示為

;

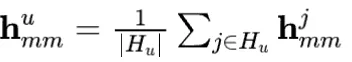

- 用戶側的多模態表征,對于 User 側,通過聚合用戶歷史交互過的 Item 得到用戶側的多模態表征,表示為

;

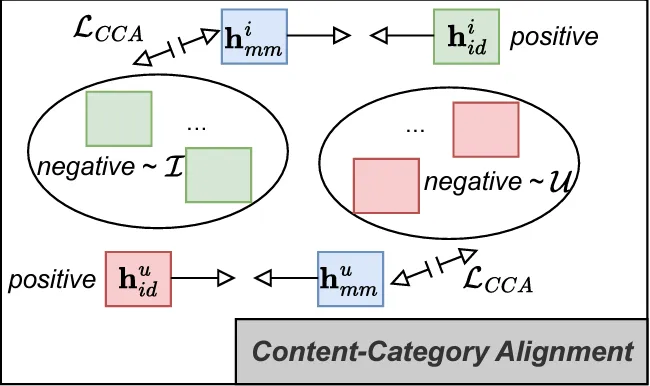

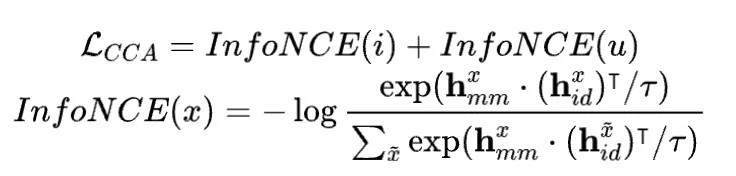

訓練細節上,我們使用 InfoNCE 對齊內容模態表征和 ID 模態表征,讓同 Item 的內容模態表征與 ID 模態表征更接近,不同 Item 的內容模態表征及 ID 模態表征的距離更疏遠。但如果不加任何約束, 可能會盲目地趨近于表征

,引起模態表征坍塌。為了規避這個問題,我們增加了正則項約束:

Fusion Module

這個模塊的作用在于融合 ID 模態表征和多模態表征, 從而得到 User 側表征和 Item 側表征, 用于召回的 topK 向量檢索

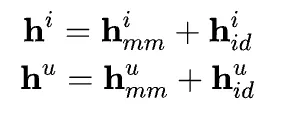

將相應的表征進行相加:

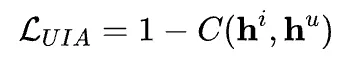

在得到 User 側和 Item 側的表征之后,我們增加了個 User 側和 Item 側的對齊,具體地,我們對用戶表征 以及交互 Item 對應的表征

作了相似度約束。

統一訓練

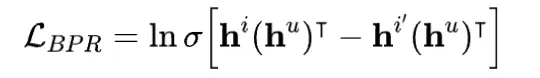

推薦任務會使用 BPR 計算損失:

前面挑戰 2 提到, 內容模態和 ID 模態的學習速度有很大差異, 因此, 會先在預訓練階段對齊不同內容模態, 得到統一的內容模態表征輸出。而在后續的 End2End 訓練階段, 則加權融合推薦任務的損失, 正則化損失, 以及前面多個對齊目標損失, 得到最終的訓練損失。

中間評估指標

為了更準確評估多模態特征在推薦系統中的適用性及應用效果, 我們提出了 3 種中間評估方案:

Zero-Shot推薦

用于評估基于用戶歷史交互行為, 多模態特征能否反映出用戶興趣, 包括 3 個步驟:

- 按時間順序對用戶歷史交互行為排序, 取最后一個行為作為Target Item,其余作為用戶歷史行為交互

- 基于用戶歷史行為交互,計算用戶的多模態表征:

計算 與 Target Item 的相似度, 判斷是否在TopK中出現

Item-CF推薦

用于評估只使用多模態特征, 基于協同過濾的方法進行物品推薦的能力

- 計算每對 Item 的I tem-CF 分數;

- 為每個 Item j , 選擇最高 Item-CF 分數所對應的Item i 作為 Target Item;

- 使用多模態表征計算 Item j 與候選集里其它 Item 的相似度得分, 判斷 Item i 是否在 TopK 里。

Mask Modality推薦

按一定比例 mask 視覺模態或文本模態, 衡量最終推薦效果差異, 從而評估不同內容模態的重要度。

04實驗結論

在不同數據集上與各 baseline 模型做對比,在目前的多模態公開數據集表現上達到 SOTA:

Pretraining 的模型在論文所提各中間評估指標上均超越 CLIP 的表現:

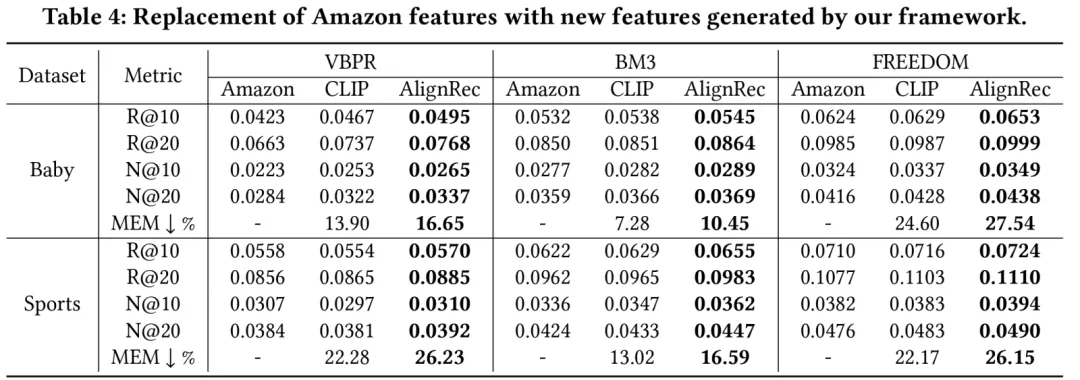

在開源數據集上生產的多模態特征與開源多模態特征對比效果上,AlignRec 的性能明顯提升:

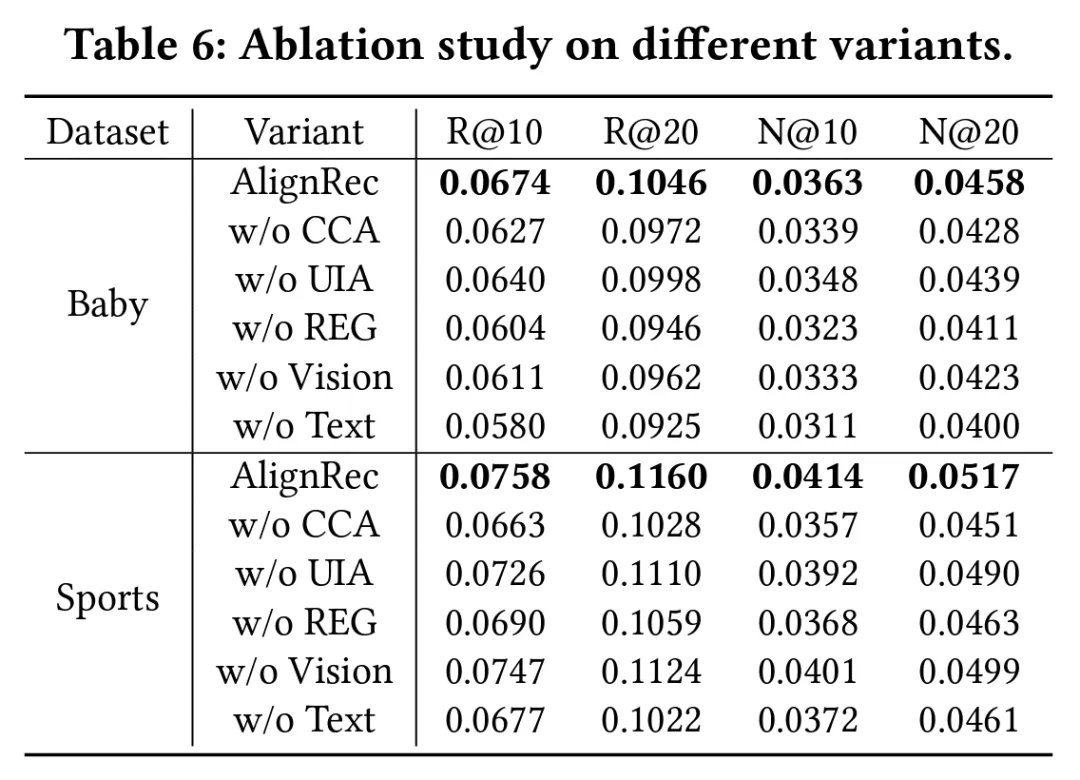

下面的表格也展示了不同模塊的消融效果:

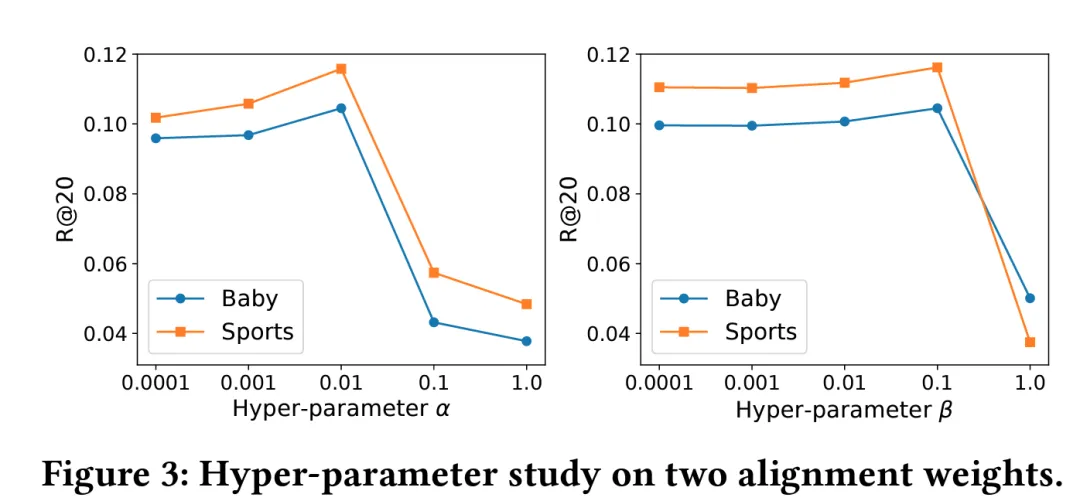

我們也列出了各個超參數對效果影響:

最后,我們也對比了長尾的效果:

05總結

我們的貢獻可以被總結為三點:

- 我們一直在探索對齊問題,并且通過小紅書推薦實踐,設計了可復用的多模態召回范式,已經拿到了線上AB收益;

- 提出AlignRec聯合訓練方式,深入解決對齊問題,提出分階段對齊的模式和中間指標評估方式;

- 最后,我們對Amazon的數據集整體的多模態數據源進行升級,為后續研究打下基礎。

06作者簡介

- 幻翎

小紅書算法工程師,主要研究方向:通用推薦模型算法,多模態算法研究和應用。 - 圖森

小紅書算法工程師,主要研究方向:通用多模態算法,大模型算法研究。 - 特圖

小紅書基礎模型團隊負責人,主要研究方向:多模態大模型 x 內容分發技術。 - 大輔

小紅書應用模型團隊負責人,主要研究方向:通用推廣搜模型算法,多模態和大模型技術的研究和應用。