NeurlPS'24開源 | RealMotion:連續自動駕駛中的運動預測

0. 論文信息

標題:Motion Forecasting in Continuous Driving

作者:Nan Song, Bozhou Zhang, Xiatian Zhu, Li Zhang

機構:Fudan University、University of Surrey

原文鏈接:https://arxiv.org/abs/2410.06007

代碼鏈接:https://github.com/fudan-zvg/RealMotion

1. 導讀

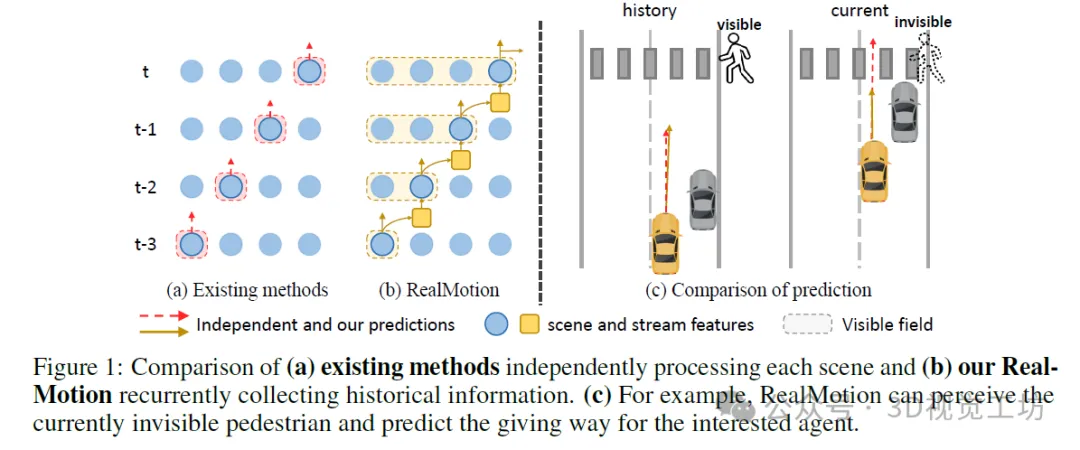

由于每個智能體的下一步行動有許多可能性以及它們在空間和時間上的復雜交互,自動駕駛中智能體的運動預測極具挑戰性。在實際應用中,隨著自動駕駛汽車的移動,運動預測會重復不斷地發生。然而,現有的預測方法通常獨立處理一定范圍內的每個駕駛場景,完全忽略了連續駕駛場景之間的情境和上下文關系。這極大地簡化了預測任務,使得解決方案在實踐中不是最佳的和低效的。為了解決這一基本限制,我們提出了一種新的連續駕駛運動預測框架,名為RealMotion。它包括兩個完整的場景級流:(1)場景上下文流漸進地累積歷史場景信息直到當前時刻,捕捉場景元素之間的時間交互關系。(2)代理軌跡流通過順序轉發過去的預測來優化當前的預測。此外,還引入了數據重組策略,以縮小現有基準和現實應用之間的差距,與我們的網絡保持一致。這些方法能夠更廣泛地利用跨空間和時間的動態運動的情境和漸進的洞察力。在不同設置的Argoverse系列上的大量實驗表明,我們的RealMotion實現了最先進的性能,以及高效的真實世界推理的優勢。

2. 引言

運動預測是當代自動駕駛系統中的關鍵要素,它使自動駕駛車輛能夠預測周圍主體(agent)的運動模式。這一預測對于確保駕駛的安全性和可靠性至關重要。然而,眾多復雜因素,包括隨機的道路狀況和交通參與者多樣化的運動模式,使得解決這一任務頗具挑戰性。近期的研究聚焦于表征和建模的研究,同時越來越重視精確的軌跡預測。此外,該領域還越來越關注多主體預測這一更具挑戰性但更有價值的子任務。這些進展共同推動了近年來運動預測領域的顯著進步。推薦課程:面向自動駕駛領域的3D點云目標檢測全棧學習路線!(單模態+多模態/數據+代碼)。

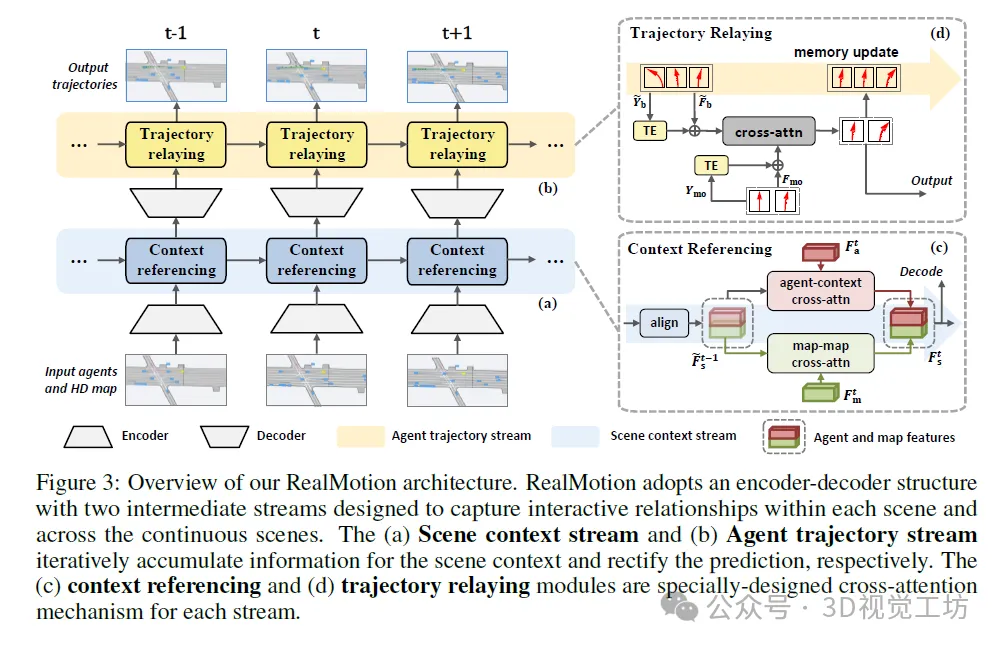

我們提出了一種用于連續駕駛的高效上下文運動預測框架,名為RealMotion。它包含兩個用于場景狀態轉換的流:(1)場景上下文流,該流逐步累積歷史場景上下文,捕捉場景元素之間的時間交互,并應對復雜的駕駛情況。(2)主體軌跡流,該流持續優化車輛等動態主體的預測,考慮時間一致性約束,并捕捉精確的運動意圖。每個流都利用專門設計的交叉注意力機制來轉換場景狀態并實現其功能。

3. 效果展示

我們意識到現有方法孤立地處理運動預測任務,即它們將有限范圍內的每個獨立駕駛場景視為互不相關的個體,忽略了在真實情況下,任何自動駕駛車輛在行駛過程中,運動預測本質上都是時間上相互關聯的。這意味著先前的方法忽略了連續場景之間的駕駛上下文,以及來自先前駕駛時段的相應潛在有用信息(圖1)。

4. 主要貢獻

我們的貢獻總結如下:(i)我們從實際應用的角度出發解決運動預測問題,這使得能夠提取和利用有價值的情境知識和漸進知識。(ii)我們引入了RealMotion,這是一種新穎的運動預測方法,它隨時間順序利用場景上下文和預測的主體運動狀態,同時保持較低的現實世界推理延遲。(iii)為了支持在現有基準上的連續駕駛設置,我們實現了一種數據重組策略來生成場景序列,緊密模擬現實世界中的駕駛場景。在Argoverse系列數據集上進行的大量實驗表明,在不同設置下,RealMotion均達到了最先進的性能。

5. 方法

鑒于現有基準測試與實際應用之間的差異,我們的首要步驟是對這些數據集進行重新組織,將每個樣本場景轉換為連續序列,以模擬連續的真實駕駛場景。具體而言,我們通過將智能體軌跡均勻分割為較短的片段并采樣局部地圖元素(參見圖2),來回顧性地檢查每個獨立場景。具體來說,我們首先沿著歷史幀步驟選擇幾個分割點Ti。然后,從這些點分別向過去和未來延伸,生成等長的軌跡片段。歷史和未來步驟的數量分別由最小分割點和真實軌跡的長度決定。此外,在每個分割點,我們為感興趣的智能體聚合一定范圍內的周圍智能體和局部地圖,形成一系列子場景。這種重新組織方式能夠自由利用原始元素,從而在場景層面為模型優化提供有價值的環境信息和漸進見解。因此,現有方法也可以引入這種新型數據結構并從中受益。

如圖3所示,我們的RealMotion方法包括編碼器、解碼器、場景上下文流和智能體軌跡流。遵循編碼器-解碼器結構,這兩個流被設計為執行時序建模,重點關注時間維度上的上下文信息和軌跡預測。

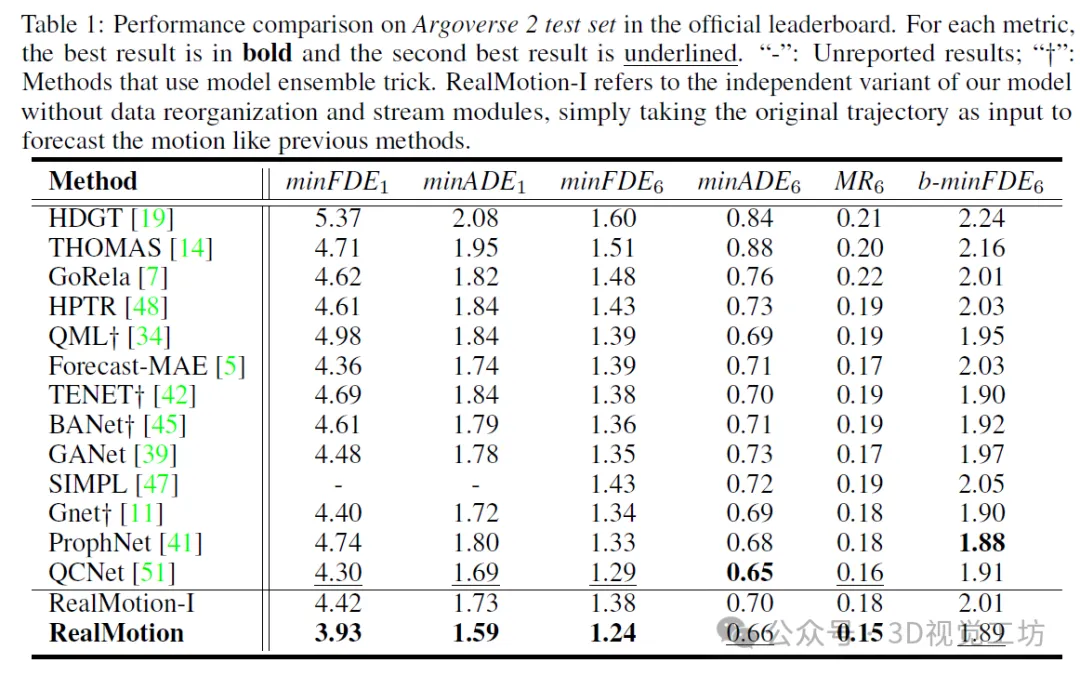

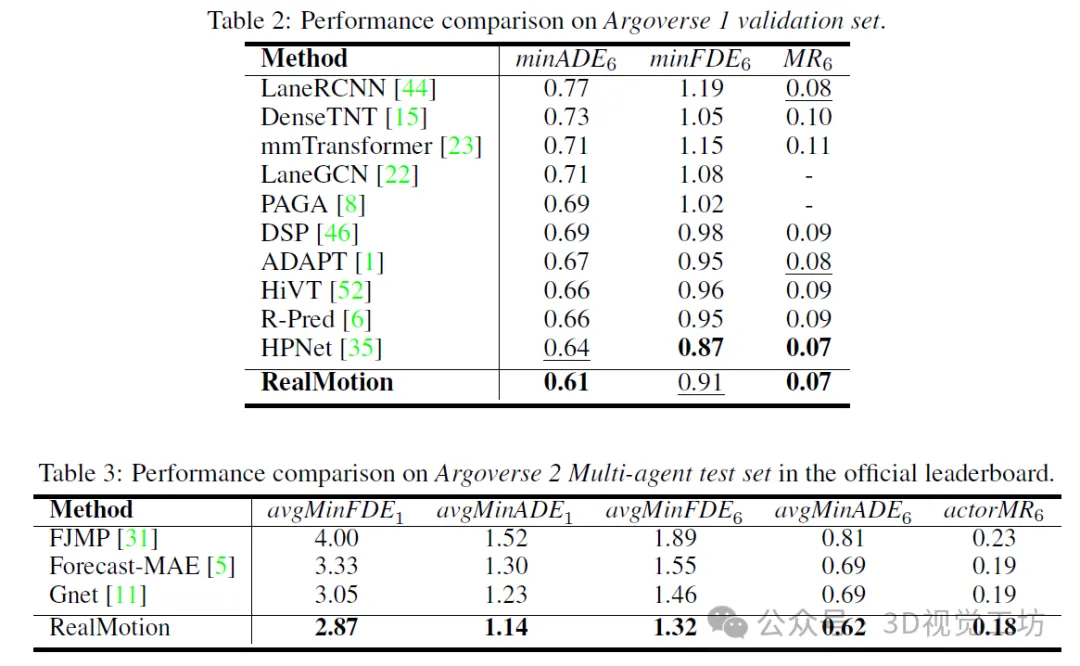

6. 實驗結果

7. 總結 & 局限性

在本文中,我們計劃從更貼近實際的連續駕駛角度出發來解決運動預測任務。這本質上相較于之前的設定,將運動預測功能置于了一個更廣泛的場景背景中。我們進一步提出了RealMotion,這是一個專為支持在時空上連續進行預測動作而設計的通用框架。我們框架的關鍵組件包括場景上下文流和代理軌跡流,這兩者都以序列化的方式工作,并逐步捕捉時間關系。我們在多種設定下進行了廣泛的實驗,全面證明了RealMotion超越了當前最先進的性能水平,從而為快速發展的自動駕駛領域中的安全可靠運動預測提供了一個有前景的方向。

我們數據處理方法的一個明顯限制是需要足夠數量的歷史幀來進行序列化。因此,它不適用于如Waymo Open Dataset等僅提供10幀歷史軌跡的短期基準測試。此外,現有的數據集通常提供的歷史信息與真實世界場景差異較大且有限,這阻礙了我們的序列化設計充分發揮其優勢。因此,我們期望在未來的工作中將我們的框架集成到序列化的自動駕駛系統中,以最大化流式設計的效益。